Эта статья — об операторе Гамильтона в квантовой механике. О функции Гамильтона в классической механике см. Функция Гамильтона.

| Квантовая механика |

|---|

|

|

Основа

|

|

Фундаментальные понятия

|

|

Эксперименты

|

|

Формулировки

|

|

Уравнения

|

|

Интерпретации

|

|

Развитие теории

|

|

Сложные темы

|

|

Известные учёные

|

|

См. также

|

| См. также: Портал:Физика |

Гамильтониа́н (

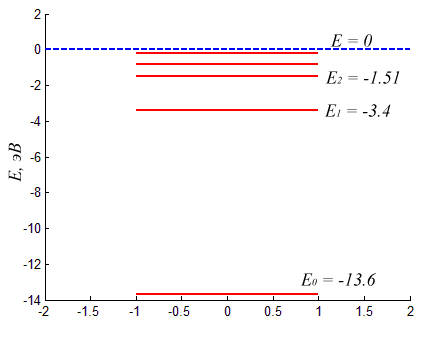

Его спектр — это множество возможных значений при измерении полной энергии системы. Спектр гамильтониана может быть дискретным или непрерывным. Также может быть ситуация (например, для кулоновского потенциала), когда спектр состоит из дискретной и непрерывной части.

Так как энергия — вещественная величина, гамильтониан является самосопряжённым оператором.

Уравнение Шрёдингера[править | править код]

Гамильтониан генерирует временную эволюцию квантовых состояний. Если

Это уравнение называется уравнением Шрёдингера (оно выглядит так же, как и уравнение Гамильтона — Якоби в классической механике). Зная состояние в начальный момент времени (t = 0), мы можем решить уравнение Шрёдингера и получить вектор состояния в любой последующий момент времени. В частности, если H не зависит от времени, то

Оператор экспоненты в правой части уравнения Шрёдингера определяется через степенной ряд по H.

По свойству *-гомоморфизма, оператор

унитарен. Это оператор временной эволюции, или пропагатор замкнутой квантовой системы.

Если гамильтониан не зависит от времени, {U(t)} образует однопараметрическую группу; отсюда следует принцип детального равновесия.

Выражения для гамильтониана в координатном представлении[править | править код]

Свободная частица[править | править код]

Если у частицы нет потенциальной энергии, то гамильтониан самый простой. Для одного измерения:

и для трёх измерений:

Потенциальная яма[править | править код]

Для частицы в постоянном потенциале V = V0 (нет зависимости от координаты и времени) в одном измерении гамильтониан такой:

В трёх измерениях:

Простой гармонический осциллятор[править | править код]

Для простого гармонического осциллятора в одном измерении потенциал зависит от координаты (но не от времени) как

где угловая частота

поэтому гамильтониан имеет вид

Для трёх измерений гамильтониан принимает вид

где трёхмерный радиус-вектор r, его модуль определяется так:

Полный гамильтониан — это сумма одномерных гамильтонианов:

В квантовой теории поля[править | править код]

В классической теории поля роль обобщённых координат играют функции поля в каждой точке пространства-времени, в квантовой теории поля они становятся операторами. Для системы взаимодействующих полей гамильтониан представляет собой сумму операторов энергии свободных полей и энергии их взаимодействия. В отличие от лагранжиана, гамильтониан не даёт явно релятивистски-инвариантного описания системы — энергия в разных инерциальных системах отсчёта различна, хотя для релятивистских систем эта инвариантность может быть доказана.

Ссылки[править | править код]

- Блохинцев Д. И. Основы квантовой механики. 5-е изд. Наука, 1976. — 664 с.

- Боум А. Квантовая механика: основы и приложения. М.: Мир, 1990. — 720 c.

- Дирак П. Принципы квантовой механики. 2-е изд. М.: Наука, 1979. — 480 с.

- Ландау, Л. Д., Лифшиц, Е. М. Квантовая механика (нерелятивистская теория). — Физматлит, 2008. — 800 с. — («Теоретическая физика», том III). — 3000 экз. — ISBN 978-5-9221-0530-9.

Напомним основные постулаты квантовой механики, связанные с эрмитовыми операторами:

- Все величины, которые можно экспериментально измерить, в квантовой механике выражаются эрмитовыми операторами (матрицами).

- Результатом измерения величины, описываемой оператором, может являться только одно из собственных значений данного оператора.

- Собственные векторы эрмитовых операторов формируют базис по которому можно разложить исходный вектор состояния.

- Вектор состояния, описывающий систему, после измерения коллапсирует в один из собственных векторов оператора измеряемой величины, причем в тот, который соответствует измеренному собственному значению.

- Коэффициенты в разложении по базисным векторам исходного вектора состояния есть амплитуды вероятности при измерении обнаружить собственное значение, связанное с данным собственным вектором.

Оператор, связанный с измерением энергии, в квантовой механике называется оператором Гамильтона или Гамильтонианом. Конкретный вид матрицы Гамильтониана зависит от деталей рассматриваемой системы. Если это система с двумя состояниями типа кубита с двумя базисными векторами, то Гамильтониан имеет вид квадратной матрицы 2х2. В общем случае он может быть и бесконечномерной матрицей.

В классической механике энергия частицы складывается из кинетической ( displaystyle T) и потенциальной ( displaystyle V). Кинетическая энергия равна:

( displaystyle T = frac{mv^2}{2}= frac{p^2}{2m}) где ( displaystyle p = mv) — импульс.

Квантовомеханический аналог получается простой заменой числового значения импульса на оператор:

( displaystyle hat{T} = frac{hat{p}^{2}}{2m} )

Сам оператор импульса в квантовомеханическом случае выражается через оператор взятия производной:

( displaystyle hat{p}=-i frac{d}{dx})

Мы получили оператор Гамильтона в координатном базисе:

( displaystyle hat{H} = -frac{1}{2m}frac{d^{2}}{dx^2}+V(x) )

Его собственные векторы также бесконечномерные — это функции от координаты x. Аппроксимируя вторую производную квадратной матрицей и прибавляя дискретизированную функцию потенциала ( displaystyle V) получим конечномерную матрицу, аппроксимирующую Гамильтониан:

( displaystyle hat{H}=-frac{1}{2m(Delta x)^2}begin{pmatrix}

-2+V(x_1)&1 &0 &… \

1&-2+V(x_2) &1 &… \

0&1 &-2+V(x_3) &… \

…&… &… &… &\

end{pmatrix})

Все что остается — это выбрать конкретный вид функции потенциала и найти на компьютере собственные векторы и собственные значения данной матрицы.

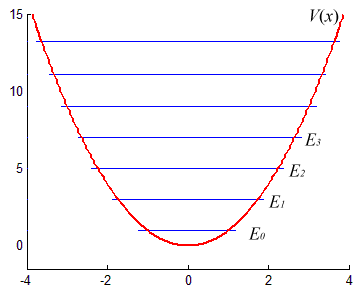

Давайте возьмем квадратичный потенциал ( displaystyle V = kx^2), отвечающий линейной силе в классическом случае (пружина, маятник). Система известна как гармонический осциллятор. Найдя собственные значения мы получим, что они отстоят друг от друга на одинаковом расстоянии, причем первый энергетический уровень не нулевой. Квантовый гармонический осциллятор, в отличие от классического, оказывается не может не совершать колебания (иметь нулевую энергию).

Мы наблюдаем эффект квантования. Измеренная энергия не может принимать любое значение, а только одно из разрешенных, дискретных.

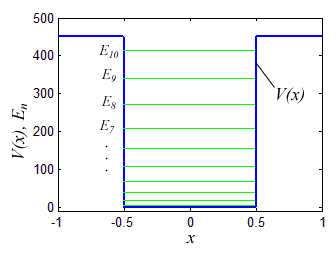

Численные величины собственных значений оператора Гамильтона зависят от вида функции потенциальной энергии. Возьмем, например, второй популярный пример — потенциал в виде прямоугольной ямы.

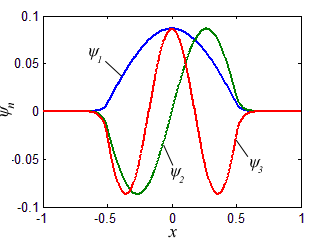

Каждому собственному значению (энергетическому уровню) соответствует собственный вектор — волновая функция в которую перейдет вектор состояния после измерения данного собственного значения (энергии). Несколько собственных функций, соответствующих нескольким первым собственным значениям Гамильтониана с прямоугольным потенциалом приведены на рисунке.

Из рисунка понятно почему квантовомеханический вектор состояния исторически получил название волновой функции. Аналогично можно найти и спектр атома водорода взяв за ( displaystyle V(x) ) кулоновский потенциал притяжения электрона и протона:

( displaystyle V(x) = -frac{e^2}{4 pi epsilon_0 |x|})

Оператор Гамильтона выделяется среди других эрмитовых операторов тем, что он является генератором эволюции во времени вектора состояния (поэтому он входит в уравнение Шредингера). В связи с этим ряд высказываний касательно времени можно сформулировать используя Гамильтониан. Так утверждение, что величина сохраняется означает ее неизменность с течением времени. На языке оператора Гамильтона данный факт преобразуется в:

Если данный эрмитов оператор коммутирует с Гамильтонианом, то физическая величина, представляемая данным оператором, сохраняется.

То есть, если ( displaystyle [A,H]=AH-HA=0), то ( displaystyle A) сохраняется.

Тривиальный случай — это закон сохранения энергии, поскольку любой оператор коммутирует сам с собой:

( displaystyle [H,H]=0 Rightarrow) энергия сохраняется.

Виталий Викторович Карабут

Эксперт по предмету «Физика»

Задать вопрос автору статьи

Гамильтониан

В классической физике функцией Гамильтона ($Hleft(overrightarrow{r},overrightarrow{p}right)$) называют полную энергию, которая выражена через импульсы и координаты частицы. Для одной частицы полная энергия равна:

где $p$ — импульс частицы, $m$ — масса частицы, $U$ — потенциальная энергия частицы.

В квантовой механике функции Гамильтона соответствует оператор. Он получится, если в выражение (1) вместо вектора импульса подставить оператор $hat{p}$, равный:

То есть имеем:

где $-frac{{hbar }^2}{2m}triangle =-frac{{hbar }^2}{2m}(frac{{partial }^2}{partial x^2}+frac{{partial }^2}{partial y^2}+frac{{partial }^2}{partial z^2})$- оператор кинетической энергии.

Введенный гамильтониан дает возможность представиться уравнение Шредингера в компактном виде:

Определение энергетического спектра системы как задача на собственные значения оператора Гамильтона

Сдай на права пока

учишься в ВУЗе

Вся теория в удобном приложении. Выбери инструктора и начни заниматься!

Получить скидку 3 000 ₽

Для стационарных процессов уравнение Шредингера можно записать в виде:

где $E_n$ — собственные значения энергии, $Psi_n$ — собственные функции, являющиеся решениями уравнения (5). Каждому собственному значению энергии соответствует одно или несколько состояний системы, которые описываются одной или несколькими собственными волновыми функциями. В том случае, если одному уровню энергии соответствует несколько собственных функций или состояний, то такие уровни именуются вырожденными. Количество состояний, соответствующих одной энергии называют кратностью вырождения (статистическим весом $g(E)).$

Задача поиска собственных значений и собственных функций оператора Гамильтона самая важная среди задач на собственные значения и собственные функции операторов физических величин. Данная задача имеет название: стационарное уравнение Шредингера.

Существенный вклад в разнообразие в эту задачу вносит вид потенциальной энергии, которая входит в гамильтониан. Энергетический спектр может быть дискретным, непрерывным, а может представлять собой часть дискретных уровней, а часть иметь непрерывного спектра.

«Гамильтониан» 👇

Известный набор собственных состояний Гамильтона полезен для решения уравнения (4). Допустим, что в начальный момент времени система пребывает в состоянии $varphi left(overrightarrow{r}right):$

Представим решение уравнения (5) в виде разложения в ряд по собственным функциям ($Psi_n(overrightarrow{r})$) оператора Гамильтона (данное разложение является всегда возможным и единственным):

где $C_n$ — постоянные коэффициенты разложения. Подставим выражение (7) в уравнение (5) получаем:

Примем во внимание то, что $Psi_n$ — собственное состояние оператора Гамильтона с собственным значением $E_n$ преобразуем выражение (8) к виду:

Равенство (9) выполняется, если:

Решением дифференциального уравнения (10) служит:

Коэффициенты $C_n$ определяют по волновой функции при $t=0 (6)$:

Из выражения (12) найдем:

Учтем, что при $T_nleft(t=0right)=1. $Следовательно, решением нестационарного уравнения Шредингера с начальным условием (6) является выражение:

Формула (14) описывает эволюцию собственного состояния оператора Гамильтона с течением времени. В нашем случае плотность вероятности не зависит от времени и ${left|Psi(overrightarrow{r},t)right|}^2={left|Psi_n(overrightarrow{r})right|}^2$. В связи с этим собственные состояния оператора Гамильтона именуют стационарными. Постоянными во времени являются средние значения физических величин.

И так, если Гамильтониан не зависит в явном виде от времени, то полную волновую функцию ($Psileft(overrightarrow{r,} tright)$), которая характеризует состояние системы можно представить как произведение координатной части $Psileft(overrightarrow{r} right)$ и экспоненты $e^{-frac{i}{hbar }E_nt}.$

Пример 1

Задание: Найдите уровни энергии дискретного спектра частицы в поле $Uleft(xright)=-alpha delta left(xright), alpha >0.$

Решение:

В качестве основы для решения задачи используем стационарное уравнение Шредингера:

[hat{H}Psi=EPsileft(1.1right),]

Запишем оператор Гамильтона ($hat{H}$) в явном виде в уравнении (1.1), получим:

[-frac{{hbar }^2}{2m}frac{{partial }^2Psileft(xright)}{partial x^2}-alpha delta left(xright)Psileft(xright)=EPsileft(xright)left(1.2right).]

Связанные состояния частицы в поле, указанном в условиях задачи могут быть только при условии $E

[Psi^{”}left(xright)+frac{2m}{{hbar }^2}alpha delta left(xright)Psileft(xright)-frac{2m}{{hbar }^2}EPsileft(xright)=0to Psi^{”}left(xright)+frac{2m}{{hbar }^2}alpha delta left(xright)Psileft(xright)-{rho }^2Psileft(xright)=0left(1.3right),]

где ведено следующее обозначение: ${rho }^2=-frac{2m}{{hbar }^2}E.$ Общее решение уравнения (1.3) имеет вид:

[Psi_1left(xright)=Ae^{rho x}+Be^{-rho x}left(1.4right).]

Волновая функция должна стремится к нулю при $xto -infty .$ Следовательно, $B=0$. В области $-infty

[Psi_1left(xright)=Ae^{rho x}left(1.5right).]

Для области $0

[Psi_2left(xright)=De^{-rho x}left(1.6right).]

В соответствии с условием непрерывности волновой функции:

[Psi_1left(0right)=Psi_2left(0right)left(1.7right).]

Можно сделать вывод о том, что $A=D.$

Найдем интеграл от уравнения Шредингера в области $0-varepsilon

[Psi’left(0+varepsilon right)-Psi’left(0-varepsilon right)+frac{2m}{{hbar }^2}alpha Psileft(0right)=0left(1.8right).]

Производная от $Psi$ претерпевает разрыв при $x=0$. Значит, величина $rho =frac{2malpha }{{hbar }^2}$ — единственное значение. Из выражения ${rho }^2=-frac{2m}{{hbar }^2}E$ следует, что имеется только одно состояние дискретного спектра с энергией:

[E=-frac{m{alpha }^2}{2hbar }.]

Ответ: $E=-frac{m{alpha }^2}{2hbar }- $единственное значение.

Пример 2

Задание: Задан оператор Гамильтона $hat{H}=-frac{{hbar }^2}{2m}frac{{partial }^2}{partial x^2}-alpha delta left(xright). $Какой вид имеет волновая функция для частицы?

Решение:

Для установления вида волновой функции следует выражение $Psileft(xright)=Ae^{-rho left|xright|}left(1.5right)$, полученное в примере $1$ нормировать на единицу:

[intlimits^0_{-infty }{A^2}e^{2rho x}+intlimits^{infty }_0{A^2}e^{-rho 2x}=A^2left(intlimits^0_{-infty }{e^{2rho x}}+intlimits^{infty }_0{e^{-2rho x}}right)=A^2left(frac{2}{2rho }right)=frac{A^2}{rho }=1left(2.1right).]

Из выражения (2.1) получаем:

[A=sqrt{rho }.]

Ответ: $Psileft(xright)=sqrt{rho }e^{-rho left|xright|}$

Находи статьи и создавай свой список литературы по ГОСТу

Поиск по теме

From Wikipedia, the free encyclopedia

The Hamiltonian is a function used to solve a problem of optimal control for a dynamical system. It can be understood as an instantaneous increment of the Lagrangian expression of the problem that is to be optimized over a certain time period.[1] Inspired by, but distinct from, the Hamiltonian of classical mechanics, the Hamiltonian of optimal control theory was developed by Lev Pontryagin as part of his maximum principle.[2] Pontryagin proved that a necessary condition for solving the optimal control problem is that the control should be chosen so as to optimize the Hamiltonian.[3]

Problem statement and definition of the Hamiltonian[edit]

Consider a dynamical system of

where ![{displaystyle mathbf {x} (t)=left[x_{1}(t),x_{2}(t),ldots ,x_{n}(t)right]^{mathsf {T}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9b3f9c33c24a2c1a5e5691da9c5430378966968a)

![{displaystyle mathbf {u} (t)=left[u_{1}(t),u_{2}(t),ldots ,u_{r}(t)right]^{mathsf {T}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/96ba4ee17af744254b59ae46de396f27f9204fd8)

subject to the above equations of motion of the state variables. The solution method involves defining an ancillary function known as the control Hamiltonian

which combines the objective function and the state equations much like a Lagrangian in a static optimization problem, only that the multipliers

The goal is to find an optimal control policy function

for all

The first-order necessary conditions for a maximum are given by

which is the maximum principle,

which generates the state transition function

,

which generates

the latter of which are referred to as the costate equations. Together, the state and costate equations describe the Hamiltonian dynamical system (again analogous to but distinct from the Hamiltonian system in physics), the solution of which involves a two-point boundary value problem, given that there are

A sufficient condition for a maximum is the concavity of the Hamiltonian evaluated at the solution, i.e.

where

Derivation from the Lagrangian[edit]

A constrained optimization problem as the one stated above usually suggests a Lagrangian expression, specifically

where

which can be substituted back into the Lagrangian expression to give

To derive the first-order conditions for an optimum, assume that the solution has been found and the Lagrangian is maximized. Then any perturbation to

For this expression to equal zero necessitates the following optimality conditions:

If both the initial value

It can be seen that the necessary conditions are identical to the ones stated above for the Hamiltonian. Thus the Hamiltonian can be understood as a device to generate the first-order necessary conditions.[8]

The Hamiltonian in discrete time[edit]

When the problem is formulated in discrete time, the Hamiltonian is defined as:

and the costate equations are

(Note that the discrete time Hamiltonian at time

Behavior of the Hamiltonian over time[edit]

From Pontryagin’s maximum principle, special conditions for the Hamiltonian can be derived.[10] When the final time

or if the terminal time is free, then:

Further, if the terminal time tends to infinity, a transversality condition on the Hamiltonian applies.[12]

The Hamiltonian of control compared to the Hamiltonian of mechanics[edit]

William Rowan Hamilton defined the Hamiltonian for describing the mechanics of a system. It is a function of three variables:

where

Hamilton then formulated his equations to describe the dynamics of the system as

The Hamiltonian of control theory describes not the dynamics of a system but conditions for extremizing some scalar function thereof (the Lagrangian) with respect to a control variable

where

The associated conditions for a maximum are

This definition agrees with that given by the article by Sussmann and Willems.[13] (see p. 39, equation 14). Sussmann and Willems show how the control Hamiltonian can be used in dynamics e.g. for the brachistochrone problem, but do not mention the prior work of Carathéodory on this approach.[14]

Current value and present value Hamiltonian[edit]

In economics, the objective function in dynamic optimization problems often depends directly on time only through exponential discounting, such that it takes the form

where

which is referred to as the current value Hamiltonian, in contrast to the present value Hamiltonian

,

which follows immediately from the product rule. Economically,

Example: Ramsey–Cass–Koopmans model[edit]

In economics, the Ramsey–Cass–Koopmans model is used to determine an optimal savings behavior for an economy. The objective function

to be maximized by choice of an optimal consumption path

where

Here,

The optimality conditions are

in addition to the transversality condition

Inserting this equation into the second optimality condition yields

which is known as the Keynes–Ramsey rule, which gives a condition for consumption in every period which, if followed, ensures maximum lifetime utility.

References[edit]

- ^ Ferguson, Brian S.; Lim, G. C. (1998). Introduction to Dynamic Economic Problems. Manchester: Manchester University Press. pp. 166–167. ISBN 0-7190-4996-2.

- ^ Dixit, Avinash K. (1990). Optimization in Economic Theory. New York: Oxford University Press. pp. 145–161. ISBN 978-0-19-877210-1.

- ^ Kirk, Donald E. (1970). Optimal Control Theory : An Introduction. Englewood Cliffs: Prentice Hall. p. 232. ISBN 0-13-638098-0.

- ^ Gandolfo, Giancarlo (1996). Economic Dynamics (Third ed.). Berlin: Springer. pp. 375–376. ISBN 3-540-60988-1.

- ^ Seierstad, Atle; Sydsæter, Knut (1987). Optimal Control Theory with Economic Applications. Amsterdam: North-Holland. pp. 107–110. ISBN 0-444-87923-4.

- ^ Mangasarian, O. L. (1966). “Sufficient Conditions for the Optimal Control of Nonlinear Systems”. SIAM Journal on Control. 4 (1): 139–152. doi:10.1137/0304013.

- ^ Léonard, Daniel; Long, Ngo Van (1992). “Endpoint Constraints and Transversality Conditions”. Optimal Control Theory and Static Optimization in Economics. New York: Cambridge University Press. p. 222 [Theorem 7.1.1]. ISBN 0-521-33158-7.

- ^ Kamien, Morton I.; Schwartz, Nancy L. (1991). Dynamic Optimization : The Calculus of Variances and Optimal Control in Economics and Management (Second ed.). Amsterdam: North-Holland. pp. 126–127. ISBN 0-444-01609-0.

- ^ Jönsson, U. (2005). “A DISCRETE VERSION OF PMP” (PDF). p. 25. Archived from the original (PDF) on January 22, 2023.

- ^ Naidu, Desineni S. (2003). Optimal Control Systems. Boca Raton: CRC Press. pp. 259–260. ISBN 0-8493-0892-5.

- ^ Torres, Delfim F. M. (2002). “A Remarkable Property of the Dynamic Optimization Extremals”. Investigacao Operacional. 22 (2): 253–263. arXiv:math/0212102.

- ^ Michel, Philippe (1982). “On the Transversality Condition in Infinite Horizon Optimal Problems”. Econometrica. 50 (4): 975–985. doi:10.2307/1912772. JSTOR 1912772. S2CID 16503488.

- ^ Sussmann; Willems (June 1997). “300 Years of Optimal Control” (PDF). IEEE Control Systems Magazine. doi:10.1109/37.588098. Archived from the original (PDF) on July 30, 2010.

- ^ See Pesch, H. J.; Bulirsch, R. (1994). “The maximum principle, Bellman’s equation, and Carathéodory’s work”. Journal of Optimization Theory and Applications. 80 (2): 199–225. doi:10.1007/BF02192933. S2CID 121749702.

- ^ Bævre, Kåre (Spring 2005). “Econ 4350: Growth and Investment: Lecture Note 7” (PDF). Department of Economics, University of Oslo.

Further reading[edit]

- Léonard, Daniel; Long, Ngo Van (1992). “The Maximum Principle”. Optimal Control Theory and Static Optimization in Economics. New York: Cambridge University Press. pp. 127–168. ISBN 0-521-33158-7.

- Takayama, Akira (1985). “Developments of Optimal Control Theory and Its Applications”. Mathematical Economics (2nd ed.). New York: Cambridge University Press. pp. 600–719. ISBN 0-521-31498-4.

- Wulwick, Nancy (1995). “The Hamiltonian Formalism and Optimal Growth Theory”. In Rima, I. H. (ed.). Measurement, Quantification, and Economic Analysis. London: Routledge. ISBN 978-0-415-08915-9.

![{displaystyle max _{mathbf {u} (t)}J=int _{t_{0}}^{t_{1}}I[mathbf {x} (t),mathbf {u} (t),t],mathrm {d} t}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ea51d4910e9a0a4ac6a086fb02314b7b6b838497)

![{displaystyle {dot {mathbf {lambda } }}(t)=-left[I_{mathbf {x} }(mathbf {x} (t),mathbf {u} (t),t)+mathbf {lambda } ^{mathsf {T}}(t)mathbf {f} _{mathbf {x} }(mathbf {x} (t),mathbf {u} (t),t)right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cdca5ef591cf2d5f384fb72a1448c5cebd6fd700)

![{displaystyle L=int _{t_{0}}^{t_{1}}I(mathbf {x} (t),mathbf {u} (t),t)+mathbf {lambda } ^{mathsf {T}}(t)left[mathbf {f} (mathbf {x} (t),mathbf {u} (t),t)-{dot {mathbf {x} }}(t)right],mathrm {d} t}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a4b75a91941402414d4025e57b1a6e405369c905)

![{displaystyle L=int _{t_{0}}^{t_{1}}left[I(mathbf {x} (t),mathbf {u} (t),t)+mathbf {lambda } ^{mathsf {T}}(t)mathbf {f} (mathbf {x} (t),mathbf {u} (t),t)+{dot {mathbf {lambda } }}^{mathsf {T}}(t)mathbf {x} (t)right],mathrm {d} t-mathbf {lambda } ^{mathsf {T}}(t_{1})mathbf {x} (t_{1})+mathbf {lambda } ^{mathsf {T}}(t_{0})mathbf {x} (t_{0})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/faa3d1c13c957da2116f6fbb684a1bd58224d477)

![{displaystyle mathrm {d} L=int _{t_{0}}^{t_{1}}left[left(I_{mathbf {u} }(mathbf {x} (t),mathbf {u} (t),t)+mathbf {lambda } ^{mathsf {T}}(t)mathbf {f} _{mathbf {u} }(mathbf {x} (t),mathbf {u} (t),t)right)mathrm {d} mathbf {u} (t)+left(I_{mathbf {x} }(mathbf {x} (t),mathbf {u} (t),t)+mathbf {lambda } ^{mathsf {T}}(t)mathbf {f} _{mathbf {x} }(mathbf {x} (t),mathbf {u} (t),t)+{dot {mathbf {lambda } }}(t)right)mathrm {d} mathbf {x} (t)right]mathrm {d} t-mathbf {lambda } ^{mathsf {T}}(t_{1})mathrm {d} mathbf {x} (t_{1})+mathbf {lambda } ^{mathsf {T}}(t_{0})mathrm {d} mathbf {x} (t_{0})leq 0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0d3ee0a3c6c33269d5a5ae883b46f24fedfccb75)

![{displaystyle {begin{aligned}{bar {H}}(mathbf {x} (t),mathbf {u} (t),mathbf {lambda } (t))equiv &,e^{rho t}left[I(mathbf {x} (t),mathbf {u} (t),t)+mathbf {lambda } ^{mathsf {T}}(t)mathbf {f} (mathbf {x} (t),mathbf {u} (t),t)right]\=&,nu (mathbf {x} (t),mathbf {u} (t),t)+mathbf {mu } ^{mathsf {T}}(t)mathbf {f} (mathbf {x} (t),mathbf {u} (t),t)end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b209d34cddfd4bf27304c7734db0d9571a22743e)

![{displaystyle H(k,c,mu ,t)=e^{-rho t}u(c(t))+mu (t){dot {k}}=e^{-rho t}u(c(t))+mu (t)[f(k(t))-(n+delta )k(t)-c(t)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ec42cb2c1452bfe95945ca3e526cbb565930c3fd)

![{displaystyle {frac {partial H}{partial k}}=-{frac {partial mu }{partial t}}=-{dot {mu }}Rightarrow mu (t)[f'(k)-(n+delta )]=-{dot {mu }}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fa359da70f6163fd5343ddea0bf2c69f1f9fcf94)