Инструкции:

Проведите регрессионный анализ с помощью

Калькулятор Линейной Регрессии

где будет найдено уравнение регрессии и предоставлен подробный отчет о расчетах, а также диаграмма рассеяния. Все, что вам нужно сделать, это ввести данные X и Y. По желанию можно добавить заголовок и название переменных.

Подробнее об этом калькуляторе линейной регрессии

A

модель линейной регрессии

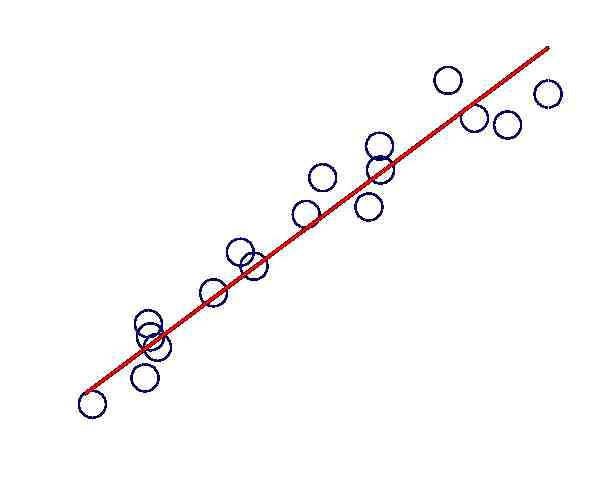

соответствует линейной модели, которая минимизирует сумму квадратов ошибок для набора пар ((X_i, Y_i)).

Это означает, что вы предполагаете существование модели, которая в упрощенной форме имеет вид (Y = alpha + beta X), а затем вы отмечаете несоответствия (ошибки), обнаруженные при использовании этой линейной модели для прогнозирования набора заданных данных.

Для каждого (X_i) в данных вы вычисляете (hat Y_i = alpha + beta X_i) и вычисляете ошибку, измеряя (Y_i – hat Y_i). В частности, в этом случае вы берете квадрат каждого несоответствия/ошибки и суммируете ВСЕ эти квадраты ошибок.

Задача регрессионного калькулятора — найти наилучшие значения (alpha) и (beta), чтобы сумма квадратов ошибок была как можно меньше.

Формула регрессии

Уравнение линейной регрессии, также известное как уравнение наименьших квадратов, имеет следующую форму: (hat Y = a + b X), где коэффициенты регрессии представляют собой значения (a) и (b).

Вопрос в том:

Как рассчитать коэффициенты регрессии?

Коэффициенты регрессии вычисляются этим регрессионным калькулятором следующим образом:

[b = frac{SS_{XY}}{SS_{XX}}]

[a = bar Y – bar X cdot b ]

Это формулы, которые вы использовали, если бы вычисляли уравнение регрессии вручную, но, вероятно, вы предпочтете использовать калькулятор (наш

Калькулятор регрессии

), который покажет вам важные шаги.

Эта формула линейной регрессии интерпретируется следующим образом: коэффициент (b) известен как коэффициент наклона, а коэффициент (a) известен как точка пересечения по оси y.

Если вместо линейной модели вы хотите использовать нелинейную модель, то вам следует рассмотреть вместо нее модель

калькулятор полиномиальной регрессии

, что позволяет использовать мощности независимой переменной.

Калькулятор линейной регрессии шаги

Прежде всего, вы хотите оценить, имеет ли смысл проводить регрессионный анализ. Итак, сначала вы должны запустить это

калькулятор коэффициента корреляции

чтобы увидеть, существует ли значительная степень линейной связи между переменными.

Другими словами, имеет смысл проводить регрессионный анализ только в том случае, если коэффициент корреляции достаточно силен, чтобы обосновать модель линейной регрессии. Кроме того, вы должны использовать это

калькулятор точечной диаграммы

чтобы убедиться, что визуальный рисунок действительно линейный.

Можно предположить, что коэффициент корреляции близок к 1, но тем не менее характер связи вовсе не линейный.

Шаги для проведения регрессионного анализа следующие:

Шаг 1:

Получите данные для зависимой и независимой переменной в формате столбца.

Шаг 2:

Введите данные или вставьте их, если они уже есть, например, в формате Excel.

Шаг 3:

Нажмите “Рассчитать”.

Этот калькулятор уравнения регрессии с шагами предоставит вам все необходимые расчеты в организованном порядке, чтобы вы могли четко понять все этапы процесса.

Остатки регрессии

Как оценить, хороша ли модель линейной регрессии? Вы можете подумать: “Легко, просто посмотрите на

scatterplot

“. В действительности математика и статистика обычно выходят за пределы того, где глаз встречается с графиком. Обычно рискованно полагаться только на диаграмму рассеяния для оценки качества модели.

С точки зрения хорошего соответствия, один из способов оценки качества соответствия модели линейной регрессии заключается в следующем

вычисление коэффициента детерминации

показывает долю вариации зависимой переменной, которая объясняется независимой переменной.

В линейной регрессии выполнение предположений имеет решающее значение для того, чтобы оценки коэффициента регрессии обладали хорошими свойствами (несмещенность, минимальная дисперсия и др.).

Для того чтобы оценить предположения линейной регрессии, необходимо посмотреть на остатки. Для этого вы можете взглянуть на нашу программу

калькулятор остатков

.

Предсказательная сила уравнения регрессии

Как узнать, правильно ли найдено уравнение регрессии? Или лучше вопрос, как узнать, имеет ли оцениваемое уравнение регрессии хорошую предсказательную силу?

Что вам нужно сделать, это

вычислить коэффициент детерминации

, который сообщает вам величину вариации зависимой переменной, которая объясняется зависимой(ыми) переменной(ями).

Для простой регрессионной модели (с одной независимой переменной) коэффициент детерминации просто вычисляется путем возведения в квадрат коэффициента корреляции.

Например, если

коэффициент корреляции

Если r = 0,8, то коэффициент детерминации равен (r^2 = 0.8^2 = 0.64), и интерпретация состоит в том, что 64% вариации зависимой переменной объясняются независимой переменной в этой модели.

Полиномиальная регрессия

Как мы упоминали ранее, бывают случаи, когда линейная регрессия просто не подходит, потому что существует четкая нелинейная модель, определяющая взаимосвязь между двумя переменными.

Ваш первый сигнал о том, что вместо линейной регрессии следует использовать полиномиальную регрессию, заключается в том, что вы видите, что в данных, представленных диаграммой рассеяния, присутствует криволинейный паттерн.

Если это так, вы можете попробовать это

калькулятор полиномиальной регрессии

, чтобы оценить нелинейную модель, которая имеет больше шансов на лучшее соответствие.

Что дает этот онлайн-калькулятор линейной регрессии?

Сначала вы получаете таблицу данных и вычисляете соответствующие квадраты и перекрестные умножения, чтобы получить требуемую сумму квадратов значений, необходимую для применения формулы регрессии.

Как только все это будет аккуратно отображено в таблице со всеми необходимыми столбцами, будут показаны формулы регрессии с подставленными правильными значениями, а затем с выводом о модели линейной регрессии, которая была оценена на основе данных.

Кроме того, строится точечная диаграмма, чтобы оценить, насколько тесна линейная связь между переменными, что дает представление о том, насколько хороша модель линейной регрессии.

Является ли r2 коэффициентом регрессии?

Нет. Технически коэффициенты регрессии — это оценочные коэффициенты, являющиеся частью регрессионной модели. Коэффициент r2 называется коэффициентом детерминации.

Коэффициент r2 также рассчитывается по выборочным данным, но это не коэффициент регрессии, но это не значит, что он не важен. Коэффициент r2 важен, потому что он дает оценку процента вариации, объясняемой моделью.

Как сделать линейную регрессию в excel?

В Excel есть возможность проводить линейную регрессию либо непосредственно с помощью команд “=НАКЛОН()” и “=ИНТЕРЦЕПТ()”, либо с помощью меню “Анализ данных”.

Но Excel не показывает все шаги, как это делает наш регрессионный калькулятор.

Другие калькуляторы, связанные с линейной регрессией

Этот

Калькулятор уравнения регрессии

является лишь одним из многих калькуляторов, представляющих интерес при работе с линейными моделями. Вас также могут заинтересовать

вычисление коэффициента корреляции

, или в

построить диаграмму рассеяния

с предоставленными данными.

Что такое коэффициент детерминации?

коэффициент детерминации

или R^2 – это измерение доли вариации зависимой переменной, которая объясняется независимой переменной.

Например, предположим, что мы имеем коэффициент детерминации R^2 = 0,67 при оценке линейной регрессии Y как функции X, тогда интерпретация заключается в том, что X объясняет 67% вариации Y.

Что происходит, когда у вас больше переменных

Потенциально у вас может быть более одной независимой переменной. Например, вы можете быть заинтересованы в оценке Y в терминах двух переменных X1 и X2. В этом случае вам необходимо

рассчитать множественную линейную регрессию

модель, где идея по сути та же: найти гиперплоскость, которая минимизирует сумму квадратов ошибок.

МНК и регрессионный анализ Онлайн + графики

Данный онлайн-сервис позволяет найти с помощью метода наименьших квадратов уравнения линейной, квадратичной, гиперболической, степенной, логарифмической, показательной, экспоненциальной регрессии и др., коэффициенты и индексы корреляции и детерминации. Показываются диаграмма рассеяние и график уравнения регрессии. Также калькулятор делает оценку значимости параметров уравнения регрессии с помощью F-критерия Фишера, t-критерия Стьюдента и критерия Дарбина-Уотсона.

Можно задать уровень значимости и указать, до какого знака после запятой округлять расчётные величины.

Математический форум (помощь с решением задач, обсуждение вопросов по математике).

Если заметили ошибку, опечатку или есть предложения, напишите в комментариях.

This Quadratic Regression Calculator quickly and simply calculates the equation of the quadratic regression function and the associated correlation coefficient. In addition, it generates a scatter plot that depicts the curve of best fit.

You can use the quadratic regression calculator in three simple steps:

- Input all known X and Y variables in the respective fields.

- Click on the “Calculate” button to compute the quadratic regression equation.

- Click on the “Reset” button to clear all fields and input new values.

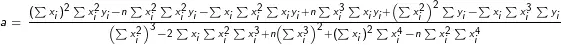

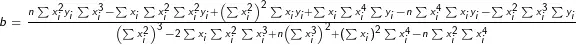

The Quadratic Regression Calculator uses the following formulas:

Quadratic regression: y = ax2 + bx + c, where a ≠ 0

Coefficients (a, b, c):

Mean x: x̄ = ∑xi / n

Mean y: ȳ = ∑yi / n

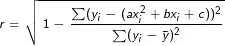

Correlation coefficient r:

Where:

n is the total number of samples,

xi (x1, x2, … ,xn) are the x values,

yi (y1, y2, … ,yn) are the y values,

∑xi is the sum of x values,

∑yi is the sum of y values,

∑xi yi is the sum of products of x and y values,

∑xi2 is the sum of squares of x values,

∑xi3 is the sum of the cubes of x values,

∑xi4 is the sum of the fourth powers of x values.

You may also be interested in our Linear Regression Calculator or Least-Squares Circle Calculator

Данный калькулятор по введенным данным строит несколько моделей регрессии: линейную, квадратичную, кубическую, степенную, логарифмическую, гиперболическую, показательную, экспоненциальную. Результаты можно сравнить между собой по корреляции, средней ошибке аппроксимации и наглядно на графике. Теория и формулы регрессий под калькулятором.

Если не ввести значения x, калькулятор примет, что значение x меняется от 0 с шагом 1.

![]()

Аппроксимация функции одной переменной

Квадратичная аппроксимация

Аппроксимация степенной функцией

Показательная аппроксимация

Логарифмическая аппроксимация

Гиперболическая аппроксимация

Экспоненциальная аппроксимация

Точность вычисления

Знаков после запятой: 4

Коэффициент линейной парной корреляции

Средняя ошибка аппроксимации, %

Средняя ошибка аппроксимации, %

Средняя ошибка аппроксимации, %

Средняя ошибка аппроксимации, %

Средняя ошибка аппроксимации, %

Логарифмическая регрессия

Средняя ошибка аппроксимации, %

Гиперболическая регрессия

Средняя ошибка аппроксимации, %

Экспоненциальная регрессия

Средняя ошибка аппроксимации, %

Результат

Файл очень большой, при загрузке и создании может наблюдаться торможение браузера.

Линейная регрессия

Уравнение регрессии:

Коэффициент a:

Коэффициент b:

Коэффициент линейной парной корреляции:

Коэффициент детерминации:

Средняя ошибка аппроксимации:

Квадратичная регрессия

Уравнение регрессии:

Система уравнений для нахождения коэффициентов a, b и c:

Коэффициент корреляции:

,

где

Коэффициент детерминации:

Средняя ошибка аппроксимации:

Кубическая регрессия

Уравнение регрессии:

Система уравнений для нахождения коэффициентов a, b, c и d:

Коэффициент корреляции, коэффициент детерминации, средняя ошибка аппроксимации – используются те же формулы, что и для квадратичной регрессии.

Степенная регрессия

Уравнение регрессии:

Коэффициент b:

Коэффициент a:

Коэффициент корреляции, коэффициент детерминации, средняя ошибка аппроксимации — используются те же формулы, что и для квадратичной регрессии.

Показательная регрессия

Уравнение регрессии:

Коэффициент b:

Коэффициент a:

Коэффициент корреляции, коэффициент детерминации, средняя ошибка аппроксимации — используются те же формулы, что и для квадратичной регрессии.

Гиперболическая регрессия

Уравнение регрессии:

Коэффициент b:

Коэффициент a:

Коэффициент корреляции, коэффициент детерминации, средняя ошибка аппроксимации – используются те же формулы, что и для квадратичной регрессии.

Логарифмическая регрессия

Уравнение регрессии:

Коэффициент b:

Коэффициент a:

Коэффициент корреляции, коэффициент детерминации, средняя ошибка аппроксимации – используются те же формулы, что и для квадратичной регрессии.

Экспоненциальная регрессия

Уравнение регрессии:

Коэффициент b:

Коэффициент a:

Коэффициент корреляции, коэффициент детерминации, средняя ошибка аппроксимации – используются те же формулы, что и для квадратичной регрессии.

Вывод формул

Сначала сформулируем задачу:

Пусть у нас есть неизвестная функция y=f(x), заданная табличными значениями (например, полученными в результате опытных измерений).

Нам необходимо найти функцию заданного вида (линейную, квадратичную и т. п.) y=F(x), которая в соответствующих точках принимает значения, как можно более близкие к табличным.

На практике вид функции чаще всего определяют путем сравнения расположения точек с графиками известных функций.

Полученная формула y=F(x), которую называют эмпирической формулой, или уравнением регрессии y на x, или приближающей (аппроксимирующей) функцией, позволяет находить значения f(x) для нетабличных значений x, сглаживая результаты измерений величины y.

Для того, чтобы получить параметры функции F, используется метод наименьших квадратов. В этом методе в качестве критерия близости приближающей функции к совокупности точек используется суммы квадратов разностей значений табличных значений y и теоретических, рассчитанных по уравнению регрессии.

Таким образом, нам требуется найти функцию F, такую, чтобы сумма квадратов S была наименьшей:

Рассмотрим решение этой задачи на примере получения линейной регрессии F=ax+b.

S является функцией двух переменных, a и b. Чтобы найти ее минимум, используем условие экстремума, а именно, равенства нулю частных производных.

Используя формулу производной сложной функции, получим следующую систему уравнений:

Для функции вида частные производные равны:

,

Подставив производные, получим:

Далее:

Откуда, выразив a и b, можно получить формулы для коэффициентов линейной регрессии, приведенные выше.

Аналогичным образом выводятся формулы для остальных видов регрессий.