Как определить, является ли распределение нормальным?

Если

установлено, что исследуемые значения

имеют количественный характер, следует

проверить выборку на нормальность

распределения. Это можно сделать

несколькими способами.

Первый

способ проверки выборки на нормальность

распределения

Прежде

всего, нужно вычислить показатели

асимметрии и эксцесса, используя

программу Excel,

имеющуюся практически на всех компьютерах.

Для этого в таблицу программы следует

поместить результаты измерений. Пусть

это будет ряд значений, полученных на

выборке из 25 объектов: 9 10 10 10 11

11 11 11 12 12 12 12 12 12 12 13 13 13 13

14 14 15 15 16 17

Данные

могут располагаться как в виде строки,

так и в виде колонки. Далее, нажатием

кнопки с символами fx,

расположенной

ниже панели инструментов, вызываем

мастер функций. В верхнем окне выбираем

категорию «Статистические», а в нижнем

– пункт «Скос». Возвращаемся к таблице

с результатами измерений, и, выделяя

набранные ранее цифры, помещаем их

значения в открывшееся окно «Аргументы

функций». На правой стороне окна

появляется результат вычислений –

0,579. Это и есть значение показателя

асимметрии, характеризующего степени

отклонения вершины кривой распределения

от его центра. Можно сказать, что

показатель асимметрии отражает отклонение

вершины реальной кривой распределения

от идеальной по оси абсцисс.

По

схожему алгоритму вычисляем величину

показателя эксцесса характеризующего

подъем или снижение вершины распределения,

то есть – отклонения по оси ординат.

Для того, чтобы произвести расчет данного

показателя, следует выбрать пункт

«эксцесс». В окне «Аргументы функций»

получим его значение – 0,116.

При

наличии статистических таблиц критических

значений асимметрии и эксцесса (в данном

учебном пособии это таблицы 9 и 10)

вычисленные значения сравниваются с

табличными. Если оба

(!) показателя окажутся меньше табличных

величин, то распределение может считаться

нормальным.

Для

нашего примера табличное значение

показателя асимметрии находим на

пересечении строки n

= 25 и колонки

р ≤ 0,01

(предположим,

что мы

анализируем

результаты

достаточно важных экспериментов и

считаем, что вероятность ошибки

статистического заключения не должна

превышать 1%). Это число составляет 1,061.

Так как вычисленное значение показателя

асимметрии 0,579 оказывается гораздо

меньше табличной величины 1,061, можно

сделать заключение, что отклонение

вершины распределения по оси абсцисс

не столь значительно, чтобы отказаться

от применения параметрических методов.

В

таблице 10 находим критическое значение

показателя эксцесса.

Для

n

= 26 (так как

в таблице

отсутствует строка для n

= 25, переходим

к ближайшей строке)

и

р

≤ 0,01 оно

составляет 0,869.

И снова

фактическое значение показателя 0,116

оказывается меньше табличного 0, 869.

Отсюда следует, что отклонение вершины

распределения по оси ординат также

несущественно и его можно считать

нормальным. То, что оба показателя

оказались меньше критических табличных

величин, дает основание для последующего

применения параметрических критериев.

Второй

способ проверки выборки на нормальность

распределения

При

отсутствии таблиц критических значений

асимметрии и эксцесса следует произвести

расчеты не только этих показателей, но

и их выборочных ошибок.

Ошибка

показателя асимметрии производится по

формуле:

![]() Для

Для

нашего примера

она составит:

![]()

Выборочная

ошибка эксцесса рассчитывается по

другой формуле:

![]() в

в

результате получим:

![]()

Далее

следует разделить показатели асимметрии

и эксцесса на их ошибки.

Частное

от деления показателей асимметрии и

эксцесса на их ошибки определяется как

tф (фактическое

значение) и сравнивается с tт,табличное

значение),

взятым из

таблицы Стьюдента (таблица 6), при

соответствующем уровне значимости и

числе степеней свободы. Если фактическое

значение критерия Стьюдента окажется

меньше табличного, распределение

признается нормальным, и, наоборот, если

фактическое значение окажется больше

табличного, следует сделать вывод о

несоответствии распределения нормальному

закону.

Для

показателя асимметрии получаем следующее

значение t-критерия:

![]()

Число

степеней свободы (df),

определяющее строку в таблице Стьюдента,

находим как n-1.

Следовательно, df

= 25-1=24. Уровень значимости (вероятность

ошибки статистического заключения),

определяющий колонку в таблице Стьюдента,

оставляем 1%. На пересечении строки df

=24 и колонки р

≤ 0,01 находим

табличное значение критерия tт

= 2,80.

Так как tф (1,25)

оказывается

гораздо

меньше чем tт

(2,80), можно

заключить, что и второй способ проверки

указывает на незначительность асимметрии

кривой распределения.

Фактическое

значения t-критерия

для показателя эксцесса рассчитываем

по формуле

Таким образом, не только для асимметрии,

но и для эксцесса tф

(0,129)

оказывается

существенно

меньше чем tт

(2,80), что опять

же указывает на нормальность распределения.

Третий

способ проверки выборки на нормальность

распределения

Проще всего задача

решается, если имеется компьютер с

установленной на ней программой

Statistica. После ввода данных в таблицу

вызывается стартовая панель модуля

Основные

статистики и таблицы

(Basic

Statistics/Tables).

В средней части окна Descriptive

Statistics

(Описательные статистики) слева находится

блок проверки распределений (Distribution).

Чтобы проверить, относятся ли показатели

выбранной переменной к распределяемым

по нормальному закону, нужно поставить

галочку в окне возле пункта K-S

and Lilliefors test for normality (Критерий

Колмогорова-Смирнова и Лилиефорса для

нормальности)

и нажать на кнопку Histograms

(гистограммы). В появившемся окне

приводятся гистограмма распределения

значений переменной и наложенная на

нее кривая нормального распределения,

сопоставление которых позволяет

визуально оценить характер распределения.

В

верхней части окна указывается

достоверность отличия проверяемого

распределения от нормального,

характеризуемая уровнем значимости р

(вероятность неправильного отвержения

гипотезы, если она верна). Если уровень

значимости р<0,05, то распределение

отлично от нормального на основании

соответствующего критерия. И наоборот,

если р>0,05, как на рисунке, то наблюдаемая

величина распределена нормально. Зная

вид распределения, в дальнейшей обработке

можно применить оптимальные статистические

методы.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Нормальное распределение

Время на прочтение

7 мин

Количество просмотров 35K

Автор статьи: Виктория Ляликова

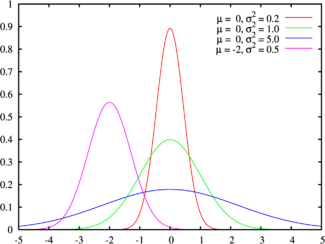

Нормальный закон распределения или закон Гаусса играет важную роль в статистике и занимает особое положение среди других законов. Вспомним как выглядит нормальное распределение

где a -математическое ожидание, – среднее квадратическое отклонение.

Тестирование данных на нормальность является достаточно частым этапом первичного анализа данных, так как большое количество статистических методов использует тот факт, что данные распределены нормально. Если выборка не подчиняется нормальному закону, тогда предположении о параметрических статистических тестах нарушаются, и должны использоваться непараметрические методы статистики

Нормальное распределение естественным образом возникает практически везде, где речь идет об измерении с ошибками. Например, координаты точки попадания снаряда, рост, вес человека имеют нормальный закон распределения. Более того, центральная предельная теорема вообще утверждает, что сумма большого числа слагаемых сходится к нормальной случайной величине, не зависимо от того, какое было исходное распределение у выборки. Таким образом, данная теорема устанавливает условия, при которых возникает нормальное распределение и нарушение которых ведет к распределению, отличному от нормального.

Можно выделить следующие этапы проверки выборочных значений на нормальность

-

Подсчет основных характеристик выборки. Выборочное среднее, медиана, коэффициенты асимметрии и эксцесса.

-

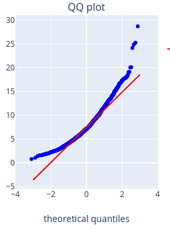

Графический. К этому методу относится построение гистограммы и график квантиль-квантиль или кратко QQ

-

Статистические методы. Данные методы вычисляют статистику по данным и определяют, какая вероятность того, что данные получены из нормального распределения

При нормальном распределении, которое симметрично, значения медианы и выборочного среднего будут одинаковы, значения эксцесса равно 3, а асимметрии равно нулю. Однако ситуация, когда все указанные выборочные характеристики равны именно таким значениям, практически не встречается. Поэтому после этапа подсчета выборочных характеристик можно переходить к графическому представлению выборочных данных.

Гистограмма позволяет представить выборочные данные в графическом виде – в виде столбчатой диаграммы, где данные делятся на заранее определенное количество групп. Вид гистограммы дает наглядное представление функции плотности вероятности некоторой случайной величины, построенной по выборке.

График QQ (квантиль-квантиль) является графиком вероятностей, который представляет собой графический метод сравнения двух распределений путем построения их квантилей. QQ график сравнивает наборы данных теоретических и выборочных (эмпирических) распределений. Если два сравниваемых распределения подобны, тогда точки на графике QQ будут приблизительно лежать на линии y=x. Основным шагом в построении графика QQ является расчет или оценка квантилей.

Существует множество статистических тестов, которые можно использовать для проверки выборочных значений на нормальность. Каждый тест использует разные предположения и рассматривает разные аспекты данных.

Чтобы применять статистические критерии сформулируем задачу. Выдвигаются две гипотезы H0 и H1, которые утверждают

H0 – Выборка подчиняется нормальному закону распределения

H1 – Выборка не подчиняется нормальному распределению

Установи уровень значимости alpha=0,05.

Теперь задача состоит в том, чтобы на основании какого-то критерия отвергнуть или принять основную нулевую гипотезу при уровне значимости

Критерий Шапиро-Уилка

Критерий Шапиро-Уилка основан на отношении оптимальной линейной несмещенной оценки дисперсии к ее обычной оценке методом максимального правдоподобия. Статистика критерия имеет вид

Числитель является квадратом оценки среднеквадратического отклонения Ллойда. Коэффициенты и критические

значения статистики являются табулированными значениями. Если

, то нулевая гипотеза нормальности распределения отклоняется на уровне значимости

.

В Python функция содержится в библиотеке scipy.stats и возвращает как статистику, рассчитанную тестом, так и значение p. В Python можно использовать выборку до 5000 элементов. Интерпретация вывода осуществляется следующим образом

Если значение , тогда принимается гипотеза H0, в противном случае, т.е. если,

, тогда принимается гипотеза H1, т.е. что выборка не подчиняется нормальному закону.

Критерий Д’Агостино

В данном критерии в качестве статистики для проверки нормальности распределения используется отношение оценки Даутона для стандартного отклонения к выборочному стандартному отклонению, оцененному методом максимального правдоподобия

В качестве статистики критерия Д’Агостино используется величина

значение которой рассчитывается на основе центральной предельной теоремы, которая утверждает, что при

гдестандартная нормальная случайная величина.

Критические значения являются табулированными значениями. Гипотеза нормальности принимается, если значение статистики лежит в интервале критических значений. Данный критерий показывает хорошую мощность против большого спектра альтернатив, по мощности немного уступая критерию Шапиро-Уилка.

В Python функция normaltest() также содержится в библиотеке scipy.stats и возвращает статистику теста и значение p. Интерпретация результата аналогична результатам в критерии Шапиро-Уилка.

Критерий согласия– Пирсона

Данный критерий является одним из наиболее распространенных критериев проверки гипотез о виде закона распределения и позволяет проверить значимость расхождения эмпирических (наблюдаемых) и теоретических (ожидаемых) частот. Таким образом, данный критерий позволяет проверить гипотезу о принадлежности наблюдаемой выборки некоторому теоретическому закону. Можно сказать, что критерий является универсальным, так как позволяет проверить принадлежность выборочных значений практическому любому закону распределения.

Для решения задачи используется статистика – Пирсона

где – эмпирические частоты (подсчитывается число элементов выборки, попавших в интервал),

– теоретические частоты. Подсчитывается критическое значение

. Если

, отклоняется гипотеза о принадлежности выборки нормальному распределению и принимается, если

.

Теперь перейдем к практической части. Для демонстрации функций будем использовать Dataset, взятый с сайта kaggle.com по прогнозированию инсульта по 11 клиническим характеристикам.

Загружаем необходимые библиотеки

import pandas as pd

import matplotlib.pyplot as plt

import seaborn as sns

import numpy as npЗагружаем датасет

data_healthcares = pd.read_csv('E:/vika/healthcare-dataset-stroke-data.csv')

Набор состоит из 5110 строк и 12 столбцов.

Посмотрим на основные характеристики, каждого признака.data_healthcares.describe()

Из данных характеристик можно увидеть, что есть пропущенные значения в показателях индекс массы тела. Посчитаем количество пропущенных значений.

Если бы нам необходимо было делать модель для прогноза, то пропущенные значения bmi являются достаточно большой проблемой, в которой возникает вопрос как их восстановить. Поэтому будем предполагать, что значения столбца bmi (индекс массы тела) подчиняются нормальному закону распределения (предварительно был построен график распределения, поэтому сделано такое предположение). Но так как, на данный момент, у нас нет необходимости в построении модели для прогноза, то удалим все пропущенные значения

new_data=data_healthcares.dropna()

Теперь можем приступать к проверке выборочных значений показателя bmi на нормальность. Вычислим основные выборочные характеристики

|

Выборочная характеристика |

Код в python |

Значение характеристики |

|

Выборочное среднее |

new_data.bmi.mean() |

28,89 |

|

Выборочная медиана |

new_data.bmi.median() |

28,1 |

|

Выборочная мода |

new_data.bmi.mode() |

28,7 |

|

Выборочное среднеквадратическое отклонение |

new_data.bmi.std() |

7.854066729680458 |

|

Выборочный коэффициент асиметрии |

new_data.bmi.skew() |

1.0553402052962928 |

|

Выборочный эксцесс |

new_data.bmi.kurtosis() |

3.362659165623678 |

После вычислений основных характеристик мы видим, что выборочное среднее и медиана можно сказать принимают одинаковые значения и коэффициент эксцесса равен 3. Но, к сожалению коэффициент асимметрии равен 1, что вводить нас в некоторое замешательство, т.е. мы уже можем предположить, что значения bmi не подчиняются нормальному закону. Продолжим исследования, перейдем к построению графиков.

Строим гистограмму

fig = plt.figure

fig,ax= plt.subplots(figsize=(7,7))

sns.distplot(new_data.bmi,color='red',label='bmi',ax=ax)

plt.show()

Гистограмма достаточно хорошо напоминает нормальное распределение, кроме конечно, небольшого выброса справа, но смотрим дальше. Тут скорее, можно предположить, что значения bmi подчиняются распределению .

Строим QQ график. В python есть отличная функция qqplot(), содержащаяся в библиотеке statsmodel, которая позволяет строить как раз такие графики.

from statsmodels.graphics.gofplots import qqplot

from matplotlib import pyplot

qqplot(new_data.bmi, line=’s’)

Pyplot.show

Что имеем из графика QQ? Наши выборочные значений имеют хвосты слева и справа, и также в правом верхнем углу значения становятся разреженными.

На основе данных графика можно сделать вывод, что значения bmi не подчиняются нормальному закону распределения. Рядом приведен пример QQ графика распределения хи-квадрат с 8 степенями свободы из выборки в 1000 значений.

Для примера построим график QQ для выборки из нормального распределения с такими же показателями стандартного отклонения и среднего, как у bmi.

std=new_data.bmi.std() # вычисляем отклонение

mean=new_data.bmi.mean() #вычисляем среднее

Z=np.random.randn(4909)*std+mean # моделируем нормальное распределение

qqplot(Z,line='s') # строим график

pyplot.show()

Продолжим исследования. Перейдем к статистическим критериям. Будем использовать критерий Шапиро-Уилка и Д’Агостино, чтобы окончательно принять или опровергнуть предположение о нормальном распределении. Для использования критериев подключим библиотеки

from scipy.stats import shapiro

from scipy.stats import normaltest

shapiro(new_data.bmi)

ShapiroResult(statistic=0.9535483717918396, pvalue=6.623218133972133e-37)

Normaltest(new_data.bmi)

NormaltestResult(statistic=1021.1795052962864, pvalue=1.793444363882936e-222)После применения двух тестов мы имеем, что значение p-value намного меньше заданного критического значения alpha , значит выборочные значения не принадлежат нормальному закону.

Конечно, мы рассмотрели не все тесты на нормальности, которые существуют. Какие можно дать рекомендации по проверке выборочных значений на нормальность. Лучше использовать все возможные варианты, если они уместны.

На этом все. Еще хочу порекомендовать бесплатный вебинар, который 15 июня пройдет на платформе OTUS в рамках запуска курса Математика для Data Science. На вебинаре расскажут про несколько часто используемых подходов в анализе данных, а также разберут, какие математические идеи работают у них под капотом и почему эти подходы вообще работают так, как нам нужно. Регистрация на вебинар доступна по этой ссылке.

Тестирование данных на нормальность часто является первым этапом их анализа, так как большое количество статистических методов исходит из предположения нормальности распределения изучаемых данных.

Например, пусть необходимо проверить гипотезу о равенстве средних значений в двух независимых выборках. Для этой цели подходит критерий Стьюдента. Но применение критерия Стьюдента обосновано, только если данные подчиняются нормальному распределению. Поэтому перед применением критерия необходимо проверить гипотезу о нормальности исходных данных. Или проверка остатков линейной регрессии на нормальность — позволяет проверить, соответствует ли применяемая модель регрессии исходным данным.

Нормальное распределение естественным образом возникает практически везде, где речь идёт об измерении с ошибками. Более того, в силу центральной предельной теоремы, распределение многих выборочных величин (например, выборочного среднего) при достаточно больших объёмах выборки хорошо аппроксимируется нормальным распределением вне зависимости от того, какое распределение было у выборки исходно. В связи с этим становится понятным, почему проверке распределения на нормальность стоит уделить особое внимание. В дальнейшем речь пойдёт о так называемых критериях согласия (goodness-of-fit tests). Проверяться будет не просто факт согласия с нормальным распределением с определёнными фиксированными значениями параметров, а несколько более общий факт принадлежности распределения к семейству нормальных распределений со всевозможными значениями параметров.

Проверку выборки на нормальность можно производить несколькими путями. Для начала можно вспомнить, какой вид у графика нормального распределения (гистограмма, график плотности и т.п.), как в нормальном распределении соотносятся среднее, мода, медиана, какими должны быть асимметрия и эксцесс, выполняется ли «правило 3-х сигм». Про всё это мы писали в статье про нормальное распределение. Вот с помощью такой описательной статистики можно оценить выборку на нормальность (обычно приемлемо отклонение на порядок ошибки рассчитываемого параметра). Вторая группа методов — критерии нормальности.

Критерии нормальности

Список критериев нормальности:

- Критерий Шапиро-Уилка

- Критерий асимметрии и эксцесса

- Критерий Дарбина

- Критерий Д’Агостино

- Критерий Васичека

- Критерий Дэвида-Хартли-Пирсона

- Критерий хи-квадрат

- Критерий Андерсона-Дарлинга

- Критерий Филлибена

- Критерий Колмогорова-Смирнова

- Критерий Мартинса-Иглевича

- Критерий Лина-Мудхолкара

- Критерий Шпигельхальтера

- Критерий Саркади

- Критерий Смирнова-Крамера-фон Мизеса

- Критерий Локка-Спурье

- Критерий Оя

- Критерий Хегази-Грина

- Критерий Муроты-Такеучи

Подробно эти критерии с формулами и таблицами можно посмотреть здесь.

Проверка на нормальность в R (источник)

Самый простой графический способ проверки характера распределения данных — построение гистограммы (с помощью функции hist() — это сделать несложно). Если гистограмма имеет колоколообразный симметричный вид, можно сделать заключение о том, что анализируемая переменная имеет примерно нормальное распределение. Однако при интерпретации гистограмм следует соблюдать осторожность, поскольку их внешний вид может сильно зависеть как от числа наблюдений, так и от шага, выбранного для разбиения данных на классы.

Другим очень часто используемым графическим способом проверки характера распределения данных является построение т.н. графиков квантилей (Q-Q plots, Quantile-Quantile plots). На таких графиках изображаются квантили двух распределений — эмпирического (т.е. построенного по анализируемым данным) и теоретически ожидаемого стандартного нормального распределения. При нормальном распределении проверяемой переменной точки на графике квантилей должны выстраиваться в прямую линию, исходящую под улом 45 градусов из левого нижнего угла графика. Графики квантилей особенно полезны при работе с небольшими по размеру совокупностями, для которых невозможно построить гистограммы, принимающие какую-либо выраженную форму.

В R для построения графиков квантилей можно использовать базовую функцию qqnorm(), которая в качестве основного аргумента принимает вектор со значениями анализируемой переменной.

x <- rnorm(500) # генерация нормально распределенной совокупности с n = 500

qqnorm(x)

Следует отметить, что интерпретация графиков квантилей при работе с небольшими выборками, происходящими из нормально распределенных генеральных совокупностей, требует определенного навыка. Дело в том, что при небольшом числе наблюдений точки на графике квантилей могут не всегда образовывать четко выраженную прямую линию. В качестве иллюстрации этого утверждения на следующем рисунке приведены графики квантилей для 5 случайным образом сгенерированных нормально распределенных выборок по 20 наблюдений каждая (если использованный в примере пакет DAAG у Вас не установлен, выполните команду install.packages(«DAAG»)):

library(DAAG)

qreference(m = 20, seed = 145, nrep = 5, nrows = 1)

Фигура, в которую выстраиваются точки на некоторых графиках далека от прямой линии. Причина данного эффекта — в небольшом объеме наблюдений.

Тесты проверки на нормальность в R

Существует целый ряд статистических тестов, специально разработанных для проверки нормальности распределения данных. В общем виде проверяемую при помощи этих тестов нулевую гипотезу можно сформулировать так: «Анализируемая выборка происходит из генеральной совокупности, имеющей нормальное распределение». Если получаемая при помощи того или иного теста вероятность ошибки Р оказывается меньше некоторого заранее принятого уровня значимости (например, 0.05), нулевая гипотеза отклоняется.

В R реализованы практически все имеющиеся тесты на нормальность — либо в виде стандарных функций, либо в виде функций, входящих в состав отдельных пакетов. Примером базовой функции является shapiro.test(), при помощи которой можно выполнить широко используемый тест Шапиро-Уилка:

shapiro.test(rnorm(500))

Shapiro-Wilk normality test

data: rnorm(500)

W = 0.9978, p-value = 0.7653 # P > 0.05 - нулевая гипотеза не отвергается

Основные классические критерии проверки на нормальность собраны в пакете nortest. Пакет можно установить с CRAN при помощи вызова функции install.packages():

> install.packages(pkgs=c("nortest"))

Подключить установленный пакет можно при помощи функции library():

> library(nortest)

Может возникнуть вопрос: «А зачем столько много разных критериев для проверки одного факта? Нельзя ли выбрать наилучший и всегда его использовать?». Ответ на этот вопрос не утешителен: «В общем случае, к сожалению, нельзя».

Критерий Лиллифорса

Критерий Лиллифорса (Lilliefors) является вариантом известного классического критерия Колмогорова-Смирнова, специально модифицированного для проверки нормальности. Эта модификация существенна. Для проверки гипотезы нормальности нельзя использовать классический непараметрический критерий Колмогорова-Смирнова, реализованный в функции ks.test(). Критерий Лиллифорса реализован в функции lillie.test():

> lillie.test(rnorm(100, mean = 6, sd = 4));

Lilliefors (Kolmogorov-Smirnov) normality test

data: rnorm(100, mean = 6, sd = 4)

D = 0.0463, p-value = 0.8621

> lillie.test(runif(100, min = 2, max = 4));

Lilliefors (Kolmogorov-Smirnov) normality test

data: runif(100, min = 2, max = 4)

D = 0.0732, p-value = 0.2089

Критерии Крамера-фон Мизеса и Андерсона-Дарлинга

Эти критерии менее известны, но обычно работают гораздо лучше, нежели критерий Лиллифорса. Они реализованы в функциях cvm.test() и ad.test() соответственно:

> cvm.test(rnorm(50, mean = 6, sd = 4));

Cramer-von Mises normality test

data: rnorm(50, mean = 6, sd = 4)

W = 0.0321, p-value = 0.8123

> ad.test(runif(50, min = 2, max = 4));

Anderson-Darling normality test

data: runif(50, min = 2, max = 4)

A = 1.5753, p-value = 0.0004118

Критерий Шапиро-Франсиа

Этот критерий работает достаточно хорошо в большинстве не очень «сложных» случаев. Получить p-значение можно посредством функции sf.test():

> sf.test(rexp(50, rate = 2));

Shapiro-Francia normality test

data: rexp(50, rate = 2)

W = 0.7803, p-value = 2.033e-06

Критерий хи-квадрат Пирсона

В отличие от задач проверки пропорций, критерий хи-квадрат обычно очень плохо работает в задачах проверки распределения на нормальность. Вероятность ошибки второго рода очень велика для достаточно широкого класса альтернативных распределений. В связи с этим, использовать его не рекомендуется. Тем не менее реализация его предоставлена функцией pearson.test(). У этой функции есть булевская опция adjusted, которая позволяет внести поправки в p-значение из-за наличия двух неизвестных параметров. Рекомендуемая последовательность действий такая: получить два p-значения, одно, соответствующее adjusted=TRUE, второе — adjusted=FALSE. Истинное p-значение обычно находится между. Кроме того, полезно поварьировать объем выборки и посмотреть, насколько сильно меняется p-значение. Если влияние объёма выборки сильное, то от использования критерия стоит отказаться во избежание ошибок.

> pearson.test(rnorm(50, mean = 6, sd = 4));

Pearson chi-square normality test

data: rnorm(50, mean = 6, sd = 4)

P = 5.2, p-value = 0.6356

> pearson.test(runif(50, min = -1, max = 1));

Pearson chi-square normality test

data: runif(50, min = -1, max = 1)

P = 7.6, p-value = 0.3692

Дополнительнаая информация: проверка на нормальность

| Нормальное распределение | |

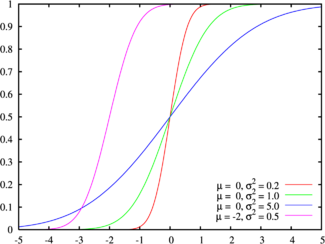

|---|---|

Зеленая линия соответствует стандартному нормальному распределениюПлотность вероятности |

|

Цвета на этом графике соответствуют графику наверхуФункция распределения |

|

| Обозначение |

|

| Параметры |

μ — коэффициент сдвига (вещественный) σ > 0 — коэффициент масштаба (вещественный, строго положительный) |

| Носитель |

|

| Плотность вероятности |

|

| Функция распределения |

![{frac {1}{2}}left[1+operatorname {erf} left({frac {x-mu }{sqrt {2sigma ^{2}}}}right)right]](https://wikimedia.org/api/rest_v1/media/math/render/svg/04670b14acb4ddb796469f3812ead9d9cccec275) |

| Математическое ожидание |

|

| Медиана |

|

| Мода |

|

| Дисперсия |

|

| Коэффициент асимметрии |

|

| Коэффициент эксцесса |

|

| Дифференциальная энтропия |

|

| Производящая функция моментов |

|

| Характеристическая функция |

|

Норма́льное распределе́ние[1][2], также называемое распределением Гаусса или Гаусса — Лапласа[3], или колоколообразная кривая — непрерывное распределение вероятностей с пиком в центре и симметричными боковыми сторонами, которое в одномерном случае задаётся функцией плотности вероятности, совпадающей с функцией Гаусса:

,

- где параметр

— математическое ожидание (среднее значение), медиана и мода распределения, а параметр

— среднеквадратическое отклонение,

— дисперсия распределения.

Таким образом, одномерное нормальное распределение является двухпараметрическим семейством распределений, которое принадлежит экспоненциальному классу распределений[4]. Многомерный случай описан в статье «Многомерное нормальное распределение».

Стандартным нормальным распределением называется нормальное распределение с математическим ожиданием

Общие сведения[править | править код]

Если величина является суммой многих случайных слабо взаимозависимых величин, каждая из которых вносит малый вклад относительно общей суммы, то центрированное и нормированное распределение такой величины при достаточно большом числе слагаемых стремится к нормальному распределению.

Это следует из центральной предельной теоремы теории вероятностей. В окружающем нас мире часто встречаются величины, значение которых определяется совокупностью многих независимых факторов. Этот факт, а также то, что распределение считалось типичным, обычным, привели к тому, что в конце XIX века стал использоваться термин «нормальное распределение». Нормальное распределение играет заметную роль во многих областях науки, например в математической статистике и статистической физике.

Случайная величина, имеющая нормальное распределение, называется нормальной, или гауссовской, случайной величиной.

Определения[править | править код]

Стандартное нормальное распределение[править | править код]

Наиболее простой случай нормального распределения — стандартное нормальное распределение — частный случай, когда

Множитель

Гаусс называл стандартным нормальным распределение с

Нормальное распределение с параметрами μ, σ[править | править код]

Каждое нормальное распределение — это вариант стандартного нормального распределения, область значений которого растягивается множителем

Если

Если в экспоненте плотности вероятности раскрыть скобки и учитывать, что

Таким образом, плотность вероятности каждого нормального распределения представляет собой экспоненту квадратичной функции:

- где

Отсюда можно выразить среднее значение как

Обозначение[править | править код]

Плотность вероятности стандартного нормального распределения (с нулевым средним и единичной дисперсией) часто обозначается греческой буквой

Нормальное распределение часто обозначается

Функция распределения[править | править код]

Функция распределения стандартного нормального распределения (нормальное интегральное распределение) обычно обозначается заглавной греческой буквой

С ней связана функция ошибок (интеграл вероятности)

![{displaystyle [-x,x]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e23c41ff0bd6f01a0e27054c2b85819fcd08b762)

Эти интегралы не выражаются в элементарных функциях и называются специальными функциями. Многие их численные приближения известны. См. ниже.

Функции связаны, в частности, соотношением:

.

Нормальное распределение с плотностью

Можно использовать функцию

.

График стандартной нормальной функции распределения

Функция распределения стандартной нормальной случайной величины может быть разложена с помощью метода интегрирования по частям в ряд:

где знак

Асимптотическое разложение функции распределения для больших

Стандартное отклонение[править | править код]

Правило 68-95-99,7.

Для нормального распределения количество значений, отличающихся от среднего на число, меньшее чем одно стандартное отклонение, составляют 68,27 % выборок. В то же время количество значений, отличающиеся от среднего на два стандартных отклонения, составляют 95,45 %, а на три стандартных отклонения — 99,73 %.

Около 68 % значений из нормального распределения находятся на расстоянии не более одного стандартного отклонения σ от среднего; около 95 % значений лежат расстоянии не более двух стандартных отклонений; и 99,7 % не более трёх. Этот факт является частным случаем правила 3 сигм для нормальной выборки.

Более точно, вероятность получить нормальное число в интервале между

С точностью до 12 значащих цифр значения для

|

|

|

|

OEIS |

|---|---|---|---|---|

| 1 | 0,682689492137 | 0,317310507863 |

3,15148718753 |

A178647 |

| 2 | 0,954499736104 | 0,045500263896 |

21,9778945080 |

A110894 |

| 3 | 0,997300203937 | 0,002699796063 |

370,398347345 |

A270712 |

| 4 | 0,999936657516 | 0,000063342484 |

15787.1927673 |

|

| 5 | 0,999999426697 | 0,000000573303 |

1744277,89362 |

|

| 6 | 0,999999998027 | 0,000000001973 |

506797345,897 |

Свойства[править | править код]

Моменты[править | править код]

Моментами и абсолютными моментами случайной величины

Если

Здесь

Центральные абсолютные моменты для неотрицательных целых

Последняя формула справедлива также для произвольных

Преобразование Фурье и характеристическая функция[править | править код]

Преобразование Фурье нормальной плотности вероятности

- где

есть мнимая единица.

Если математическое ожидание

В теории вероятности, преобразование Фурье плотности распределения действительной случайной величины

Бесконечная делимость[править | править код]

Нормальное распределение является бесконечно делимым.

Если случайные величины

Отсюда вытекает, что нормальная случайная величина представима как сумма произвольного числа независимых нормальных случайных величин.

Максимальная энтропия[править | править код]

Нормальное распределение имеет максимальную дифференциальную энтропию среди всех непрерывных распределений, дисперсия которых не превышает заданную величину[11][12].

Правило трёх сигм для гауссовской случайной величины[править | править код]

График плотности вероятности нормального распределения и процент попадания случайной величины на отрезки, равные среднеквадратическому отклонению.

Правило трёх сигм (

- где

— математическое ожидание и параметр нормальной случайной величины.

Более точно — приблизительно с вероятностью 0,9973 значение нормально распределённой случайной величины лежит в указанном интервале.

Моделирование нормальных псевдослучайных величин[править | править код]

При компьютерном моделировании, особенно при применении метода Монте-Карло, желательно использовать величины, распределенные по нормальному закону. Многие алгоритмы дают стандартные нормальные величины, так как нормальную величину

- где Z — стандартная нормальная величина.

Алгоритмы также используют различные преобразования равномерных величин.

Простейшие приближённые методы моделирования основываются на центральной предельной теореме. Если сложить достаточно большое количество независимых одинаково распределённых величин с конечной дисперсией, то сумма будет иметь распределение, близкое к нормальному. Например, если сложить 100 независимых стандартно равномерно распределённых случайных величин, то распределение суммы будет приближённо нормальным.

Для программного генерирования нормально распределённых псевдослучайных величин предпочтительнее использовать преобразование Бокса — Мюллера. Оно позволяет генерировать одну нормально распределённую величину на базе одной равномерно распределённой.

Также существует алгоритм Зиккурат, который работает даже быстрее преобразования Бокса — Мюллера. Тем не менее, сложнее в реализации, но его применение оправдано в случаях, когда требуется генерирование очень большого числа неравномерно распределённых случайных чисел.

Нормальное распределение в природе и приложениях[править | править код]

Нормальное распределение часто встречается в природе. Например, следующие случайные величины хорошо моделируются нормальным распределением:

- отклонение при стрельбе;

- погрешности измерений (однако погрешности некоторых измерительных приборов имеют иное распределение);

- некоторые характеристики живых организмов в популяции.

Такое широкое распространение этого распределения связано с тем, что оно является бесконечно делимым непрерывным распределением с конечной дисперсией. Поэтому к нему в пределе приближаются некоторые другие, например биномиальное и пуассоновское. Этим распределением моделируются многие недетерминированные физические процессы[13].

Многомерное нормальное распределение используется при исследовании многомерных случайных величин (случайных векторов). Одним из многочисленных примеров таких приложений является исследование параметров личности человека в психологии и психиатрии.

Связь с другими распределениями[править | править код]

- Отношение квадратов двух стандартных нормальных случайных величин имеет распределение Фишера со степенями свободы

История[править | править код]

Впервые нормальное распределение как предел биномиального распределения при

См. также[править | править код]

- Аддитивный белый гауссовский шум

- Логнормальное распределение

- Равномерное распределение

- Центральная предельная теорема

- Двумерное нормальное распределение

- Многомерное нормальное распределение

- Распределение хи-квадрат

- Статистический критерий

- Частотное распределение

Примечания[править | править код]

- ↑ Вентцель Е. С. Теория вероятностей. — 10-е изд., стереотипное.. — М.: Academia, 2005. — 576 с. — ISBN 5-7695-2311-5.

- ↑ Ширяев А. Н. Вероятность. — М.: Наука, 1980.

- ↑ 1 2 Математический энциклопедический словарь. — М.: Советская энциклопедия, 1988. — С. 139—140.

- ↑ Wasserman L. All of Statistics. — New York, NY: Springer, 2004. — С. 142. — 433 с. — ISBN 978-1-4419-2322-6.

- ↑ Доказательство см. Гауссов интеграл

- ↑ Halperin, Hartley & Hoel, 1965, item 7.

- ↑ McPherson (1990)

- ↑ Wolfram|Alpha: Computational Knowledge Engine. Wolframalpha.com. Дата обращения: 3 марта 2017.

- ↑ Bryc (1995, p. 23)

- ↑ Bryc (1995, p. 24)

- ↑ Cover, Thomas M.; Thomas, Joy A. Elements of Information Theory. — John Wiley and Sons, 2006. — С. 254.

- ↑ Park, Sung Y.; Bera, Anil K. Maximum Entropy Autoregressive Conditional Heteroskedasticity Model (англ.) // Journal of Econometrics (англ.) (рус. : journal. — Elsevier, 2009. — P. 219—230. Архивировано 7 марта 2016 года.

- ↑ Талеб Н. Н. Чёрный лебедь. Под знаком непредсказуемости = The Black Swan: The Impact of the Highly Improbable. — КоЛибри, 2012. — 525 с. — ISBN 978-5-389-00573-0.

- ↑ Королюк, 1985, с. 135.

- ↑ Галкин В. М., Ерофеева Л. Н., Лещева С. В. Оценки параметра распределения Коши // Труды Нижегородского государственного технического университета им. Р. Е. Алексеева. — 2014. — № 2(104). — С. 314—319. — УДК 513.015.2(G).

- ↑ Lukacs, Eugene. A Characterization of the Normal Distribution (англ.) // The Annals of Mathematical Statistics (англ.) (рус. : journal. — 1942. — Vol. 13, no. 1. — P. 91—3. — ISSN 0003-4851. — doi:10.1214/aoms/1177731647. — JSTOR 2236166.

- ↑ Lehmann, E. L.ruen. Testing Statistical Hypotheses. — 2nd. — Springer (англ.) (рус., 1997. — С. 199. — ISBN 978-0-387-94919-2.

- ↑ The doctrine of chances; or, a method of calculating the probability of events in play, L., 1718, 1738, 1756; L., 1967 (репродуцир. изд.); Miscellanea analytica de scriebus et quadraturis, L., 1730.

Литература[править | править код]

- Королюк В. С., Портенко Н. И., Скороход А. В., Турбин А. Ф. Справочник по теории вероятностей и математической статистике. — М.: Наука, 1985. — 640 с.

- Halperin, Max; Hartley, Herman O.; Hoel, Paul G. Recommended Standards for Statistical Symbols and Notation. COPSS Committee on Symbols and Notation (англ.) // The American Statistician (англ.) (рус. : journal. — 1965. — Vol. 19, no. 3. — P. 12—14. — doi:10.2307/2681417. — JSTOR 2681417.

- McPherson, Glen. Statistics in Scientific Investigation: Its Basis, Application and Interpretation (англ.). — Springer-Verlag, 1990. — ISBN 978-0-387-97137-7.

- Bryc, Wlodzimierz. The Normal Distribution: Characterizations with Applications (англ.). — Springer-Verlag, 1995. — ISBN 978-0-387-97990-8.

Ссылки[править | править код]

- Таблица значений функции стандартного нормального распределения

- Онлайн расчёт вероятности нормального распределения

Нормальность распределения

В примерах в данной статье данные генерятся при каждой загрузке страницы. Если Вы хотите посмотреть пример с другими значениями –

обновите страницу .

Некоторые статистические инструменты исходят из предположения, что распределение

является нормальным. Ниже будет приведён алгоритм проверки нормальности распределения,

а также пример в excel.

Закон распределения

Проверка на соответствие нормальному распределению – это частный случай решения задачи

о нахождении среди известных функций распределения такой, максимально точно описывающей

данное распределение.

В первую очередь, необходимо структурировать имеющиеся значения, в статье

свойства

распределения

описано, как строится ряд распределения, поэтому здесь я опущу детали и приведу

исходные данные и обработанные значения:

| 144 | 145 | 147 | 147 | 161 | 139 | 168 | 161 | 145 | 166 |

| 153 | 134 | 151 | 152 | 151 | 142 | 149 | 141 | 170 | 135 |

| 138 | 159 | 163 | 153 | 139 | 164 | 152 | 154 | 150 | 158 |

| 155 | 154 | 130 | 164 | 163 | 156 | 157 | 137 | 145 | 166 |

| 144 | 161 | 149 | 152 | 124 | 145 | 155 | 144 | 169 | 149 |

| 162 | 164 | 162 | 143 | 140 | 133 | 151 | 149 | 133 | 147 |

| 146 | 150 | 144 | 133 | 133 | 159 | 139 | 145 | 159 | 158 |

| 145 | 158 | 136 | 154 | 162 | 153 | 148 | 148 | 131 | 148 |

| 149 | 168 | 138 | 148 | 157 | 146 | 161 | 152 | 154 | 172 |

| 158 | 136 | 151 | 145 | 143 | 136 | 165 | 140 | 147 | 152 |

| Таблица 1. Исходные данные для проверки нормальности распределения |

| # | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 |

|---|---|---|---|---|---|---|---|---|---|---|

| x | 1 | 6 | 8 | 9 | 17 | 20 | 12 | 14 | 8 | 4 |

| pi | 0.01 | 0.06 | 0.08 | 0.09 | 0.17 | 0.2 | 0.12 | 0.14 | 0.08 | 0.04 |

| Таблица 2. Количество элементов в каждом интервале |

График 1. Ряд распределения

Независимо от того, что мы видим на графике, нам необходимо проверить, является

ли распределение нормальным.

Характеристики нормального распределения – это среднее значение и стандартное отклонение.

Вычислим эти значения для нашего распределения:

μ = 150.01

σ = 10.3

Расчёт среднего значения и стандартного отклонения описан в статье параметры распределения

Нормальное распределение

Кривая нормального распределения для μ=150.01 и σ=10.3:

P(x) = e^[-0.5((x-150.01)/10.3)2] / [10.3√2π]

Формула нормального распределения

График 2. Ряд распределения и нормальное распределение, μ = 150.01, σ = 10.3

Первое приближение

Попробуем изобрести критерий нормальности, самое простое,

что приходит в голову – это определить процент соответствия

нормальной кривой и существующего распределения.

Для этого сложим абсолютные значения разниц по всем точкам графика,

найдём площадь под графиком нормального распределения и вычислим

интересующее отклонение, я назову такой критерий

“критерий нормальности” и постановлю, что если отклонение

больше, допустим 30%, то распределение не является нормальным.

diff = Σ|D(X) – P(X)|

S = ΣP(X)

Δ = diff / S

diff = 17.33

S = 106.6

Δ = 16%

Отклонение составляет 16%, а значит я делаю вывод, что распределение является нормальным

по критерию нормальности со средним значением

μ=150.01 и стандартным отклонением σ=10.3.

Скачать статью в формате PDF.

Автор статьи:

Дата редакции статьи: 19.12.2019

Вам понравилась статья?

/

Просмотров: 3 815

![{displaystyle F(x)=Phi left({frac {x-mu }{sigma }}right)={frac {1}{2}}left[1+operatorname {erf} left({frac {x-mu }{sigma {sqrt {2}}}}right)right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6a75caa2df3861960f6c6a5ac91f0b0fa6d79504)

![{displaystyle Phi (x)={frac {1}{2}}+{frac {1}{sqrt {2pi }}}cdot e^{-x^{2}/2}left[x+{frac {x^{3}}{3}}+{frac {x^{5}}{3cdot 5}}+cdots +{frac {x^{2n+1}}{(2n+1)!!}}+cdots right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b755fcac449fe404b290943b01b01eab9c50440a)

![{displaystyle mathbb {E} left[X^{p}right]={begin{cases}0&p=2n+1,\sigma ^{p},left(p-1right)!!&p=2n.end{cases}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c39f9a1d5eadfbc872b3cd41f8135576e3123bc4)

![{displaystyle mathbb {E} left[left|Xright|^{p}right]=sigma ^{p},left(p-1right)!!cdot left.{begin{cases}{sqrt {frac {2}{pi }}}&p=2n+1,\1&p=2n.end{cases}}right}=sigma ^{p}cdot {frac {2^{frac {p}{2}}Gamma left({frac {p+1}{2}}right)}{sqrt {pi }}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c45215d47f1e0fc958abfae9a8d7137995cf90a8)

![{displaystyle t={frac {{overline {X}}-mu }{S/{sqrt {n}}}}={frac {{frac {1}{n}}(X_{1}+cdots +X_{n})-mu }{sqrt {{frac {1}{n(n-1)}}left[(X_{1}-{overline {X}})^{2}+cdots +(X_{n}-{overline {X}})^{2}right]}}}sim t_{n-1}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/36ff0d3c79a0504e8f259ef99192b825357914d7)