Нормальным называют распределение вероятностей непрерывной случайной величины

, плотность которого имеет вид:

где

–

математическое ожидание,

–

среднее квадратическое отклонение

.

Вероятность того, что

примет

значение, принадлежащее интервалу

:

где

– функция Лапласа:

Вероятность того, что абсолютная

величина отклонения меньше положительного числа

:

В частности, при

справедливо

равенство:

Асимметрия, эксцесс,

мода и медиана нормального распределения соответственно равны:

, где

Правило трех сигм

Преобразуем формулу:

Положив

. В итоге получим

если

, и, следовательно,

, то

то есть вероятность того, что

отклонение по абсолютной величине будет меньше утроенного среднего квадратического отклонение, равна 0,9973.

Другими словами, вероятность того,

что абсолютная величина отклонения превысит утроенное среднее квадратическое отклонение, очень мала, а именно равна

0,0027. Это означает, что лишь в 0,27% случаев так может произойти. Такие

события исходя из принципа невозможности маловероятных

событий можно считать практически невозможными. В этом и состоит

сущность правила трех сигм: если случайная величина распределена нормально, то

абсолютная величина ее отклонения от математического ожидания не превосходит

утроенного среднего квадратического отклонения.

На практике правило трех сигм

применяют так: если распределение изучаемой случайной величины неизвестно, но

условие, указанное в приведенном правиле, выполняется, то есть основание

предполагать, что изучаемая величина распределена нормально; в противном случае

она не распределена нормально.

Смежные темы решебника:

- Таблица значений функции Лапласа

- Непрерывная случайная величина

- Показательный закон распределения случайной величины

- Равномерный закон распределения случайной величины

Пример 2

Ошибка

высотометра распределена нормально с математическим ожиданием 20 мм и средним

квадратичным отклонением 10 мм.

а) Найти

вероятность того, что отклонение ошибки от среднего ее значения не превзойдет 5

мм по абсолютной величине.

б) Какова

вероятность, что из 4 измерений два попадут в указанный интервал, а 2 – не

превысят 15 мм?

в)

Сформулируйте правило трех сигм для данной случайной величины и изобразите

схематично функции плотности вероятностей и распределения.

Решение

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

а) Вероятность того, что случайная величина, распределенная по

нормальному закону, отклонится от среднего не более чем на величину

:

В нашем

случае получаем:

б) Найдем

вероятность того, что отклонение ошибки от среднего значения не превзойдет 15

мм:

Пусть событие

– ошибки 2

измерений не превзойдут 5 мм и ошибки 2 измерений не превзойдут 0,8664 мм

– ошибка не

превзошла 5 мм;

– ошибка не

превзошла 15 мм

в)

Для заданной нормальной величины получаем следующее правило трех сигм:

Ошибка высотометра будет лежать в интервале:

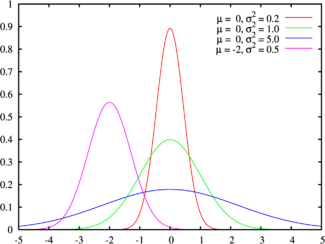

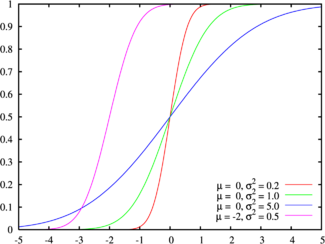

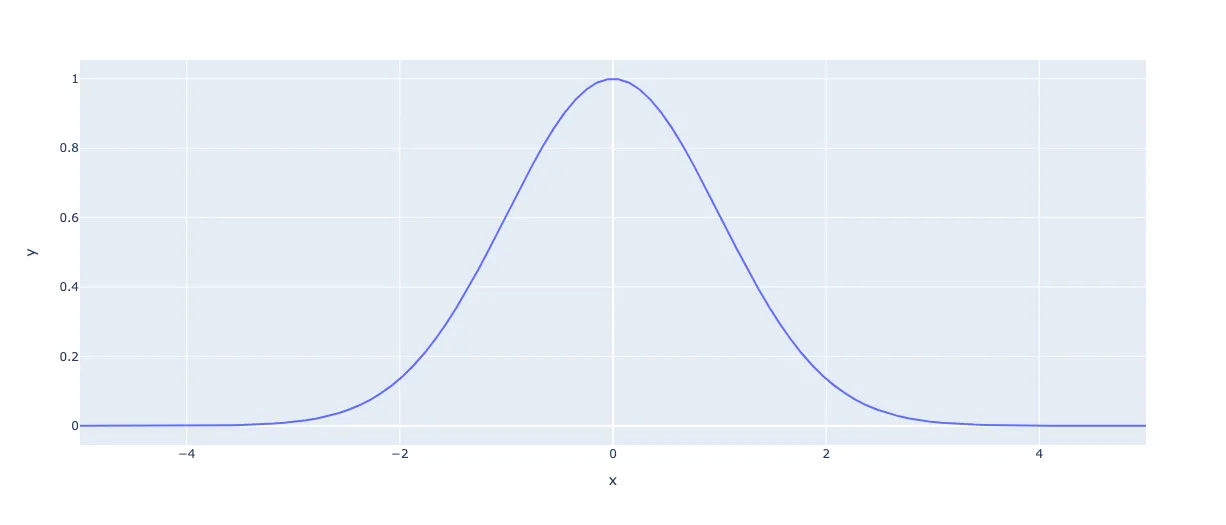

Функция плотности вероятностей:

График плотности распределения нормально распределенной случайной величины

Функция распределения:

График функции

распределения нормально распределенной случайной величины

Задача 1

Среднее

количество осадков за июнь 19 см. Среднеквадратическое отклонение количества

осадков 5 см. Предполагая, что количество осадков нормально-распределенная

случайная величина найти вероятность того, что будет не менее 13 см осадков.

Какой уровень превзойдет количество осадков с вероятностью 0,95?

Задача 2

Найти

закон распределения среднего арифметического девяти измерений нормальной

случайной величины с параметрами m=1.0 σ=3.0. Чему равна вероятность того, что

модуль разности между средним арифметическим и математическим ожиданием

превысит 0,5?

Указание:

воспользоваться таблицами нормального распределения (функции Лапласа).

Задача 3

Отклонение

напряжения в сети переменного тока описывается нормальным законом

распределения. Дисперсия составляет 20 В. Какова вероятность при изменении

выйти за пределы требуемых 10% (22 В).

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 4

Автомат

штампует детали. Контролируется длина детали Х, которая распределена нормально

с математическим ожиданием (проектная длинна), равная 50 мм. Фактическая длина

изготовленных деталей не менее 32 и не более 68 мм. Найти вероятность того, что

длина наудачу взятой детали: а) больше 55 мм; б) меньше 40 мм.

Задача 5

Случайная

величина X распределена нормально с математическим ожиданием a=10и средним

квадратическим отклонением σ=5. Найти

интервал, симметричный относительно математического ожидания, в котором с

вероятностью 0,9973 попадает величина Х в результате испытания.

Задача 6

Заданы

математическое ожидание ax=19 и среднее квадратическое отклонение σ=4

нормально распределенной случайной величины X. Найти: 1) вероятность

того, что X примет значение, принадлежащее интервалу (α=15;

β=19); 2) вероятность того, что абсолютная величина отклонения значения

величины от математического ожидания окажется меньше δ=18.

Задача 7

Диаметр

выпускаемой детали – случайная величина, распределенная по нормальному закону с

математическим ожиданием и дисперсией, равными соответственно 10 см и 0,16 см2.

Найти вероятность того, что две взятые наудачу детали имеют отклонение от

математического ожидания по абсолютной величине не более 0,16 см.

Задача 8

Ошибка

прогноза температуры воздуха есть случайная величина с m=0,σ=2℃. Найти вероятность

того, что в течение недели ошибка прогноза трижды превысит по абсолютной

величине 4℃.

Задача 9

Непрерывная

случайная величина X распределена по нормальному

закону: X∈N(a,σ).

а) Написать

плотность распределения вероятностей и функцию распределения.

б) Найти

вероятность того, что в результате испытания случайная величина примет значение

из интервала (α,β).

в) Определить

приближенно минимальное и максимальное значения случайной величины X.

г) Найти

интервал, симметричный относительно математического ожидания a, в котором с

вероятностью 0,98 будут заключены значения X.

a=5; σ=1.3;

α=4; β=6

Задача 10

Производится измерение вала без

систематических ошибок. Случайные ошибки измерения X

подчинены нормальному закону с σx=10. Найти вероятность того, что измерение будет

произведено с ошибкой, превышающей по абсолютной величине 15 мм.

Задача 11

Высота

стебля озимой пшеницы – случайная величина, распределенная по нормальному закону

с параметрами a = 75 см, σ = 1 см. Найти вероятность того, что высота стебля:

а) окажется от 72 до 80 см; б) отклонится от среднего не более чем на 0,5 см.

Задача 12

Деталь,

изготовленная автоматом, считается годной, если отклонение контролируемого

размера от номинала не превышает 10 мм. Точность изготовления деталей

характеризуется средним квадратическим отклонением, при данной технологии

равным 5 мм.

а)

Считая, что отклонение размера детали от номинала есть нормально распределенная

случайная величина, найти долю годных деталей, изготовляемых автоматом.

б) Какой

должна быть точность изготовления, чтобы процент годных деталей повысился до

98?

в)

Написать выражение для функции плотности вероятности и распределения случайной

величины.

Задача 13

Диаметр

детали, изготовленной цехом, является случайной величиной, распределенной по

нормальному закону. Дисперсия ее равна 0,0001 см, а математическое ожидание –

2,5 см. Найдите границы, симметричные относительно математического ожидания, в

которых с вероятностью 0,9973 заключен диаметр наудачу взятой детали. Какова

вероятность того, что в серии из 1000 испытаний размер диаметра двух деталей

выйдет за найденные границы?

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 14

Предприятие

производит детали, размер которых распределен по нормальному закону с

математическим ожиданием 20 см и стандартным отклонением 2 см. Деталь будет

забракована, если ее размер отклонится от среднего (математического ожидания)

более, чем на 2 стандартных отклонения. Наугад выбрали две детали. Какова вероятность

того, что хотя бы одна из них будет забракована?

Задача 15

Диаметры

деталей распределены по нормальному закону. Среднее значение диаметра равно d=14 мм

, среднее квадратическое

отклонение σ=2 мм

. Найти вероятность того,

что диаметр наудачу взятой детали будет больше α=15 мм и не меньше β=19 мм; вероятность того, что диаметр детали

отклонится от стандартной длины не более, чем на Δ=1,5 мм.

Задача 16

В

электропечи установлена термопара, показывающая температуру с некоторой

ошибкой, распределенной по нормальному закону с нулевым математическим

ожиданием и средним квадратическим отклонением σ=10℃. В момент когда термопара

покажет температуру не ниже 600℃, печь автоматически отключается. Найти

вероятность того, что печь отключается при температуре не превышающей 540℃ (то

есть ошибка будет не меньше 30℃).

Задача 17

Длина

детали представляет собой нормальную случайную величину с математическим

ожиданием 40 мм и среднеквадратическим отклонением 3 мм. Найти:

а)

Вероятность того, что длина взятой наугад детали будет больше 34 мм и меньше 43

мм;

б)

Вероятность того, что длина взятой наугад детали отклонится от ее

математического ожидания не более, чем на 1,5 мм.

Задача 18

Случайное

отклонение размера детали от номинала распределены нормально. Математическое

ожидание размера детали равно 200 мм, среднее квадратическое отклонение равно

0,25 мм, стандартами считаются детали, размер которых заключен между 199,5 мм и

200,5 мм. Из-за нарушения технологии точность изготовления деталей уменьшилась

и характеризуется средним квадратическим отклонением 0,4 мм. На сколько

повысился процент бракованных деталей?

Задача 19

Случайная

величина X~N(1,22). Найти P{2

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 20

Заряд пороха для охотничьего ружья

должен составлять 2,3 г. Заряд отвешивается на весах, имеющих ошибку

взвешивания, распределенную по нормальному закону со средним квадратическим

отклонением, равным 0,2 г. Определить вероятность повреждения ружья, если максимально

допустимый вес заряда составляет 2,8 г.

Задача 21

Заряд

охотничьего пороха отвешивается на весах, имеющих среднеквадратическую ошибку

взвешивания 150 мг. Номинальный вес порохового заряда 2,3 г. Определить

вероятность повреждения ружья, если максимально допустимый вес порохового

заряда 2,5 г.

Задача 21

Найти

вероятность попадания снарядов в интервал (α1=10.7; α2=11.2).

Если случайная величина X распределена по

нормальному закону с параметрами m=11;

σ=0.2.

Задача 22

Плотность

вероятности распределения случайной величины имеет вид

Найти

вероятность того, что из 3 независимых случайных величин, распределенных по

данному закону, 3 окажутся на интервале (-∞;5).

Задача 23

Непрерывная

случайная величина имеет нормальное распределение. Её математическое ожидание

равно 12, среднее квадратичное отклонение равно 2. Найти вероятность того, что

в результате испытания случайная величина примет значение в интервале (8,14)

Задача 24

Вероятность

попадания нормально распределенной случайной величины с математическим

ожиданием m=4 в интервал (3;5) равна 0,6. Найти дисперсию данной случайной

величины.

Задача 25

В

нормально распределенной совокупности 17% значений случайной величины X

меньше 13% и 47% значений случайной величины X

больше 19%. Найти параметры этой совокупности.

Задача 26

Студенты

мужского пола образовательного учреждения были обследованы на предмет

физических характеристик и обнаружили, что средний рост составляет 182 см, со

стандартным отклонением 6 см. Предполагая нормальное распределение для роста,

найдите вероятность того, что конкретный студент-мужчина имеет рост более 185

см.

| Нормальное распределение | |

|---|---|

Зеленая линия соответствует стандартному нормальному распределениюПлотность вероятности |

|

Цвета на этом графике соответствуют графику наверхуФункция распределения |

|

| Обозначение |

|

| Параметры |

μ — коэффициент сдвига (вещественный) σ > 0 — коэффициент масштаба (вещественный, строго положительный) |

| Носитель |

|

| Плотность вероятности |

|

| Функция распределения |

![{frac {1}{2}}left[1+operatorname {erf} left({frac {x-mu }{sqrt {2sigma ^{2}}}}right)right]](https://wikimedia.org/api/rest_v1/media/math/render/svg/04670b14acb4ddb796469f3812ead9d9cccec275) |

| Математическое ожидание |

|

| Медиана |

|

| Мода |

|

| Дисперсия |

|

| Коэффициент асимметрии |

|

| Коэффициент эксцесса |

|

| Дифференциальная энтропия |

|

| Производящая функция моментов |

|

| Характеристическая функция |

|

Норма́льное распределе́ние[1][2], также называемое распределением Гаусса или Гаусса — Лапласа[3], или колоколообразная кривая — непрерывное распределение вероятностей с пиком в центре и симметричными боковыми сторонами, которое в одномерном случае задаётся функцией плотности вероятности, совпадающей с функцией Гаусса:

,

- где параметр

— математическое ожидание (среднее значение), медиана и мода распределения, а параметр

— среднеквадратическое отклонение,

— дисперсия распределения.

Таким образом, одномерное нормальное распределение является двухпараметрическим семейством распределений, которое принадлежит экспоненциальному классу распределений[4]. Многомерный случай описан в статье «Многомерное нормальное распределение».

Стандартным нормальным распределением называется нормальное распределение с математическим ожиданием

Общие сведения[править | править код]

Если величина является суммой многих случайных слабо взаимозависимых величин, каждая из которых вносит малый вклад относительно общей суммы, то центрированное и нормированное распределение такой величины при достаточно большом числе слагаемых стремится к нормальному распределению.

Это следует из центральной предельной теоремы теории вероятностей. В окружающем нас мире часто встречаются величины, значение которых определяется совокупностью многих независимых факторов. Этот факт, а также то, что распределение считалось типичным, обычным, привели к тому, что в конце XIX века стал использоваться термин «нормальное распределение». Нормальное распределение играет заметную роль во многих областях науки, например в математической статистике и статистической физике.

Случайная величина, имеющая нормальное распределение, называется нормальной, или гауссовской, случайной величиной.

Определения[править | править код]

Стандартное нормальное распределение[править | править код]

Наиболее простой случай нормального распределения — стандартное нормальное распределение — частный случай, когда

Множитель

Гаусс называл стандартным нормальным распределение с

Нормальное распределение с параметрами μ, σ[править | править код]

Каждое нормальное распределение — это вариант стандартного нормального распределения, область значений которого растягивается множителем

Если

Если в экспоненте плотности вероятности раскрыть скобки и учитывать, что

Таким образом, плотность вероятности каждого нормального распределения представляет собой экспоненту квадратичной функции:

- где

Отсюда можно выразить среднее значение как

Обозначение[править | править код]

Плотность вероятности стандартного нормального распределения (с нулевым средним и единичной дисперсией) часто обозначается греческой буквой

Нормальное распределение часто обозначается

Функция распределения[править | править код]

Функция распределения стандартного нормального распределения (нормальное интегральное распределение) обычно обозначается заглавной греческой буквой

С ней связана функция ошибок (интеграл вероятности)

![{displaystyle [-x,x]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e23c41ff0bd6f01a0e27054c2b85819fcd08b762)

Эти интегралы не выражаются в элементарных функциях и называются специальными функциями. Многие их численные приближения известны. См. ниже.

Функции связаны, в частности, соотношением:

.

Нормальное распределение с плотностью

Можно использовать функцию

.

График стандартной нормальной функции распределения

Функция распределения стандартной нормальной случайной величины может быть разложена с помощью метода интегрирования по частям в ряд:

где знак

Асимптотическое разложение функции распределения для больших

Стандартное отклонение[править | править код]

Правило 68-95-99,7.

Для нормального распределения количество значений, отличающихся от среднего на число, меньшее чем одно стандартное отклонение, составляют 68,27 % выборок. В то же время количество значений, отличающиеся от среднего на два стандартных отклонения, составляют 95,45 %, а на три стандартных отклонения — 99,73 %.

Около 68 % значений из нормального распределения находятся на расстоянии не более одного стандартного отклонения σ от среднего; около 95 % значений лежат расстоянии не более двух стандартных отклонений; и 99,7 % не более трёх. Этот факт является частным случаем правила 3 сигм для нормальной выборки.

Более точно, вероятность получить нормальное число в интервале между

С точностью до 12 значащих цифр значения для

|

|

|

|

OEIS |

|---|---|---|---|---|

| 1 | 0,682689492137 | 0,317310507863 |

3,15148718753 |

A178647 |

| 2 | 0,954499736104 | 0,045500263896 |

21,9778945080 |

A110894 |

| 3 | 0,997300203937 | 0,002699796063 |

370,398347345 |

A270712 |

| 4 | 0,999936657516 | 0,000063342484 |

15787.1927673 |

|

| 5 | 0,999999426697 | 0,000000573303 |

1744277,89362 |

|

| 6 | 0,999999998027 | 0,000000001973 |

506797345,897 |

Свойства[править | править код]

Моменты[править | править код]

Моментами и абсолютными моментами случайной величины

Если

Здесь

Центральные абсолютные моменты для неотрицательных целых

Последняя формула справедлива также для произвольных

Преобразование Фурье и характеристическая функция[править | править код]

Преобразование Фурье нормальной плотности вероятности

- где

есть мнимая единица.

Если математическое ожидание

В теории вероятности, преобразование Фурье плотности распределения действительной случайной величины

Бесконечная делимость[править | править код]

Нормальное распределение является бесконечно делимым.

Если случайные величины

Отсюда вытекает, что нормальная случайная величина представима как сумма произвольного числа независимых нормальных случайных величин.

Максимальная энтропия[править | править код]

Нормальное распределение имеет максимальную дифференциальную энтропию среди всех непрерывных распределений, дисперсия которых не превышает заданную величину[11][12].

Правило трёх сигм для гауссовской случайной величины[править | править код]

График плотности вероятности нормального распределения и процент попадания случайной величины на отрезки, равные среднеквадратическому отклонению.

Правило трёх сигм (

- где

— математическое ожидание и параметр нормальной случайной величины.

Более точно — приблизительно с вероятностью 0,9973 значение нормально распределённой случайной величины лежит в указанном интервале.

Моделирование нормальных псевдослучайных величин[править | править код]

При компьютерном моделировании, особенно при применении метода Монте-Карло, желательно использовать величины, распределенные по нормальному закону. Многие алгоритмы дают стандартные нормальные величины, так как нормальную величину

- где Z — стандартная нормальная величина.

Алгоритмы также используют различные преобразования равномерных величин.

Простейшие приближённые методы моделирования основываются на центральной предельной теореме. Если сложить достаточно большое количество независимых одинаково распределённых величин с конечной дисперсией, то сумма будет иметь распределение, близкое к нормальному. Например, если сложить 100 независимых стандартно равномерно распределённых случайных величин, то распределение суммы будет приближённо нормальным.

Для программного генерирования нормально распределённых псевдослучайных величин предпочтительнее использовать преобразование Бокса — Мюллера. Оно позволяет генерировать одну нормально распределённую величину на базе одной равномерно распределённой.

Также существует алгоритм Зиккурат, который работает даже быстрее преобразования Бокса — Мюллера. Тем не менее, сложнее в реализации, но его применение оправдано в случаях, когда требуется генерирование очень большого числа неравномерно распределённых случайных чисел.

Нормальное распределение в природе и приложениях[править | править код]

Нормальное распределение часто встречается в природе. Например, следующие случайные величины хорошо моделируются нормальным распределением:

- отклонение при стрельбе;

- погрешности измерений (однако погрешности некоторых измерительных приборов имеют иное распределение);

- некоторые характеристики живых организмов в популяции.

Такое широкое распространение этого распределения связано с тем, что оно является бесконечно делимым непрерывным распределением с конечной дисперсией. Поэтому к нему в пределе приближаются некоторые другие, например биномиальное и пуассоновское. Этим распределением моделируются многие недетерминированные физические процессы[13].

Многомерное нормальное распределение используется при исследовании многомерных случайных величин (случайных векторов). Одним из многочисленных примеров таких приложений является исследование параметров личности человека в психологии и психиатрии.

Связь с другими распределениями[править | править код]

- Отношение квадратов двух стандартных нормальных случайных величин имеет распределение Фишера со степенями свободы

История[править | править код]

Впервые нормальное распределение как предел биномиального распределения при

См. также[править | править код]

- Аддитивный белый гауссовский шум

- Логнормальное распределение

- Равномерное распределение

- Центральная предельная теорема

- Двумерное нормальное распределение

- Многомерное нормальное распределение

- Распределение хи-квадрат

- Статистический критерий

- Частотное распределение

Примечания[править | править код]

- ↑ Вентцель Е. С. Теория вероятностей. — 10-е изд., стереотипное.. — М.: Academia, 2005. — 576 с. — ISBN 5-7695-2311-5.

- ↑ Ширяев А. Н. Вероятность. — М.: Наука, 1980.

- ↑ 1 2 Математический энциклопедический словарь. — М.: Советская энциклопедия, 1988. — С. 139—140.

- ↑ Wasserman L. All of Statistics. — New York, NY: Springer, 2004. — С. 142. — 433 с. — ISBN 978-1-4419-2322-6.

- ↑ Доказательство см. Гауссов интеграл

- ↑ Halperin, Hartley & Hoel, 1965, item 7.

- ↑ McPherson (1990)

- ↑ Wolfram|Alpha: Computational Knowledge Engine. Wolframalpha.com. Дата обращения: 3 марта 2017.

- ↑ Bryc (1995, p. 23)

- ↑ Bryc (1995, p. 24)

- ↑ Cover, Thomas M.; Thomas, Joy A. Elements of Information Theory. — John Wiley and Sons, 2006. — С. 254.

- ↑ Park, Sung Y.; Bera, Anil K. Maximum Entropy Autoregressive Conditional Heteroskedasticity Model (англ.) // Journal of Econometrics (англ.) (рус. : journal. — Elsevier, 2009. — P. 219—230. Архивировано 7 марта 2016 года.

- ↑ Талеб Н. Н. Чёрный лебедь. Под знаком непредсказуемости = The Black Swan: The Impact of the Highly Improbable. — КоЛибри, 2012. — 525 с. — ISBN 978-5-389-00573-0.

- ↑ Королюк, 1985, с. 135.

- ↑ Галкин В. М., Ерофеева Л. Н., Лещева С. В. Оценки параметра распределения Коши // Труды Нижегородского государственного технического университета им. Р. Е. Алексеева. — 2014. — № 2(104). — С. 314—319. — УДК 513.015.2(G).

- ↑ Lukacs, Eugene. A Characterization of the Normal Distribution (англ.) // The Annals of Mathematical Statistics (англ.) (рус. : journal. — 1942. — Vol. 13, no. 1. — P. 91—3. — ISSN 0003-4851. — doi:10.1214/aoms/1177731647. — JSTOR 2236166.

- ↑ Lehmann, E. L.ruen. Testing Statistical Hypotheses. — 2nd. — Springer (англ.) (рус., 1997. — С. 199. — ISBN 978-0-387-94919-2.

- ↑ The doctrine of chances; or, a method of calculating the probability of events in play, L., 1718, 1738, 1756; L., 1967 (репродуцир. изд.); Miscellanea analytica de scriebus et quadraturis, L., 1730.

Литература[править | править код]

- Королюк В. С., Портенко Н. И., Скороход А. В., Турбин А. Ф. Справочник по теории вероятностей и математической статистике. — М.: Наука, 1985. — 640 с.

- Halperin, Max; Hartley, Herman O.; Hoel, Paul G. Recommended Standards for Statistical Symbols and Notation. COPSS Committee on Symbols and Notation (англ.) // The American Statistician (англ.) (рус. : journal. — 1965. — Vol. 19, no. 3. — P. 12—14. — doi:10.2307/2681417. — JSTOR 2681417.

- McPherson, Glen. Statistics in Scientific Investigation: Its Basis, Application and Interpretation (англ.). — Springer-Verlag, 1990. — ISBN 978-0-387-97137-7.

- Bryc, Wlodzimierz. The Normal Distribution: Characterizations with Applications (англ.). — Springer-Verlag, 1995. — ISBN 978-0-387-97990-8.

Ссылки[править | править код]

- Таблица значений функции стандартного нормального распределения

- Онлайн расчёт вероятности нормального распределения

Правило трех сигм

Содержание:

- В чем заключается правило трех сигм (3-sigma rule) в статистике

- Нормальное распределение случайной величины

- Примеры решения задач

В чем заключается правило трех сигм (3-sigma rule) в статистике

Определение

Математическое ожидание — это среднее значение случайной величины. Обозначается как (mu).

Определение

Стандартное или среднеквадратичное отклонение — это наиболее частый показатель рассеивания значений величины относительно математического ожидания. Обозначается символом (sigma), который произносится как «сигма».

Определение

Правило трех сигм заключается в том, что при нормальном распределении практически все значения величины с вероятностью 0,9973 лежат не далее трех сигм в любую сторону от математического ожидания, то есть находятся в диапазоне (left[mu-3sigma;;mu+3sigmaright]).

Осторожно! Если преподаватель обнаружит плагиат в работе, не избежать крупных проблем (вплоть до отчисления). Если нет возможности написать самому, закажите тут.

Приблизительно 99,7% всех значений лежат в пределе трех сигм от математического ожидания, около 95% — в пределах двух сигм, а примерно 68% значений лежат в пределах всего одной сигмы.

Те значения, которые выходят за рамки 3 сигм, принято считать грубыми ошибками. Большое количество таких ошибок может свидетельствовать о том, что распределение на самом деле не является нормальным. В этом заключается практическая польза правила 3 сигм.

Нормальное распределение случайной величины

Определение

Нормальное распределение (распределение Гаусса) — это такое распределение вероятностей, функция плотности которого совпадает с функцией Гаусса.

(fleft(xright)=frac1{sigmasqrt{2pi}}expleft(-frac{left(x-muright)^2}{2sigma^2}right))

где (mu) — значение математического ожидания, (sigma) – величина среднеквадратического отклонения, (sigma^2) — дисперсия распределения.

Определение

Функция плотности — это функция, которая характеризует сравнительную вероятность реализации определенных значений случайной переменной или переменных.

Иными словами, функция плотности показывает, с какой вероятностью случайное значение будет равно заданному. Чем «выше» значение по оси ординат, тем больше вероятность, что случайное значение будет равно данному по оси абсцисс. Таким образом, на графике нормального распределения наиболее вероятно то значение, которое совпадает с точкой максимума. А те значения, которые находятся в «основании» графика, то есть находятся низко по оси Y, менее вероятны.

Нормальное распределение величины центрировано и нормировано.

График нормального распределения тесно связан с центральной предельной теоремой (ЦПТ). Согласно ЦПТ, сумма достаточно большого количества слабо зависимых случайных величин имеет распределение, близкое к нормальному.

Пример

Нормальное распределение не является абстрактным понятием. Ему соответствуют некоторые характеристики живых организмов в популяции, отклонение от мишени при стрельбе, измерения и их погрешности. Во всех этих случаях наиболее распространена группа близких значений, но есть отклонения как в большую, так и в меньшую сторону.

Примеры решения задач

Рассмотрим несколько простых задач на применение правила 3 сигм.

Задача 1

Имеется выборка жителей богатого дома. Средняя зарплата жильцов составляет 150 000 рублей, среднеквадратичное отклонение равно 20 000 рублей. Определите, жители с какой зарплатой вряд ли могут жить в этом доме: А) 205 000 рублей; Б) 95 000; В) 230 000; Г) 87 000.

Решение

Чтобы решить данную задачу, необходимо определить, каковы верхние и нижние границы возможных зарплат в доме. Для этого воспользуемся правилом 3 сигм.

(s_{нижн.}=mu-3sigma=150;000-3cdot20;000=150;000-60;000=90;000)

(s_{верх.}=mu+3sigma=150;000+3cdot20;000=150;000+60;000=210;000)

Значения А, Б входят в диапазон (left[90;000;;210;000right]). Значения В, Г не входят в него и, следовательно, являются искомыми грубыми ошибками.

Ответ: В, Г.

Задача 2

Завод выпускает партии по 100 цилиндрических деталей. Диаметр каждой детали — случайная величина, распределенная по нормальному закону. Математическое ожидание равно 65 мм, а среднее отклонение составляет 0,9 мм. Для упаковки партии используют коробки шириной 6600 мм. Детали кладут в один ряд. Если детали не поместятся в одну коробку, придется брать еще одну. Найдите вероятность, что понадобится только одна коробка.

Решение

Т. к. диаметр каждой детали распределен нормально, то и их общий диаметр также будет распределен нормально.

Чтобы все детали поместились в одну коробку, необходимо, чтобы отклонение диаметра всех деталей отклонялось от ожидаемого не более чем на 100 мм. Это следует из того, что математическое ожидание общего диаметра всех деталей равно (65cdot100=6500). А ширина коробки составляет 6600 мм.

Для расчета воспользуемся формулами дисперсии и правилом 3 сигм, чтобы вычислить вероятность, что понадобится только одна коробка.

(Pleft|X-M(X)right|<100;Rightarrow2Phileft[frac{100}{100sigma}right]=2Phileft[1,111right]=2cdot0,3665=0,733)

Ответ: 0,733

Нормально разбираемся в Нормальном распределении

Уровень сложности

Средний

Время на прочтение

6 мин

Количество просмотров 11K

Всем привет. Это пост про интуитивное понимание Нормального распределения.

Обычный курс теории вероятностей проходит следующим образом. Сначала вам даются понятные и относительно простые концепции. Все легко объясняется “на пальцах”: подбрасывание монеток, красные и белые шары в урнах, кролики в клетках и так далее.

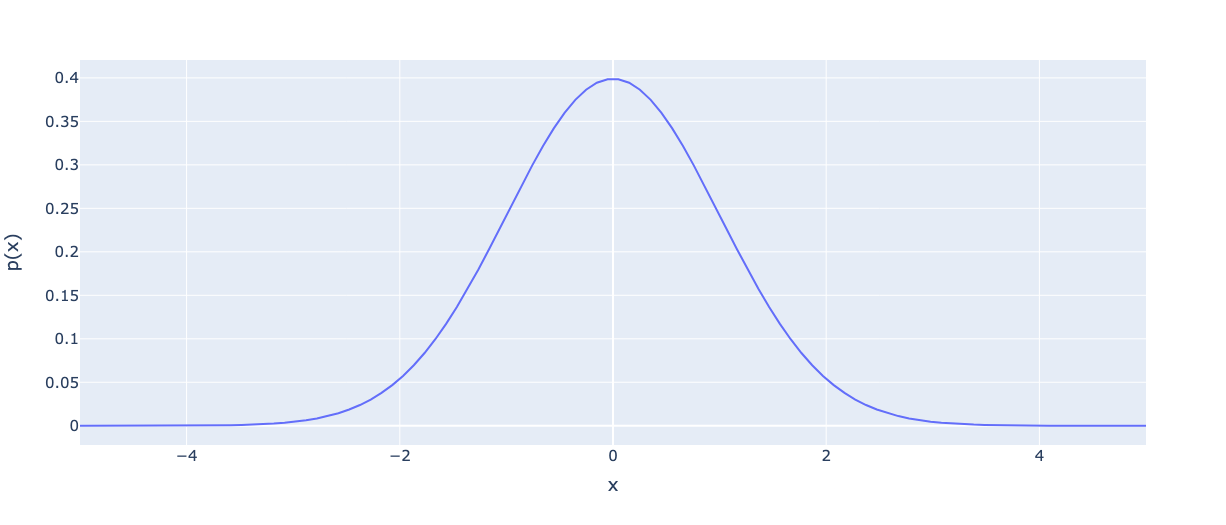

Но в следующей теме вас бросают в яму к этому монстру:

Внезапно больше нет ни монет, ни урн, ни шаров. Вам только говорят запомнить эту функцию плотности вероятности Нормального распределения, что это очень важно и что график похож на колокол. В остальном вы предоставлены сами себе.

Но что это такое? Почему там экспонента? Почему минус? Зачем делить на 2 сигма-квадрат? Откуда взялось число Пи? Куда делись монеты, шары, урны и кролики? Почему мы от интуитивных объяснений перешли к тупому запоминанию?

Каждая формула несет некоторую идею. В этом посте мы будем препарировать нормальное распределение, пока не поймем, что оно в себе несет. В конце мы выведем функцию плотности вероятности, чтобы понять, откуда она берется.

Я покажу, что, несмотря на пугающий вид, Нормальное распределение это не конь в вакууме. Это все еще про броски монеток, урны и другие вещи из реального мира.

Самореклама

Эта статья является переводом моей статьи из Substack Understanding the Normal Distribution for Real. Переходите туда если вам удобнее читать на английском или хочется получать такой контент по почте.

Так же у меня есть телеграм канал @boris_again

Препарируем монстра

Начнем изнутри. Разберемся в идеях, стоящих за этим куском:

Режем монстра на части.

Где это среднее, один из параметров распределения.

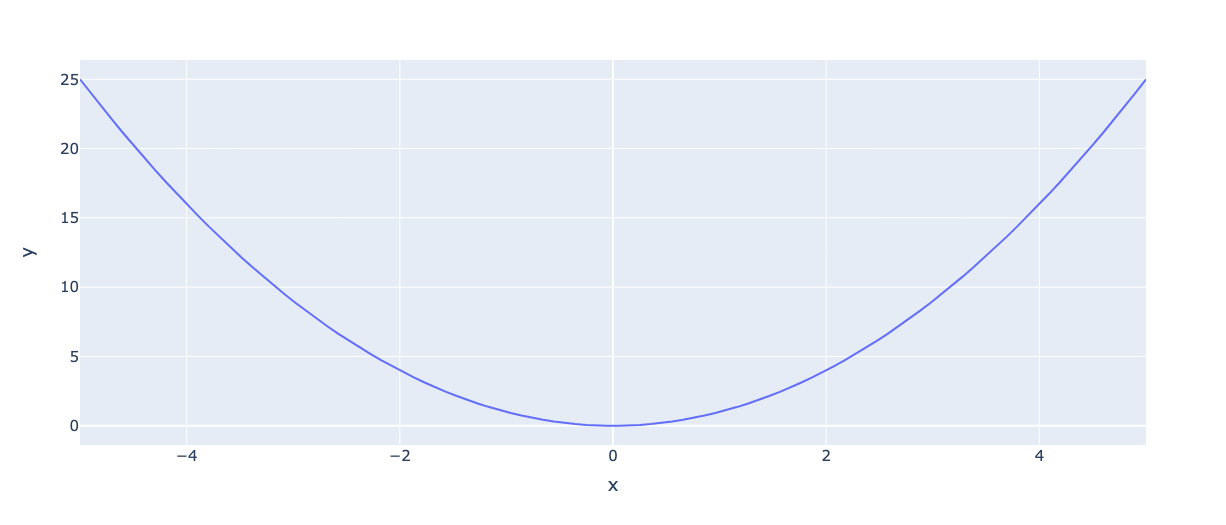

Посмотрим на график функции при

:

Мы видим параболу. Она похожа на форму колокола, но перевернутую. Также заметьте, что ось произвольна, а не находится в диапазоне

, так что это пока не распределение.

Обратите внимание, что чем дальше от среднего значения, тем больше значение функции. Во-вторых, квадрат позволяет нам одинаково относиться к отрицательным и положительным значениям. Он делает форму колокола симметричной.

Идея: определяет местоположение вершины колокола, и распределение становится симметричным.

Наконец-то, форма колокола! Но значения y отрицательны. Естественно у нас не может быть отрицательных вероятностей.

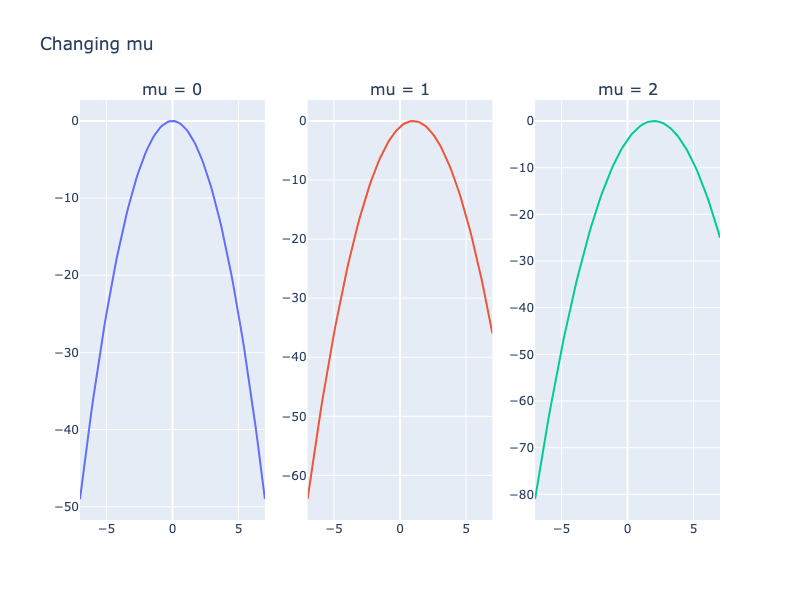

Что будет если менять ?

Вывод: Изменение перемещает пик колокола в другое место.

Добавим следующий кусок, деление на сигма квадрат:

Здесь сигма — это второй параметр распределения: стандартное отклонение. Квадрат сигмы — это дисперсия. Что это дает нашему распределению?

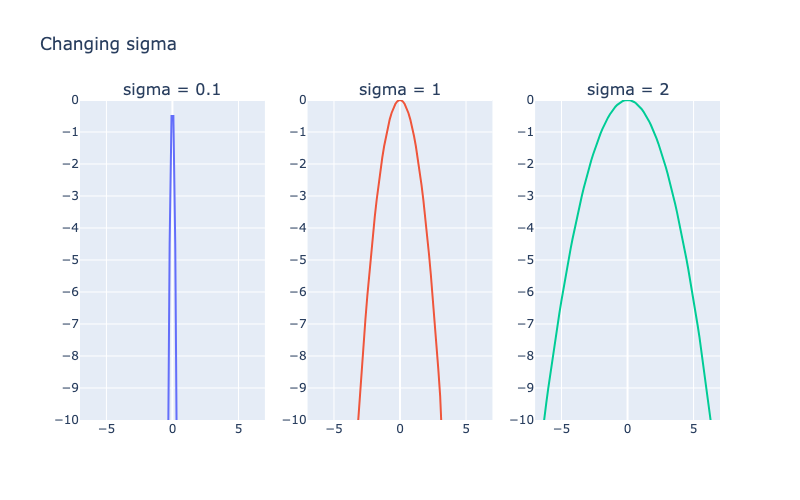

Попробуем поменять ее:

Идея: знаменатель с сигмой задает скорость изменения значения функции по мере удаления от среднего. Меньшие сигмы создают более узкие колоколообразные формы.

Мы можем рассматривать сигму как меру неопределенности. Малые сигмы указывают на то, что среднее значение более вероятно. Большие сигмы распределяют вероятность по более широкому диапазону.

Сигма возводится в квадрат, чтобы показать: неопределенность возрастает квадратично (быстро), а не линейно (медленно). Другими словами, небольшая вариация данных сильно меняет колоколообразную кривую.

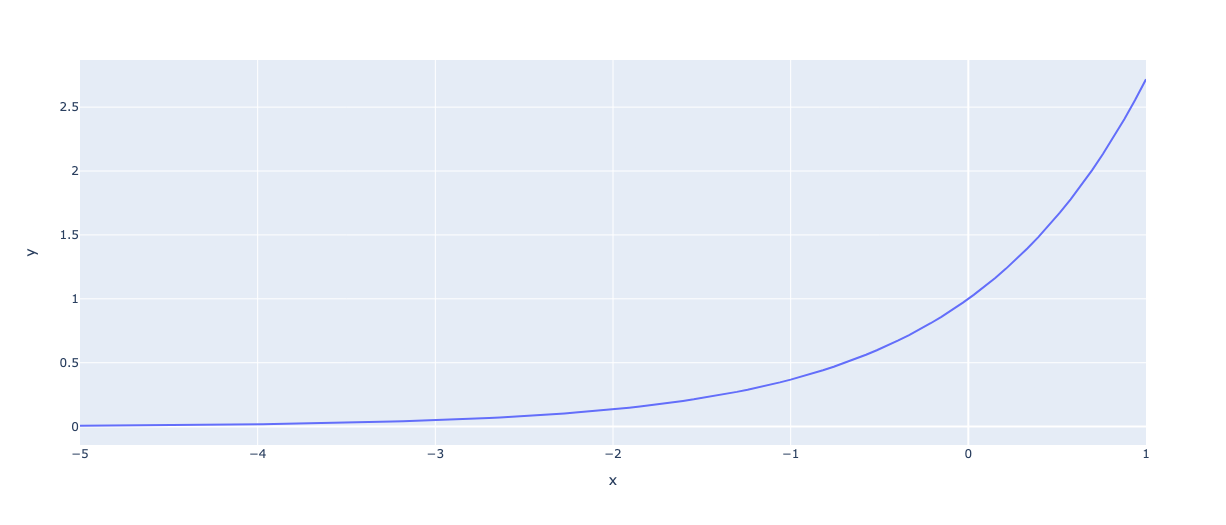

Отлично, у нас есть колоколообразная кривая. Но она не похожа на распределение вероятностей. Чтобы это было распределение, выходы должны находиться в пределах и в сумме равняться 1. Вот здесь и появляется экспонента.

Давайте построим на график около нуля:

Обратите внимание: экспонента отображает любой отрицательный вход в значение между 0 и 1. В нашем случае аргумент всегда отрицательный.

Отлично! Теперь все значения находятся между , и у нас получилась нужная нам колоколообразная кривая. Мы закончили.

На самом деле нет. Это прекрасная колоколообразная кривая, но в сумме значения не равны 1. Один только пик почти равен 1.

Как сделать так, чтобы сумма была равна 1? Нормализовать!

Как бы вы нормализовали такую последовательность чисел, как: ? Легко: разделить на сумму.

В нашем случае функция — это не просто последовательность чисел. Она непрерывна. Тем не менее, идея та же. Чтобы получить сумму давайте проинтегрируем:

Теперь, когда у нас есть сумма, давайте разделим функцию на нее:

Наконец, мы собрали все части, чтобы получить нормальное распределение.

Если вм нужны подробности вычисления интеграла, то я рекомендую это видео:

Связь с Биномиальным распределением

Нормальное распределение тесно связано с биномиальным. Давайте отвлечемся и рассмотрим биномиальное распределение поближе. Это поможет нам получить полное представление о нормальном распределении.

Представьте, что у вас есть Substack рассылка, и вы собираетесь запустить рекламную кампанию, нацеленную на 100 человек. Вы знаете свою конверсию в подписку: 10%. Какова вероятность того, что подпишутся ровно 5 человек?

Давайте представим каждого пользователя в виде броска монеты. Он либо регистрируются с вероятностью , либо нет. Это может быть описано распределением Bernoulli(n, p), которое имеет следующую функцию массы вероятности:

Идея: это бросок монеты, есть два возможных исхода, и с вероятностью выпадает орел.

Это распределение позволяет отвечать на вопросы типа “Какова вероятность выпадения орла для этой монеты?” или, более практично, “Какова вероятность того, что пользователь подпишется?”.

Мы можем сложить несколько случайных величин Бернулли и получить Биномиальное распределение . Оно говорит нам о вероятности получения

успехов из

независимых испытаний Бернулли с вероятностью

.

Биномиальное распределение объединяет все независимые испытания, чтобы ответить на новые вопросы: “Какова вероятность выпадения 3 орлов из 3 бросков?” или “Сколько пользователей мы можем ожидать при регистрации?”

Вот PMF Биномиального распределения:

Где это Биномиальный коэффициент.

Биномиальный коэффициент используется для того, чтобы учесть множество способов регистрации человек. Например, при наличии четырех посетителей существует шесть способов зарегистрироваться двум из них.

Давайте подставим наши значения, чтобы найти вероятность того, что зарегистрируются ровно пять человек:

Ожидаемое количество подписчиков среди 5 пользователей равно просто умноженное на

, то есть 3.387. Мы также можем получить вероятность регистрации хотя бы 5 подписчиков, просуммировав по

и получим 0.94242.

Теперь давайте посмотрим, что происходит по мере роста числа испытаний.

Обратите внимание: с ростом результирующая PMF приближается к знакомой колоколообразной форме Нормального распределения.

Оказывается, что Нормальное распределение является предельным случаем биномиального распределения. Биномиальное распределение отвечает на вопрос: “Насколько вероятно получить k орлов из n бросков монеты?” Нормальное распределение имеет ту же идею, но дает приблизительный результат.

Нас интересует это приближение, потому что вычисление коэффициентов биномиального распределения для больших значений требует огромных вычислительных затрат. Факториалы в формуле являются самой большой проблемой. Например, для биномиальный коэффициент равен 75287520. Это очень дорогое вычисление, особенно если вам нужно суммировать по многим

.

Вместо вычисления биномиальной PMF мы можем аппроксимировать его вычислением PDF нормального распределения. Это гораздо быстрее: нужно только подставить несколько чисел в формулу. Этот подход часто используется в опросах.

Основная идея нормального распределения: число успехов в большом количестве независимых испытаний типа “да или нет” распределено симметрично вокруг среднего значения, а форма распределения описывается функцией Гаусса.

Надеюсь, теперь PMF нормального распределения больше не является просто страшной формулой в вакууме. Она по-прежнему связана с подбрасыванием монет и реальной жизнью, как и Биномиальное распределение

Выводим Нормальное распределение

Почему именно такая функция позволяет нам аппроксимировать Биномиальное распределение? Чтобы ответить на этот вопрос, нам нужно будет вывести PMF нормального распределения. Есть несколько способов сделать это, но мы будем использовать наши знания о том, что нормальное распределение является предельным случаем биномиального распределения. Я опишу только основные шаги, так как детали вывода довольно длинные, но вы можете найти полный вывод в этой статье.

Нормальное распределение является предельным случаем Биномиального, если не очень мало, и выполняется условие:

Если это не так, мы получаем распределение Пуассона, что тоже круто, но выходит за рамки этого поста.

Помните биномиальный PMF? Предположим, у нас есть последовательность испытаний Бернулли, каждое с вероятностью успеха , и мы повторяем этот эксперимент

раз. Пусть

— количество успехов в n испытаниях. Тогда

имеет биномиальное распределение с параметрами

. Функция массы вероятности

определяется как:

Самая тяжелая часть — факториал. Давайте воспользуемся приближением Cтирлинга, чтобы вычислить факториалы быстрее:

Подставив это в Биномиальный коэффициент мы получаем:

Это может выглядеть пугающе, но на самом деле это просто замена и некоторая перестановка терминов.

Подставляя это приближение в PMF Биномиального распределения, мы получаем:

Это функция плотности вероятности нормального распределения при , и квадратом

:

Вывод: гауссиана появляется, когда мы заменяем вычисления факториалов в биномиальном приближении.

Завершение

Мы разобрали нормальное распределение на его компоненты, исследовали связь между биномиальным и нормальным распределением и, наконец, получили нормальную PDF. Надеюсь, теперь для вас это не столько таинственный монстр, сколько прекрасный способ описания явлений реального мира.

Код для графиков вы можете найти в этом коллабе.

Спасибо за внимание! Если вам нравится такой контент, то подписывайтесь на мой телеграм канал @boris_again и substack.

-

Нормальное распределение.

График

дифференциальной функции нормального

распределения называют нормальной

кривой (кривой Гаусса).

а

– соответствует мат. ожиданию

σ

– среднее квадратическое отклонение

Исследуем

функцию методами дифференциального

исчисления.

-

D=R

– функция определена на всей оси х. -

нормальная

кривая расположена над осью х. -

– ось

х служит горизонтальной асимптотой

графика. -

.

y’=0

при x=a,

y’>0

при x<a,

y’<0

при x>a.

При x=a

функция имеет максимум, равный

. -

Разность

х-а содержится в аналитическом выражении

функции в квадрате, то есть график

функции симметричен относительно

прямой х=а. -

.

При х=а+σ и х=а-σ

,

а при переходе через эти точки она

меняет знак.

Точки

перегиба:

.

Нормальная

кривая сдвигается вправо, если параметр

а

возрастает и влево, если а

убывает. Чем больше σ,

тем кривая более сжимается к оси х, и

наоборот.

Вероятность

попадания в заданный интервал нормальной

случайной величины.

Свойства

Функции Лапласа:

Вероятность

попадания случайной величины,

распределённой по нормальному закону:

-

Правило «трёх сигма».

Преобразуем

формулу

положив

.

В итоге получим:

Если

t=3

и, следовательно,

,

то

То

есть вероятность того, что абсолютная

величина отклонения превысит утроенное

среднее квадратической отклонение,

очень мала. Такое событие можно считать

невозможным.

Правило

трёх сигм:

Если случайная величина распределена

нормально, то абсолютная величина её

отклонения от математического ожидания

не превосходит утроенного среднего

квадратического отклонения.

-

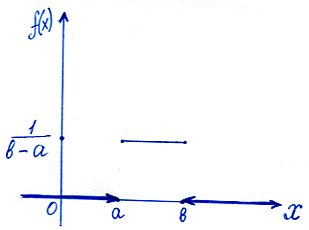

Равномерное распределение.

Распределение

вероятностей называют равномерным,

если на интервале, которому принадлежат

все возможные значения случайной

величины, дифференциальная функция

имеет постоянное значение.

Найдём

дифференциальную функцию равномерного

распределения, считая, что все возможные

значения случайной величины заключены

в интервале (a,

b),

на котором дифференциальная функция

сохраняет постоянное значение

.

при

Найдём

значение С.

-

Закон Пуассона.

Рассмотрим

дискретную случайную величину Х, которая

может принимать только целые, не

отрицательные значения. Говорят, что

случайная величина Х распределена по

закону Пуассона, если вероятность того,

что она примет определенное значение

m,

выражается формулой:

Где

а

– некоторая положительная величина,

называемая параметром Пуассона.

Ряд

распределения случайной величины X,

распределённой по закону Пуассона,

имеет вид:

|

Хm |

0 |

1 |

2 |

… |

m |

… |

|

Pm |

|

|

|

… |

|

… |

Убедимся,

что сумма всех вероятностей

равна 1.

По

определению математического ожидания:

Для

определения дисперсии найдём второй

начальный момент Х:

Находим

дисперсию:

Равенство

мат. ожидания и дисперсии применяется

на практике для решения вопроса,

правдоподобия гипотезы о том, что

случайная величина Х распределена по

закону Пуассона.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

![{displaystyle F(x)=Phi left({frac {x-mu }{sigma }}right)={frac {1}{2}}left[1+operatorname {erf} left({frac {x-mu }{sigma {sqrt {2}}}}right)right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6a75caa2df3861960f6c6a5ac91f0b0fa6d79504)

![{displaystyle Phi (x)={frac {1}{2}}+{frac {1}{sqrt {2pi }}}cdot e^{-x^{2}/2}left[x+{frac {x^{3}}{3}}+{frac {x^{5}}{3cdot 5}}+cdots +{frac {x^{2n+1}}{(2n+1)!!}}+cdots right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b755fcac449fe404b290943b01b01eab9c50440a)

![{displaystyle mathbb {E} left[X^{p}right]={begin{cases}0&p=2n+1,\sigma ^{p},left(p-1right)!!&p=2n.end{cases}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c39f9a1d5eadfbc872b3cd41f8135576e3123bc4)

![{displaystyle mathbb {E} left[left|Xright|^{p}right]=sigma ^{p},left(p-1right)!!cdot left.{begin{cases}{sqrt {frac {2}{pi }}}&p=2n+1,\1&p=2n.end{cases}}right}=sigma ^{p}cdot {frac {2^{frac {p}{2}}Gamma left({frac {p+1}{2}}right)}{sqrt {pi }}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c45215d47f1e0fc958abfae9a8d7137995cf90a8)

![{displaystyle t={frac {{overline {X}}-mu }{S/{sqrt {n}}}}={frac {{frac {1}{n}}(X_{1}+cdots +X_{n})-mu }{sqrt {{frac {1}{n(n-1)}}left[(X_{1}-{overline {X}})^{2}+cdots +(X_{n}-{overline {X}})^{2}right]}}}sim t_{n-1}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/36ff0d3c79a0504e8f259ef99192b825357914d7)