Тригонометрические функции от матрицы — обобщения тригонометрических функций для квадратных матриц.

Тригонометрические функции (особенно часто синус и косинус) от квадратных матриц возникают в решениях систем дифференциальных уравнений второго порядка.[1] Они определяются через те же ряды Тейлора, через которые определяются тригонометрические функции от вещественного или комплексного аргумента:[2]

где Xn означает матрицу X в степени n, а I — единичную матрицу той же размерности.

Также тригонометрические функции матричного аргумента могут быть определены через матричную экспоненту с учётом матричного аналога формулы Эйлера eiX = cos X + i sin X:

Например, пусть X — стандартная матрица Паули:

Тогда

Можно вычислить и кардинальный синус:

Свойства[править | править код]

Справедлив матричный аналог основного тригонометрического тождества:[2]

Если X является диагональной матрицей, sin X и cos X также являются диагональными матрицами, причём (sin X)nn = sin(Xnn) и (cos X)nn = cos(Xnn), то есть синус и косинус диагональной матрицы могут быть вычислены путём вычисления соответственно синусов и косинусов элементов аргумента на главной диагонали.

Матричные аналоги формул синуса и косинуса суммы справедливы тогда и только тогда, когда матрицы коммутируют, то есть XY = YX:[2]

Другие функции[править | править код]

Тангенс, обратные тригонометрические функции, гиперболические функции и обратные гиперболические функции так же могут быть определены и для матриц:[3]

(см. Обратные тригонометрические функции#Связь с натуральным логарифмом, Матричный логарифм?!, Квадратный корень из матрицы)

и так далее.

Примечания[править | править код]

- ↑ Gareth I. Hargreaves, Nicholas J. Higham. Efficient Algorithms for the Matrix Cosine and Sine (англ.) // Numerical Analysis Report : journal. — Manchester Centre for Computational Mathematics, 2005. — No. 461.

- ↑ 1 2 3 Nicholas J. Higham. Functions of matrices: theory and computation (англ.). — 2008. — P. 287f. — ISBN 9780898717778.

- ↑ Scilab trigonometry Архивная копия от 9 июля 2017 на Wayback Machine.

Содержание

Функция от матрицы

В настоящем разделе матрица $ A_{} $ считается квадратной порядка $ n_{} $.

Полином от матрицы

Сначала оптимизируем вычисление степени матрицы.

П

Пример 1. Вычислить

$$

A^{100} quad npu quad

A=left(

begin{array}{rrrr}

1 &2 &1 &0 \

1 & 1 & 0 &-1 \

-2& 0 & 1 & 2 \

0 & 2 & 1 & 1

end{array}

right)^{100} .

$$

Решение. Можно организовать вычисление $ A^{100} $ по алгоритму квадрирования-умножения, заимствованному из раздела “MОДУЛЯРНАЯ АРИФМЕТИКА”:

$$ A^{100}=left( left( left( left( left( left( A right)^2 A right)^2 right)^2 right)^2 Aright)^2 right)^2 . $$

Имеем: $ underline{100}_{_{10}}=underline{1100100}_{_2} $

$$

begin{array}{|c|c|c|c|c|}

hline

j & 1 & 2 & 3 & 4 \

hline

{mathfrak b}_j & 1 & 1 & 0 & 0 \

hline

& A & A^2 A & left(A^3 right)^2 & left(A^6 right)^2 \

&

left(

begin{array}{rrrr}

1 &2 &1 &0 \

1 & 1 & 0 &-1 \

-2& 0 & 1 & 2 \

0 & 2 & 1 & 1

end{array}

right)

&

left(

begin{array}{rrrr}

1 &6 & 3 &0 \

3& 1 & 0 &-3 \

-6& 0 & 1 & 6 \

0 & 6 & 3 & 1

end{array}

right)

&

left(

begin{array}{rrrr}

1 & 12 & 6 &0 \

6 & 1 & 0 &-6 \

-12& 0 & 1 & 12 \

0 & 12 & 6 & 1

end{array}

right)

&

left(

begin{array}{rrrr}

1 & 24 & 12 &0 \

12 & 1 & 0 &-12 \

-24& 0 & 1 & 24 \

0 & 24 & 12 & 1

end{array}

right)

\

hline

end{array}

$$

$$

begin{array}{|c|c|c|}

hline

5 &6 &7 \

hline

1 &0 & 0 \

hline

left(A^{12} right)^2 A &

left(A^{25} right)^2&

left(A^{50} right)^2 \

left(

begin{array}{rrrr}

1 & 50 & 25 &0 \

25 & 1 & 0 &-25 \

-50& 0 & 1 & 50 \

0 & 50 & 25 & 1

end{array}

right)

&

left(

begin{array}{rrrr}

1 & 100 & 50 &0 \

50 & 1 & 0 &-50 \

-100& 0 & 1 & 100 \

0 & 100 & 50 & 1

end{array}

right)

&

left(

begin{array}{rrrr}

1 & 200 & 100 &0 \

100 & 1 & 0 &-100 \

-200& 0 & 1 & 200 \

0 & 200 & 100 & 1

end{array}

right)

\

hline

end{array}

$$

♦

Рассмотрим далее произвольный полином $ g(x)=b_0x^m+b_1x^{m-1}+dots+b_m in mathbb C[x] $.

Вычисление его значения от матрицы $ A_{} $, т.е.

$$ g(A)=b_0A^m +b_1A^{m-1}+dots+b_m E , $$

где $ E_{} $ — единичная матрица того же порядка, что и $ A_{} $, может быть произведено с помощью

схемы Хорнера — чтобы сэкономить на операции умножения матриц.

П

Пример 2. Вычислить $ g(A)_{} $ для

$$ g(x)= 3,x^4-x^3+2,x^2-4,x-1 quad u quad

A=left( begin{array}{rrr}

1 & -3 & 4 \

3& 1 &8 \

-4 & -8 & 1

end{array}

right) .

$$

Решение. Схему Хорнера организуем по тому же принципу, что и для вычисления значения полинома в точке:

$$

g(A)=(((3,A-E)A+2,E)A-4,E)A-E .

$$

$$

B_1 = 3A-E =

left( begin{array}{rrr}

2 & -9 & 12 \

9& 2 & 24 \

-12 & -24 & 2

end{array}

right) ;

$$

$$

B_2=B_1A+2E=

left( begin{array}{rrr}

-71 & -111 & -52 \

-81& -215 & 76 \

-92 & -4 & -236

end{array}

right) ;

$$

$$

B_3=B_2A-4E=

left( begin{array}{rrr}

-200 & 518 & -1224 \

-1030& -584 & -1968 \

840 & 2160 & -640

end{array}

right) ;

$$

$$

g(A)=B_4=B_3A-E=

left( begin{array}{rrr}

6249 & 10910 & 2120 \

5090& 18249 & -10760 \

9880 & 4760 & 19999

end{array}

right)

$$

♦

Применение теоремы Гамильтона-Кэли

Дальнейшие упрощения возможны в случае, когда $ deg g ge n $, т.е. когда степень полинома становится больше или равной порядка матрицы. Предположим, что мы в состоянии вычислить характеристический полином матрицы $ A_{} $:

$$ f(x)=det (A-x E) , . $$

Т

Теорема 1. Обозначим $ g_1(x) $ остаток от деления $ g_{}(x) $ на характеристический полином $ f(x)=det (A – x E) $. Тогда

$$ g(A)= g_1(A) .$$

Доказательство. Действительно, указанное равенство последует из теоремы Гамильтона-Кэли при подстановке матрицы $ A_{} $ в

формулу

$$

g(x)equiv f(x)q(x)+g_1(x) , deg g_1 < n

$$

здесь $ q_{}(x) $ означает частное от деления $ g(x_{}) $ на $ f(x_{}) $.

♦

Эта теорема позволяет свести вычисление $ g({mathbf A}) $ к случаю полинома степени меньшей порядка матрицы. Это соображение существенно упрощает поставленную задачу, но при этом возникает другая: как вычислить остаток от деления если делимое существенно превосходит делитель по степени? Посмотрим, как этот подход будет выглядеть для примера 1.

П

Пример 3. Вычислить

$$

A^{100} quad npu quad

A=left(

begin{array}{rrrr}

1 &2 &1 &0 \

1 & 1 & 0 &-1 \

-2& 0 & 1 & 2 \

0 & 2 & 1 & 1

end{array}

right)^{100} .

$$

Решение. Здесь

$$det (A- x E) = x^4-4,x^3+6, x^2 – 4, x +1 . $$

Деление полинома $ g(x)equiv x^{100} $ на характеристический полином, организованное традиционным способом (т.е. “в столбик” ) дает в остатке полином

$$ g_1(x)=161700,x^3-480150,x^2+475300,x-156849 ; $$

при этом частное $ q_{}(x) $ является полиномом $ 96 $-й степени. Для вычислений обоих полиномов приходится использовать специализированный пакет компьютерной алгебры. Вычисление $ g_1(A) $ уже может быть произведено «вручную», например, с использованием схемы Хорнера.

♦

Заметим, что собственно частное от деления полинома $ g_{}(x) $ на характеристический полином не участвует в последующих вычислениях полинома от матрицы — для этого нужны только коэффициенты остатка. Можно ли изобрести обходной способ вычисления остатка, который не требует промежуточного вычисления частного? — Оказывается, можно.

Предположим, что мы в состоянии найти корни характеристического полинома $ f(x)=det (A-x E) $, т.е. собственные числа матрицы $ A_{} $. Предположим сначала, что все эти корни $ lambda_1,dots,lambda_n $ различны. Подставим их в тождество для определения частного и остатка:

$$

g(x)equiv f(x)q(x)+g_1(x) , .

$$

Поскольку $ f(lambda_j)=0 $ при $ jin {1,dots,n} $, получаем равенства

$$ {g(lambda_j) = g_1(lambda_j)}_{j=1}^n , . $$

Полином $ g_1(x) $ имеет степень меньшую $ n_{} $, а его значения совпадают со значениями полинома $ g(x) $ в $ n_{} $ точках. Такой полином определяется однозначно — как интерполяционный полином, построенный по таблице значений

$$

begin{array}{c|ccccc}

x & lambda_1 & lambda_2 & dots & lambda_n \ hline

y & g(lambda_1) & g(lambda_2) &dots & g(lambda_n)

end{array}

$$

Для его вычислений можно использовать любой из методов, изложенных в разделе “ИНТЕРПОЛЯЦИЯ”. Предпочтение отдается методу Лагранжа:

$$

g_1(x) equiv

sum_{k=1}^n frac{g(lambda_k)}{f_k(lambda_k)}f_k(x)

= sum_{k=1}^n frac{g(lambda_k)}{f'(lambda_k)}f_k(x)

$$

где $ f_{k}(x) $ означает частное от деления характеристического полинома на его линейный множитель:

$$

f_k(x)equiv frac{f(x)}{x-lambda_k}

equiv (x-lambda_1)times dots times (x-lambda_{k-1})

(x-lambda_{k+1})times dots times (x-lambda_{n})

, .

$$

Т

Теорема 2. Если все собственные числа $ lambda_{1},dots,lambda_n $

матрицы $ A_{} $ различны, то

$$

g(A)= sum_{k=1}^n frac{g(lambda_k)}{f_k(lambda_k)}f_k(A)

= sum_{k=1}^n frac{g(lambda_k)}{f'(lambda_k)}f_k(A)

$$

где $ f_k(x) $ означает частное от деления $ f_{}(x) $ на $ x- lambda_k $.

Каждое из суммируемых выражений в формуле можно представить в виде двух

сомножителей:

один из них зависит от полинома $ g_{}(x) $, а второй — не зависит. Таким образом,

при изменении полинома происходит лишь пересчет значений

$ g(lambda_1),dots, g(lambda_n) $, а их матричные сомножители не меняются.

Структура этих последних уже была нами установлена в пункте

☞

СОБСТВЕННЫЙ ВЕКТОР: каждая

матрица $ f_k(A) $ — ранга $ 1 $, т.е. имеет свои столбцы пропорциональными (и равными собственным векторам, принадлежащим $ lambda_{k} $).

П

Пример 4. Выписать формулу $ g(A)_{} $ для произвольного

$ g(x)in mathbb C[x] $ и

$$

A=left( begin{array}{rrr}

9 & 22 & -6 \ -1 &-4 & 1 \ 8 & 16 & -5

end{array}

right) .

$$

Решение. $ det (A-x E)=-(x-3) (x+2)(x+1) $.

Пренебрегая знаком – , имеем:

$$

begin{matrix}

f_1(x)=x^2+3x+2 & u & f_1(A)=

left( begin{array}{rrr}

40 & 80 & -20 \ 0 &0 & 0 \ 40 & 80 & -20

end{array}

right) , f_1(3)=20 ; \

f_2(x)=x^2-2x-3 & u & f_2(A)=

left( begin{array}{rrr}

-10 & -30 & 10 \ 5 &15 & -5 \ 0 & 0 & 0

end{array}

right) , f_2(-2)=5 ; \

f_3(x)=x^2-x-6 & u & f_3(A)=

left( begin{array}{rrr}

-4 & -8 & 4 \ 4 & 8 & -4 \ 8 & 16 & -8

end{array}

right), f_3(-1)=-4 .

end{matrix}

$$

$$

g(A)=g(3)

left(

begin{array}{rrr}

2 & 4 & -1 \ 0 &0 & 0 \ 2 & 4 & -1

end{array}

right) + g(-2)

left( begin{array}{rrr}

-2 & -6 & 2 \ 1 &3 & -1 \ 0 & 0 & 0

end{array}

right)

+ g(-1)

left( begin{array}{rrr}

1 & 2 & -1 \ -1 & -2 & 1 \ -2 & -4 & 2

end{array}

right) .

$$

♦

В случае, когда характеристический полином матрицы $ A_{} $ имеет кратные корни, для вычисления полинома $ g_1(x) $ из теоремы $ 1 $ приходится привлекать обобщение понятия классического интерполяционного полинома в виде интерполяционного полинома Эрмита. Действительно, полином $ g_1(x) $ определялся в теореме $ 1 $ как остаток от деления $ g_{}(x) $ на характеристический полином $ f(x)=det (A- xE) $:

$$

g(x)equiv f(x)q(x)+g_1(x) ;

$$

При этом $ deg g_1 < n $, и, следовательно, полином $ g_1(x) $ вполне определялся произвольным набором $ n_{} $ своих значений — мы брали их равными $ g(lambda_1),dots,g(lambda_n) $ в случае, когда все корни $ f_{}(x) $ были различными (простыми).

Если же теперь среди корней имеются кратные и разложение характеристического полинома на линейные множители имеет вид

$$

f(x)equiv (-1)^n(x – lambda_1)^{{mathfrak m}_1} times

dots times (x – lambda_{{mathfrak r}})^{ {mathfrak m}_{{mathfrak r}}} quad ; quad

{mathfrak m}_1+dots+{mathfrak m}_{{mathfrak r}}=n, lambda_k ne

lambda_{ell} npu k ne ell, exists {mathfrak m}_j > 1,

$$

то для нахождения полинома $ g_1(x) $ не хватает значений $ g(lambda_1),dots, g(lambda_{{mathfrak r}}) $. Для получения дополнительных условий, можно продифференцировать тождество $ g(x)equiv f(x)q(x)+g_1(x) $ по $ x_{} $ и подставить в получившееся значения всех кратных корней полинома $ f_{}(x) $:

$$ g^{prime}(lambda_j) = f^{prime}(lambda_j) q(lambda_j)+f(lambda_j) q^{prime}(lambda_j)+g_1(lambda_j) . $$

Поскольку для любого кратного корня $ lambda_{j} $ будет выполнено условие

(см.

☞

ЗДЕСЬ ): $ f^{prime}(lambda_j)=0 $, то результатом подстановки будет равенство $ g^{prime}(lambda_j)=g_1^{prime}(lambda_j) $. Получаем дополнительные условия для определения полинома $ g_{1}(x) $. Итак, для нахождения полинома $ g_1(x) $ нам следует дополнительно к значениям $ g_{}(x) $ на всех корнях характеристического полинома (т.е. на собственных числах) матрицы $ A_{} $ вычислить еще и значения производной этой функции на всех кратных корнях. Может, однако, так случиться, что и этих дополнительных условий будет недостаточно для нахождения полинома $ g_1(x) $. Тогда следует продолжить процесс вычисления производных — для тех значений $ lambda_{j} $, кратность которых $ {mathfrak m}_j $ больше $ 2_{} $. Окончательно, для определения полинома $ g_1(x) $ мы имеем значения полинома $ g(x) $

и его производных

$$

begin{matrix}

g(lambda_1),dots, g^{({mathfrak m}_{_1}-1)}(lambda_1), \

g(lambda_2),dots, g^{({mathfrak m}_{_2}-1)}(lambda_1), \

dots, \

g(lambda_{mathfrak r}),dots, g^{({mathfrak m}_{_{mathfrak r}}-1)}(lambda_{mathfrak r}) ;

end{matrix}

$$

при этом количество значений в каждой строке равно (алгебраической) кратности соответствующего собственного числа. По этим значениям полином степени меньшей $ n_{} $ восстанавливается однозначно.

Заметим, что данный метод не чувствителен к геометрической кратности каждого из собственных чисел (т.е. к структуре

жордановой нормальной формы матрицы $ A_{} $ вне ее главной диагонали); для его работы достаточно информации об алгебраической кратности.

П

Пример 5. Вычислить $ A^{100} $ для

$$

A=

left(

begin{array}{rrrr}

1 &2 &1 &0 \

1 & 1 & 0 &-1 \

-2& 0 & 1 & 2 \

0 & 2 & 1 & 1

end{array}

right) ;

A=

left(

begin{array}{rrrr}

1 &0 &0 &0 \

1 & 2 & 0 &1 \

2& 3 & 1 & 2 \

-1 & -1 & 0 & 0

end{array}

right) ;

A=

left(

begin{array}{rrrr}

1 &1 & 2 &-1 \

1 & -1 & -4 &2 \

0& 1 & 3 & -1 \

0 & 0 & 1 & 1

end{array}

right) .

$$

Решение. У всех трех матриц одинаковый характеристический полином: $ det (A- x E) = (x-1)^4 $. Остаток от деления $ x^{100} $ на $ (x-1)^4 $ совпадает с отрезком ряда Тейлора функции $ x^{100} $ при разложении ее по степеням $ x-1 $, т.е. с

$$

begin{matrix}

g_1(x)&=&1+100,(x-1)+frac{100cdot99}{2}(x-1)^2+frac{100cdot 99 cdot 98}{6}(x-1)^3= \

&= & -156849+475300,x-480150,x^2+161700,x^3 .

end{matrix}

$$

Для всех трех матриц формула вычисления $ A^{100} $ одна и та же:

$$

A^{100} =

-156849, E+475300,A-480150,A^2+161700,A^3 .

$$

Несмотря на то обстоятельство, что жордановы нормальные формы у этих матриц различны.

♦

В приведенном способе нахождения остатка от деления полинома $ g(x) $ на характеристический полином матрицы $ A_{} $ имеется один нюанс, требующий пояснений.

Предположим, что элементы матрицы $ A_{} $ целочислены: $ {a_{jk} in mathbb Z}_{j,k=1}^n $. Тогда и характеристический полином $ f(x)=det (A-x E) $ является полиномом

с целочисленными коэффициентами $ f(x) in mathbb Z[x] $. Поскольку старший коэффициент $ f_{}(x) $ равен $ 1_{} $ по абсолютной величине, то и остаток от деления

$ g_{} (x) $ на $ f_{}(x) $ будет иметь только целые коэффициенты (см.

☞

ЗДЕСЬ ): $ g_1(x) in mathbb Z[x] $. Между тем, вычисление этого полинома через посредство корней характеристического полинома, в общем случае, приводит к иррациональным выражениям: корни полинома, как правило, не выражаются в радикалах через его коэффициенты.

П

Пример 6. Вычислить $ g(A) $ для

$$ g(x)= x^{10}-6,x^8+11,x^7-x^3+4,x^2- 1 $$

и

$$

A=

left(

begin{array}{rrrrr}

6 &1 &5 &2 & -1 \

-5 & -1 & -4 & -2 & 1 \

-5 & -1 & -5 & -1 & 1 \

-5 & -1 & -5 & -2 & 2 \

-5 & 0 & -7 & -2 & 2

end{array}

right) , .

$$

Решение. Характеристический полином $ f(x)= det (A-x E)=-(x^5-4,x-2) $ имеет корни, не выражающиеся в радикалах.

Попробуем применить теорему 2 для приближенных значений корней:

$$ lambda_1 approx -1.243596, lambda_2 approx -0.508499, lambda_3 approx 1.518512, lambda_{4,5} approx 0.116792 pm {mathbf i}, 1.438448,, . $$

Для нахождения частных от деления $ f_{}(x) $ на линейные множители $ (x-lambda_j) $ воспользуемся следующим приемом. Частное от деления произвольного полинома

$$ f(x)=a_0x^5+a_1x^4+a_2x^3+a_3x^2+a_4x+a_5 $$

на линейный полином $ x – lambda $ находится по формуле

$$

q(x,lambda)=a_0x^4+(a_0lambda + a_1)x^3+(a_0lambda^2+a_1lambda+a_2)x^2+(a_0lambda^3+a_1lambda^2+a_2lambda+a_3)x+

$$

$$

+(a_0lambda^4+a_1lambda^3+a_2lambda^2+a_3 lambda+a_4) , ,

$$

которая является развернутым вариантом схемы Хорнера. Подставляя сюда значения коэффициентов характеристического полинома $ f_{}(x) $ и приближенные значения его корней, получаем приближения полиномов $ f_j(x) $:

$$

begin{array}{ccl}

f_1(x) &approx & -x^4+1.243596,x^3-1.546532,x^2+1.923266,x+1.608239 , , \

f_2(x) & approx &-x^4+0.508499,x^3-0.258572,x^2+0.131483,x+3.933141, , \

f_3(x) & approx & dots \

f_{4,5}(x) & approx & -x^4+(-0.116792mp 1.438448, mathbf i),x^3+(2.055491mp 0.335998, mathbf i),x^2+ dots

end{array}

$$

Вычисляем значения этих полиномов на матрице $ A_{} $:

$$

f_1(A) approx

left(

begin{array}{rrrrr}

1.844873 & 0.503518 & 3.247794 & -1.280266 & 0.201656 \

0.383692& 0.104720 & 0.675468 & -0.266266 & 0.041940 \

-4.616308& -1.259922 & -8.126748 & 3.203527 &-0.504592 \

1.601674 & 0.437142 & 2.819656 &-1.111496 & 0.175073 \

-6.130986 & -1.673321 & -10.793252 & 4.254651 & -0.670156

end{array}

right)

$$

$$

f_2(A) approx

left(

begin{array}{rrrrr}

-6.028030 & -5.334374 & -3.876435 & 0.470253 & 0.893870 \

9.342582 & 8.267515 & 6.007919& -0.728825 & -1.385371\

4.342582 & 3.842873 & 2.792577 & -0.338769 & -0.643943\

6.885079 & 6.092801 & 4.427577 & -0.537112 & -1.020959\

5.592221 & 4.948714 & 3.596180 &-0.436255 & -0.829246

end{array}

right)

$$

$$

f_3(A) approx dots

$$

$$

f_{4,5}(A) approx

left(

begin{array}{rrr}

-4.833170pm 17.111687 , mathbf i & -10.621186 pm 0.712576 , mathbf i & dots \

6.383099 mp 14.587375 , mathbf i & 9.509036 pm 0.668706 , mathbf i & dots \

1.383099 mp 14.587376 , mathbf i & 8.504395mp 2.151023 , mathbf i & dots \

0.799140 mp 21.779614 , mathbf i & 12.443094mp 3.925469 , mathbf i & dots \

11.076597 mp 23.459604 , mathbf i & 15.455549pm 1.532904 , mathbf i & dots

end{array}

right) , .

$$

Несмотря на кажущуюся хаотичность формирования элементов этих матриц, столбцы каждой из них пропорциональны (впрочем, равно как и строки).

Составляем матрицу из теоремы $ 2 $:

$$

sum_{k=1}^5 frac{g(lambda_k)}{f_k(lambda_k)}f_k(A) =

sum_{k=1}^5 frac{g(lambda_k)}{f_k(lambda_k)} q(A,lambda_k) approx

$$

$$

approx

left(

begin{array}{rrrrr}

-94.999999 & -173.999999 & -237.999999 & 143.999999 & 198.999999 \

159.999999 & 149.999999& 301.999999&-101.999999&-191.999999\

39.999999&156.999999&79.999999&-127.999999&-125.999999\

194.999999 &277.999999&229.999999&-239.999999&-140.999999\

404.999999&273.999999&435.999999&-67.999999&-278.999999

end{array}

right)

$$

(при уменьшении точности вычислений возможно появление ненулевых мнимых частей). Полученный ответ можно интерпретировать как приближение истинного, а именно, целочисленного:

$$

left(

begin{array}{rrrrr}

-95&-174&-238&144&199\

160&150&302&-102&-192\

40&157&80&-128&-126\

195&278&230&-240&-141\

405&274&436&-68&-279

end{array}

right) , .

$$

Возникает вопрос: можно ли было получить этот ответ, не прибегая к численным методам (и использованию мнимых чисел)? Где именно «заложена» принципиальная целочисленность ответа? Для ответа посмотрим на выражение

$$

sum_{k=1}^5 frac{g(lambda_k)}{f_k(lambda_k)}f_k(A) = sum_{k=1}^5 frac{g(lambda_k)}{f_k(lambda_k)}f_k(A) =

$$

$$

sum_{k=1}^5 frac{g(lambda_k)}{f_k(lambda_k)} left(a_0A^4+(a_0lambda_k + a_1)A^3 + (a_0lambda_k^2+a_1lambda_k+a_2)A^2 dots right)=

$$

$$

= left(a_0sum_{k=1}^5 frac{g(lambda_k)}{f_k(lambda_k)} right)A^4 +

left( a_0 sum_{k=1}^5 frac{g(lambda_k)lambda_k}{f_k(lambda_k)}+a_1 sum_{k=1}^5 frac{g(lambda_k)}{f_k(lambda_k)} right) A^3+ dots , ,

$$

здесь $ a_0=(-1)^n,a_1, a_2,dots $ обозначают коэффициенты полинома $ f_{}(x) $. Выражения в круглых скобках представляют собой симметрические рациональные функции от корней этого полинома. Согласно теореме Гаусса, эти функции допускают представление в виде рациональных функций от коэффициентов $ a_0,a_1, a_2,dots $ (а, на самом деле, полиномов от этих коэффициентов). Так что ответ в задаче действительно должен быть целочисленным. Другое дело, что для его практического поиска мы привлекли численные методы поскольку явное представление симметрических рациональных функций через коэффициенты полинома — задача весьма сложная.

♦

Анализ с помощью жордановой нормальной формы

Все применения ЖНФ основаны на формулах подобия матрицы и ее ЖНФ:

$$C^{-1}{mathbf A}C ={mathbf A}_{_{mathfrak J}} quad iff quad {mathbf A}=

C{mathbf A}_{_{mathfrak J}}C^{-1} . $$

Оказывается, что любая мыслимая операция над

матрицей $ {mathbf A} $ может быть сведена к этой же операции над формой Жордана:

$$g({mathbf A})= Cg({mathbf A}_{_{mathfrak J}})C^{-1} .$$

В самом деле, имеем, например:

$$

{mathbf A}^2 =(C{mathbf A}_{_{mathfrak J}}C^{-1})^2=C{mathbf A}_{_{mathfrak J}}C^{-1}C{mathbf A}_{_{mathfrak J}}C^{-1}=C{mathbf A}_{_{mathfrak J}}^2C^{-1} .

$$

По индукции можно показать справедливость равенства

$$

{mathbf A}^N=C{mathbf A}_{_{mathfrak J}}^NC^{-1} quad npu quad forall N in mathbb N .

$$

Далее, справедливость равенства $ {mathbf A}^0=E=C{mathbf A}_{_{mathfrak J}}^0C^{-1} $

очевидна.

Но тогда можно доказать и справедливость равенства

$$ g({mathbf A}) = Cg({mathbf A}_{_{mathfrak J}})C^{-1} $$

для любого полинома $ g(x)=b_0x^m+dots+b_m in mathbb C[x] $. Отсюда — прямая дорога к аналитическим функциям от матрицы… Этот переход обсудим НИЖЕ,

а пока остановимся и проведем анализ структуры полинома от ЖНФ.

Мы будем рассматривать матрицы и их ЖНФ над полем $ mathbb C_{} $. Пусть характеристический полином матрицы $ mathbf A_{} $

имеет следующее разложение на линейные множители над полем $ mathbb C_{} $:

$$

f(lambda)= det (mathbf A – lambda E) equiv (-1)^n(lambda – lambda_1)^{{mathfrak m}_1} times

dots times (lambda – lambda_{{mathfrak r}})^{ {mathfrak m}_{{mathfrak r}}} quad ; quad

{mathfrak m}_1+dots+{mathfrak m}_{{mathfrak r}}=n, lambda_k ne

lambda_{ell} npu k ne ell.

$$

ЖНФ матрицы $ mathbf A_{} $ имеет вид блочно-диагональной матрицы

$$

{mathbf A}_{_{mathfrak J}}=left(

begin{array}{cccc}

mathbf A_1 & mathbb O & dots & mathbb O \

mathbb O & mathbf A_2 & dots & mathbb O \

vdots & & ddots & vdots\

mathbb O & mathbb O & dots & mathbf A_{{mathfrak r}}

end{array}

right) quad , quad mbox{ здесь } mathbf A_j – mbox{ матрица порядка }

{mathfrak m}_jtimes {mathfrak m}_j .

$$

В свою очередь, каждая из составляющих матриц

$ mathbf A_j $ имеет снова блочно-диагональный вид

$$

mathbf A_j=

left(

begin{array}{cccc}

{mathbf A}_{j1} & mathbb O & dots & mathbb O \

mathbb O & {mathbf A}_{j2} & dots & mathbb O \

vdots & & ddots & vdots\

mathbb O & mathbb O & dots & {mathbf A}_{j ell_j}

end{array}

right)

$$

где на диагонали стоят клетки Жордана, т.е. матрицы вида

$$

{mathfrak J}_k (lambda_j) =

left(

begin{array}{cccccc}

lambda_j & & & & & \

1 & lambda_j & & & & \

0 & 1 & lambda_j & & mathbb O & \

vdots & & ddots & ddots& & \

0 & 0 & 0 & dots & lambda_j & \

0 & 0 & 0 & dots & 1 & lambda_j

end{array}

right)_{k times k} .

$$

Теперь наша задача — свести вычисление произвольного полинома от $ {mathbf A}_{_{mathfrak J}} $ к вычислению этого же полинома от клеток Жордана: $ g({mathbf A}_{_{mathfrak J}}) $ — к $ g({mathfrak J}_k (lambda_j)) $.

Структура степенной функции

Т

Теорема 3. Если матрица $ {mathbf D} $ — блочно-диагональная, то и $ {mathbf D}^N $ —

блочно-диагональная:

$$

left(

begin{array}{cccc}

{mathbf D}_1 & mathbb O & dots & mathbb O \

mathbb O & {mathbf D}_2 & dots & mathbb O \

vdots & & ddots & vdots \

mathbb O & mathbb O & dots & {mathbf D}_r

end{array}

right)^N=

left(

begin{array}{cccc}

{mathbf D}_1^N & mathbb O & dots & mathbb O \

mathbb O & {mathbf D}_2^N & dots & mathbb O \

& & ddots & \

mathbb O & mathbb O & dots & {mathbf D}_r^N

end{array}

right) .

$$

Здесь $ {mathbf D}_1, dots, {mathbf D}_r $ — квадратные матрицы1).

Т

Теорема 4. Если матрица $ L_{} $ — нижнетреугольная, то и $ L^N $ — нижнетреугольная.

Теоремы $ 3 $ и $ 4 $ сводят вычисление степени матрицы $ {mathbf A} $ к вычислению степени ее клеток Жордана $ {mathfrak J}_k (lambda_j) $.

Т

Теорема 5. Имеет место равенство:

$$

left(

begin{array}{rrrrrr}

lambda & & & & & \

1 & lambda & &mathbb O & & \

0& 1 & lambda & & & \

vdots & & ddots & ddots & & \

0 & 0 & dots & 1 & lambda & \

0 & 0 & dots & 0 & 1 &lambda

end{array}

right)_{ktimes k}^N=

left(

begin{array}{ccrlcc}

lambda^N & & & & & \

C_N^1 lambda^{N-1} & lambda^N & &mathbb O & & \

C_N^2 lambda^{N-2} & C_N^1 lambda^{N-1} & lambda^N & & & \

dots & & ddots & ddots & & \

C_N^{k-2} lambda^{N-k} & dots & & C_N^1 lambda^{N-1} &lambda^N & \

C_N^{k-1} lambda^{N-k+1} & dots & & C_N^2 lambda^{N-2} & C_N^1 lambda^{N-1} &lambda^N

end{array}

right)

$$

(считаем здесь элементы с отрицательными показателями $ lambda $ равными нулю).

Более корректная запись матрицы в правой части возможна с помощью матрицы

$$H_j = begin{array}{rl}

begin{array}{c}

{scriptstyle 0 to} \ {scriptstyle 1 to} \ vdots \ {scriptstyle j to}

\ vdots \ {scriptstyle k-1 to}

end{array}

left(begin{array}{llllll}

0 & & & & &\

0 & & & mathbb O & &\

vdots & & & & &\

1 & & & & \

vdots & ddots & & &\

0 & & 1 & dots & 0 & 0

end{array}

right)

end{array}

=left[

begin{array}{ll}

mathbb O_{jtimes (k-j)} & mathbb O_{jtimes j} \

E_{(k-j) times (k-j)} & mathbb O_{(k-j)times j}

end{array}

right]_{ktimes k}

$$

(единицами заполнена $ j_{} $-я диагональ, считая от нулевой — главной):

$$

left[{mathfrak J}_k (lambda) right]^N =

$$

$$

=lambda^N E +

C_N^1 lambda^{N-1} H_1 + C_N^2 lambda^{N-2} H_2 +

dots +left{ begin{array}{ccc}

C_N^N H_N & npu & N<k, \

C_N^{k-1}lambda^{N-k+1} H_{k-1} & npu & N ge k.

end{array}

right.

$$

П

Пример. Вычислить

$$

{mathbf A}=left(

begin{array}{rrrr}

1 &2 &1 &0 \

1 & 1 & 0 &-1 \

-2& 0 & 1 & 2 \

0 & 2 & 1 & 1

end{array}

right)^{100} .

$$

Решение. Найдем ЖНФ для матрицы $ {mathbf A} $ и матрицу $ C_{} $.

$$det ({mathbf A}- lambda E) = (lambda-1)^4 . $$

Ищем корневые векторы, принадлежащие $ lambda_1=1 $:

$$

{mathbf B}={mathbf A}- E=

left(

begin{array}{rrrr}

0 & 2 & 1 & 0 \

1 & 0 & 0 &-1 \

-2 & 0 & 0 & 2 \

0 & 2 & 1 & 0

end{array}

right)

quad

rightarrow

quad

left(

begin{array}{rrrr}

0 &2 &1 &0 \

1 & 0 & 0 &-1 \

0& 0 & 0 & 0 \

0 & 0 & 0 & 0

end{array}

right)

$$

Имеем: $ mathbb Q_1=mathcal L left(

left[ 0 , -1 , 2 , 0 right]^{^{top}},

left[ 1 , 0 , 0 , 1 right]^{^{top}}

right) $; следовательно геометрическая кратность собственного числа не равна его алгебраической кратности и матрица $ {mathbf A} $ недиагонализуема.

$$

{mathbf B}^2=mathbb O_{4times 4} quad

Longrightarrow quad mathbb Q_2=

mathcal L left(

left[ 0 , -1 , 2 , 0 right]^{^{top}},

left[ 1 , 0 , 0 , 1 right]^{^{top}},left[ 1 , 0 , 0 , 0 right]^{^{top}},

left[ 0 , 1 , 0 , 0 right]^{^{top}}

right) .

$$

В ЖНФ имеются $ 2_{} $ клетки $ 2 times 2 $. Для построения

канонического базиса берем векторы из относительного базиса $ mathbb Q_2 $ над

$ mathbb Q_1 $ и домножаем их на $ {mathbf B} $ (заполняем башни сверху вниз). Получаем

$$

C=

left(

begin{array}{rrrr}

1 & 0 & 0 & 2 \

0 & 1 & 1 & 0 \

0 & -2 & 0 & 0 \

0 & 0 & 0 & 2

end{array}

right) quad ,

{mathbf A}_{_mathfrak J}=

left(

begin{array}{rrrr}

1 & & & \

1 & 1 & & \

& & 1 & \

& & 1 & 1

end{array}

right)

$$

Теперь воспользуемся формулой $ {mathbf A}^{100}=C {mathbf A}_{_{mathfrak J}}^{100} C^{-1} $ и теоремами 1-3:

$$

{mathbf A}^{100}=C left(

begin{array}{rrrr}

1 & & & \

1 & 1 & & \

& & 1 & \

& & 1 & 1

end{array}

right)^{100}C^{-1}=

$$

$$=

left(

begin{array}{rrrr}

1 & 0 & 0 & 2 \

0 & 1 & 1 & 0 \

0 & -2 & 0 & 0 \

0 & 0 & 0 & 2

end{array}

right)

left(

begin{array}{llll}

1 & & & \

100 & 1 & & \

& & 1 & \

& & 100 & 1

end{array}

right)

left(

begin{array}{rrrr}

1 & 0 & 0 & -1 \

0 & 0 & -1/2 & 0 \

0 & 1 & 1/2 & 0 \

0 & 0 & 0 & 1/2

end{array}

right)

=

$$

$$

= left(

{begin{array}{rrrr}

1 & 200 & 100 & 0 \

100 & 1 & 0 & -100 \

-200 & 0 & 1 & 200 \

0 & 200 & 100 & 1

end{array}}

right) .

$$

♦

Решение линейного разностного уравнения

§

Настоящий пункт тесно связан с разделом ЛИНЕЙНОЕ РАЗНОСТНОЕ УРАВНЕНИЕ.

Пусть рекуррентная последовательность задается уравнением

$$

x_{n+K}=a_1 x_{n+K-1}+ dots+ a_n x_K

$$

и начальными данными $ x_0,x_1,dots,x_{n-1} $.

Введем в рассмотрение столбцы, состоящие из $ n_{} $ последовательных элементов этой последовательности, обозначив

$$

X_0=left( begin{array}{l}

x_0 \ x_1 \ vdots \ x_{n-1}

end{array}

right), X_1=left( begin{array}{l}

x_1 \ x_2 \ vdots \ x_{n}

end{array}

right), X_2=left( begin{array}{l}

x_2 \ x_3 \ vdots \ x_{n+1}

end{array}

right), dots,

X_K=left( begin{array}{l}

x_K \ x_{K+1} \ vdots \ x_{K+n-1}

end{array}

right),dots ;

$$

а также следующую матрицу, известную как матрица Фробениуса:

$$

{mathfrak F}=

left( begin{array}{lllllll}

0 & 1 & 0 & 0 & dots & 0 & 0 \

0 & 0 & 1 & 0 & dots & 0 & 0 \

0 & 0 & 0 & 1 & dots & 0 & 0 \

vdots& &&&ddots & & vdots \

0 & 0 & 0 & 0 & dots & 0 & 1 \

a_n & a_{n-1} & a_{n-2} & & dots & a_2 & a_1

end{array} right)_{n times n} .

$$

Используя правило умножения матриц, а также соотношение между элементами последовательности, получаем:

$$

X_1={mathfrak F}X_0, X_2={mathfrak F}X_1,dots, X_K={mathfrak F}X_{K-1},dots,

$$

откуда имеем:

$$

X_K={mathfrak F}^KX_0 quad npu quad Kin mathbb N .

$$

Искомое выражение для $ x_{K} $ получится умножением первой строки матрицы

$ {mathfrak F}^K $ на столбец начальных данных $ X_{0} $. Таким образом, задача решения разностного уравнения сводится к задаче возведения в степень матрицы $ {mathfrak F} $.

Для нахождения $ {mathfrak F}^{K} $ воспользуемся результатами предыдущего пункта. Найдя

жорданову нормальную форму (ЖНФ) $ {mathfrak F}_{mathfrak J} $ и соответствующую матрицу

преобразования базиса $ C_{} $, получим

$$

{mathfrak F}_{mathfrak J} =C^{-1} mathfrak F C Longrightarrow

{mathfrak F}^{K}=C {mathfrak F}_{_{mathfrak J}}^{K} C^{-1} , .

$$

Характеристический полином матрицы Фробениуса:

$$det ({mathfrak F}- lambda E)=

(-1)^n(lambda^n-a_1 lambda^{n-1}-dots-a_n) .

$$

с точностью до знака совпадает с характеристическим полиномом последовательности.

Обозначим его корни $ lambda_1,dots,lambda_n $. Если они различны, то жорданова нормальная форма $ {mathfrak F}_{_{mathfrak J}} $ диагональна. Если же среди этих корней имеются кратные, то установление структуры ЖНФ потребует усилий; однако же можно заранее утверждать, что эта форма диагональной не будет.

Т

Теорема 6. Если все корни характеристического полинома различны, то решение разностного уравнения получается в виде

$$ x_{K}= C_1lambda_1^K + dots+ C_n lambda_n^K , $$

числа $ C_{1},dots,C_n $ не зависят от $ K_{} $ и определяются с помощью начальных условий из системы линейных уравнений:

$$

left{begin{array}{rrrrcl}

C_1 &+C_2 &+dots &+ C_n &=& x_0 \

lambda_1 C_1 &+ lambda_2C_2&+dots & + lambda_n C_n & = & x_1 \

lambda_1^2 C_1 &+ lambda_2^2C_2&+dots & + lambda_n^2 C_n & = & x_2 \

dots &&&&& dots \

lambda_1^{n-1}C_1 &+ lambda_2^{n-1}C_2&+dots & + lambda_n^{n-1} C_n & = & x_{n-1}.

end{array}

right.

$$

Доказательство теоремы и ее обобщение на случай наличия кратных корней характеристического полинома

☞

ЗДЕСЬ.

Асимптотика степенной функции

Задача. Выяснить как себя ведет $ mathbf A^N $ при $ Nto +infty $.

Пример предыдущего пункта показывает, что существуют матрицы $ mathbf A_{} $, для которых некоторые элементы $ mathbf A^N $ неограниченно возрастают при $ Nto +infty $.

Т

Теорема 7. Если все собственные числа матрицы $ mathbf A_{} $ меньше $ 1 $ по абсолютной величине, т.е. $ {|lambda_j|<1}_{j=1}^n $, то

$$ lim_{Nto +infty} mathbf A^N = mathbb O_{ntimes n} , . $$

Если существует хотя бы одно собственное число $ lambda_j $ такое, что $ |lambda_j|>1 $, то существует хотя бы один элемент матрицы $ mathbf A^N $ неограниченно возрастающий при

$ Nto +infty $.

Условия теоремы можно переформулировать в виде соответствующих неравенств на спектральный радиус матрицы. Проверка этих условий возможна без непосредственного вычисления собственных чисел матрицы $ mathbf A_{} $. Достаточно построить характеристический полином матрицы и применить к нему критерий Шура-Кона.

Cлучай существования единичного по модулю собственного числа матрицы $ mathbf A $ кажется исключительным, маловероятным. Вероятность попадания случайно брошенной комплексной точки на окружность $ |z|=1 $ равна $ 0 $. И тем не менее,

реальный мир играет вероятностями — см.

☞

ЦЕПИ МАРКОВА.

Вычисление полинома от матрицы

Теперь проведем анализ структуры матрицы $ g(mathbb A) $ с помощью жордановой нормальной формы.

Способ вычисления матричной степени распространяется и на полином от матрицы:

$$g({mathbf A})= Cg({mathbf A}_{_{mathfrak J}})C^{-1}$$

и аналоги теорем $ 3 $ и $ 4 $ сводят вычисление $ g({mathbf A}) $ к вычислению $ g(x_{}) $ от клеток Жордана.

Поскольку

$$gleft( {mathfrak J}_k (lambda) right)=

b_0left[{mathfrak J}_k (lambda)right]^m+b_1left[{mathfrak J}_k (lambda)right]^{m-1}+dots+b_mE_{mtimes m}

$$

то на основании теоремы $ 5 $ получаем следующий результат

Т

Теорема 8. Имеет место равенство

$$

gleft(left[

begin{array}{rrrrr}

lambda & & & & \

1 & lambda & & mathbb O & \

0& 1 & lambda & & \

vdots & & ddots & ddots & \

0 & 0 & dots & 1 &lambda

end{array}

right]_{ktimes k}right)=

left[

begin{array}{ccccc}

g(lambda) & & & & \

g'(lambda) & g(lambda) & & mathbb O & \

frac{g”(lambda)}{2!}& g'(lambda) & g(lambda) & & \

vdots & & ddots & ddots & \

frac{g^{(k-1)}(lambda)}{(k-1)!} & frac{g^{(k-2)}(lambda)}{(k-2)!} & dots & g'(lambda) & g(lambda)

end{array}

right]=

$$

$$

=g(lambda)E+ g'(lambda) H_1 + frac{g”(lambda)}{2!}H_2+dots+

frac{g^{(k-1)}(lambda)}{(k-1)!} H_{k-1}

$$

?

Можно ли утверждать, что геометрическая кратность собственного числа $ g(lambda_j) $ матрицы $ g({mathbf A}) $ совпадает с геометрической кратностью собственного числа $ lambda_j $ матрицы $ {mathbf A} $ (т.е. что порядки соответствующих клеток Жордана одинаковы)?

Аналитическая функция от матрицы

Норма матрицы. Матричный ряд

Нормой произвольной (не обязательно квадратной) матрицы $ A in mathbb C^{mtimes n} $ называется неотрицательное число $ | A | $, удовлетворяющее условиям (аксиомам):

1.

$ | A |=0 $ тогда и только тогда, когда $ A=mathbb O_{mtimes n} $;

2.

для $ forall alphain mathbb C $ справедливо $ | alpha A |=|alpha |cdot | A | $;

3.

для любых матриц $ A, B $ из $ mathbb C^{mtimes n} $ справедливо $ | A + B | le | A |+| B | $;

Три эти аксиомы являются универсальными аксиомами нормы в произвольном линейном векторном пространстве. Для матриц можно ввести дополнительную операцию — операцию умножения. В этом случае норму подчиняют еще одной аксиоме.

4.

для любых матриц $ A_{} $ и $ B_{} $, допускающих умножение $ A cdot B $,

справедливо $ | A cdot B | le | A | cdot | B | $.

Здесь следует отметить, что матрицы $ A, B $ и $ Acdot B $ принадлежат, вообще говоря, разным линейным пространствам. В каждом из этих пространств норма может быть задана по различным формулам. Более подробное изложение материала с особенностями введения нормы в произвольном линейном векторном пространстве

☞

ЗДЕСЬ. В настоящем и последующем пунктах мы ограничимся только рассмотрением норм векторов и норм квадратных матриц.

Норму можно вводить разными способами.

П

Пример.

Для матриц с комплексными элементами евклидова норма (или норма Фробениуса) вводится формулой:

$$| A | = sqrt{sum_{j,k} |a_{jk}|^2} ;$$

эту формулу для матриц с вещественными элементами можно переписать в виде

$$

| A | = sqrt{ operatorname{Sp}_{}, (A cdot A^{^{top}})} , .

$$

Выполнение для нее аксиом

1

и

2

очевидно. Справедливость

3

следует из неравенства треугольника: $ |a_{jk}+b_{jk}|^2le |a_{jk}|^2 +|b_{jk}|^2 $, а

4

следует из неравенства Коши-Буняковского:

$$|a_{j1}b_{1k}+dots+ a_{jn}b_{nk}|^2 le

left(|a_{j1}|^2+dots+|a_{jn}|^2 right)

left(|a_{1k}|^2+dots+|a_{nk}|^2 right) , .$$

Эту норму можно рассматривать как обобщение понятия длины вектора в $ mathbb R^{n} $:

$ | X_{ntimes 1} | = sqrt{ x_1^2+dots+x_n^2}=|X| $.

Вообще, любая формула, задающая скалярное произведение в евклидовом пространстве матриц, порождает и норму матрицы:

$ | A |= sqrt{langle A,A rangle} $. Только что введенная норма соответствует стандартному скалярному произведению.

Т

Теорема 9. Евклидова норма вещественной матрицы не меняется при умножении этой матрицы на произвольную ортогональную.

Доказательство

☞

ЗДЕСЬ.

П

Пример.

$ displaystyle | A | = max_j sum_k |a_{jk}| $. Тогда

$ | X_{ntimes 1} | =displaystyle{ max_{j=1,dots,n} |x_j|} $.

П

Пример. $ displaystyle | A | = max_k sum_j |a_{jk}| $. Тогда

$ | X_{ntimes 1} | =displaystyle{ sum_{j=1}^n |x_j|} $.

Введение понятия нормы позволяет упростить рассуждения о сходимости матричной последовательности $ { A_N }_{N=1}^{infty} $. В предыдущих пунктах эта сходимость понималась в смысле существования пределов у

последовательностей элементов $ a_{jk}^{(N)} $ одновременно для всех индексов $ j_{} $ и $ k_{} $.

Норма позволяет объединить исследование этих последовательностей на сходимость в изучение одной.

Т

Теорема 10. Последовательность $ { A_N }_{N=1}^{infty} $ сходится при $ N to infty $ к матрице $ A_{} $ тогда и только тогда, когда

$$lim_{Nto infty} | A_N – A |=0 , .$$

Матричный ряд

$$

sum_{j=1}^{infty} A_j = A_1 + dots + A_N+ dots

$$

называется сходящимся если существует конечный предел последовательности

$$left{ S_N = sum_{j=1}^{N} A_j= A_1 + dots + A_N right}_{N=1}^{infty}$$

его частичных сумм. Тогда величина этого предела называется суммой матричного ряда:

$$ S= sum_{j=1}^{infty} A_j = lim_{Nto infty} S_N , .$$

Матричный ряд называется расходящимся если хотя бы для

одной пары индексов $ j_{} $ и $ k_{} $ последовательность $ s_{jk}^{(N)} $ расходится.

Матричный ряд называется абсолютно сходящимся если сходится числовой ряд его норм:

$ displaystyle sum_{j=1}^{infty} | A_j | $.

Т

Теорема 11. Если матричный ряд сходится абсолютно, то он сходится и в обычном смысле.

Т

Теорема 12 [признак сравнения]. Если ряд $ displaystyle sum_{j=1}^{infty} A_j $

абсолютно сходится и $ | A_j |ge | B_j | $ для

$ forall jin mathbb N $, то и ряд

$ displaystyle sum_{j=1}^{infty} B_j $ сходится абсолютно.

Матричный степенной ряд

Рассмотрим теперь степенной ряд

$$

sum_{j=0}^{infty}b_j z^j=b_0+b_1z+b_2z^2+dots

$$

переменную в котором предполагаем комплексной: $ z in mathbb C $.

Пусть $ R $ — радиус сходимости этого ряда, т.е. ряд сходится

при $ |z|<R $ и расходится при $ |z|>R $. Известно, что

$$R=overline{lim_{nto infty}}left| frac{b_n}{b_{n+1}} right|=

overline{lim_{nto infty}} frac{1}{sqrt[n]{|b_{n}|}} , .$$

Рассмотрим теперь соответствующий матричный степенной ряд

$$

sum_{j=0}^{infty} b_j Z^j =b_0E+b_1 Z +b_2 Z^2+dots

$$

при $ Z in mathbb C^{ntimes n} $.

Т

Теорема 13. Матричный степенной ряд сходится абсолютно

для любой матрицы $ Z $ такой, что $ | Z|<R $.

Доказательство. Имеем

$$ sum_{j=0}^{infty}| b_j Z^j | le sum_{j=0}^{infty}| b_j|, | Z |^j , .$$

Числовой ряд в правой части сходится при $ | Z|<R $. На основании теорем $ 11 $ и $ 12 $

сходится и ряд $ sum_{j=0}^{infty} b_j Z^j $.

П

Пример. Ряд

$$sum_{j=0}^{infty}z^j=1+z+z^2+dots+z^j+dots $$

сходится при $ |z|<1 $ к функции $ 1/(1-z) $. На основании теоремы $ 13 $

можно утверждать, что матричный ряд

$$

sum_{j=0}^{infty}Z^j=E+Z+Z^2+dots+Z^j+dots

$$

сходится абсолютно для любой матрицы $ Z $ такой, что $ | Z|<1 $.

=>

Если ряд $ sum_{j=0}^{infty}b_j z^j $ сходится при $ forall z in mathbb C $,

то и ряд $ sum_{j=0}^{infty}b_j Z^j $ сходится при любой матрице $ Zin mathbb C^{n times n} $.

Сумма сходящегося степенного ряда $ sum_{j=0}^{infty}b_j Z^j $ будет

функцией переменной матрицы $ Z $. Такая функция называется аналитической функцией матрицы.

Если обозначить сумму ряда $ sum_{j=0}^{infty}Z^j $ через $ F(Z) $, то

легко проверяется

свойство: $ F(Z)(E-Z)=E $. Таким образом, ряд сходится к матрице $ (E-Z)^{-1} $ при $ |Z |<1 $.

Т

Теорема 14. Если матрицы $ A $ и $ B $ подобны, а $ F $ — аналитическая функция, определенная для $ A $, то тогда она будет

определена и для $ B $, и матрицы $ F(A) $ и $ F(B) $ также подобны:

$$ A doteq B quad Rightarrow quad F(A) doteq F(B) , . $$

Доказательство. По условию $ B=C^{-1} AC $ при некоторой неособенной матрице

$ Cin mathbb C^{ntimes n} $. Рассмотрим $ N $-ю частичную сумму ряда:

$$ F_N(Z)= sum_{j=0}^{N} a_j Z^j, . $$

В

☝

ПУНКТЕ было доказано, что

$$F_N(B)=C^{-1}F_N(A) C , .$$

Переходя к пределу, получаем

$$lim_{N rightarrow infty} F_N(B)=

C^{-1}left( lim_{N rightarrow infty} F_N(A) right) C =C^{-1}F(A)C , .$$

Таким образом, функция $ F $ определена и для $ B $ и $ F(B)=C^{-1}F(A)C $.

♦

Т

Теорема 15. Ряд $ sum_{j=0}^{infty} b_j Z^j $ сходится для любой матрицы $ A $ чей спектр лежит внутри круга сходимости:

$$ {|lambda_j|<R}_{j=1}^n $$

и расходится если хотя бы одно число оказывается за пределами этого круга:

$$ exists j in {1,dots,n} quad mbox{ такое, что } quad |lambda_j|>R , . $$

Доказательство

☞

ЗДЕСЬ.

=>

Если $ {|lambda_j|<R}_{j=1}^n $, то спектр матрицы $ F(A) $ равен $ { F(lambda_j) }_{j=1}^n $.

П

Пример. Вычислить сумму ряда

$$sum_{j=1}^{infty}frac{1}{j} A^j quad npu quad

A=left( begin{array}{rrr}

-3/2& 0& -4 \

-7& 1/2 & -14\

1 & 0 & 5/2

end{array}

right)

,

.$$

Решение. Соответствующий степенной ряд сходится при $ |z|<1 $ и

имеет суммой $ (- ln (1-z)) $.

$$ det (A-lambda E)=-(lambda-1/2)^3 , . $$

По теореме $ 15 $ матричный ряд сходится. Для применения

формулы ?? нам потребуется ЖНФ матрицы $ A $. Опуская промежуточные вычисления, получим

$$

A=

underbrace{

left( begin{array}{rrr}

-2& -1& -2 \

0& 0 & -7\

1 & 1 & 1

end{array}

right)}_{C}

underbrace{

left( begin{array}{rrr}

1/2& 0& 0 \

0& 1/2 & 0\

0 & 1 & 1/2

end{array}

right)

}_{A_{_{mathfrak J}}}

underbrace{

left( begin{array}{rrr}

-1& 1/7& -1 \

1 & 0 & 2 \

0 & -1/7 & 0

end{array}

right)

}_{C^{-1}}

$$

$$

– ln (E-A)=

left( begin{array}{rrr}

-2& -1& -2 \

0& 0 & -7\

1 & 1 & 1

end{array}

right)

left( begin{array}{rrr}

ln 2& 0& 0 \

0 & ln 2 & 0\

0 & 2 & ln 2

end{array}

right)

left( begin{array}{rrr}

-1& 1/7& -1 \

1 & 0 & 2 \

0 & -1/7 & 0

end{array}

right)

$$

Ответ.

$$

left( begin{array}{ccc}

ln 2-4 & 0 & -8 \

-14 & ln 2 & -28 \

2 & 0 & ln 2+4

end{array}

right) , .

$$

Формула

$$

F(Z)=CF(Z_{_{mathfrak J}})C^{-1} quad npu quad

Fleft( {mathfrak J}_k (lambda) right)=left[

begin{array}{ccccc}

F(lambda) & & & & \

F'(lambda) & F(lambda) & & mathbb O & \

frac{F”(lambda)}{2!}& F'(lambda) & F(lambda) & & \

vdots & & ddots & ddots & \

frac{F^{(k-1)}(lambda)}{(k-1)!} & frac{F^{(k-2)}(lambda)}{(k-2)!} &

dots & F'(lambda) & F(lambda)

end{array}

right]

$$

может быть использована и для доопределения функции от матрицы для случая тех

матриц, которые не удовлетворяют условиям теорем $ 13 $ или $ 15 $. Действительно, если ряд

$ sum_{j=1}^{infty} z^j/j $ представляет функцию

$ (-ln (1-z)) $ только при $ |z|<1 $, то сама функция существует и для $ z le -1 $.

Если договориться положить последнюю формулу в качестве определения функции

от матрицы $ Z $, то эта формула будет вычислять $ F(Z) $ для

всех тех матриц, на спектрах которых определены значения функции $ F(z) $

и ее производных до порядков, соответствующих порядкам клеток Жордана.

С использованием этой договоренности возможно и дальнейшее упрощение вычислений $ F(A) $, основанное на теореме Гамильтона-Кэли. В самом деле,

поскольку степени матрицы $ A^{n}, A^{n+1},dots $ линейно

выражаются через степени

$$ E=A^0, A, A^{2},dots, A^{n-1} , $$

то бесконечный ряд $ sum_{j=0}^{infty} b_j A^j $ может быть свернут в матричный полином

степени не выше $ n-1 $. Нахождение этого полинома производится обобщением

теоремы $ 2 $.

Т

Теорема 16. Если $ {lambda_1,dots,lambda_n} subset mathbb C $ — различные

корни аналитической функции $ Phi(z) $, лежащие внутри ее круга сходимости, то

существует единственное представление функции в виде:

$$

Phi(z) equiv (z-lambda_1)times dots times (z-lambda_n)Q(z) ,

$$

где $ Q(z) $ — аналитическая функция с тем же радиусом сходимости.

Т

Теорема 17. Если все собственные числа

$ lambda_1,dots,lambda_n $ матрицы $ A $ различны, то

$$F(A)=g(A) , ,$$

где $ g(x) $ — интерполяционный полином, построенный по таблице

$$

begin{array}{c|ccc}

x & lambda_1 & dots & lambda_n \ hline

y & F(lambda_1) & dots & F(lambda_n)

end{array}

, .

$$

Доказательство. Рассмотрим функцию $ Phi(z)= F(z)-g(z) $.

Поскольку $ g(lambda_j)=F(lambda_j) $, то $ Phi(lambda_j)=0 $ для всех

$ jin {1,dots,n} $. Тогда для $ Phi(z) $ будет выполнено тождество из теоремы $ 16 $.

Подставим матрицу $ A $ в это тождество:

$$Phi(A) equiv underbrace{(A-lambda_1E)times dots

times (A-lambda_nE)}_{=mathbb O}Q(A)

$$

Отсюда и следует равенство $ F(A)=g(A) $.

Дифференцирование матрицы

Рассмотрим (не обязательно квадратную) матрицу, элементами которой являются

функции, зависящие от переменной $ tin ]a,b[ subset mathbb R $:

$ A(t)=left[a_{jk}(t) right]_{j,k} $.

Производной матрицы $ A(t) $ по $ t $ будем называть матрицу

$$frac{ d, A(t)}{ d, t}= A^{prime} (t)=

left[frac{ d, a_{jk}(t)}{ d, t} right]_{j,k} $$

в предположении, что все производные в правой части существуют.

Таким образом, дифференцирование матрицы определается как ее поэлементное

дифференцирование. Поэтому свойства дифференцирования матриц легко выводятся

из соответствующих свойств производных скалярных функций.

Т

Теорема 18. Если соответствующие матричные действия имеют смысл, то

справедливы следующие соотношения

$$frac{ d, C}{ d, t}=mathbb O $$

при постоянной матрице $ C $ (элементы которой не зависят от $ t $);

$$frac{ d,left( A(t)+B(t) right)}{ d, t}=

frac{ d, A(t)}{ d, t}+frac{ d, B(t)}{ d, t} , ;$$

$$frac{ d, C A(t)}{ d, t}=

Cfrac{ d, A(t)}{ d, t} , quad

frac{ d, A(t)C}{ d, t}=frac{ d, A(t)}{ d, t} {bf C}

, ;$$

$$frac{ d, left(A(t)B(t) right)}{ d, t}=

frac{ d, A(t)}{ d, t}

B (t)+A (t)frac{ d, B(t)}{ d, t}

, .

$$

Для квадратной матрицы $ A(t) $ и $ Kin mathbb N $:

$$frac{ d, A^K(t)}{ d, t}

=A^{prime} (t)A^{K-1}(t)+A(t)A^{prime} (t)A^{K-2}(t)

+dots+A^{K-1}(t)A^{prime} (t) , ,$$

а если она коммутирует со своей производной, т.е. $ A(t)A^{prime} (t)=

A^{prime}(t)A(t) $, то

$$frac{ d, A^K(t)}{ d, t}=K A^{prime} (t)A^{K-1}(t)

, . $$

Для матрицы $ A(t) $, неособенной при любых рассматриваемых значениях $ t $, справедливо:

$$frac{ d, A^{-1} (t)}{ d, t} =-A^{-1} (t)

frac{ d,A(t)}{ d, t} A^{-1} (t) , . $$

Матричная экспонента

Матричной экспонентой или экспоненциалом называется матричный ряд

$$

exp ( Z )=e^{ Z } = sum_{j=0}^{infty} frac{Z^j}{j!}=E+Z+frac{1}{2}Z^2+frac{1}{3!}Z^3+dots

, .

$$

На основании следствия к теореме $ 13 $ этот ряд сходится и притом абсолютно для любой матрицы $ Z in mathbb C^{ntimes n} $ .

В настоящем пункте мы ограничимся рассмотрением вещественной матрицы $ Z $.

Т

Теорема 19. Если матрицы $ A $ и $ B $ коммутируют, то коммутируют и $ e^{A} $ и $ e^{ B} $:

$$

e^{A} e^{B} =e^{B} e^{A}= e^{A+B} , .

$$

Доказательство

☞

ЗДЕСЬ.

=>

Для любой матрицы $ A $ матрица $ e^{A} $ обратима и $ left( e^{A} right)^{-1}=e^{-A} $ .

Особое прикладное значение имеет матрица

$$

e^{tA}= sum_{j=0}^{infty} frac{t^j}{j!} A^j , ,

$$

зависящая от параметра $ tin mathbb C $. Если продифференцировать ряд по этому параметру, то на основании теоремы ?? получим:

$$

frac{ d, e^{t A}}{ d, t}=sum_{j=1}^{infty}

frac{jt^{j-1}}{j!}A^j=A

sum_{j=1}^{infty} frac{t^{j-1}}{(j-1)!}A^{j-1}=Ae^{tA} , .

$$

Таким образом, $ e^{t A} $ является решением матричного дифференциального уравнения2)

$$

frac{ d, X}{ d, t}= A X , .

$$

Обычно это уравнение рассматривают не относительно квадратной матрицы $ X $,

а относительно вектора-столбца $ X_{ntimes 1} $, т.е. последнее уравнение представляет матричную запись системы обыкновенных

дифференциальных уравнений:

$$

left{

begin{array}{cccccc}

d, x_1/d, t &=&a_{11}x_1+&a_{12}x_2+&dots+&a_{1n}x_n , , \

d, x_2/d, t &=&a_{21}x_1+&a_{22}x_2+&dots+&a_{2n}x_n , ,\

dots & & & &dots & \

d, x_n/d, t &=&a_{n1}x_1+&a_{n2}x_2+&dots+&a_{nn}x_n , .

end{array}

right.

$$

При задании начальных условий

$$

x_1(t_0)=x_{10},x_2(t_0)=x_{20},dots , x_n(t_0)=x_{n0} quad iff

quad X(t_0)=X_0

$$

решение уравнения $ d, X big/ d, t= A X $

представляет естественное обобщение одномерного (скалярного) случая:

$$

X(t)=e^{(t-t_0)A}X_0 , .

$$

В пункте ?? указаны два способа вычисления аналитической функции матрицы. Применим их для нахождения $ e^{t A} $.

$$

e^{t A}=Ce^{t A_{mathfrak J}}C^{-1}

$$

и вычисление $ e^{t, x} $ от клетки Жордана производится по формуле

$$

exp left( t cdot left[

begin{array}{rrrrr}

lambda & & & & \

1 & lambda & &mathbb O & \

0& 1 & lambda & & \

vdots & & ddots & ddots & \

0 & 0 & dots & 1 &lambda

end{array}

right]_{ktimes k}right)=

left[

begin{array}{ccccc}

e^{lambda t} & & & & \

te^{lambda t} & e^{lambda t} & &mathbb O & \

frac{t^2}{2!}e^{lambda t}& te^{lambda t} & e^{lambda t} & & \

vdots & & ddots & ddots & \

frac{t^{k-1}}{(k-1)!}e^{lambda t} & frac{t^{k-2}}{(k-2)!}e^{lambda t}

& dots & te^{lambda t} &

e^{lambda t}

end{array}

right]=

$$

$$

=e^{lambda t} left( E+ t H_1 + frac{t^2}{2!}H_2+dots+

frac{t^{k-1}}{(k-1)!} H_{k-1} right) , .

$$

Матрицы $ {H_j} $ определяются в

☝

ПУНКТЕ.

?

Доказать справедливость равенства: $ det( e^A ) = e^{operatorname{Sp} (A )} $.

П

Пример. Для системы дифференциальных уравнений

$$

left{

begin{array}{ccccc}

d, x_1 / d, t &=&&x_2&+x_3, \

d, x_2 / d, t &=&x_1&+x_2&-x_3, \

d, x_3 / d, t &=&&x_2&+x_3

end{array}

right.

$$

а) найти решение при $ x_1(0)=1,x_2(0)=1,x_3(0)=1 $;

б) найти все начальные условия

$$ x_1(0)=x_{10},x_2(0)=x_{20},x_3(0)=x_{30}, , $$

для которых решения будут ограниченными при $ tto +infty $.

Решение. Здесь $ t_0=0 $, $ det (A – lambda E) = – lambda (lambda -1)^2 $.

$$

A=

underbrace{

left( begin{array}{rrr}

2& -1& 1 \

-1& 1 & 0\

1 & -1 & 1

end{array}

right)}_{C}

underbrace{

left( begin{array}{rrr}

0& 0& 0 \

0& 1 & 0\

0 & 1 & 1

end{array}

right)

}_{{bf A}_{mathfrak J}}

underbrace{

left( begin{array}{rrr}

1& 0& -1 \

1 & 1 & -1 \

0 & 1 & 1

end{array}

right)

}_{C^{-1}}

$$

$$

e^{t A}=

left( begin{array}{rrr}

2& -1& 1 \

-1& 1 & 0\

1 & -1 & 1

end{array}

right)

left( begin{array}{rrr}

1& 0& 0 \

0& e^{t} & 0\

0 & te^{t} & e^{t}

end{array}

right)

left( begin{array}{rrr}

1& 0& -1 \

1 & 1 & -1 \

0 & 1 & 1

end{array}

right)=

$$

$$

=left( begin{array}{rrr}

2-e^{t}+te^t & t, e^t & -2+ 2, e^t-t, e^t \

-1 +e^t & e^t & 1-e^t \

1 -e^t+t, e^t& t, e^t & -1+2, e^t-t, e^t

end{array}

right) , .

$$

Домножая эту матрицу справа на столбец $ [1,1,1]^{^{top}} $, получаем

$$x_1(t)=e^t(1+t),, x_2(t)=e^t,, x_3(t)=e^t(1+t) , . $$

Для решения б) домножим последнюю матрицу справа на столбец

$ [x_{10},x_{20},x_{30}]^{^{top}} $. Получившийся столбец можно представить в виде

линейной комбинации трех:

$$

left( begin{array}{c}

2x_{10}-2x_{30} \ -x_{10}+x_{30} \ x_{10} – x_{30}

end{array}

right)

+e^t

left( begin{array}{c}

-x_{10}+2,x_{30} \ x_{10}+x_{20}-x_{30} \ -x_{10} +2, x_{30}

end{array}

right)

+t, e^t

left( begin{array}{c}

x_{10}+x_{20}-x_{30} \ 0 \ x_{10}+x_{20}-x_{30}

end{array}

right)

$$

Решение может быть ограниченным лишь при условии, когда столбцы при $ e^t $

и $ t, e^t $ будут нулевыми. Решаем получившуюся систему линейных

однородных уравнений относительно $ x_{10},x_{20} $ и $ x_{30} $, получаем, что

при любом $ x_{30} $ решение, проходящее через точку $ [2, x_{30},-x_{30},x_{30}]^{^{top}} $

будет ограниченным; более того, оно будет стационарным, т.е. не покинет

этой точки при изменении $ t $.

♦

П

Пример. Найти решение системы дифференциальных уравнений

$$

left{

begin{array}{ccrrrr}

d, x_1 / d, t &=&-9,x_1&+12,x_2&-7,x_3 &-7, x_4, \

d, x_2 / d, t &=&-25,x_1&+35,x_2&-20,x_3&-22, x_4 , \

d, x_3 / d, t &=&-16,x_1&+24,x_2&-14,x_3&-15, x_4, \

d, x_4 / d, t &=&-17,x_1&+22,x_2&-12,x_3&-14, x_4,

end{array}

right.

$$

при $ x_1(0)=1,x_2(0)=0,x_3(0)=1,x_4(0)=0 $.

Решение. Имеем:

$$ f(lambda)=det (A-lambda E) = lambda^4+2lambda^3+6lambda^2+2lambda+5 , .$$

Спектр матрицы $ { -1 pm 2 mathbf i, pm mathbf i } $ состоит из мнимых чисел. Для вычисления $ e^{At} $ можно воспользоваться интерполяционной формулой из пункта ??. Вычисления частных при делении $ f(lambda) $ на линейные полиномы $ lambda- lambda_{ast} $ и

$ lambda- overline{lambda_{ast}} $ упрощаются соображениями комплексной сопряженности:

$$

f_1(lambda)equiv frac{f(lambda)}{lambda-(-1+2 mathbf i))}equiv lambda^3+(1+2 mathbf i)lambda^2+lambda+(1+2 mathbf i),

$$

$$

f_2(lambda)equiv frac{f(lambda)}{lambda-(-1-2 mathbf i))}equiv overline{f_1(lambda)} equiv lambda^3+(1-2 mathbf i)lambda^2+lambda+(1-2 mathbf i),

$$

$$

f_3(lambda)equiv frac{f(lambda)}{lambda-mathbf i}equiv

lambda^3+(2+mathbf i)lambda^2+(5+2mathbf i)lambda+5 mathbf i , ,

$$

$$

f_4(lambda)equiv frac{f(lambda)}{lambda+mathbf i}equiv overline{f_3(lambda)} equiv

lambda^3+(2-mathbf i)lambda^2+(5-2mathbf i)lambda-5 mathbf i , .

$$

Аналогичное упрощение возникает и при вычислениях полиномов от матрицы, т.е. $ {f_j(A)} $:

$$

f_1(A)=

left(

begin{array}{rrrr}

32+26 mathbf i & -40-20 mathbf i & 20+10 mathbf i & 28+4 mathbf i \

73+88 mathbf i & -98-76 mathbf i & 49+38 mathbf i & 74+26 mathbf i\

54+46 mathbf i & -68-36 mathbf i & 34+18 mathbf i & 48+8 mathbf i\

42+66 mathbf i & -60-60 mathbf i & 30+30 mathbf i & 48+24 mathbf i

end{array}

right), , f_2(A)=overline{f_1(A)} ,

$$

$$

f_3(A)=

left(

begin{array}{rrrr}

7-mathbf i & -2+14 mathbf i & -3-9 mathbf i & 2-12 mathbf i\

17-6 mathbf i &2+36 mathbf i &-12-21 mathbf i & -1-31 mathbf i \

13-9 mathbf i & 10+30 mathbf i & -15-15 mathbf i & -8-26 mathbf i \

7-mathbf i &-2+14 mathbf i & -3-9 mathbf i & 2-12 mathbf i

end{array}

right), , f_4(A)=overline{f_3(A)} .

$$

Формулы решения системы дифференциальных уравнений по формуле

$$

left(sum_{j=1}^4 e^{lambda_j t} frac{f_j(A)}{f_j(lambda_j)}right) left( begin{array}{c} 1 \ 0 \ 1 \ 0 end{array} right) , .

$$

приводим к вещественному виду с использованием

формулы Эйлера

представления экспонент от мнимых чисел:

$$ e^{lambda_j t} = e^{t mathfrak{R}mathbf{e} (lambda_j) } left{cos ( t mathfrak{I}mathbf{m}(lambda_j)) + mathbf i sin ( t mathfrak{I}mathbf{m}(lambda_j)) right} , .

$$

Ответ.

$$

x_1(t)=frac{1}{5}( 17 e^{-t} cos (2t)-31 e^{-t} sin (2t) -2 cos t – sin t ), ,

$$

$$

x_2(t)=frac{1}{10}( 59 e^{-t} cos (2t)-187 e^{-t} sin (2t) -59 cos t – 17sin t ), ,

$$

$$

x_3(t)=frac{1}{5}( 28 e^{-t} cos (2t)-54 e^{-t} sin (2t) -23 cos t – 14sin t ), ,

$$

$$

x_4(t)=frac{1}{10}( 12 e^{-t} cos (2t)-66 e^{-t} sin (2t) -12 cos t – sin t ), .

$$

Если при любых начальных условиях решение уравнения

$$

frac{ d, X}{ d, t}= A X , .

$$

ограничено при $ t to +infty $, то будем называть это уравнение устойчивым по Ляпунову.

Устойчивое уравнение называется асимптотически устойчивым по Ляпунову если

все решения стремятся к $ mathbb O_{ntimes 1} $ при $ t to +infty $.

Уравнение называется неустойчивым по Ляпунову, если существует хотя бы один набор начальных условий, для которого соответствующее решение $ X(t) $ неограничено при $ t to +infty $.

В дальнейшем будем говорить просто об устойчивости, имея в виду устойчивость по Ляпунову.

Представление решения уравнения формулой

$$

X(t)=e^{(t-t_0)A}X_0

$$

позволяет свести исследование устойчивость этого уравнения к анализу спектра матрицы $ A $, либо же — в случае наличия кратных собственных чисел матрицы — к анализу ее жордановой нормальной формы $ A_{mathfrak J} $.

Т

Теорема 20. Уравнение $ d, X big/ d, t= A X $

а) устойчиво тогда и только тогда, когда

$$ mathfrak{R}mathbf{e} (lambda_j) le 0 quad npu j in {1,dots,n} , ,$$

и клетки Жордана в ЖНФ $ A_{mathfrak J} $, соответствующие собственным числам с $ mathfrak{R}mathbf{e} (lambda_j) = 0 $, имеют порядок $ 1 $;

б) асимптотически устойчиво тогда и только тогда, когда

$$ mathfrak{R}mathbf{e} (lambda_j) < 0 quad npu j in {1,dots,n} $$

(т.е. спектр матрицы $ A $ лежит в левой полуплоскости комплексной плоскости).

Конструктивная проверка последнего условия возможна чисто алгебраическими методами. Действительно, это условие

означает устойчивость характеристического полинома $ f(lambda)=det (A-lambda E) $

и может быть проверено с помощью критериев Рауса или Льенара-Шипара за конечное

число элементарных операций над коэффициентами.

=>

Уравнение $ d, X big/ d, t= A X $ с симметричной матрицей $ A $

а) устойчиво тогда и только тогда, когда матрица отрицательно полуопределена;

б) асимптотически устойчиво тогда и только тогда, когда матрица отрицательно определена.

Возникает сильное желание обобщить предлагаемый подход на систему уравнений

$$

frac{ d, X}{ d, t}= A(t) X

$$

с матрицей, зависящей от $ t $. Например, в случае, когда $ A(t) $ является матричным полиномом

$$

A(t)=A_0t^K+A_1t^{K-1} + dots + A_K quad npu {A_0,A_1,dots,A_K} subset mathbb R^{ntimes n}

$$

соблазнительно записать решение в виде

$$ X(t)=e^{int_{t_0}^t A(tau) d tau} X_0 $$

при

$$

int_{t_0}^t A(tau) d tau= A_0 frac{(t^{K+1}-t_0^{K+1})}{(K+1)!}+A_1 frac{(t^{K}-t_0^{K})}{K!} + dots + A_K (t-t_0) , .

$$

К сожалению, в общем случае, этот подход не сработает. Причины этого объясняются

☞

ЗДЕСЬ.

Матричные синус и косинус

Решение дифференциального уравнения второго порядка, описывающего, например, закон Гука

$$frac{ d,^2 x}{ d, t^2}= a, x , { x,a,t} subset mathbb R, x(t_0)=x_0,

frac{ d, x(t)}{ d, t}Bigg|_{t=t_0}= x_0^{prime}

$$

представимо в виде

$$

x(t)=left{ begin{array}{ccc}

displaystyle

frac{sqrt{a}x_0+x_0^{prime}}{2sqrt{a}} e^{sqrt{a}(t-t_0)} +

frac{x_0-x_0^{prime}}{2sqrt{a}} e^{-sqrt{a}(t-t_0)}

& npu & a>0, \

displaystyle

x_0 cos left( sqrt{|a|}(t-t_0) right) +

frac{x_0^{prime}}{sqrt{|a|}}

sin left( sqrt{|a|}(t-t_0) right)

& npu & a<0, \

x_0+x_0^{prime}(t-t_0) & npu & a=0 , .

end{array}

right.

$$

По аналогии поставим задачу поиска решения для системы уравнений

$$

frac{ d^2 X}{ d, t^2}=AX

$$

при матрице $ A in mathbb R^{ntimes n} $. Желательно найти такие матричные

аналоги для используемых операций, чтобы формулы для решения сохранили тот же вид.

Аналогами тригонометрических функций являются матричные синус и косинус:

$$

sin Z = sum_{j=1}^{infty} (-1)^{j-1}frac{Z^{2j-1}}{(2j-1)!}=

Z- frac{Z^3}{3!}+frac{Z^5}{5!}-dots

$$

$$

cos Z = sum_{j=0}^{infty} (-1)^{j}frac{Z^{2j}}{(2j)!}=

E- frac{Z^2}{2!}+frac{Z^4}{4!}-dots

$$

На основании следствия к теореме $ 13 $ оба ряда сходятся при

любой матрице $ Z in mathbb C^{ntimes n} $.

П

Пример. Вычислить $ cos $ и $ sin $ от матрицы

$$

A=left(

begin{array}{rr}

0 & 1 \

-1 & 0

end{array}

right) , .

$$

Решение проведем двумя способами. Сначала следуем формальному определению.

$$

A^2=

left(

begin{array}{rr}

-1 & 0 \

0 & -1

end{array}

right),

A^3=

left(

begin{array}{rr}

0 & -1 \

1 & 0

end{array}

right),

A^4=

left(

begin{array}{rr}

1 & 0 \

0 & 1

end{array}

right),

A^5=

left(

begin{array}{rr}

0 & 1 \

-1 & 0

end{array}

right) = A,

A^6=

left(

begin{array}{rr}

-1 & 0 \

0 & -1

end{array}

right)=A^2,dots

$$

Очевидна цикличность получающейся матричной последовательности.

$$

cos A=

left(

begin{array}{rr}

1 & 0 \

0 & 1

end{array}

right)-frac{1}{2}

left(

begin{array}{rr}

-1 & 0 \

0 & -1

end{array}

right) + frac{1}{4!} left(

begin{array}{rr}

1 & 0 \

0 & 1

end{array}

right) – dots =

$$

$$

=

left(

begin{array}{cc}

1+1/2+1/4!+dots & 0 \

0 & 1+1/2+1/4!+dots

end{array}

right) =

left(

begin{array}{cc}

(e+e^{-1})/2 & 0 \

0 & (e+e^{-1})/2

end{array}

right) , .

$$

Аналогично:

$$

sin A=

left(

begin{array}{cc}

0 & (e-e^{-1})/2 \

-(e-e^{-1})/2 & 0

end{array}

right) , .

$$

А теперь проверим с помощью интерполяционного представления. Вычислим характеристический полином:

$$ det (A-lambda E) = lambda^2 +1 equiv (lambda- mathbf i)(lambda+ mathbf i) , . $$

Тогда

$$

cos A = frac{cos mathbf i}{2mathbf i} (A+mathbf i E) + frac{cos (-mathbf i)}{-2mathbf i} (A-mathbf i E)=E cos mathbf i , .

$$

Хотя и трудно поверить, но можно формально проверить справедливость равенства

$$ cos mathbf i = frac{e+e^{-1}}{2} , . $$

То есть косинус чисто мнимого числа равен числу вещественному (да еще и большему $ 1 $)! Но это действительно следует из формального определения косинуса как суммы степенного ряда.

♦

Т

Теорема 21. Справедливо основное тригонометрическое тождество

$$ cos^2 Z + sin^2 Z equiv E_{ntimes n} , . $$

Квадратный корень из матрицы

Сложности возникают при определении $ sqrt{ A} $. Формально, корнем

квадратным из матрицы $ {mathbf A} $ называется решение матричного уравнения

$$

X^2=A

$$

Уже для матриц второго порядка это уравнение не всегда разрешимо:

например, не существует решения при

$$A = left(

begin{array}{cc}

0 & 0 \

1 & 0

end{array}

right) .

$$

С другой стороны, при

$$A = left(

begin{array}{rr}

-1 & 0 \

0 & -1

end{array}

right)

$$

существует бесконечное множество решений

$$

X=

left(

begin{array}{cc}

alpha & -(alpha^2+1)/beta \

beta & -alpha

end{array}

right) ,

$$

задаваемое двумя параметрами $ alpha $ и $ beta ne 0 $.

Т

Теорема 22. Решение уравнения

$$

X^2=A

$$

а) всегда существует при $ det A ne 0 $;

б) всегда существует среди вещественных симметричных матриц,

если $ A $ — симметричная и положительно полуопределенная.

Доказательство проведем только для б). Симметричная матрица $ A $

приводится к диагональному виду с помощью ортогональной матрицы:

$$

P^{^{top}}{mathbf A}P=

left( begin{array}{cccc}

lambda_1 & & & mathbb O \

& lambda_2 & & \

&& ddots & \

mathbb O && & lambda_n

end{array}

right) quad npu quad P^{^{top}}=P^{-1} .

$$

Легко видеть, что матрица

$$

X= P left( begin{array}{cccc}

sqrt{lambda_1} & & & mathbb O \

& sqrt{lambda_2} & & \

&& ddots & \

mathbb O&& & sqrt{lambda_n}

end{array}

right)P^{^{top}}

$$

является решением уравнения $ X^2=A $. Здесь под $ sqrt {.} $

понимается произвольное значение квадратного корня. Это значение будет

вещественным при $ lambda_jge 0 $. Если матрица $ A $ положительно

полуопределена, то все $ lambda_j $ неотрицательны.

Таким образом, последняя формула определяет вещественное решение; матрица $ X $

будет симметричной и может быть выбрана положительно полуопределенной.

♦

П

Пример. Вычислить

$$sqrt{

left( begin{array}{rrr}

24 & 6 & -12 \

6 &33 & 6\

-12 & 6 & 24

end{array}

right)

}

.

$$

Решение. $ det (A – lambda E) = – (lambda-9) (lambda -36)^2 $.

Поскольку матрица $ A $ симметрична, то привести ее к диагональному

виду можно с помощью ортогональной матрицы $ C $. Мы, однако же, используем

общий алгоритм диагонализации чтобы получить возможно

большее число ответов:

$$

{mathbf A}=

underbrace{

left( begin{array}{rrr}

1& 0& 2 \

2& 2 & -1\

0 & 1 & 2

end{array}

right)}_{C}

underbrace{

left( begin{array}{rrr}

36& 0& 0 \

0& 36 & 0\

0 & 0 & 9

end{array}

right)

}_{{mathbf A}_{mathfrak J}}

underbrace{

left( begin{array}{rrr}

5/9& 2/9& -4/9 \

-4/9 & 2/9 & 5/9 \

2/9 & -1/9 & 2/9

end{array}

right)}_{C^{-1}}

$$

$$

sqrt{{mathbf A}}=

underbrace{

left( begin{array}{rrr}

1& 0& 2 \

2& 2 & -1\

0 & 1 & 2

end{array}

right)}_{C}

underbrace{

left( begin{array}{rrr}

pm 6& 0& 0 \

0& pm 6 & 0\

0 & 0 & pm 3

end{array}

right)

}_{sqrt{{mathbf A}_{mathfrak J}}}

underbrace{

left( begin{array}{rrr}

5/9& 2/9& -4/9 \

-4/9 & 2/9 & 5/9 \

2/9 & -1/9 & 2/9

end{array}

right)

}_{C^{-1}}

$$

Ответ. $ sqrt{A}= $

$$

pmunderbrace{ frac{1}{3}left( begin{array}{rrr}

14& 2& -4 \

2 & 17 & 2 \

-4 & 2 & 14

end{array}

right)}_{+++ sqrt{A_{mathfrak J}}} ;

pmunderbrace{ frac{1}{3}left( begin{array}{rrr}

14& 2& -4 \

34 & 1 & -38 \

12 & -6 & -6

end{array}

right)}_{+-+ sqrt{A_{mathfrak J}}} ;

pmunderbrace{ left( begin{array}{rrr}

-2& -2& 4 \

-2 & -5 & -2 \

4 & -2 & -2

end{array}

right)}_{–+ sqrt{A_{mathfrak J}}} ;

$$

$$

pmunderbrace{ frac{1}{3}left( begin{array}{rrr}

6& 6& -12 \

38 & -1 & -34 \

4 & -2 & -14

end{array}

right)}_{+– sqrt{A_{mathfrak J}}} .

$$

Т

Теорема 23. Если $ A $ —симметричная матрица такая, что

-

она положительно определена;

-

матрица $ E-A $ положительно определена;

то рекуррентная матричная последовательность

$$ X_0=mathbb O, left{ X_{j}=X_{j-1}+frac{1}{2}(A-X_{j-1}^2) right}_{j=1}^{infty} $$

сходится к положительно определенному квадратному корню из $ A $.

Условия на матрицу $ A $ эквивалентны тому, что ее спектр целиком лежит в интервале $ [0,1] $ (следствие

☞

теоремы Коши ).

П

Пример. Для

$$

A=left(begin{array}{rrr}

0.541667 & 0.205342 & -0.372008 \

0.205342 & 0.811004 & 0.166667 \

-0.372008 & 0.166667 & 0.522329

end{array}

right)

$$

имеем (все матрицы — симметричные)

$$

X_0=mathbb O_{3times 3}, X_1=left(begin{array}{rrr}

0.2708335 & 0.102671 & -0.186004\

ast & 0.405502 & 0.083333\

ast & ast & 0.261164

end{array}

right), dots,

$$

$$

X_{12}=left(begin{array}{rrr}

0.640657 & 0.167720& -0.315098\

ast & 0.871895 & 0.147379\

ast & ast & 0.630487

end{array}

right)

$$

и

$$

X_{12}^2-A approx

left(begin{array}{rrr}

-0.004 & 0.0019 & -0.0038\

ast & -0.0009& 0.0019\

ast & ast & -0.0038

end{array}

right) , .

$$

Задачи

Источники

Демидович Б.П. Лекции по математической теории устойчивости. М.: Изд-во МГУ: ЧеРо, 1998

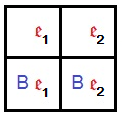

Тригонометрические функции от матрицы — обобщения тригонометрических функций для квадратных матриц.

Тригонометрические функции (особенно часто синус и косинус) от квадратных матриц возникают в решениях систем дифференциальных уравнений второго порядка.[1] Они определяются через те же ряды Тейлора, через которые определяются тригонометрические функции от вещественного или комплексного аргумента:[2]

- [math]displaystyle{ begin{align}

sin X & = X – frac{X^3}{3!} + frac{X^5}{5!} – frac{X^7}{7!} + cdots & = sum_{n=0}^infty frac{(-1)^n}{(2n+1)!}X^{2n+1} \

cos X & = I – frac{X^2}{2!} + frac{X^4}{4!} – frac{X^6}{6!} + cdots & = sum_{n=0}^infty frac{(-1)^n}{(2n)!}X^{2n}

end{align} }[/math]

где Xn означает матрицу X в степени n, а I — единичную матрицу той же размерности.

Также тригонометрические функции матричного аргумента могут быть определены через матричную экспоненту с учётом матричного аналога формулы Эйлера eiX = cos X + i sin X:

- [math]displaystyle{ begin{align}

sin X & = {e^{iX} – e^{-iX} over 2i} \

cos X & = {e^{iX} + e^{-iX} over 2}.

end{align} }[/math]

Например, пусть X — стандартная матрица Паули:

- [math]displaystyle{

sigma_1 = sigma_x =

begin{pmatrix}

0&1\

1&0

end{pmatrix} ~, }[/math]

Тогда

- [math]displaystyle{

sin(theta sigma_1) = sin(theta)~ sigma_1 , qquad cos (theta sigma_1) = cos (theta)~I~,

}[/math]

Можно вычислить и кардинальный синус:

- [math]displaystyle{ operatorname{sinc}( theta sigma_1) =operatorname{sinc}( theta) ~I. }[/math]

Свойства

Справедлив матричный аналог основного тригонометрического тождества:[2]

- [math]displaystyle{ sin^2 X + cos^2 X = I }[/math]

Если X является диагональной матрицей, sin X и cos X также являются диагональными матрицами, причём (sin X)nn = sin(Xnn) и (cos X)nn = cos(Xnn), то есть синус и косинус диагональной матрицы могут быть вычислены путём вычисления соответственно синусов и косинусов элементов аргумента на главной диагонали.

Матричные аналоги формул синуса и косинуса суммы справедливы тогда и только тогда, когда матрицы коммутируют, то есть XY = YX:[2]

- [math]displaystyle{ begin{align}

sin (X pm Y) = sin X cos Y pm cos X sin Y \

cos (X pm Y) = cos X cos Y mp sin X sin Y

end{align} }[/math]

Другие функции

Тангенс, обратные тригонометрические функции, гиперболические функции и обратные гиперболические функции так же могут быть определены и для матриц:[3]

- [math]displaystyle{ arcsin X = -i ln left( iX + sqrt{I-X^2} right) }[/math] (см. Обратные тригонометрические функции#Связь с натуральным логарифмом, Матричный логарифм[en], Квадратный корень из матрицы)

- [math]displaystyle{ begin{align}

sinh X & = {e^X – e^{-X} over 2} \

cosh X & = {e^X + e^{-X} over 2}

end{align} }[/math]

и так далее.

Примечания

- ↑ Gareth I. Hargreaves, Nicholas J. Higham. Efficient Algorithms for the Matrix Cosine and Sine (англ.) // Numerical Analysis Report : journal. — Manchester Centre for Computational Mathematics, 2005. — No. 461.

- ↑ 2,0 2,1 2,2 Nicholas J. Higham. Functions of matrices: theory and computation (англ.). — 2008. — P. 287f. — ISBN 9780898717778.

- ↑ Scilab trigonometry Архивная копия от 9 июля 2017 на Wayback Machine.

From Wikipedia, the free encyclopedia

The trigonometric functions (especially sine and cosine) for real or complex square matrices occur in solutions of second-order systems of differential equations.[1] They are defined by the same Taylor series that hold for the trigonometric functions of real and complex numbers:[2]

with Xn being the nth power of the matrix X, and I being the identity matrix of appropriate dimensions.

Equivalently, they can be defined using the matrix exponential along with the matrix equivalent of Euler’s formula, eiX = cos X + i sin X, yielding