Стандартное отклонение (англ. Standard Deviation) — простыми словами это мера того, насколько разбросан набор данных.

Вычисляя его, можно узнать, являются ли числа близкими к среднему значению или далеки от него. Если точки данных находятся далеко от среднего значения, то в наборе данных имеется большое отклонение; таким образом, чем больше разброс данных, тем выше стандартное отклонение.

Стандартное отклонение обозначается буквой σ (греческая буква сигма).

Стандартное отклонение также называется:

- среднеквадратическое отклонение,

- среднее квадратическое отклонение,

- среднеквадратичное отклонение,

- квадратичное отклонение,

- стандартный разброс.

Использование и интерпретация величины среднеквадратического отклонения

Стандартное отклонение используется:

- в финансах в качестве меры волатильности,

- в социологии в опросах общественного мнения — оно помогает в расчёте погрешности.

Пример:

Рассмотрим два малых предприятия, у нас есть данные о запасе какого-то товара на их складах.

| День 1 | День 2 | День 3 | День 4 | |

|---|---|---|---|---|

| Пред.А | 19 | 21 | 19 | 21 |

| Пред.Б | 15 | 26 | 15 | 24 |

В обеих компаниях среднее количество товара составляет 20 единиц:

- А -> (19 + 21 + 19+ 21) / 4 = 20

- Б -> (15 + 26 + 15+ 24) / 4 = 20

Однако, глядя на цифры, можно заметить:

- в компании A количество товара всех четырёх дней очень близко находится к этому среднему значению 20 (колеблется лишь между 19 ед. и 21 ед.),

- в компании Б существует большая разница со средним количеством товара (колеблется между 15 ед. и 26 ед.).

Если рассчитать стандартное отклонение каждой компании, оно покажет, что

- стандартное отклонение компании A = 1,

- стандартное отклонение компании Б ≈ 5.

Стандартное отклонение показывает эту волатильность данных — то, с каким размахом они меняются; т.е. как сильно этот запас товара на складах компаний колеблется (поднимается и опускается).

Расчет среднеквадратичного (стандартного) отклонения

Формулы вычисления стандартного отклонения

σ — стандартное отклонение,

xi — величина отдельного значения выборки,

μ — среднее арифметическое выборки,

n — размер выборки.

Эта формула применяется, когда анализируются все значения выборки.

S — стандартное отклонение,

n — размер выборки,

xi — величина отдельного значения выборки,

xср — среднее арифметическое выборки.

Эта формула применяется, когда присутствует очень большой размер выборки, поэтому на анализ обычно берётся только её часть.

Единственная разница с предыдущей формулой: “n — 1” вместо “n”, и обозначение “xср” вместо “μ”.

Разница между формулами S и σ (“n” и “n–1”)

Состоит в том, что мы анализируем — всю выборку или только её часть:

- только её часть – используется формула S (с “n–1”),

- полностью все данные – используется формула σ (с “n”).

Как рассчитать стандартное отклонение?

Пример 1 (с σ)

Рассмотрим данные о запасе какого-то товара на складах Предприятия Б.

| День 1 | День 2 | День 3 | День 4 | |

| Пред.Б | 15 | 26 | 15 | 24 |

Если значений выборки немного (небольшое n, здесь он равен 4) и анализируются все значения, то применяется эта формула:

Применяем эти шаги:

1. Найти среднее арифметическое выборки:

μ = (15 + 26 + 15+ 24) / 4 = 20

2. От каждого значения выборки отнять среднее арифметическое:

x1 – μ = 15 – 20 = -5

x2 – μ = 26 – 20 = 6

x3 – μ = 15 – 20 = -5

x4 – μ = 24 – 20 = 4

3. Каждую полученную разницу возвести в квадрат:

(x1 – μ)² = (-5)² = 25

(x2 – μ)² = 6² = 36

(x3 – μ)² = (-5)² = 25

(x4 – μ)² = 4² = 16

4. Сделать сумму полученных значений:

Σ (xi – μ)² = 25 + 36+ 25+ 16 = 102

5. Поделить на размер выборки (т.е. на n):

(Σ (xi – μ)²)/n = 102 / 4 = 25,5

6. Найти квадратный корень:

√((Σ (xi – μ)²)/n) = √ 25,5 ≈ 5,0498

Пример 2 (с S)

Задача усложняется, когда существуют сотни, тысячи или даже миллионы данных. В этом случае берётся только часть этих данных и анализируется методом выборки.

У Андрея 20 яблонь, но он посчитал яблоки только на 6 из них.

Популяция — это все 20 яблонь, а выборка — 6 яблонь, это деревья, которые Андрей посчитал.

| Яблоня 1 | Яблоня 2 | Яблоня 3 | Яблоня 4 | Яблоня 5 | Яблоня 6 |

| 9 | 2 | 5 | 4 | 12 | 7 |

Так как мы используем только выборку в качестве оценки всей популяции, то нужно применить эту формулу:

Математически она отличается от предыдущей формулы только тем, что от n нужно будет вычесть 1. Формально нужно будет также вместо μ (среднее арифметическое) написать X ср.

Применяем практически те же шаги:

1. Найти среднее арифметическое выборки:

Xср = (9 + 2 + 5 + 4 + 12 + 7) / 6 = 39 / 6 = 6,5

2. От каждого значения выборки отнять среднее арифметическое:

X1 – Xср = 9 – 6,5 = 2,5

X2 – Xср = 2 – 6,5 = –4,5

X3 – Xср = 5 – 6,5 = –1,5

X4 – Xср = 4 – 6,5 = –2,5

X5 – Xср = 12 – 6,5 = 5,5

X6 – Xср = 7 – 6,5 = 0,5

3. Каждую полученную разницу возвести в квадрат:

(X1 – Xср)² = (2,5)² = 6,25

(X2 – Xср)² = (–4,5)² = 20,25

(X3 – Xср)² = (–1,5)² = 2,25

(X4 – Xср)² = (–2,5)² = 6,25

(X5 – Xср)² = 5,5² = 30,25

(X6 – Xср)² = 0,5² = 0,25

4. Сделать сумму полученных значений:

Σ (Xi – Xср)² = 6,25 + 20,25+ 2,25+ 6,25 + 30,25 + 0,25 = 65,5

5. Поделить на размер выборки, вычитав перед этим 1 (т.е. на n–1):

(Σ (Xi – Xср)²)/(n-1) = 65,5 / (6 – 1) = 13,1

6. Найти квадратный корень:

S = √((Σ (Xi – Xср)²)/(n–1)) = √ 13,1 ≈ 3,6193

Дисперсия и стандартное отклонение

Стандартное отклонение равно квадратному корню из дисперсии (S = √D). То есть, если у вас уже есть стандартное отклонение и нужно рассчитать дисперсию, нужно лишь возвести стандартное отклонение в квадрат (S² = D).

Дисперсия — в статистике это “среднее квадратов отклонений от среднего”. Чтобы её вычислить нужно:

- Вычесть среднее значение из каждого числа

- Возвести каждый результат в квадрат (так получатся квадраты разностей)

- Найти среднее значение квадратов разностей.

Ещё расчёт дисперсии можно сделать по этой формуле:

S² — выборочная дисперсия,

Xi — величина отдельного значения выборки,

Xср (может появляться как X̅) — среднее арифметическое выборки,

n — размер выборки.

Правило трёх сигм

Это правило гласит: вероятность того, что случайная величина отклонится от своего математического ожидания более чем на три стандартных отклонения (на три сигмы), почти равна нулю.

Глядя на рисунок нормального распределения случайной величины, можно понять, что в пределах:

- одного среднеквадратического отклонения заключаются 68,26% значений (Xср ± 1σ или μ ± 1σ),

- двух стандартных отклонений — 95,44% (Xср ± 2σ или μ ± 2σ),

- трёх стандартных отклонений — 99,72% (Xср ± 3σ или μ ± 3σ).

Это означает, что за пределами остаются лишь 0,28% — это вероятность того, что случайная величина примет значение, которое отклоняется от среднего более чем на 3 сигмы.

Стандартное отклонение в excel

Вычисление стандартного отклонения с “n – 1” в знаменателе (случай выборки из генеральной совокупности):

1. Занесите все данные в документ Excel.

2. Выберите поле, в котором вы хотите отобразить результат.

3. Введите в этом поле “=СТАНДОТКЛОНА(“

4. Выделите поля, где находятся данные, потом закройте скобки.

5. Нажмите Ввод (Enter).

В случае если данные представляют всю генеральную совокупность (n в знаменателе), то нужно использовать функцию СТАНДОТКЛОНПА.

Коэффициент вариации

Коэффициент вариации — отношение стандартного отклонения к среднему значению, т.е. Cv = (S/μ) × 100% или V = (σ/X̅) × 100%.

Стандартное отклонение делится на среднее и умножается на 100%.

Можно классифицировать вариабельность выборки по коэффициенту вариации:

- при <10% выборка слабо вариабельна,

- при 10% – 20 % — средне вариабельна,

- при >20 % — выборка сильно вариабельна.

Узнайте также про:

- Корреляции,

- Метод Крамера,

- Метод наименьших квадратов,

- Теорию вероятностей

- Интегралы.

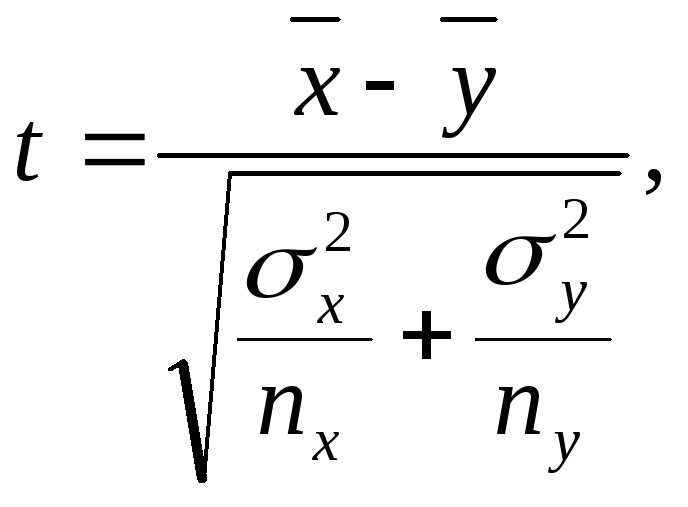

В отличие от критериев

Розенбаума и Манна-Уитни критерий t

Стьюдента является параметрическим,

т. е. основан на определении основных

статистических показателей – средних

значений в каждой выборке (и

)

и их дисперсий (s2x

и s2y),

рассчитываемых по стандартным формулам

(см. раздел 5).

Использование критерия

Стьюдента предполагает соблюдение

следующих условий:

-

Распределения значений

для обеих выборок должны соответствовать

закону нормального распределения (см.

раздел 6). -

Суммарный объем выборок

должен быть не менее 30 (для β1

= 0,95) и не менее 100 (для β2

= 0,99). -

Объемы двух выборок

не должны существенно отличаться друг

от друга (не более чем в 1,5 ÷ 2 раза).

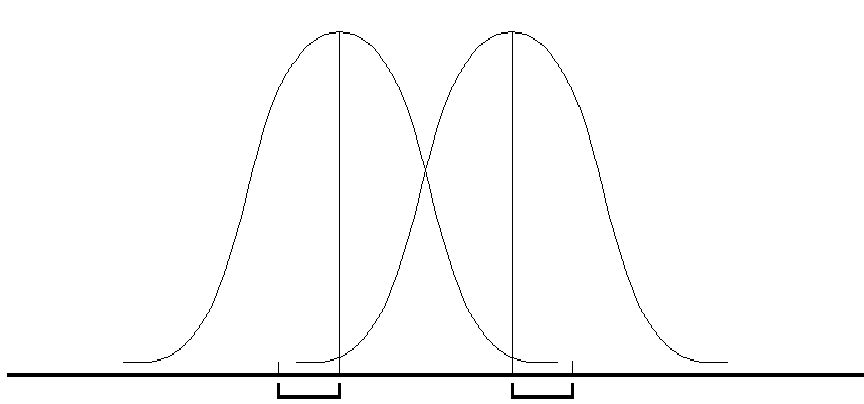

Идея критерия Стьюдента

достаточно проста. Предположим, что

значения переменных в каждой из выборок

распределяются по нормальному закону,

т. е. мы имеем дело с двумя нормальными

распределениями, отличающимися друг

от друга по средним значениям и дисперсии

(соответственно

и

,

и

,

см. рис. 7.1).

sx

sy

Рис.

7.1. Оценка различий между двумя независимыми

выборками:

и

–

средние значения выборок x

и y;

sx

и sy

–

стандартные отклонения

Нетрудно понять, что

различия между двумя выборками будут

тем больше, чем больше разность между

средними значениями и чем меньше их

дисперсии (или стандартные отклонения).

В

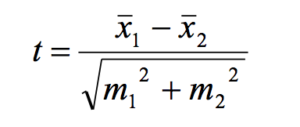

случае независимых выборок коэффициент

Стьюдента определяют по формуле:

где nx

и ny

– соответственно численность выборок

x

и y.

После вычисления

коэффициента Стьюдента в таблице

стандартных (критических) значений t

(см. Приложение, табл. Х) находят величину,

соответствующую числу степеней свободы

n

= nx

+ ny

– 2, и сравнивают

ее с рассчитанной по формуле. Если tэксп.

£

tкр.,

то гипотезу о достоверности различий

между выборками отвергают, если же

tэксп.

> tкр.,

то ее принимают. Другими словами, выборки

достоверно отличаются друг от друга,

если вычисленный по формуле коэффициент

Стьюдента больше табличного значения

для соответствующего уровня значимости.

В рассмотренной нами

ранее задаче вычисление средних значений

и дисперсий дает следующие значения:

xср.

= 38,5; σх2

= 28,40; уср.

= 36,2; σу2

= 31,72.

Можно видеть, что

среднее значение тревожности в группе

девушек выше, чем в группе юношей. Тем

не менее эти различия настолько

незначительны, что вряд ли они являются

статистически значимыми. Разброс

значений у юношей, напротив, несколько

выше, чем у девушек, но различия между

дисперсиями также невелики.

Подставляем

значения в формулу:

Вывод

tэксп.

= 1,14 < tкр.

= 2,05 (β1

= 0,95). Различия между двумя сравниваемыми

выборками не являются статистически

достоверными. Данный вывод вполне

согласуется с таковым, полученным при

использовании критериев Розенбаума и

Манна-Уитни.

Другой

способ определения различий между двумя

выборками по критерию Стьюдента состоит

в вычислении доверительного интервала

стандартных отклонений. Доверительным

интервалом называется среднеквадратичное

(стандартное) отклонение, деленное на

корень квадратный из объема выборки и

умноженное на стандартное значение

коэффициента Стьюдента для n

– 1 степеней свободы (соответственно,

и

).

Примечание

Величина

=mx

называется

среднеквадратичной ошибкой (см. раздел

5). Следовательно, доверительный интервал

есть среднеквадратичная ошибка,

умноженная на коэффициент Стьюдента

для данного объема выборки, где число

степеней свободы ν = n

– 1, и заданного уровня значимости.

Две

независимые друг от друга выборки

считаются достоверно различающимися,

если доверительные интервалы для этих

выборок не перекрываются друг с другом.

В нашем случае мы имеем для первой

выборки 38,5 ± 2,84, для второй 36,2 ± 3,38.

Следовательно,

случайные вариации xi

лежат в диапазоне 35,66 ¸

41,34, а вариации yi

– в диапазоне 32,82 ¸

39,58. На основании этого можно констатировать,

что различия между выборками x

и y

статистически недостоверны (диапазоны

вариаций перекрываются друг с другом).

При этом следует иметь в виду, что ширина

зоны перекрытия в данном случае не имеет

значения (важен лишь сам факт перекрытия

доверительных интервалов).

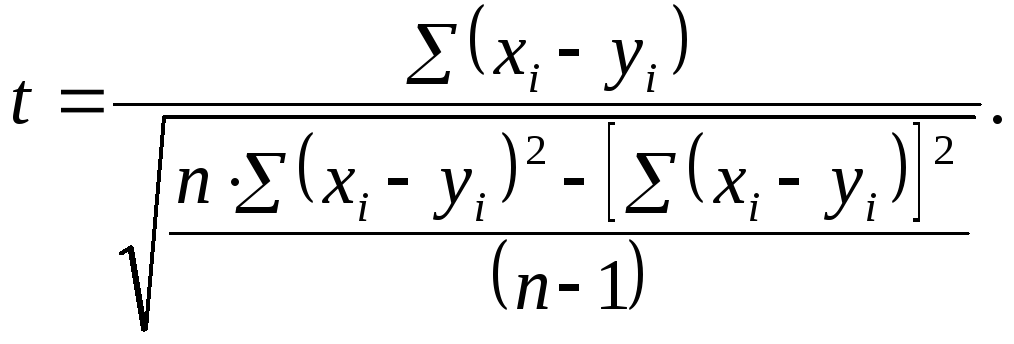

Метод

Стьюдента для зависимых друг от друга

выборок (например, для сравнения

результатов, полученных при повторном

тестировании на одной и той же выборке

испытуемых) используют достаточно

редко, поскольку для этих целей существуют

другие, более информативные статистические

приемы (см. раздел 10). Тем не менее, для

данной цели в первом приближении можно

использовать формулу Стьюдента следующего

вида:

Полученный результат

сравнивают с табличным значением для

n

– 1 степеней свободы, где n

– число пар значений x

и y.

Результаты сравнения интерпретируются

точно так же, как и в случае вычисления

различий между двумя независимыми

выборками.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

23.02.201514.96 Mб37Longman_Advanced_Learners_39_Grammar.pdf

- #

- #

- #

- #

- #

- #

- #

- #

- #

| Распределение Стьюдента | |

|---|---|

Плотность вероятности Плотность вероятности |

|

Функция распределения Функция распределения |

|

| Обозначение |

|

| Параметры |

— число степеней свободы — число степеней свободы |

| Носитель |

|

| Плотность вероятности |

|

| Функция распределения |

где где  — гипергеометрическая функция — гипергеометрическая функция |

| Математическое ожидание |

, если , если  |

| Медиана |

|

| Мода |

|

| Дисперсия |

, если , если  |

| Коэффициент асимметрии |

, если , если  |

| Коэффициент эксцесса |

, если , если  |

| Дифференциальная энтропия |

|

| Производящая функция моментов | не определена |

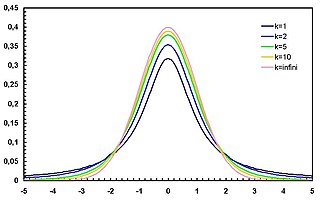

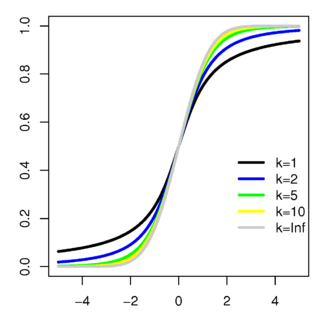

Распределе́ние Стью́дента (

Распределение Стьюдента играет важную роль в статистическом анализе и используется, например, в t-критерии Стьюдента для оценки статистической значимости разности двух выборочных средних, при построении доверительного интервала для математического ожидания нормальной совокупности при неизвестной дисперсии, а также в линейном регрессионном анализе. Распределение Стьюдента также появляется в байесовском анализе данных, распределённых по нормальному закону.

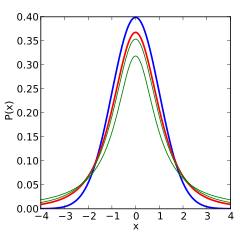

График плотности распределения Стьюдента, как и нормального распределения, является симметричным и имеет вид колокола, но с более «тяжёлыми» хвостами, то есть реализациям случайной величины, имеющей распределение Стьюдента, более свойственно сильно отличаться от математического ожидания. Это делает его важным для понимания статистического поведения определённых типов отношений случайных величин, в которых отклонение в знаменателе увеличено и может производить отдалённые величины, когда знаменатель соотношения близок к нулю.

Распределение Стьюдента — частный случай обобщённого гиперболического распределения.

История и этимология[править | править код]

В статистике t-распределение было впервые получено как апостериорное распределение в 1876 году Фридрихом Гельмертом[1][2][3] и Якобом Люротом[en][4][5][6].

В англоязычной литературе распределение берёт название из статьи Уильяма Госсета в журнале Пирсона «Биометрика», опубликованной под псевдонимом «Стьюдент»[7][8].

Госсет работал в пивоварне Гиннесс в Дублине, Ирландия, и применял свои знания в области статистики как при варке пива, так и на полях — для выведения самого урожайного сорта ячменя. Исследования были обращены к нуждам пивоваренной компании и проводились на малом количестве наблюдений, что послужило толчком для развития методов, работающих на малых выборках.

Госсету пришлось скрывать свою личность при публикации из-за того, что ранее другой исследователь, работавший на Гиннесс, опубликовал в своих материалах сведения, составлявшие коммерческую тайну компании, после чего Гиннесс запретил своим работникам публикацию любых материалов, независимо от содержавшейся в них информации.

Статья Госсета описывает распределение как «Частотное распределение стандартных отклонений выборок, извлечённых из генеральной совокупности». Оно стало известным благодаря работе Роналда Фишера, который называл распределение «распределением Стьюдента», а величину — буквой t[9].

Определение[править | править код]

Пусть

называется распределением Стьюдента с

Это распределение абсолютно непрерывно с плотностью:

,

где

для чётных

и соответственно

для нечётных

.

Также плотность распределения Стьюдента можно выразить воспользовавшись бета-функцией Эйлера

.

График функции плотности t-распределения симметричен, а его форма напоминает форму колокола, как у стандартного нормального распределения, но он ниже и шире.

Следующие графики отражают плотность t-распределения при увеличении числа

|

1 степень свободы |

2 степени свободы |

3 степени свободы |

|

5 степеней свободы |

10 степеней свободы |

30 степеней свободы |

Функция распределения[править | править код]

Функция распределения может быть выражена через регуляризованную неполную бета-функцию

Для

где

[10]

Для

Другая формула верна для

,

где 2F1 является частным случаем гипергеометрической функции.

Частные случаи[править | править код]

- Распределение Стьюдента с одной степенью свободы (

) это стандартное распределение Коши.

-

- Функция распределения:

- Плотность вероятности:

- Функция распределения:

- Распределение Стьюдента с двумя степенями свободы (

):

-

- Функция распределения:

- Плотность вероятности:

;

- Функция распределения:

- Распределение Стьюдента с тремя степенями свободы (

):

-

- Плотность вероятности:

- Плотность вероятности:

- Распределение Стьюдента с бесконечным числом степеней свободы (

):

-

- Плотность вероятности

- Плотность вероятности

совпадает с плотностью вероятности стандартного нормального распределения.

Свойства распределения Стьюдента[править | править код]

-

, если

нечётно;

, если

чётно. В частности,

Характеристики[править | править код]

Распределение Стьюдента с

,

где

Пусть,

– несмещённая оценка дисперсии.

Тогда случайная величина

имеет распределение хи-квадрат с

Случайная величина

Подставим получившиеся величины в величину

,

которая имеет распределение Стьюдента и отличается от

Распределение статистики критерия

Как возникает t-распределение[править | править код]

Выборочная дисперсия[править | править код]

Распределение Стьюдента возникает в связи с распределением выборочной дисперсии.

Пусть

.

С этим фактом связано использование распределения Стьюдента в статистике для точечного оценивания, построения доверительных интервалов и тестирования гипотез, касающихся неизвестного среднего выборки из нормального распределения.

Байесовская статистика[править | править код]

В байесовской статистике, нецентральное t-распределение встречается как маргинальное распределение коэффициента

Зависимость неизвестной дисперсии выражается через:

где

Когда данные неинформативны из теоремы Байеса следует

нормальное распределение и масштабированное обратное хи-квадрат распределение, где

.

Маргинализованный интеграл в таком случае имеет вид

после замены

получим

и оценку

это нестандартизированное t-распределение.

С помощью замены

Дифференцирование выше было представлено для случая неинформативной априорной вероятности для

Обобщения распределения Стьюдента[править | править код]

Нестандартизированное распределение Стьюдента[править | править код]

Распределение Стьюдента можно обобщить до семейства функций с тремя параметрами, включающими коэффициент сдвига

или

,

где

Плотность нестандартизированного распределения Стьюдента представляет собой репараметризованное распределение Пирсона типа VII и определяется следующим выражением[13]

Здесь

В байесовском выводе предельное распределение неизвестного среднего значения

Такое распределение является результатом комбинации распределения Гаусса (нормального распределения) со средним значением

Эквивалентно, это распределение является результатом комбинации распределения Гаусса с масштабированным обратным хи-квадрат распределением с параметрами

Альтернативная параметризация на основании обратного параметра масштабирования λ[14] (аналогично тому, как мера точности обратна дисперсии), определенная отношением

тогда плотность определяется как

Свойства:

Это распределение является результатом комбинации распределения Гаусса со средним

Нецентральное распределение Стьюдента[править | править код]

Нецентральное распределение Стьюдента, это один способов обобщения стандартного распределения Стьюдента, включающий дополнительный коэффициент сдвига (параметр нецентральности)

В нецентральном распределении Стьюдента медиана не совпадает с модой, т.е. оно не симметрично (в отличие от нестандартизированного).

Это распределение важно для изучения статистической мощности t-критерия Стьюдента.

Дискретное распределение Стьюдента[править | править код]

Дискретное распределение Стьюдента имеет следующую функцию распределения с r пропорциональным:[15]

Где a, b, и k – параметры. Такое распределение возникает при работе с системами из дискретных распределений, таких как распределение Пирсона.[16]

Связь с другими распределениями[править | править код]

Обобщение распределения Гаусса[править | править код]

Мы можем получить выборку с t-распределением, взяв отношение величин из нормального распределения и квадратный корень из распределения хи-квадрат.

где

Если мы вместо нормального распределения, возьмём например, Ирвин-Холл, получится симметричное распределение с 4 параметрами, которое включает в себя нормальное, равномерное, треугольное, а также распределения Стьюдента и Коши; таким образом, это обобщение более гибкое, чем многие другие симметричные обобщения распределения Гаусса.

Применение распределения Стьюдента[править | править код]

Проверка гипотезы[править | править код]

Некоторые статистики могут иметь распределение Стьюдента на выборках небольшого размера, поэтому распределение Стьюдента формирует основу критериев значимости. Например, тест ранговой корреляции Спирмена ρ, в нулевом случае (нулевая корреляция) хорошо аппроксимируется распределением Стьюдента при размере выборки больше 20.

Построение доверительного интервала[править | править код]

Распределение Стьюдента может быть использовано для оценки того, насколько вероятно, что истинное среднее находится в каком-либо заданном диапазоне.

Предположим, что число A выбрано так, что

Тогда T имеет t-распределение с n–1 степенями свободы. В силу симметрии распределения, это равноценно утверждению, что А удовлетворяет

что эквивалентно

таким образом, интервал с доверительным пределом в точках

Такой подход применяется в t-критерии Стьюдента: если разность между средними значениями выборок из двух нормальных распределений сама может быть нормально распределена, распределение Стьюдента может быть использовано для исследования того, можно ли с большой долей вероятности полагать эту разность равной нулю.

Для нормально распределённых выборок односторонний (1−a) верхний доверительный предел (UCL) среднего значения равен

Полученный в результате верхний доверительный предел будет наибольшим средним значением для данного доверительного интервала и размера выборки. Другими словами, если

Построение интервала-предиктора[править | править код]

Распределение Стьюдента может быть использовано для получения интервала-предиктора для ненаблюдаемой выборки из нормального распределения с неизвестным средним и дисперсией.

В байесовской статистике[править | править код]

Распределение Стьюдента, особенно нецентральное, часто возникает в байесовской статистике как результат связи с нормальным распределением.

Действительно, если нам неизвестна дисперсия нормально распределенной случайной величины, но известно сопряженное априорное распределение, можно будет подобрать такое гамма-распределение, что полученные в результате величины будут обладать распределением Стьюдента.

Эквивалентные конструкции с теми же результатами включают сопряжённое масштабированное обратное хи-квадратное распределение. Если некорректное априорное распределение, пропорциональное

Параметрическое моделирование, устойчивое к нарушениям исходных предпосылок[править | править код]

Распределение Стьюдента часто используется в качестве альтернативы нормальному распределению для модели данных.[18] Это происходит из-за того, что довольно часто настоящие данные имеют более тяжелые хвосты, чем позволяет нормальное распределение. Классический подход заключается в определении выбросов и их исключении (или понижении их веса). Однако не всегда легко определить выброс (особенно в задачах с большой размерностью), и распределение Стьюдента является естественным выбором, обеспечивающим параметрический подход к робастной статистике.

Ланж и другие исследовали использование распределения Стьюдента для робастного (устойчивого к нарушениям исходных предпосылок) моделирования данных. Байесовский расчет обнаруживается у Гельмана и др.

Количество степеней свободы контролирует эксцесс распределения и коррелируется с параметром масштабирования.

Некоторые другие свойства распределения Стьюдента[править | править код]

Пусть,

Функция

Это используется например, в T-критерии Стьюдента. Для t-распределения с

где Ix – регуляризированная неполная бета функция (a, b).

При статистической проверки гипотез эта функция используется для построения р-значения.

Выборка по методу Монте-Карло[править | править код]

Есть разные подходы к получению случайных величин из распределения Стьюдента. Всё зависит от того, требуются независимые выборки, или они могут быть построены путём применения обратной функции распределения над выборкой с однородным распределением.

В случае с независимой выборкой легко применить расширение метода Бокса-Мюллера в его полярной (тригонометрической) форме[19]. Преимущество этого метода в том, что он одинаково относится ко всем положительным степеням свободы

Плотность распределения Стьюдента через решение дифференциального уравнения[править | править код]

Плотность распределения Стьюдента можно получить, решив следующее дифференциальное уравнение:

Процентили[править | править код]

Таблицы значений[править | править код]

Многие учебники по статистике включают в себя таблицы распределения Стьюдента.

В наши дни лучший способ узнать полностью точное критическое значение t или кумулятивную вероятность — это использование статистической функции, встроенной в электронные таблицы (Office Excel, OpenOffice Calc и т.д.), или интерактивного веб-калькулятора. Нужные функции электронных таблиц — TDIST и TINV.

Таблица ниже включает в себя значения некоторых значений для распределений Стьюдента с v степенями свободы для ряда односторонних или двусторонних критических областей.

В качестве примера того, как читать эту таблицу, возьмём четвёртый ряд, который начинается с 4; это означает, что v, количество степеней свободы, равно 4 (и если мы работаем, как это показано выше, с n величин с фиксированной суммой, то n = 5). Возьмём пятое значение в колонке 95% для односторонних(90% для двусторонних). Значение это равно “2.132”. Значит, вероятность, что T меньше 2.132 равна 95% или Pr(−∞ <T< 2.132) = 0.95; это также означает, что Pr(−2.132 <T< 2.132) = 0.9.

Это может быть вычислено по симметрии распределения,

- Pr(T < −2.132) = 1 − Pr(T > −2.132) = 1 − 0.95 = 0.05,

получаем

- Pr(−2.132 < T < 2.132) = 1 − 2(0.05) = 0.9.

Обратите внимание, что последний ряд также даёт критические точки: распределение Стьюдента с бесконечным количеством степеней – это нормальное распределение.

Первая колонка отображает число степеней свободы.

| односторонний | 75% | 80% | 85% | 90% | 95% | 97.5% | 99% | 99.5% | 99.75% | 99.9% | 99.95% |

|---|---|---|---|---|---|---|---|---|---|---|---|

| двусторонний | 50% | 60% | 70% | 80% | 90% | 95% | 98% | 99% | 99.5% | 99.8% | 99.9% |

| 1 | 1.000 | 1.376 | 1.963 | 3.078 | 6.314 | 12.71 | 31.82 | 63.66 | 127.3 | 318.3 | 636.6 |

| 2 | 0.816 | 1.080 | 1.386 | 1.886 | 2.920 | 4.303 | 6.965 | 9.925 | 14.09 | 22.33 | 31.60 |

| 3 | 0.765 | 0.978 | 1.250 | 1.638 | 2.353 | 3.182 | 4.541 | 5.841 | 7.453 | 10.21 | 12.92 |

| 4 | 0.741 | 0.941 | 1.190 | 1.533 | 2.132 | 2.776 | 3.747 | 4.604 | 5.598 | 7.173 | 8.610 |

| 5 | 0.727 | 0.920 | 1.156 | 1.476 | 2.015 | 2.571 | 3.365 | 4.032 | 4.773 | 5.893 | 6.869 |

| 6 | 0.718 | 0.906 | 1.134 | 1.440 | 1.943 | 2.447 | 3.143 | 3.707 | 4.317 | 5.208 | 5.959 |

| 7 | 0.711 | 0.896 | 1.119 | 1.415 | 1.895 | 2.365 | 2.998 | 3.499 | 4.029 | 4.785 | 5.408 |

| 8 | 0.706 | 0.889 | 1.108 | 1.397 | 1.860 | 2.306 | 2.896 | 3.355 | 3.833 | 4.501 | 5.041 |

| 9 | 0.703 | 0.883 | 1.100 | 1.383 | 1.833 | 2.262 | 2.821 | 3.250 | 3.690 | 4.297 | 4.781 |

| 10 | 0.700 | 0.879 | 1.093 | 1.372 | 1.812 | 2.228 | 2.764 | 3.169 | 3.581 | 4.144 | 4.587 |

| 11 | 0.697 | 0.876 | 1.088 | 1.363 | 1.796 | 2.201 | 2.718 | 3.106 | 3.497 | 4.025 | 4.437 |

| 12 | 0.695 | 0.873 | 1.083 | 1.356 | 1.782 | 2.179 | 2.681 | 3.055 | 3.428 | 3.930 | 4.318 |

| 13 | 0.694 | 0.870 | 1.079 | 1.350 | 1.771 | 2.160 | 2.650 | 3.012 | 3.372 | 3.852 | 4.221 |

| 14 | 0.692 | 0.868 | 1.076 | 1.345 | 1.761 | 2.145 | 2.624 | 2.977 | 3.326 | 3.787 | 4.140 |

| 15 | 0.691 | 0.866 | 1.074 | 1.341 | 1.753 | 2.131 | 2.602 | 2.947 | 3.286 | 3.733 | 4.073 |

| 16 | 0.690 | 0.865 | 1.071 | 1.337 | 1.746 | 2.120 | 2.583 | 2.921 | 3.252 | 3.686 | 4.015 |

| 17 | 0.689 | 0.863 | 1.069 | 1.333 | 1.740 | 2.110 | 2.567 | 2.898 | 3.222 | 3.646 | 3.965 |

| 18 | 0.688 | 0.862 | 1.067 | 1.330 | 1.734 | 2.101 | 2.552 | 2.878 | 3.197 | 3.610 | 3.922 |

| 19 | 0.688 | 0.861 | 1.066 | 1.328 | 1.729 | 2.093 | 2.539 | 2.861 | 3.174 | 3.579 | 3.883 |

| 20 | 0.687 | 0.860 | 1.064 | 1.325 | 1.725 | 2.086 | 2.528 | 2.845 | 3.153 | 3.552 | 3.850 |

| 21 | 0.686 | 0.859 | 1.063 | 1.323 | 1.721 | 2.080 | 2.518 | 2.831 | 3.135 | 3.527 | 3.819 |

| 22 | 0.686 | 0.858 | 1.061 | 1.321 | 1.717 | 2.074 | 2.508 | 2.819 | 3.119 | 3.505 | 3.792 |

| 23 | 0.685 | 0.858 | 1.060 | 1.319 | 1.714 | 2.069 | 2.500 | 2.807 | 3.104 | 3.485 | 3.767 |

| 24 | 0.685 | 0.857 | 1.059 | 1.318 | 1.711 | 2.064 | 2.492 | 2.797 | 3.091 | 3.467 | 3.745 |

| 25 | 0.684 | 0.856 | 1.058 | 1.316 | 1.708 | 2.060 | 2.485 | 2.787 | 3.078 | 3.450 | 3.725 |

| 26 | 0.684 | 0.856 | 1.058 | 1.315 | 1.706 | 2.056 | 2.479 | 2.779 | 3.067 | 3.435 | 3.707 |

| 27 | 0.684 | 0.855 | 1.057 | 1.314 | 1.703 | 2.052 | 2.473 | 2.771 | 3.057 | 3.421 | 3.690 |

| 28 | 0.683 | 0.855 | 1.056 | 1.313 | 1.701 | 2.048 | 2.467 | 2.763 | 3.047 | 3.408 | 3.674 |

| 29 | 0.683 | 0.854 | 1.055 | 1.311 | 1.699 | 2.045 | 2.462 | 2.756 | 3.038 | 3.396 | 3.659 |

| 30 | 0.683 | 0.854 | 1.055 | 1.310 | 1.697 | 2.042 | 2.457 | 2.750 | 3.030 | 3.385 | 3.646 |

| 40 | 0.681 | 0.851 | 1.050 | 1.303 | 1.684 | 2.021 | 2.423 | 2.704 | 2.971 | 3.307 | 3.551 |

| 50 | 0.679 | 0.849 | 1.047 | 1.299 | 1.676 | 2.009 | 2.403 | 2.678 | 2.937 | 3.261 | 3.496 |

| 60 | 0.679 | 0.848 | 1.045 | 1.296 | 1.671 | 2.000 | 2.390 | 2.660 | 2.915 | 3.232 | 3.460 |

| 80 | 0.678 | 0.846 | 1.043 | 1.292 | 1.664 | 1.990 | 2.374 | 2.639 | 2.887 | 3.195 | 3.416 |

| 100 | 0.677 | 0.845 | 1.042 | 1.290 | 1.660 | 1.984 | 2.364 | 2.626 | 2.871 | 3.174 | 3.390 |

| 120 | 0.677 | 0.845 | 1.041 | 1.289 | 1.658 | 1.980 | 2.358 | 2.617 | 2.860 | 3.160 | 3.373 |

| ∞ | 0.674 | 0.842 | 1.036 | 1.282 | 1.645 | 1.960 | 2.326 | 2.576 | 2.807 | 3.090 | 3.291 |

Например, если нам дана выборка с выборочной дисперсией 2 и выборочным средним 10, взятая из выборочного набора 11 (10 степеней свободы), используя формулу

Мы можем определить с 90% уровнем доверия, что истинное среднее таково:

(то есть, в среднем, в 90% случаев верхний предел превышает истинное среднее)

и, всё также с 90% уверенностью, мы находим истинное среднее значение, превышающее

(В среднем, в 90% случаев нижний предел меньше истинного среднего)

Так что с 80% уверенностью (1-2*(1-90%) = 80%), мы находим истинное значение, лежащее в интервале

Другими словами, в 80% случаев истинное среднее ниже верхнего предела и выше нижнего предела.

Это не эквивалентно утверждению, что с 80% вероятностью истинное среднее лежит между определенной парой верхних и нижних пределов.

Обобщение[править | править код]

Обобщением распределения Стьюдента является обобщённое гиперболическое распределение.

Примечания[править | править код]

- ↑ Helmert, F. R. (1875). “Über die Bestimmung des wahrscheinlichen Fehlers aus einer endlichen Anzahl wahrer Beobachtungsfehler”. Z. Math. Phys., 20, 300–3.

- ↑ Helmert, F. R. (1876a). “Über die Wahrscheinlichkeit der Potenzsummen der Beobachtungsfehler und uber einige damit in Zusammenhang stehende Fragen”. Z. Math. Phys., 21, 192–218.

- ↑ Helmert, F. R. (1876b). “Die Genauigkeit der Formel von Peters zur Berechnung des wahrscheinlichen Beobachtungsfehlers directer Beobachtungen gleicher Genauigkeit”, Astron. Nachr., 88, 113–32.

- ↑ Lüroth, J. Vergleichung von zwei Werten des wahrscheinlichen Fehlers (нем.) // Astron. Nachr. : magazin. — 1876. — Bd. 87, Nr. 14. — S. 209—220. — doi:10.1002/asna.18760871402. — Bibcode: 1876AN…..87..209L.

- ↑ Pfanzagl, J.; Sheynin, O. A forerunner of the t-distribution (Studies in the history of probability and statistics XLIV) (англ.) // Biometrika : journal. — 1996. — Vol. 83, no. 4. — P. 891—898. — doi:10.1093/biomet/83.4.891.

- ↑ Sheynin, O. Helmert’s work in the theory of errors (англ.) // Arch. Hist. Exact Sci. : journal. — 1995. — Vol. 49. — P. 73—104. — doi:10.1007/BF00374700.

- ↑ “Student” [William Sealy Gosset]. The probable error of a mean (англ.) // Biometrika : journal. — 1908. — March (vol. 6, no. 1). — P. 1—25. — doi:10.1093/biomet/6.1.1.

- ↑ “Student” (William Sealy Gosset), original Biometrika paper as a scan Архивная копия от 5 марта 2016 на Wayback Machine

- ↑ 1 2 Рональд Фишер. Applications of “Student’s” distribution (англ.) // metron. — 1925. — Vol. 5. — P. 90—104. Архивировано 5 марта 2016 года.

- ↑ 1 2 3 Johnson, N.L., Kotz, S., Balakrishnan, N. глава 28 // Continuous Univariate Distributions, Volume 2, 2nd Edition.. — 1995. — ISBN 0-471-58494-0.

- ↑ Hogg & Craig (1978, Sections 4.4 and 4.8.)

- ↑ W. G. Cochran. The distribution of quadratic forms in a normal system, with applications to the analysis of covariance // Mathematical Proceedings of the Cambridge Philosophical Society. — 1934-04-01. — Т. 30, вып. 02. — С. 178—191. — ISSN 1469-8064. — doi:10.1017/S0305004100016595.

- ↑ Simon Jackman. Bayesian Analysis for the Social Sciences. — Wiley. — 2009. — С. 507.

- ↑ Bishop C.M. Pattern recognition and machine learning. — Springer. — 2006.

- ↑ Ord, J.K. (1972) Families of Frequency Distributions, Griffin. ISBN 0-85264-137-0 (Table 5.1)

- ↑ Ord, J.K. (1972) Families of Frequency Distributions, Griffin. ISBN 0-85264-137-0 (Chapter 5)

- ↑ Королюк, 1985, с. 134.

- ↑ Kenneth L. Lange, Roderick J. A. Little, Jeremy M. G. Taylor. Robust Statistical Modeling Using the t Distribution // Journal of the American Statistical Association. — 1989-12-01. — Т. 84, вып. 408. — С. 881—896. — ISSN 0162-1459. — doi:10.1080/01621459.1989.10478852.

- ↑ 1 2 Ralph W. Bailey. Polar Generation of Random Variates with the t-Distribution // Mathematics of Computation. — 1994-01-01. — Т. 62, вып. 206. — С. 779—781. — doi:10.2307/2153537. Архивировано 3 апреля 2016 года.

Литература[править | править код]

- Королюк В. С., Портенко Н. И., Скороход А. В., Турбин А. Ф. Справочник по теории вероятностей и математической статистике. — М.: Наука, 1985. — 640 с.

Т-критерий Стьюдента (t-тест) простым языком

Сегодня мы говорим о t-критерии. Т-критерий наиболее популярный статистический тест в биомедицинских исследованиях. Также его называют парный Т-критерий Стьюдента, t-test, two-sample unpaired t-test. Однако, при использовании этого статистического инструмента допускается достаточно много ошибок. Сегодня в этой статье мы постараемся разобраться, как избежать ошибок применения t-критерия Стьюдента, как интерпретировать его результаты и как рассчитывать t-критерий самостоятельно. Об этом обо всем читайте далее.

При описании любого статистического критерия, будь то t-критерий Стьюдента, либо какой-либо еще, нужно вспомнить о том, как же вообще используются статистические критерии. Для того, чтобы понять, как используется любой критерий, нужно перейти к нескольким достаточно логичным для понимания этапам:

Этапы статистического вывода (statistic inference)

- Первый из них – это вопрос, который мы хотим изучить с помощью статистических методов. То есть первый этап: что изучаем? И какие у нас есть предположения относительно результата? Этот этап называется этап статистических гипотез.

- Второй этап – нужно определиться с тем, какие у нас есть в реальности данные для того, чтобы ответить на первый вопрос. Этот этап – тип данных.

- Третий этап состоит в том, чтобы выбрать корректный для применения в данной ситуации статистический критерий.

- Четвертый этап это логичный этап применения интерпретации любой формулы, какие результаты мы получили.

- Пятый этап это создание, синтез выводов относительно первого, второго, третьего, четвертого, пятого этапа, то есть что же получили и что же это в реальности значит.

Предлагаю долго не ходить вокруг да около и посмотреть применение t-критерия Стьюдента на реальном примере.

Видео-версия статьи

Пример использования т-критерия Стьюдента

А пример будет достаточно простой: мне интересно, стали ли люди выше за последние 100 лет. Для этого нужно подобрать некоторые данные. Я обнаружил интересную информацию в достаточно известной статье The Guardian (Tall story’s men and women have grown taller over last century, Study Shows (The Guardian, July 2016), которая сравнивает средний возраст человека в разных странах в 1914 году и в аналогичных странах в 2014 году.

Там приведены данные практически по всем государствам. Однако, я взял лишь 5 стран для простоты вычислений: это Россия, Германия, Китай, США и ЮАР, соответственно 1914 год и 2014 год.

Общее количество наблюдений – 5 в 1914 году в группе 1914 года и общее значение также 5 в 2014 году. Будем думать опять же для простоты, что эти данные сопоставимы, и с ними можно работать.

Дальше нужно выбрать критерии – критерии, по которым мы будем давать ответ. Равны ли средние по росту в 1914 году x̅1914 и в 2014 году x̅2014. Я считаю, что нет. Поэтому моя гипотеза это то, что они не равны (x̅1914≠x̅2014). Соответственно альтернативная гипотеза моему предположению, так называемая нулевая гипотеза (нулевая гипотеза консервативна, обратная вашей, часто говорит об отсутствии статистически значимых связей/зависимостей) будет говорить о том, что они между собой на самом деле равны (x̅1914=x̅2014), то есть о том, что все эти находки случайны, и я, по сути, не прав.

Теперь нужно дать какой-то аргументированный ответ. Даем его с помощью статистического критерия. Соответственно теперь наступает самое важное: как выбрать статистический критерий? Я думаю, это будет темой отдельной статьи. Для корректности использования t-критерия Стьюдента лишь скажу, что нужно, чтобы:

Условия применения статистического критерия т-теста (критерия Стьюдента)

— данные распределялись по закону нормального распределения;

— данные были количественными;

— и это две независимые между собой выборки (независимые это значит, что в этих группах разные люди, а никак, например, до и после применения препарата у одной группы, люди должны быть разными, тогда группы являются несвязанными, либо независимыми), этот аспект стоит учитывать для выбора вида т-критерия Стьюдента, так как для парных выборок существует свой парный т-критерий (paired t-test).

В итоге Мы определились с тем, что это будет t-критерий Стьюдента.

Формула t-критерия Стьюдента достаточно простая. Она гласит о том, что в числителе у нас разница средних, в знаменателе у нас корень квадратный суммы ошибок репрезентативности по этим группам:

Ошибки репрезентативности были подробно объяснены мною в статье по доверительным интервалам. Поэтому я рекомендую вам ознакомиться с ней, чтобы лучше разобраться, что такое ошибки репрезентативности, что такое выборка, как она соотносится с генеральной совокупностью.

Для того, чтобы не тратить время, я в принципе все уже рассчитал по каждой из групп: средняя (x̅) ,стандартное отклонение (SD) и ошибка репрезентативности (mr).

Давайте остановимся на том, что же значат эти значения:

— средняя (x̅) это среднеарифметическое по 5 наблюдениям в каждой группе;

— если совсем упрощать значение стандартного отклонения (SD), то можно сказать, что оно представляет собой обобщенную среднюю отклонения каждого значения от среднего (стандартное отклонение показывает, насколько широко значения рассеяны (разбросаны) относительно средней). И дальше мы находим нечто среднее отклонений каждого варианта в группе от среднего;

— и ошибка репрезентативности она тоже находится достаточно просто: это как раз наше отклонение от средней некоторое стандартизованное, поэтому стандартное отклонение на размер выборки (mr=).

Итак, продолжаем. В ходе подстановки каждого значения в нашу формулу, мы находим, что t-критерий Стьюдента равен 3,78. Однако, я думаю, пока тем, кто не знаком со статистическими критериями, это мало о чем говорит.

Итак, теперь настает четвертый этап вопрос интерпретации. Ранее мы получили значение t-критерия в 3,78. Однако, что же это значит? Стоит отметить, что результаты статистических критериев и вообще их интерпретация не говорит о точном «да», либо «нет» в выводе, то есть рост отличается, либо рост не отличается. Всегда это вопрос определенной доли вероятности – доли вероятности ошибиться при констатации положительного результата (речь об ошибке первого рода (I type error, Alpha)). То есть, например, если мы скажем, что средний рост в начале ХХ и в начале XXI века отличаются с долей ошибкой меньше 5 %. Как раз эта величина в 5 % и фиксируется как достаточная для большинства биомедицинских исследований, помните, р больше, либо меньше 0,05.

Итак, как нам перейти от нашей t к р вероятности? Это сделать достаточно просто, стоит лишь воспользоваться табличными значениями t для определенных степеней свободы. Теперь вопрос: как найти эти степени свободы? Но это сделать достаточно просто. Для того, чтобы обнаружить степени свободы для наших групп, нужно лишь сложить количество наблюдений 5 и 5 в нашем случае и вычесть 2. В нашем случае степень свободы равна 8.

Итак, t=3,78, степень свободы равна 8. Переходим в табличное значение и получаем р вероятность – вероятность равна 0,005. То есть вероятность того, что мы ошибаемся при констатации факта различия роста ранее и сейчас, крайне мала – это 0,005 %, не 5 %, а 0,005 %. То есть мы можем говорить с высокой долей достоверности того, что наш рост сейчас в XXI веке и 100 лет назад отличаются.

Вот то, что касается расчета t-критерия Стьюдента и его интерпретации.

На этом наш разговор о t-критерии Стьюдента закончен. Спасибо, что ознакомились с этой статьей. Я очень надеюсь на вашу обратную связь. Пожалуйста, подписывайтесь на наш сайте, ставьте лайки, предлагайте свои темы для следующих выпусков. Спасибо большое за поддержку. С вами был Кирилл Мильчаков. Пока, до новых встреч!

Если Вам понравилась статья и оказалась полезной, Вы можете поделиться ею с коллегами и друзьями в социальных сетях:

Определение 2.13

Стандартным отклонением выборки x1, x2, …, xn называется число S, которое вычисляется по формуле:

.

Таким образом, выборочное стандартное отклонение

равно квадратному корню из выборочной дисперсии, следовательно, справедливы

формулы:

Пример 2.21 В течение пяти

дней студент Ковалев записывал стоимость обедов в студенческой столовой: 3,2;

4,8; 5,6; 4,5; 5,4. Найдем выборочную дисперсию и стандартное отклонение.

Сначала определим среднее:

Вычислим дисперсию:

Найдем стандартное отклонение:

Округлим полученное значение: S =

0,95 условных рублей.

■

Определение 2.14 Выборочной

дисперсией вариационного ряда x1, x2, …, xn с

соответствующими частотами называется число

, определяемое формулой:

соответственно, при малом и большом значении n,где .

Пример

2.22 Для социологического

исследования были собраны данные о количественном составе 20 семей, приведенные

в следующей таблице.

Таблица 2.16 – Количественный

состав семей

|

Количество членов семьи |

1 2 3 |

|

|

2 3 8 |

Найдем среднее, дисперсию и стандартное отклонение:

n = 2 + 3 + 8 + 5 + 1 + 1 = 20;

.

Округлим S2 = 1,50 и S = 1,23. Итак, – это среднее число членов семьи, S = 1,23 – это стандартное

отклонение от среднего.

■

Определение 2.15 Выборочной

дисперсией статистического ряда, состоящего из k

интервалов с соответствующими интервальными средними и

интервальными частотами , называется число

, равное:

соответственно, при малом и большом значении n,

где .

Пример

2.23 Результаты экзамена по высшей

математике пятидесяти студентов представлены следующим статистическим рядом.

Используется десятибалльная система оценок. Найдем среднее и стандартное

отклонение.

Таблица 2.17 – Итоги экзамена по высшей математике

|

Оценка |

0–2 |

2–4 |

4–6 |

6–8 |

8–1 |

|

|

3 |

9 |

16 |

14 |

8 |

Итак,

Найдем интервальные средние:

Вычислим среднее:

Найдем

дисперсию данной выборки:

стандартного отклонения:

.

Итак, средняя оценка студентов I

курса составляет 5,6 баллов. Стандартное отклонение баллов

показывает, что оценки большинства студентов отличаются от среднего не более,

чем на 2,26 баллов.

■

Таким образом, для вычисления

выборочной дисперсии необходимо найти значение среднего , вычислить

сумму квадратов отклонений выборочный значений от среднего и разделить ее на n –

1, где n – число всех наблюдений. Извлечение квадратного корня

при нахождении стандартного отклонения возвращает к первоначальному масштабу

единицы измерения.

Обработка и анализ статических

данных требует кропотливой и нелегкой вычислительной работы. Для организации

вычислений в математической статистике часто используются специальные таблицы.

Пример 2.24 Найдем среднее и стандартное

отклонение для статистического ряда из примера 1.4 о высоте городских зданий.

Все необходимые вычисления будем записывать в таблицу 2.18.

Из таблицы 2.18

берем необходимые промежуточные результаты:

Итак, среднее высоты зданий равно 27,12

метров, а стандартное отклонение равно 9,96 метров.

Таблица 2.18 – Вычисление среднего и

стандартного отклонения высоты зданий

|

Высота |

Интервальное среднее |

Частота |

|

|

|

|

|

5–10 10–15 15–20 20–25 25–30 30–35 35–40 40–45 35–50 |

7,5 12,5 17,5 22,5 27,5 32,5 37,5 42,5 47,5 |

2 3 5 6 8 7 5 3 1 |

15 37,5 87,5 135 220 227,5 187,5 127,5 47,5 |

-19,625 -14,625 -9,625 -4,625 0,375 5,375 10,375 15,375 20,375 |

385,14062 213,89062 92,64065 21,390625 0,140625 28,890625 107,64062 236,39062 415,14062 |

770,28124 641,67186 463,20312 128,34375 1,12500 202,23437 538,20310 709,17186 415,14062 |

|

Сумма |

40 |

1085 |

3869,3447 |

Уважаемый посетитель!

Чтобы распечатать файл, скачайте его (в формате Word).

Ссылка на скачивание – внизу страницы.

![{begin{matrix}{frac {n+1}{2}}left[psi ({frac {1+n}{2}})-psi ({frac {n}{2}})right]\[0.5em]+log {left[{sqrt {n}}B({frac {n}{2}},{frac {1}{2}})right]}end{matrix}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1cd3fdc61973f68042141bd52ef3b36cd233e8a0)

![{mathbb {E}}left[t^{k}right]=0](https://wikimedia.org/api/rest_v1/media/math/render/svg/03e22470d6afaa3397555bea76f3fecd20968fad)

![{displaystyle mathbb {E} left[t^{k}right]={frac {1}{{sqrt {pi }}Gamma left({frac {n}{2}}right)}}left[Gamma left({frac {k+1}{2}}right)Gamma left({frac {n-k}{2}}right)n^{frac {k}{2}}right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/aecd6a751df7ace0449d2eddecbfbf244c13405b)