Как найти свой сайт в поисковой системе

На первый взгляд, проблема поиска своего сайта в интернете кажется бессмысленной. Однако это не так, ведь от позиции сайта в поисковых системах по определенным ключевыми словам определяется авторитетность сайта и количество пользователей сети интернет, переходящих на ваш сайт.

Инструкция

Поисковые системы индексируют, т.е. добавляют в свой каталог, как одностраничные статические сайты, так и огромные порталы и динамические форумы и интернет-магазины. Для того чтобы поисковая система заметила новый адрес в интернете – домен, его необходимо добавить в поисковую машину через так называемую Add Url.Google: http://www.google.com/addurl/Яндекс: http://webmaster.yandex.ru/addurl.xmlRambler: http://www.rambler.ru/doc/add_site_form.shtmlАпорт: http://catalog.aport.ru/rus/add/AddUrl.aspxYahoo!: http://siteexplorer.search.yahoo.com/submitBing! (MSN, Live Search Microsoft): http://www.bing.com/docs/submit.aspxПосле того, как домен был добавлен в Add Url, поисковой машине потребуется от нескольких часов до 2-3 недель, чтобы принять сайт и начать его индексацию. При этом, на сайте, конечно же, должен быть какой-либо текстовый контент.

Если вы хотите анализировать позиции сайта по ключевым словам и фразам и узнать, на какой странице в выдаче находится ваш ресурс при вводе пользователем того или иного запроса, необходимо воспользоваться специальным сервисом. Один из них — «Сеумка» — вычисляет позицию вашего домена в выбранной поисковой системе по заданным ключевикам. «Сеумка» находится по адресу: http://seumka.ru/. Данный сервис, как и многие качественные сервисы по предоставлению SEO-информации, является платным.

Еще один интересный сервис под названием SetLinks является биржой ссылок, которая бесплатно предоставляет услугу мониторинга позиций интернет-ресурса в поисковых машинах. Сайт SEMRush также может показать вам положение страниц вашего сайта в популярных поисковых системах. Сервис расположен по ссылке: http://ru.semrush.com/ru/?db=ru

Некоторую информацию о позициях сайта в поисковых системах по сильным запросам предоставляет сервис Cy-Pr.com: http://www.cy-pr.com/analysis/. Часть информации по сайту предоставляется бесплатно, часть – за деньги.

Войти на сайт

или

Забыли пароль?

Еще не зарегистрированы?

This site is protected by reCAPTCHA and the Google Privacy Policy and Terms of Service apply.

Как найти свой сайт не на прямую ссылку а с через поисковую систему без домена.

Знаток

(269),

закрыт

6 лет назад

Evgeny M.

Высший разум

(899237)

6 лет назад

Надо раскручивать свой сайт также, как обычно раскручивают свои сайты профессиональные вэб-мастера.

А эти черти обычно добавляют ссылки на свой сайт в разные интернет-каталоги и поисковые системы. Таким способом они ловко увеличивают индекс цитирования своего сайта. Чем больше будет на ваш сайт ссылок, тем больше будет у него индекс цитирования. Зачем же нужен высокий индекс цитирования сайта?

Давно известно, что сайты с более высоким индексом цитирования всегда располагаются ближе к началу списка выдачи поисковой системой (типа Яндекс, Гугл, Нигма, Ремблер и др.) при поиске по какому-нибудь конкретному запросу (при прочих равных условиях). А чем ближе к началу выдачи поисковой системы располагается Ваш сайт, тем более вероятно, что на него зайдут посетители, когда они что-то ищут в Интернете, связанное с тематикой Вашего сайта. Значит Ваш сайт получит целевых посетителей!

Сейчас поставить свои ссылки в разные интернет-каталоги и поисковики можно на уникальном проекте “Раскрутка сайта”, где такой процесс расстановки ссылок в каталоги сделан автоматизированным.

Там можно заплатить всего 200 руб. (за один свой сайт на время использования сервиса в один месяц) и раскидать до нескольких тысяч ссылок на свой сайт по каталогам Интернета. Это профессиональный тариф (Веб-Мастер). Частное лицо может оплатить через Сбербанк или через электронные деньги.

Там есть еще и разные другие более дорогие тарифные планы. Это когда уже не Вы решаете, куда будете ставить ссылки, а за Вас решает специалист по раскрутке сайтов. Я этими дорогими тарифами никогда не пользовался. (Хотя это, возможно, это хорошее решение, если совсем ничего не понятно и нет времени разбираться в этом. Всё таки каждый должен заниматься своим делом!)

За месяц расставил в каталогах около одной тысячи ссылок на свой сайт и через пару месяцев (когда поисковики обнаружили все эти ссылки) уже был результат – по двум интересующим меня запросам мой сайт оказался в первой десятке у одного поисковика и в первой двадцатке у двух других поисковиков и в первой пятидесятке у остальных поисковиках.

Это реальные результаты. До этого в течении целого года мой сайт не обнаруживался в поисковиках даже в первой сотне по интересующим меня запросам. Сейчас раз в год захожу на этот проект и за месяц “догоняю” ссылки на новые каталоги, которые появляются в их базе данных.

Сервис “Раскрутка сайта” существует много лет и его услугами пользуются уже тысячи вэб-мастеров, как любителей, так и профессионалов.

Короче, рекомендую!

Источник: Личный опыт и опыт профессиональных раскрутчиков сайтов

Андрей

Высший разум

(266769)

6 лет назад

Ну так найми SEO’шника для оптимизации и продвижения сайта в поисковом рейтинге. И подожди несколько месяцев – когда очередь поискового робота дойдёт и до твоего сайта… Если, конечно, поисковый робот вообще знает о его существовании. Ты свой сайт в поисковиках хотя бы зарегистрировал?

Sshhhhh….

Просветленный

(39400)

6 лет назад

Ну естественно. Во-первых нужно какое-то время чтобы поисковый робот гугла (и яндекса, и прочих) прошелся по вашему сайту. Во-вторых ваш сайт должен как-то подняться в рейтинге по ключевым словам. То есть или он должен быть популярным/цитируемым или его надо “продвигать” за плату

noj lav

Ученик

(72)

6 лет назад

Проблема может быть в двух случаях:

1. Вы не добавили сайт в поисковики.

2. При установке WordPress вы поставили галочку которая запрещает индексировать сайт поисковым системам.

Хотя может я и ошибаюсь.

НЭЙМ.РФ

Просветленный

(24047)

6 лет назад

Если сайт зареган в “вебмастерских” поисковиков и там сообщается что он проиндексирован, то возможно что вы ищете свой сайт на первых страницах выдачи, а нужно искать где-то на 100500-х. Чтобы было иначе – сайт нужно продвигать. Подробнее читайте здесь например: www-reg.ru/seo.html

Что сделать, чтобы мой сайт видели поисковые системы

В этой статье мы расскажем, как добавить сайт в поисковые системы: как проиндексировать сайт в Яндексе и добавить сайт в поиск Google.

После публикации сайта позаботьтесь о том, чтобы пользователи могли найти его в Интернете. Если пользователь знает URL-адрес сайта, сделать это легко. Сложнее сделать так, чтобы сайт быстро находился через поисковые системы.

Возникает закономерный вопрос: «Я уже создал сайт, как его разместить в Интернете?». Это связано с индексацией сайта. Прежде чем понять, как добавить свой сайт в поисковики Яндекс и Google, разберемся, что такое индексация.

Бесплатный SSL-сертификат

Поисковые системы больше доверяют сайтам с SSL. Получите в подарок SSL-сертификат начального уровня на 1 год и хостинг на 2 месяца бесплатно при регистрации нового домена на сайте REG.RU.

Зарегистрировать

Что такое индексация

Индексация сайта — это добавление его страниц в базу поисковых систем (поиск в Яндекс, Google, Рамблер, Yahoo, Mail, Bing и т.д.). Чтобы проиндексировать веб-страницы, поисковики отправляют на обход специальных роботов. Они анализируют HTML-код сайтов, учитывая:

- правильное наполнение страниц метатегами (description, title, keywords, h1, p) и их соответствие стандартам вёрстки;

- грамотное расположение текста;

- перелинковку;

- наличие карты сайта (sitemap);

- микроразметку.

В результате проверки роботы индексируют сайт, и он начинает отображаться в поисковой выдаче. Как добавить сайт на индексацию в поисковики, читайте ниже.

Почему сайта нет в Yandex и Google

Процесс индексации может занимать несколько недель. Представьте, какое количество новых сайтов нужно обойти роботам. Кроме того, не все страницы одного сайта индексируются одновременно. А если в коде есть то, что не удовлетворяет требованиям поисковых систем, индексация затянется.

Если вы только что разместили сайт в Интернете, он не будет сразу же отображаться в Яндекс и Google. Если вам нужно, чтобы сайт как можно быстрее отображался в поисковой выдаче, ускорьте индексацию вручную.

Ниже рассмотрим, как бесплатно добавить сайт на индексацию в поисковики.

Как ускорить процесс индексации сайта

Как сделать так, чтобы сайт стал быстрее видимым для поисковых систем? Нужно самому указать на свой сайт Яндекс и Google. Это делается через специальные панели, предназначенные для разработчиков сайтов: Яндекс.Вебмастер и Google Search Console. Прежде чем следовать инструкции о том, как разместить сайт в Гугл и в Яндекс, авторизуйтесь в нужной системе.

Как добавить сайт в Яндекс.Вебмастер

Чтобы добавить сайт в поисковую систему Яндекс, следуйте инструкции ниже:

-

1.

Перейдите на страницу Яндекс.Вебмастера.

-

2.

Перейдите по ссылке Добавить сайт.

-

3.

Введите адрес сайта (доменное имя) и нажмите Добавить:

Размещение сайта в Яндекс.Webmaster

-

4.

Подтвердите права на сайт. Сделать это можно через:

- код-страницы (Метатег);

- загрузку файла на хостинг (HTML-файл);

- или добавление TXT-записи (DNS-запись).

Мы рекомендуем добавить DNS-запись, так как это наиболее простой способ.

Как добавить DNS-запись для подтверждения прав

Кликните по вкладке «DNS-запись» и скопируйте значение TXT, которое нужно добавить:

Яндекс.Вебмастер: подтверждение прав на сайт

Определите, какие DNS-серверы прописаны для домена, по инструкции. От этого будет зависеть, где добавить TXT-запись:

- если для домена указаны ns1.reg.ru и ns2.reg.ru, воспользуйтесь пошаговой инструкцией раздела «Помощь»;

- если для домена указаны ns1.hosting.reg.ru и ns2.hosting.reg.ru, воспользуйтесь статьей.

Дождитесь обновления зоны домена.

Готово, вы добавили TXT-запись для подтверждения права на домен.

-

5.

После подтверждения прав нажмите Проверить. Если права подтверждены корректно, вы увидите следующее:

как добавить сайт в поиск яндекса

После мы рекомендуем воспользоваться инструментом Переобход страниц. Через него можно задать, какие страницы сайта стоит проиндексировать в первую очередь.

Готово, вы ускорили индексацию сайта. Теперь вы знаете, как добавить сайт в Вебмастер.

Обратите внимание

Описанный способ не требует технических навыков и знания SEO-оптимизации, но не гарантирует, что сайт сразу появится в поисковой выдаче. Если вы технически подкованы, воспользуйтесь другим способом: Как добавить сайт в поиск Яндекса.

Как добавить сайт в поиск Google

Как разместить сайт в Гугле, вы узнаете по инструкции:

-

1.

Перейдите на страницу Google Search Console.

-

2.

Введите адрес сайта в первом блоке и нажмите Продолжить:

Как добавить url в поисковые системы

-

3.

Добавьте нужную запись в зону домена по инструкции ниже и нажмите Подтвердить.

Как добавить DNS-запись для подтверждения прав

Скопируйте значение TXT-записи.

Определите, какие DNS-серверы прописаны для домена, по инструкции. От этого будет зависеть, где добавить TXT-запись:

- если для домена указаны ns1.reg.ru и ns2.reg.ru, воспользуйтесь пошаговой инструкцией раздела «Помощь»;

- если для домена указаны ns1.hosting.reg.ru и ns2.hosting.reg.ru, воспользуйтесь статьей.

Дождитесь обновления зоны домена.

Готово, вы добавили TXT-запись для подтверждения права на домен.

-

4.

Если права подтверждены корректно, вы увидите уведомление. Нажмите Готово:

Готово, вы ускорили индексацию сайта. Теперь вы знаете, как добавить сайт в поисковики.

Обратите внимание

Описанный способ не требует технических навыков и знания SEO-оптимизации, но не гарантирует, что сайт сразу появится в поисковой выдаче. Если вы технически подкованы, воспользуйтесь другим способом: Как добавить сайт в Google?.

Мы рассказали о том, как зарегистрировать сайт в Яндексе и Гугле и добавить сайт в поисковые системы бесплатно. Это поможет вам на начальном этапе. Если вы хотите продвигать свой ресурс, рекомендуем также подключить SSL-сертификат. Он поможет в SEO-продвижении проекта: позволит занять более высокую позицию в поисковой выдаче. В REG.RU вы можете заказать бесплатный SSL-сертификат для домена на 1 год: Как заказать бесплатный SSL-сертификат?

У Семёна есть сайт, но он не может его найти в поисковиках 🙁

-Как же так, я сделал отличный сайт, но никак не могу его найти, что мне делать?

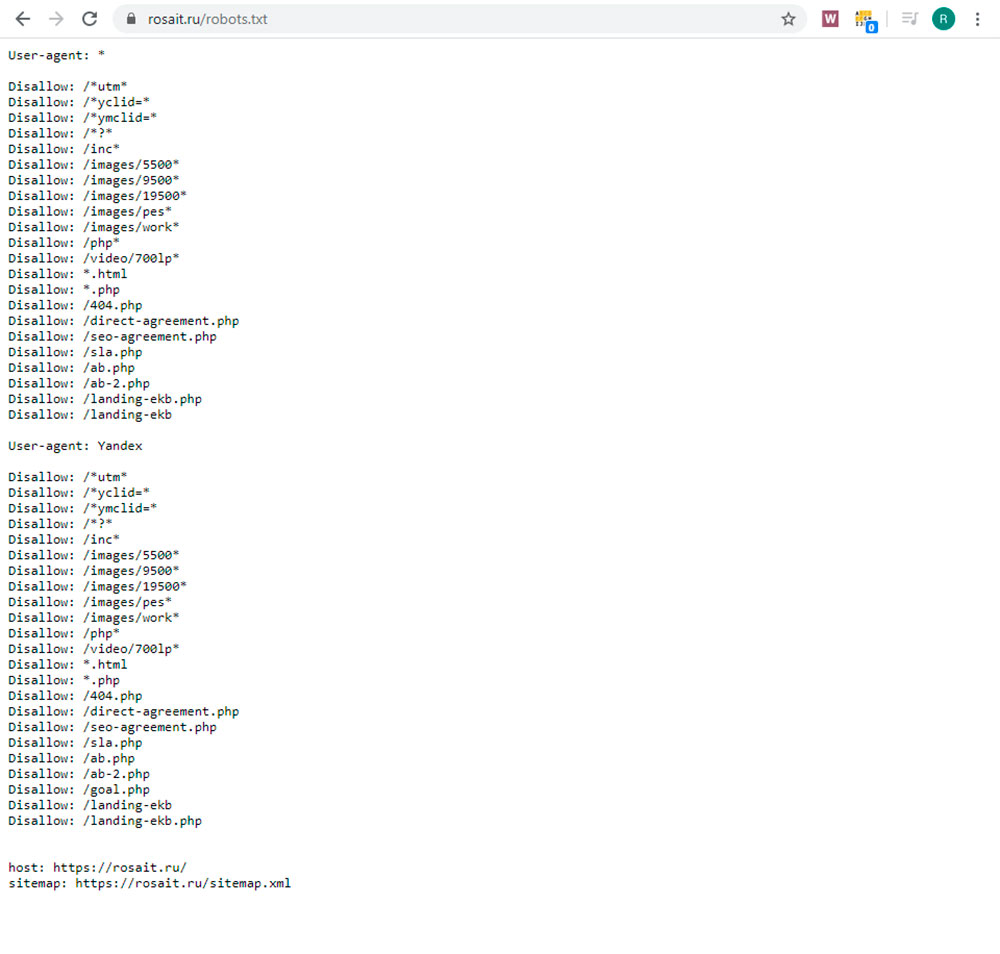

Его друг Аркадий говорит: -Семён, так у тебя роботс не настроен!

-Что не настроено?

-Роботс.тхт – это такой системный файл, который сообщает поисковикам что сайт нужно выдавать в поисковой выдаче.

Если индексация сайта открыта, то примерно через 2 недели ты сможешь найти свой сайт в поиске по названию, номеру телефона или email который ты указал на сайте!

-И всё? Это всё что нужно чтобы мой сайт появился в поисковой выдаче? – изумленно проговаривает Семён.

-Да, этого вполне хватит чтобы ты и твои клиенты могли тебя найти, зная название или номер телефона! А если ты хочешь, чтобы тебя находили НОВЫЕ клиенты, то я могу рассказать намного больше, но постепенно, одну тему за встречу, сойдет? – подмигивает Аркадий.

-Конечно! – говорит Семён, улыбаясь.

-Ну, тогда до встречи…и индексацию открыть не забудь!

Кстати, если не торопишься, могу тебе ещё вот что про Роботс рассказать…

Если хочешь проверить как настроен твой роботс — после адреса сайта добавляешь /robots.txt Должно получиться примерно так https://rosait.ru/robots.txt, но помни, для каждого сайта файл для роботов составляется индивидуально!

А если ты введешь в поисковике команду site:названиесайта.ру то ты увидишь сколько и какие страницы твоего сайта можно найти в поисковиках!

А если вдаваться в детали, то здесь 5 основных элементов:

- User-agent – здесь мы указываем поисковые системы, которым сообщаем информацию из файла robots.txt.

- Disallow – директива, которая запрещена для индексации.

- Allow – директива, которая разрешена для индексации.

- host: https://rosait.ru/ – Адрес вашего сайта

- sitemap: https://rosait.ru/sitemap.xml – Путь к карте сайта.

“Новое – это хорошо забытое старое…”. Кажется, в мире интернета смысл этой поговорки немного изменился. В условиях миллиардной аудитории никто не ждет, пока какой-то проект или красивый лендинг забылся. Копирование, копирование и еще раз копирование – это философия не только небольших частных предпринимателей, которые просматривают сайт-визитку или витрину магазина где-то за океаном. Копируются соцсети, мессенджеры, маркетплейсы, различные сервисы для бизнеса. И плагиат распространен в мире арбитража трафика.

Увидели красивый лендинг или крутой преленд с высокой конверсией? Необязательно тратить много времени и делать все с нуля. Если не копировать, то какой смысл в SPY-инструментах. Но простое использование команд “Ctrl+C” и “Ctrl+V” не работает. Да и при копировании страницы теряется код, нарушается верстка, пропадают картинки, отсутствует анимация. Не работают формы обратной связи, партнерские ссылки для переадресации на сайт рекламодателя засчитываются владельцу донора.

Можно ли скопировать сайт так, чтобы его можно было отредактировать под себя и залить на сервер? И как это сделать? Об этом сегодня и поговорим. Усаживайтесь поудобнее, впереди вас ожидает только полезная информация и рабочие советы.

Можно ли скопировать любой сайт

Если коротко – не все так однозначно… Из теории мы знаем, что при переходе на какой-то сайт, браузер подает запрос, сервер ему отвечает и передает данные в виде html-кода. Это язык разметки, после загрузки данных в окне web-браузера мы видим содержимое сайта. При этом локальная копия исходного кода хранится в буфере. Кеш временно сохраняться на жестком диске в папке C:UsersUSERNAMEAppDataLocalGoogleChrome. Достаточно извлечь из памяти данные страницы и сохранить. Но, было бы все так просто, каждый арбитражник да каждый школьник уже создал бы собственный *Facebook, Youtube, TikTok или криптобиржу.

Но современный сайт — это больше, чем веб-документ в формате html. Масштабные проекты да и простые лендинги чаще пишутся с использованием языка PHP или создаются на базе систем управления контентом (CMS), таких как WordPress, Joomla, MODx, Drupal. Собранные в визуальном конструкторе за 10 минут блоги и лендинги на их основе также в своей основе имеют код php. Структура таких порталов, даже небольших, двухуровневая: frontend — то, с чем взаимодействуют пользователи (именно взаимодействуют, а не просто просматривают), и backend — часть, исполняемая на сервере.

❗❗❗Интересно знать – 📢Как правильно сделать лендинг пейдж самому: пошаговая инструкция.

Современный сайт может быть полностью построен на базе динамических скриптов (например, адаптивные лендинги, которые подстраиваются под размер экрана) или содержать отдельные элементы. Это может быть “калькулятор” для расчета заказа, форма обратной связи, курсы валют или другие данные, которые могут меняться.

Можно скопировать только те скрипты, которые исполняются на стороне посетителя. Серверная часть для скачивания не доступна. Но исходный код и ответ сервера, который видят пользователь – это не одно и то же. При каждом обращении данные могут отличаться. Вы можете сохранить себе на компьютер код, выданные сервером. Но в дальнейшем такой проект без существенной доработки бек-энда работать не будет. После загрузки на сервер максимум, что можно получить – статический сайт с множеством проблем:

- сбивается верстка на адаптивных сайтах: съезжают кнопки, таблицы, текст;

- часть информации, как текстового, так и графического контента, становится недоступной;

- не работают формы, в некоторых случаях при заполнении полей обратной связи заявки будет получать конкурент, у которого вы “своровали” сайт;

- ни о какой адаптивности говорить не стоит: сайт будет всегда адаптированным под размер экрана устройства, с которого было копировано.

Хорошая новость в том, что простые сайты скопировать можно и даже обеспечить их корректную работу после минимальных правок в визуальном редакторе и ввода штучных изменений в код. Это лендинги, прелендинги, сайты-визитки и даже небольшие интернет-магазины на несколько страниц.

Загрузить можно даже сайт, который работает с использованием динамических таблиц. Правда мы получим статическую страницу с урезанными функциями (например, без адаптации под размер экрана).

А зачем вообще копировать чужой сайт

Если перефразировать слова Остина Клеона из книги “Кради как художник”, копирование – это творческий процесс, если мы, конечно, просто не выдаем чужие наработки за свои. И он ведет нас к прогрессу. Используя готовые образцы за основу, мы создаем что-то новое. Становится актуальным вопрос: что хорошо, а что плохо? “Существует только то, что достойно или недостойно быть позаимствованным…”.

Копирование помогает переосмыслить чужие идеи и сделать что-то лучшее. Для веб-программистов и верстальщиков – это возможность разобрать чужой код, изучить особенности работы скриптов, анимацию, чтобы потом использовать эти идеи в новых проектах.

Актуально копирование сайтов в арбитраже трафика и среди маркетологов, которые запускают рекламные кампании в сети. Можно потратить месяцы и тысячи долларов (это при самых скромных подсчетах) на тестирование лендингов и прелендингов, сайтов визиток и одностраничных магазинов (неважно, созданным с нуля или на базе шаблонов). Но все равно не получить результат.

Альтернатива — найти Landing Page через SPY-инструмент, посмотреть статистику, выбрать и, естественно, доработать под себя. Второй способ занимает немного времени, буквально часы. И бонус — можно сразу скопировать рабочую связку типа “баннер+лендинг”, “прелендинг+лендинг” или даже “баннер+преленд+лендинг пейдж”.

❗❗❗Читайте также: Как припарковать домен – подробный гайд.

Последствия копирования чужих сайтов

Прежде чем переходить непосредственно к основному разделу с советами, вспомним о последствиях, которые могут ожидать при копировании:

- административная ответственность. За копирование чужого сайта (прежде всего это касается дизайна и логотипов) на вас могут подать в суд. Но это возможно только в случаях, когда скопирован уникальный портал, например интернет-магазин, который разрабатывался с нуля, а не лендинг по бесплатному шаблону;

- владелец оригинала через суд может заставить вас удалить свой ресурс, если вы копируете магазин или страницу захвата. Вы потеряете клиентов, которых успели привлечь, усилия на доработку и продвижение пропадут зря;

- вы теряете часть клиентов, когда используете чужой дизайн: клиенты будут ассоциировать вас с компанией-донором сайта, в следующий раз могут обратиться в другую компанию;

- возможна просадка конверсии – в случае, если лендинг уже надоел аудитории, пользователи будут его игнорировать, так как часть целевой аудитории уже отклонила предложение или воспользовалась им.

Все же в арбитраже, если успеть вовремя заметить лендинги и прелендинги с высокой конверсией, копирование сайта позволяет быстро запустить рабочий креатив и увеличить ROI, сберегая время и силы на разработку. А web-программисты получают образец для тренировок и разбора удачных решений.

Как скачать веб сайт на компьютер через браузер

Самый очевидный способ скопировать web-сайт — скачать его с помощью браузера. При этом доступно сразу два способа:

- народный Ctrl+S (“Страница” — “Сохранить как…” в Opera. В Chrome опция запрятана в “Дополнительных инструментах”) — метод, который сразу приходит на ум;

- копирование кода страницы через “Инструменты разработчика” в меню “Разработка” (в браузерах на базе Google Chrome — в меню “Дополнительные инструменты”).

Кажется, все просто, зачем еще заморачиваться. Используем команду “Ctrl+S” и получаем готовый html-файл. Не все так, как кажется. Функция сохранения создана, в первую очередь, чтобы можно было просматривать информацию автономно, когда нет доступа к интернету. И это не самый удобный способ копирования сайта.

Доступно три варианта скачивания:

- только html;

- одним файлом;

- страница полностью.

Первый метод предполагает сохранение только html-разметки. Если такую страницу просматривать без интернета или попытаться установить на сервер, то мы увидим только таблицы, заголовки. Большая часть контента, картинки, формы, виджеты и даже часть текста, будет утеряна.

Очевидно, нужно выбрать пункт “Страница полностью” или “Одним файлом”. В первом случае будет сохранен html-файл вместе с папкой, в которой сохраняются файлы стилей, шрифты, картинки, ссылки на другие страницы. Во втором создается веб-архив: HTML документ вместе с javascript, css, аудио и видео, закодированный по методу MIME (.mhtml) – по такому же принципу кодируются сообщения электронной почты.

И mhtml-архив и html-докумет с файлами позволяют просматривать содержимое страницы в автономном режиме. Но в случае загрузки на сервер сайт работать не будет или с заметными искажениями, хотя сохраненные страницы можно открыть через визуальный редактор (и даже через текстовый редактор типа MS Word), отредактировать и уже сохранить в правильном формате.

Но главный недостаток — за один раз вы сохраняете только одну страницу. Если это большой сайт, на выходе получится много папок, не связанных между собой, которые придется связывать вручную.

Более продвинутый способ копирования – через инструменты разработчика. Позволяет скопировать не только саму html-разметку, но и структуру файлов сайта с каталогами.

Чтобы скопировать сайт:

- входим в меню “Разработка”;

- выбираем “Инструменты разработчика” (Ctrl+I или Ctrl+Shift+I) – перед нами появляются DevTools;

- выбираем вкладку “Sources” – в левой части окна открывается окно с деревом каталогов;

- просматриваем структуру страницы – обычно файлы сайта идут в первой папке, ниже – папки с внешними скриптами (обычно, их копировать не нужно);

- создаем на локальном хранилище (жесткий диск, флешка, облачное хранилище, куда мы будем копировать страницу) папку с названием страницы, внутри создаем каталоги в соответствии со структурой зеркала сайта;

- сохраняем поочередно все файлы, кликнув по ним правой кнопкой мыши и выбрав команду “Save As”. К сожалению, скопировать все файлы одним махом или папку целиком возможности нет;

- копируем название файлов (символы в названии после вопросительного знака (“?”) копировать необязательно), если оно не подставилось автоматически;

- если нужно скачать изображение, то мы кликаем по нему в каталоге в левой части окна, после этого нажимаем по самому объекту правой кнопкой мышки и выбираем все ту же команду – “Save As”.

Повторяем процедуру для всех страниц сайта. Естественно, если названия папок с контентом совпадают, то на сервере используется общий каталог, создавать новый на локальном диске не нужно.

Если инструментов разработчика нет, можно пойти по более длинному пути. Создаем папку с названием сайта, внутри три каталога: img – для изображений, видео; css – для файлов стилей; js – для файлов скриптов. Открываем главную страницу копируемого сайта. Нажимаем “Ctrl+U” – браузер откроет исходный код страницы. Копируем его и вставляем в блокнот. Сохраняем файл в папке сайта (корневой папке) под именем index.html. В исходном коде находим ссылки на скрипты, изображения (заканчиваются расширением .jpg, .png), стили (css), скрипты (js) – кликаем по ним. Код сохраняем с использованием блокнота. Помещаем в папки с соответствующим названием. По такой же схеме сохраняем все страницы.

Правда смысла в этом методе немного. В современных браузерах, даже небольших авторских проектах, реализованы инструменты разработчика. Да и удобнее пользоваться парсерами, способными в автоматическом режиме просканировать все страницы и скачать сайт целиком.

Специализированные программы для копирования сайта – парсеры

Парсеры, они же грабберы или рипперы – это специализированные программы, которые постранично сканируют сайт или только выбранные разделы, скачивают исходный код и контент, систематизируют данные в автоматическом режиме. У парсеров, как и у обычного браузера, нет доступа к данным, сохраненным на сервере: на это способен лишь хакерский софт, и то только после внедрения шпионского ПО (червя или трояна), которое сольет пароли и логины для доступа или напрямую данные с сервера злоумышленнику. Как вы понимаете, такой софт в свободном доступе не лежит.

Популярная статья: ТОП-6 парсеров Телеграм – где скачать, как пользоваться.

Принцип работы парсеров такой же, как и при постраничном скачивании с помощью команды “Сохранить как…” или через “Инструменты разработчика”. Только поочередно веб-страницы открывает не пользователь, а бот, который имитирует поведение человека. Похожий алгоритм у роботов поисковых систем.

Юзер вводит url-адрес в адресной строке граббера. Приложение подает запрос серверу, тот в ответ выдает html-код. Дальше бот считывает страницу и начинает ее сканирование: ищет все внутренние ссылки и отправляет запрос по ним, потом снова считывает и сохраняет код, стили, скрипты, мультимедиа, контент. Процесс повторяется, пока приложение не сканирует весь сайт.

Парсеры не смогут сделать идентичную копию сайта. Они сохраняют лишь его статический html-слепок (зеркальную копию или дубликат). Но для небольших лендингов часто этого достаточно, где исходный код и страница в браузере – идентичны. И главный бонус – такой софт облегчает работу арбитражников:

- экономит время, десятки часов;

- автоматически систематизирует файлы, создавая структуру сайта, которую можно загрузить на сервер и запустить;

- снижает вероятность механической ошибки, когда какой-то файл сохранен не под правильным именем или помещен не в тот каталог.

Недостаток – по-прежнему невозможно скачать исходный код. Только слепок или зеркальную копию с контентом и ссылками, которую выдает сервер. Остальные минусы зависят от конкретного приложения. Например, некоторое ПО просто скачивает с каждой страницы всю информацию, которую сможет найти. В итоге получается много дублей картинок и скриптов. Сайт размером в 20 мегабайт может разрастись до 200 мб.

В сети выложено много парсеров как бесплатных, так и платных. Есть софт в виде программного обеспечения для установки на локальное устройство (для Windows, Android, MacOS, iOS), скрипты для установки на сервер, онлайн-сервисы.

Специализированные программы для установки на компьютер

WinHTTrack WebSite Copier

WinHTTrack WebSite Copier – приложение для скачивания сайтов, которое распространяется бесплатно. Есть версии для Windows, в том числе устаревших версий Windows 2000, XP (WinHTTrack), Linux, BSD (WebHTTrack). Основная задача – скачивание и упорядочивание файлов. На выходе получаем готовую папку с зеркальной копией сайта, которую можно залить на сервер.

У софта есть много дополнительных опций:

- скачивание закрытых разделов сайта (при наличии доступа – логина и пароля), доступных авторизованным пользователям;

- создание резервных копий в несколько кликов;

- обновление уже скачанного сайта – приложение сопоставит и добавит обновленные разделы или внесет изменения в скачанные страницы;

- возможно одновременное скачивание нескольких сайтов с перекрестными ссылками или скачивание вместе с сайтом страниц других ресурсов, на которые ведут внешние ссылки;

- гибкая настройка формата структуры сохраненного сайта (одним файлом mhtml или сайта полностью), ассоциаций MIME, добавление прокси и др.;

- возобновление прерванных загрузок и другие опции.

Cyotek WebCopy

Еще один бесплатный парсер с широкими возможностями. Софт автоматически упорядочивает структуру, копирует скрытые части сайта, которые доступны только после аутентификации. Полезная функция – захват форм. В отличие от других грабберов, Cyotel WebCopy умеет копировать с сохранением работоспособности формы доступа, обратной связи, заказа, которые реализованы на сервере через динамические скрипты php.

В отличие от HTTrack, есть версия только для Windows, зато здесь более современный и приятный дизайн.

Особенности:

- автоматическое упорядочивание структуры. Парсер сопоставляет все ссылки и переназначает путь к ним после копирования, исключает появление дубликатов;

- можно вручную установить формат, по которому приложение будет упорядочивать структуру;

- доступно сохранение контента в один файл (MIME html);

- опция захвата форм, возможно скачивание закрытых разделов, доступных после авторизации;

- приложение выводит дерево ссылок, в котором можно наглядно посмотреть структуру сайта;

- фильтры, позволяющие сохранить только скрипты или изображения;

- приложение устроено так, чтобы создать зеркальную копию сайта, которая будет работать автономно.

Wget

Это универсальная утилита с множеством полезных функций. Умеет сканировать и копировать сайты по http, https, ftp, ftps. Если оценивать по возможностях – это одно из самых мощных приложений. Умеет сканировать сайт и сохранять исходный код вместе с контентом в один файл (mhtml для локального просмотра), создавать зеркальные копии сайта, которые в дальнейшем можно загрузить на новый сервер. Также среди функций – скачивание исходного кода с сервера по ftp (для разработчиков и владельцев).

Утилита изначально написана для linux, но потом создатели сделали компиляцию для Windows. Но визуальная оболочка отсутствует. Управление граббером через командную строку.

Скачать дистрибутив для Linux можно здесь. Версия для Windows (файл .exe) – здесь.

Процесс установки на Windows:

- загружаем файл или zip-архив;

- извлекаем файл wget.exe, копируем его в папку Windows/System32 (или в другой каталог, который позволяет запускать утилиту через командную строку из любого места);

- запускаем командную строку: прописываем в строке поиска на панели задач cmd (Windows 10, 11) или Win + X — “Выполнить”, пишем команду cmd, нажимаем кнопку ОК;

- вводим команду “wget -h”, чтобы увидеть список команд с расшифровкой;

- для удобства создаем каталог в корневой папке на диске С, куда будут загружаться файлы сайтов (cd / – команда, чтобы переместиться в корневой каталог, md wgetdown – создать папку с названием “wgetdown”).

Некоторые команды:

- сделать зеркало сайта: wget -r https://www.yoursite.com;

- сделать копию сайта и локализовать ссылки: wget –convert-links -r https://www.yoursite.com;

- сделать оффлайн-зеркало с локализацией ссылок: wget –mirror –convert-links –adjust-extension –page-requisites –no-parent https://www.yoursite.com;

- сохранить зеркало сайта как .html: wget –html-extension -r https://www.yoursite.com;

- загрузить изображения: wget -A “*.jpg” -r https://www.yoursite.com.

Web ScrapBook

Браузерное расширение для Chrome, позволяет в несколько кликов скачать копию сайта или отдельную страницу. Также позволяет просматривать на браузере архивированные страницы, когда доступ к интернету отсутствует.

Особенности:

- удобное управление в один клик;

- минимум функций.

Teleport Pro

Одно из самых популярных приложений для копирования сайтов и лендингов среди арбитражников. Приложение может скачать сайт целиком или отдельные страницы со всеми ссылками и адаптацией для просмотра на компьютере. Граббер умеет создавать статические дубликаты лендингов и прелендингов, которые можно запускать на сервере.

Особенности:

- автоматическое восстановление структуры сайта;

- есть возможность настроить адреса ссылок;

- поиск по ключевым словам;

- загрузка скрытых разделов, защищенных паролем;

- создание дубликатов сайта;

- одновременное сканирование нескольких адресов.

Недостаток – устаревший дизайн, немного запутанный интерфейс.

Offline Explorer

Один из самых продвинутых грабберов с большим набором функций, интуитивно понятным и современным интерфейсом. Но он платный. Приложение умеет захватывать сайты целиком или отдельные страницы. С высокой точностью воспроизводит дубликаты страниц в социальных сетях (*Facebook, YouTube, *Instagram), может сканировать защищенные паролем разделы. Разработан на движке Chromium.

Особенности:

- одновременная загрузка нескольких проектов;

- автоматическое скачивание при появлении обновлений (резервное архивирование);

- загрузка по HTTP, FTP;

- реализовано сканирование и копирование страниц в социальных сетях.

Webcopier

Еще один платный проект. Webcopier изначально разработан для корпоративного использования. Это одновременно веб-браузер и инструмент, позволяет в несколько кликов сохранять интернет-каталоги, брошюры, расшаривать данные внутри локальной сети. Для разработчиков реализована возможность поиска мертвых ссылок и анализа структуры сайта.

Маркетологам риппер дает возможность быстро копировать страницы лендингов для дальнейшего редактирования.

Особенности:

- парсер имеет встроенные средства просмотра;

- копирование страниц в несколько кликов;

- сканирование, просмотр структуры;

- загрузка сайта с автоматической корректировкой структуры;

- есть версии для Windows, Mac, Android.

Плагин Save Page WE

Расширение для браузеров Chrome, Firefox. Фактически плагин копирует опцию “Save As…”, но более качественно упорядочивает структуру файлов. И имеет несколько полезных функций, таких как извлечение ссылок и файлов (изображений, видео).

Онлайн-сервисы для копирования сайтов

DollySites

Это не совсем онлайн-сервис, а скрипт, который можно установить на свой сервер (в лицензию входит возможность установки на три IP). Позволяет скачать и отредактировать сайт в несколько кликов, поддерживает прокси и tor-сайты (.union). Есть инструмент захвата и адаптации форм обратной связи. По набору функций DollySite превосходит многие оффлайн-пакеты для локальной установки. После регистрации открывается личный кабинет, где можно управлять загрузками.

Особенности:

- встроенный редактор;

- можно в несколько кликов заменить картинку или текст;

- высокая скорость работы за счет серверных ресурсов;

- можно перевести сайт с помощью встроенного переводчика.

Главный недостаток – скрипт платный. Демо-версия на один час без функции экспорта.

Web2zip

Простой сервис, который позволяет сделать дубликат сайта или лендинга. Функция у приложения только одна – сохранить сайт. Зато инструмент сразу создает zip-архив, готовый к загрузке на сервер и распаковке. Работает без регистрации и авторизации.

Saveweb2zip

Еще один сервис для создания дубликата сайта в один клик с упаковкой в zip. Но у сервиса есть несколько дополнительных функций:

- настройка форм обратной связи, интеграция с партнерками;

- копирование мобильной версии.

Saveweb2zip – один из лучших инструментов арбитражника, который позволяет быстро копировать лендинги и в один клик адаптировать их для захвата клиентов.

RoboTools

Роботулс пошел дальше и предлагает скопировать не только актуальную версию сайта, но и версии за прошлые годы из веб-архивов. Инструмент специально разработан для создания сателлитов. Сервис позволяет скачать сайт за несколько минут. Для загрузки доступен zip-архив, который можно отредактировать или загрузить на сервер и сразу же запустить (после распаковки). Сайт платный – оплата за страницы. Но скачивание с некоторыми ограничениями доступно бесплатно в демо-версии.

Webparse.ru

Сервис для скачивания сайтов в один клик, но с дополнительными функциями: скачивание мобильной версии, сканирование и просмотр контента, загрузка страницы или всего ресурса целиком. Сайт платный, есть пробная версия с одним бесплатным скачиванием.

WebSiteDownloader

Простой инструмент для скачивания сайтов в один клик без регистрации и ограничений. Вставляем ссылку, нажимаем кнопку “Download”. Полезная функция – поддержка скачивания из веб-архива Wayback Machine.

Копирование с использованием услуг фрилансеров и компаний

Еще один способ скопировать сайт – обратиться в веб-студию или к фрилансеру через одну из бирж фриланса. Метод подойдет, если вам понравился лендинг, сайт-визитка или небольшой магазин, сайт с описанием услуг и хочется себе такой же. Это не вариант для арбитражников: от звонка и заключения договора до получения готового сайта уйдет пару дней. Зато вариант для небольших предпринимателей, блогеров, у которых нет возможности и надобности разбираться в тонкостях веб-дизайна, работы с html-разметкой, подключения баз данных и настройки хостингов.

При обращении к фрилансерам, возможны два варианта:

- копирование сайта через парсер с редактированием кода и структуры, изменением контактов, форм обратной связи, некоторых фото. Дизайн будет идентичным, но новые функции добавить практически невозможно. Цена – в пределах 800-1000 рублей. Время работы – 1-2 дня;

- визуальное копирование с помощью конструктора (сборка нового сайта с нуля по шаблону). Этот вариант дороже, в пределах 5000 – 8000 рублей за простой лендинг, сайт на 3-5 страниц. Будут небольшие отличия в дизайне, анимации. Зато можно добавить функции по желанию. Время – до 10 дней.

В любом случае вы получаете сайт с правильной версткой без ошибок, с работающими формами обратной связи.

Студии, где можно заказать услугу копирования сайта:

- студия SPECHEET (specheet.ru). Копирование (парсинг) – 790 рублей, от одного дня. Создание копии лендинга с нуля – от 7000 руб.;

- pro – сервис копирования сайтов (парсинга). Предлагает три тарифа: эконом за 390 руб. – копирование парсером с удалением трекеров и жучков; Эконом+ за 590 руб. – дополнительно редактируется форма приема заявок; Стандарт за 990 руб. – копирование с удалением трекеров, редактированием формы приема заявок, замена текста, контактов, установка Я.Метрики, залив на хостинг;

- веб-агентство pixel – предлагает комплексное копирование сайта (дизайна, форм, скриптов), цены рассчитываются индивидуально.

Гайд: как скачать весь сайт

Мы уже описали, как копировать сайт постранично с помощью встроенных инструментов браузера. Теперь подробная инструкция по использованию программ и сервисов.

Как скопировать сайт с помощью программы Cyotel WebCopy

Эту программу мы выбрали по трем причинам: она бесплатная, хороший функционал, почти как у платного софта, и приятный современный интерфейс (в сравнении с HTTrack, Teleport Pro, у которых возможности такие же).

Скачиваем установочный файл – переходим на официальный сайт, нажимаем кнопку “Download”.

Запускаем скачанный установщик, принимаем условия, нажимаем кнопку дальше.

Отмечаем необходимые настройки, нажимаем кнопку “Дальше” (Next).

Выбираем опции установки (создавать ли ярлык на рабочем столе), нажимаем “далее” и “установить”.

Запускаем приложение. Основные режимы работы программы:

- тестирование сайта;

- просмотр отчета по содержимому сайта;

- быстрое сканирование;

- копирование сайта.

Быстрое сканирование позволяет увидеть структуру страниц и их взаимосвязь. Через отчет можно оценить размер сайта и насколько много дополнительного контента будет загружено.

Чтобы скопировать сайт, достаточно в поле с адресом (website) вставить URL и нажать кнопку Копировать (Copy). Приложение автоматически создает структуру, редактирует ссылки. Все данные сохраняются в папку (Save folder), указанную под адресной строкой.

Готово, получаем дубликат сайта с преобразованным php-кодом в html-разметку. После завершения копирования в окне с данными можно посмотреть результаты копирования, список файлов, карту сайта.

Копирование сайта с помощью онлайн-сервиса Saveweb2zip

Процесс копирования с помощью сервиса упрощен, насколько возможно. Все четыре шага:

- переходим по ссылке saveweb2zip.com;

- вставляем в адресную строку url сайта или страницы;

- если нужно, настраиваем форму обратной связи;

- нажимаем кнопку “Скачать”.

Сервис сканирует сайт, автоматически формирует его зеркало и запускает скачивание. На этом копирование закончено. Вы получаете готовый для запуска дубликат. Скачанный zip-архив можно редактировать в визуальном редакторе или распаковать и запустить на сервере.

Скачивание изображений с сайта

И предустановленные программы, и онлайн-сервисы скачивают сайт целиком вместе с изображениями, скриптами, видео. Но картинки, как и видеоролики, копируются не всегда. Причина может быть как в установленных ограничениях по размеру файла, так и просто связана со сбоями в работе сервиса, ошибками в коде. Изображения могут физически находится на стороннем сайте (хостинге изображений или видеохостинге) и граббер проигнорирует их. В такой ситуации есть несколько решений:

- сканировать с помощью парсера, который умеет отдельно скачивать картинки и другой мультимедиа контент;

- заново сканировать сайт парсером, установив функцию “Скачать все страницы по ссылкам” (multiple mirror);

- копировать картинки вручную: открываем в браузере исходный сайт и скопированную на ПК копию, просматриваем страницы, где отсутствуют изображения, копируем картинки, кликнув по ним правой кнопкой мыши и выбираем команду “Сохранить изображение как…”, сохраняем в папку с контентом (img, pics, content или другое название) в раннее скачанном архиве;

- через инструменты разработчика: нажимаем в браузере Ctrl+Shift+I, открываем вкладку Sources, находим папку с изображением, копируем в папку с архивом.

Удобный функционал по скачиванию картинок реализован в Wget. Но приложение работает только через командную строку. Чтобы скачать изображения, запускаем программу через командную строку и вводим команду wget -A “*.jpg” -r https://www.yoursite.com

Как редактировать скопированный сайт

После скачивания есть несколько способов редактирования:

- открываем через блокнот или адаптированный блокнот для программистов (Notepad++, HAPedit или другой) и редактируем исходный код (вариант для настоящих гиков);

- через локальное приложение для создания и редактирования сайтов, например Adobe Dreamwiever или через WYSIWYG Web Builder. Впрочем, отредактировать скачанный лендинг можно даже через MS Word. Работает по принципу графического редактора (но не получится отредактировать формы захвата). Редактируем текст, стили, добавляем разделы как и при редактировании текстового документа;

- через веб-абминку CMS. Импортировать большой сайт на WordPress, Joomla или другую CMS не так легко (веб-разработчики новичкам рекомендуют работать с Modx Revo), но с лендингами, у которых минимум внешних ссылок, можно управиться, хотя это требует опыта.

Для редактирования лучше использовать специализированный редактор, хотя можно использовать и MS Word или его бесплатные аналоги, например WPS Office.

Подведем итоги

Скопировать сайт несложно, если это ресурс на несколько страниц без сложных форм и скриптов. Лендинги, магазины на одну страницу, визитки можно скачать, отредактировать и запустить на собственном сервере за несколько минут. Но когда дело касается сложных проектов с сотнями, тысячами страниц, корректно скопировать их достаточно сложно. И усилия на доработку часто нужны такие же, как на создание с нуля. Впрочем, для маркетологов и арбитражников парсеры заметно упрощают жизнь и позволяют намного быстрее запускать успешные рекламные кампании.

❗Читайте также: ТОП 10+🔥 парсеров для Инстраграм – подробный обзор сервисов.

*владелец Facebook и Instagram, компания Meta – запрещенная в РФ организация