Одним

из центральных вопросов, решаемых с

помощью корреляционного метода, является

определение и оценка количественной

меры тесноты связи между факторными и

результативными признаками.

При

решении однофакторного или многофакторного

корреляционного комплекса универсальным

показателем тесноты взаимосвязи между

изучаемыми признаками считается

корреляционное

отношение,

позволяющее довольно точно измерить и

оценить влияние факторных признаков

на признаки- результаты при любой форме

корреляционной зависимости.

Корреляционное

отношение –– показатель, который можно

рассчитать для простой или множественной

корреляции на базе данных, получаемых

в процессе решения дисперсионного

комплекса:

,

(11.1)

где

– корреляционное отношение;

Wф

— объем систематической (факторной)

вариации;

Wобщ

— объем

общей вариации признака-результата.

Корреляционное

отношение может обеспечить довольно

высокий уровень точности количественного

измерения тесноты взаимосвязи между

изучаемыми признаками, так как оно

позволяет полнее «уловить» все колебания,

вызванные влиянием факторных признаков

на результат. Вместе с этим преимуществом

корреляционное отношение содержит

существенный недостаток: имея всегда

положительное значение, при обратной

корреляционной зависимости оно не

показывает направление связи между

изучаемыми признаками. Поэтому для

выявления направленности корреляционной

зависимости между признаками-факторами

и признаками-результатами нередко

приходится использовать графический

прием.

При корреляционных

связях обычно изучаются взаимоотношения

разноименных величин. Поэтому приходится

сопоставлять не линейные отклонения

индивидуальных вариант, а их преобразованные

значения, нередко выраженные в отвлеченных

числах.

11.4. Коэффициенты прямолинейной парной корреляции

Если взаимосвязь

между изучаемой парой признаков

выражается в форме, близкой к прямолинейной,

то степень тесноты связи между этими

признаками можно рассчитать при помощи

коэффициента

прямолинейной парной корреляции.

В настоящее время имеется много различных

способов расчета коэффициента парной

корреляции. Каждый способ учитывает

характер и особенности взаимосвязей

между изучаемыми признаками в

статистической совокупности. Доказано,

что наиболее точный результат

корреляционной тесноты связи между

факторным и результативным признаками

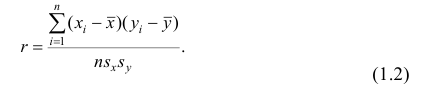

может быть получен по формуле

,

(11.2)

где r

ху

– коэффициент парной корреляции между

признаком-фактором (х) и признаком-результатом

(у); tx

– нормированное отклонение по

признаку-фактору; t

y

– нормированное отклонение по

признаку-результату.

Коэффициенты

корреляции, также как и корреляционные

отношения, обладают стабильным свойством,

заключающимся в том, что пределы колебаний

этих показателей могут быть выражены

следующим образом: -1< r

ху

< 1. Это означает, что коэффициенты

корреляции и корреляционные отношения

могут колебаться в пределах, не превышающих

единицу.

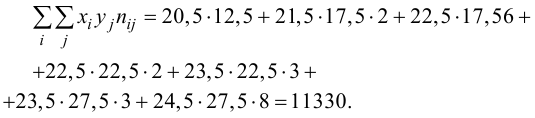

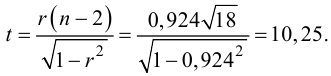

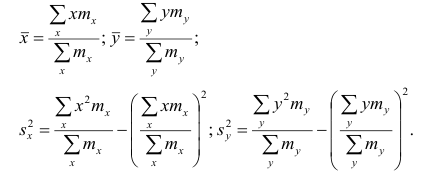

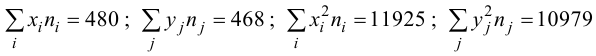

Сокращенный

вариант расчета коэффициента парной

корреляции между урожайностью сена

многолетних трав и годовым удоем коров

в 100 сельскохозяйственных организациях

по формуле 11.3 приведен в табл. 11.1.

Т

а б л и ц а 11.

1. Расчет

вспомогательных показателей для

определения коэффициента парной

корреляции

|

№ п.п. |

х, ц/га |

ц/га |

|

ц/га |

у, ц |

ц |

|

ц |

|

|

1 |

20 |

-10 |

100 |

-1,0 |

20 |

-15 |

225 |

-1,5 |

1,5 |

|

2 |

21 |

-9 |

81 |

-0,9 |

20 |

-15 |

225 |

-1,5 |

1,4 |

|

3 |

22 |

-8 |

64 |

-0,8 |

25 |

10 |

100 |

-1,0 |

0,8 |

|

… |

… |

.. |

… |

… |

… |

… |

… |

… |

… |

|

100 |

50 |

20 |

400 |

2,0 |

50 |

15 |

225 |

1,5 |

3,0 |

|

Σ |

3000 |

– |

10000 |

– |

3500 |

– |

10000 |

– |

70,0 |

|

Среднее |

30 |

– |

|

– |

35 |

– |

|

– |

0,7 |

Как

видно, полученное среднее произведение

нормированных отклонений по признаку-фактору

и признаку-результату

представляет

собой коэффициент парной корреляции

между этими признаками. Поскольку этот

коэффициент положительный, то взаимосвязь

между признаками прямая, а величина

коэффициента корреляции (r

= 0,7) указывает на среднюю меру зависимости

годового удоя одной коровы от урожайности

сена многолетних трав.

Необходимо

иметь в виду, что абсолютная величина

коэффициента корреляции, как и

корреляционного отношения, может

колебаться от 0 до 1, а с учетом направления

связи

– находиться

в пределах от –

1

до 1. При этом чем ближе коэффициент

корреляции к единице (отрицательной

или положительной), тем теснее находятся

признаки во взаимосвязи.

Расчет

коэффициента корреляции по основной

формуле 11.2 хотя и дает довольно точный

результат, но отличается повышенной

трудоемкостью вычисления. Поэтому для

измерения степени тесноты связи между

факторным и результативным признаками

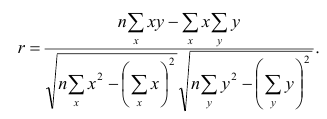

можно рекомендовать формулу, предложенную

К. Пирсоном:

,

(11.3)

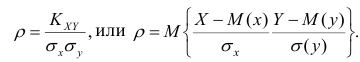

где

r

xy

– коэффициент прямолинейной парной

корреляции;

– среднее произведение факторного и

результативного признаков:– среднее значение соответственного

факторного и результативного признаков,–– средние квадратические отклонения

признака-фактора и признака-результата.

При

расчете коэффициента прямолинейной

парной корреляции по формуле 11.3 в общем

виде можно воспользоваться макетом

вспомогательной табл. 11.2.

Т а б

л и ц а 11.2. Схема

расчета вспомогательных показателей

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Содержание:

Корреляционный анализ:

Связи между различными явлениями в природе сложны и многообразны, однако их можно определённым образом классифицировать. В технике и естествознании часто речь идёт о функциональной зависимости между переменными x и у, когда каждому возможному значению х поставлено в однозначное соответствие определённое значение у. Это может быть, например, зависимость между давлением и объёмом газа (закон Бойля—Мариотта).

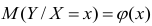

В реальном мире многие явления природы происходят в обстановке действия многочисленных факторов, влияния каждого из которых ничтожно, а число их велико. В этом случае связь теряет свою однозначность и изучаемая физическая система переходит не в определённое состояние, а в одно из возможных для неё состояний. Здесь речь может идти лишь о так называемой статистической связи. Статистическая связь состоит в том, что одна случайная переменная реагирует на изменение другой изменением своего закона распределения. Следовательно, для изучения статистической зависимости нужно знать аналитический вид двумерного распределения. Однако нахождение аналитического вида двумерного распределения по выборке ограниченного объёма, во-первых, громоздко, во-вторых, может привести к значительным ошибкам. Поэтому на практике при исследовании зависимостей между случайными переменными X и У обычно ограничиваются изучением зависимости между одной из них и условным математическим ожиданием другой, т.е.

Вопрос о том, что принять за зависимую переменную, а что — за независимую, следует решать применительно к каждому конкретному случаю.

Знание статистической зависимости между случайными переменными имеет большое практическое значение: с её помощью можно прогнозировать значение зависимой случайной переменной в предположении, что независимая переменная примет определенное значение. Однако, поскольку понятие статистической зависимости относится к осредненным условиям, прогнозы не могут быть безошибочными. Применяя некоторые вероятностные методы, как будет показано далее, можно вычислить вероятность того, что ошибка прогноза не выйдет за определенные границы.

Введение в корреляционный анализ

Связь, которая существует между случайными величинами разной природы, например, между величиной X и величиной Y, не обязательно является следствием прямой зависимости одной величины от другой (так называемая функциональная связь).

В некоторых случаях обе величины зависят от целой совокупности разных факторов, общих для обеих величин, в результате чего и формируется связанные друг с другом закономерности. Когда связь между случайными величинами обнаружена с помощью статистики, мы не можем утверждать, что обнаружили причину происходящего изменения параметров, скорее мы лишь увидели два взаимосвязанных следствия.

Например, дети, которые чаще смотрят по телевизору американские боевики, меньше читают. Дети, которые больше читают, лучше учатся. Не так-то просто решить, где тут причины, а где следствия, но это и не является задачей статистики.

Статистика может лишь, выдвинув гипотезу о наличии связи, подкрепить ее цифрами. Если связь действительно имеется, говорят, что между двумя случайными величинами есть корреляция. Если увеличение одной случайной величины связано с увеличением второй случайной величины, корреляция называется прямой.

Например, количество прочитанных страниц за год и средний балл (успеваемость). Если, напротив рост одной величины связано с уменьшением другой, говорят об обратной корреляции. Например, количество боевиков и количество прочитанных страниц. Взаимная связь двух случайных величин называется корреляцией, корреляционный анализ позволяет определить наличие такой связи, оценить, насколько тесна и существенна эта связь. Все это выражается количественно.

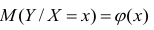

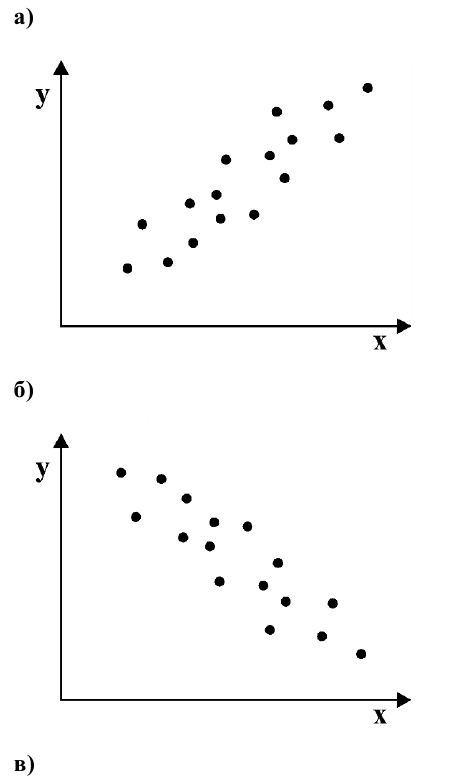

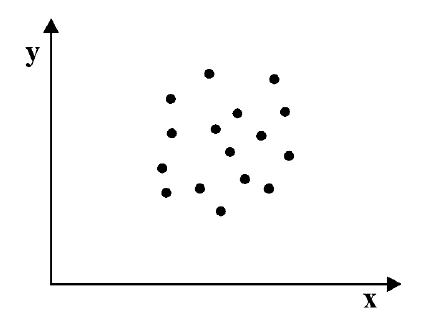

Как определить, есть ли корреляция между величинами? В большинстве случаев, это можно увидеть на обычном графике. Например, по каждому ребенку из нашей выборки можно определить величину

Если график имеет вид а), то это говорит о наличии прямой корреляции, в случае, если он имеет вид б) – корреляция обратная. Отсутствие корреляции тоже можно приблизительно определить по виду графика – это случай в).

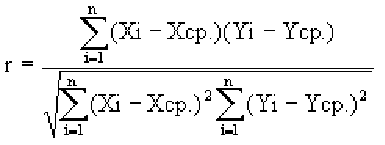

С помощью коэффициента корреляции можно посчитать насколько тесная связь существует между величинами.

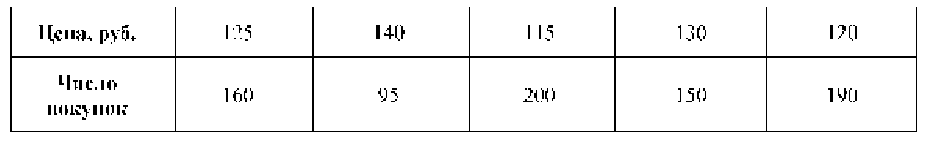

Пусть, существует корреляция между ценой и спросом на товар. Количество купленных единиц товара в зависимости от цены у разных продавцов показано в таблице:

Коэффициент r мы считаем в Excel, с помощью функции

Надо отметить, что чем ближе к 0 коэффициент корреляции, тем слабее связь между величинами. Наиболее тесная связь при прямой корреляции соответствует коэффициенту r, близкому к +1. В нашем случае, корреляция обратная, но тоже очень тесная, и коэффициент близок к -1.

Что можно сказать о случайных величинах, у которых коэффициент имеет промежуточное значение? Например, если бы мы получили r = 0,65. В этом случае, статистика позволяет сказать, что две случайные величины частично связаны друг с другом. Скажем на 65% влияние на количество покупок оказывала цена, а на 35% – другие обстоятельства. И еще одно важное обстоятельство надо упомянуть.

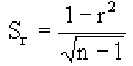

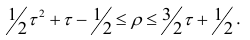

Поскольку мы говорим о случайных величинах, всегда существует вероятность, что замеченная нами связь – случайное обстоятельство. Причем вероятность найти связь там, где ее нет, особенно велика тогда, когда точек в выборке мало, а при оценке Вы не построили график, а просто посчитали значение коэффициента корреляции на компьютере. Так, если мы оставим всего две разные точки в любой произвольной выборке, коэффициент корреляции будет равен или +1 или -1. Из школьного курса геометрии мы знаем, что через две точки можно всегда провести прямую линию. Для оценки статистической достоверности факта обнаруженной Вами связи полезно использовать так называемую корреляционную поправку:

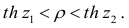

Связь нельзя считать случайной, если:

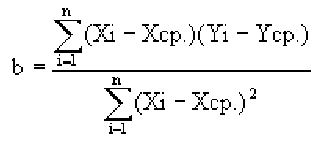

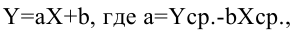

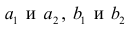

В то время как задача корреляционного анализа – установить, являются ли данные случайные величины взаимосвязанными, цель регрессионного анализа – описать эту связь аналитической зависимостью, т.е. с помощью уравнения. Мы рассмотрим самый несложный случай, когда связь между точками на графике может быть представлена прямой линией. Уравнение этой прямой линии

Зная уравнение прямой, мы можем находить значение функции по значению аргумента в тех точках, где значение X известно, a Y – нет. Эти оценки бывают очень нужны, но они должны использоваться осторожно, особенно, если связь между величинами не слишком тесная. Отметим также, что из сопоставления формул для b и r видно, что коэффициент не дает значение наклона прямой, а лишь показывает сам факт наличия связи.

Определение формы связи. Понятие регрессии

Определить форму связи — значит выявить механизм получения зависимой случайной переменной. При изучении статистических зависимостей форму связи можно характеризовать функцией регрессии (линейной, квадратной, показательной и т.д.).

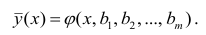

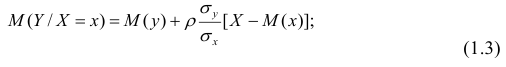

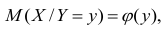

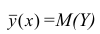

Условное математическое ожидание

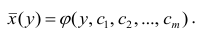

функцией регрессии случайной переменной Y относительно X (или функцией регрессии Y по X). Точно так же условное математическое ожидание

На примере, дискретного распределения найдём функцию регрессии.

Функция регрессии имеет важное значение при статистическом анализе зависимостей между переменными и может быть использована для прогнозирования одной из случайных переменных, если известно значение другой случайной переменной. Точность такого прогноза определяется дисперсией условного распределения.

Несмотря на важность понятия функции регрессии, возможности её практического применения весьма ограничены. Для оценки функции регрессии необходимо знать аналитический вид двумерного распределения (X, Y). Только в этом случае можно точно определить вид функции регрессии, а затем оценить параметры двумерного распределения. Однако для подобной оценки мы чаще всего располагаем лишь выборкой ограниченного объема, по которой нужно найти вид двумерного распределения (X, Y), а затем вид функции регрессии. Это может привести к значительным ошибкам, так как одну и ту же совокупность точек

Кривой регрессии Y по X (или Y на А) называют условное среднее значение случайной переменной У, рассматриваемое как функция определенного класса, параметры которой находят методом наименьших квадратов по наблюдённым значениям двумерной случайной величины (х, у), т.е.

Аналогично определяется кривая регрессии X по Y (X на Y):

Кривую регрессии называют также эмпирическим уравнением регрессии или просто уравнением регрессии. Уравнение регрессии является оценкой соответствующей функции регрессии.

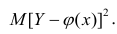

Возникает вопрос: почему для определения кривой регрессии

используют именно условное среднее

Если рассеивание вычисляется относительно

Основные положения корреляционного анализа

Статистические связи между переменными можно изучать методом корреляционного и регрессионного анализа. С помощью этих методов решают разные задачи; требования, предъявляемые к исследуемым переменным, в каждом методе различны.

Основная задача корреляционного анализа — выявление связи между случайными переменными путём точечной и интервальной оценки парных коэффициентов корреляции, вычисления и проверки значимости множественных коэффициентов корреляции и детерминации, оценки частных коэффициентов корреляции. Корреляционный анализ позволяет также оценить функцию регрессии одной случайной переменной на другую.

Предпосылки корреляционного анализа следующие:

- 1) переменные величины должны быть случайными;

- 2) случайные величины должны иметь совместное нормальное распределение.

Рассмотрим простейший случай корреляционного анализа — двумерную модель. Введём основные понятия и опишем принцип проведения корреляционного анализа. Пусть X и Y — случайные переменные, имеющие совместное нормальное распределение. В этом случае связь между X и Y можно описать коэффициентом корреляции p;. Этот коэффициент определяется как ковариация между X и Y, отнесённая к их среднеквадратическим отклонениям:

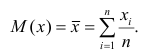

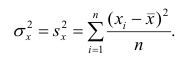

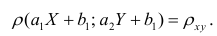

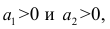

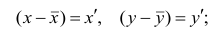

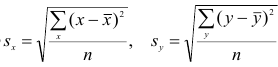

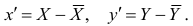

Оценкой коэффициента корреляции является выборочный коэффициент корреляции r. Для его нахождения необходимо знать оценки следующих параметров:

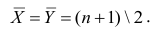

математического ожидания является среднее арифметическое, т.е.

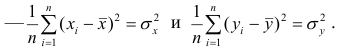

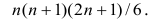

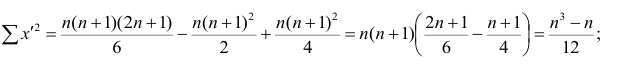

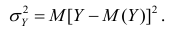

Оценкой дисперсии служит выборочная дисперсия, т.е.

Тогда выборочный коэффициент корреляции

Коэффициент р называют также парным коэффициентом корреляции, а r— выборочным парным коэффициентом корреляции.

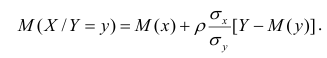

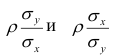

При совместном нормальном законе распределения случайных величин X и Y, используя рассмотренные выше параметры распределения и коэффициент корреляции, можно получить выражение для условного математического ожидания, т. е, записать выражение для функции регрессии одной случайной величины на другую. Так, функция регрессии Y на X имеет вид:

функция регрессии X на Y — следующий вид:

Выражения

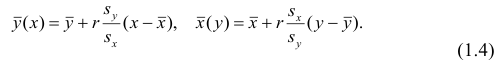

Подставив в (1.3) соответствующие оценки параметров, получим уравнения регрессии, график которых — прямая линия, проходящая через точку

Таким образом, в корреляционном анализе на основе оценок параметров двумерной нормальной совокупности получаем оценки тесноты связи между случайными переменными и можем оценить регрессию одной переменной на другую. Особенностью корреляционного анализа является строго линейная зависимость между переменными. Это обусловливается исходными предпосылками. На практике корреляционный анализ можно применять для обработки наблюдений, сделанных на предприятиях при нормальных условиях работы, если случайные изменения свойства сырья или других факторов вызывают случайные изменения свойств продукции.

Свойства коэффициента корреляции

Коэффициент корреляции является одним из самых распространенных способов измерения связи между случайными переменными. Рассмотрим некоторые свойства этого коэффициента.

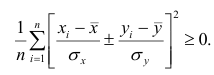

Теорема 1. Коэффициент корреляции принимает значения на интервале (-1, +1).

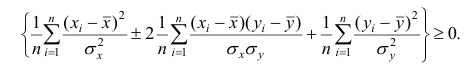

Доказательство. Докажем справедливость утверждения для случая дискретных переменных. Запишем явно неотрицательное выражение:

Возведём выражение под знаком суммы в квадрат:

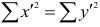

Первое и третье из слагаемых равны единице, поскольку из определения дисперсии следует, что

Таким образом, окончательно получаем

Если коэффициент корреляции положителен, то связь между переменными также положительна и значения переменных увеличиваются или уменьшаются одновременно. Если коэффициент корреляции имеет отрицательное значение, то при увеличении одной переменной уменьшается другая.

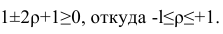

Приведём следующее важное свойство коэффициента корреляции: коэффициент корреляции не зависит от выбора начала отсчёта и единицы измерения, т. е. от любых постоянных

Таким образом, переменные X и У можно уменьшать или увеличивать в а раз, а также вычитать или прибавлять к значениям X и У одно и то же число b. В результате величина коэффициента корреляции не изменится.

Если коэффициент корреляции

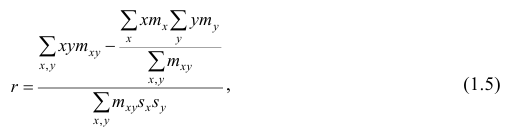

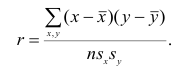

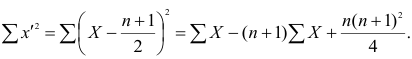

Выборочный коэффициент корреляции вычисляют по формуле (1.2). Имеется несколько модификаций этой формулы, которые удобно использовать при той или иной форме представления исходной информации. Так, при малом числе наблюдений выборочный коэффициент корреляции удобно вычислять по формуле

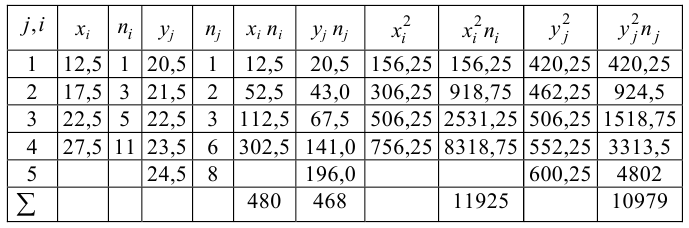

Если информация имеет вид корреляционной таблицы (см. п 1.5), то удобно пользоваться формулой

где

Из формулы (1.2) очевидно, что

Поле корреляции. Вычисление оценок параметров двумерной модели

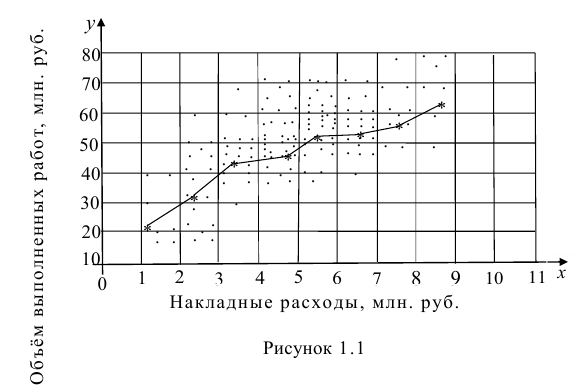

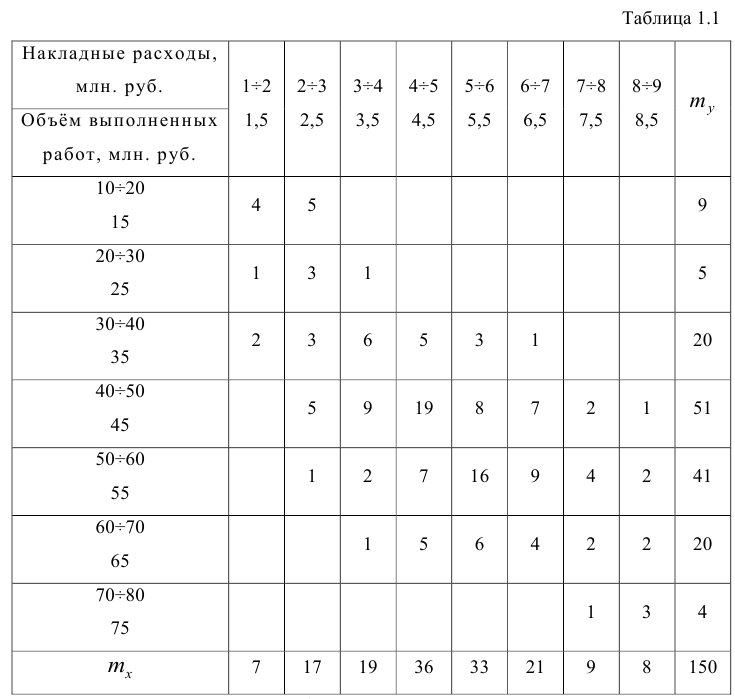

На практике для вычисления оценок параметров двумерной модели удобно использовать корреляционную таблицу и поле корреляции. Пусть, например, изучается зависимость между объёмом выполненных работ (у) и накладными расходами (x). Имеем выборку из генеральной совокупности, состоящую из 150 пар переменных

Пару случайных чисел

По осям координат откладывают или дискретные значения переменных, или интервалы их изменения. Для интервального ряда наносят координатную сетку. Каждую пару переменных из данной выборки изображают в виде точки с соответствующими координатами для дискретного ряда или в виде точки в соответствующей клетке для интервального ряда. Такое изображение корреляционной зависимости называют полем корреляции. На рис. 1.1 изображено поле корреляции для выборки, состоящей из 150 пар переменных (ряд интервальный).

Если вычислить средние значения у в каждом интервале изменения х [обозначим их

Корреляционную таблицу, как и поле корреляции, строят по

сгруппированному ряду (дискретному или интервальному). Табл. 1.1 построена на основе интервального ряда. В первой строке и первом столбце таблицы помещают интервалы изменения х и у и значения середин интервалов. Так, например, 1,5 — середина интервала изменения *=1-2,15— середина интервала изменения у= 10-20. В ячейки, образованные пересечением строк и столбцов, заносят частоты попадания пар значений (л у) в соответствующие интервалы по х и у. Например, частота 4 означает, что в интервал изменения у от 10 до 20 попало 4 пары наблюдавшихся значений. Эти частоты обозначают

Как будет показано в дальнейшем, корреляционно таблицей удобно пользоваться при вычислении коэффициентов корреляций и параметров уравнений регрессии.

Корреляционная таблица построена на основе интервального ряда, поэтому для оценок параметров воспользуемся формулами гл. 1 для вычисления средней арифметической и дисперсии. Имеем:

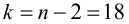

Проверка гипотезы о значимости коэффициента корреляции

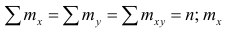

На практике коэффициент корреляции р обычно неизвестен. По результатам выборки может быть найдена его точечная оценка — выборочный коэффициент корреляции r.

Равенство нулю выборочного коэффициента корреляции ещё не свидетельствует о равенстве нулю самого коэффициента корреляции, а следовательно, о некоррелированности случайных величин X и Y. Чтобы выяснить, находятся ли случайные величины в корреляционной зависимости, нужно проверить значимость выборочного коэффициента корреляции г, т.е. установить, достаточна ли его величина для обоснованного вывода о наличии корреляционной связи. Для этого проверяют нулевую гипотезу

которая имеет распределение Стьюдента с k=n-2

степенями свободы. Для проверки нулевой гипотезы по уровню значимости а и числу степеней свободы к находят по таблицам распределения Стьюдента (t-распределение; см. табл. 1 приложения) критическое значение

В случае значимого выборочного коэффициента, корреляции есть смысл построить доверительный интервал для коэффициента корреляций р. Однако для этого нужно знать закон распределения выборочного коэффициента корреляции r.

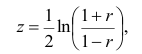

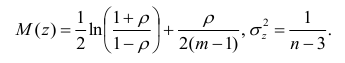

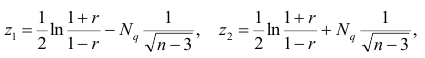

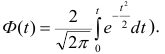

Плотность вероятности выборочного коэффициента корреляции имеет сложный вид, поэтому прибегают к специально подобранным функциям от выборочного коэффициента корреляции, которые сводятся к хорошо изученным распределениям, например нормальному или Стьюдента. Чаще всего для подбора функции применяют преобразование Фишера. Вычисляют статистику:

где r=thz — гиперболический тангенс от z.

Распределение статистики z хорошо аппроксимируется нормальным распределением с параметрами

В этом, случае доверительный интервал для римеетвид

где

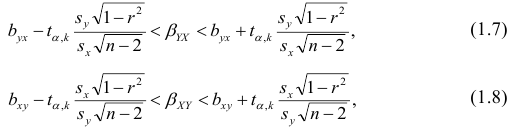

Если коэффициент корреляции значим, то коэффициенты регрессии также значимо отличаются от нуля, а интервальные оценки для них можно получить по следующим формулам:

где

Корреляционное отношение

На практике часто предпосылки корреляционного анализа нарушаются: один из признаков оказывается величиной не случайной, или признаки не имеют совместного нормального распределения. Однако статистическая зависимость между ними существует. Для изучения связи между признаками в этом случае существует общий показатель зависимости признаков, основанный на показателе изменчивости — общей (или полной) дисперсии.

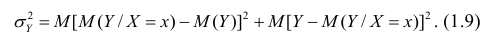

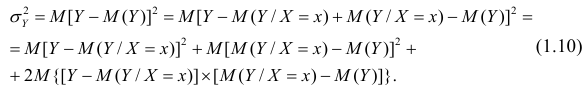

Полной называется дисперсия признака относительно его математического ожидания. Так, для признака Y это

Очевидно, чем меньше влияние прочих факторов, тем теснее связь, тем более приближается она к функциональной. Представим

Первое слагаемое обозначим

Покажем, что

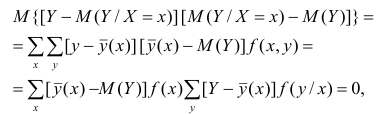

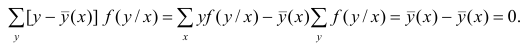

Для простоты полагаем распределение дискретным. Имеем

так как при любом х справедливо равенство

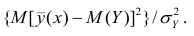

Третье слагаемое в равенстве (1.10) равно нулю, поэтому равенство (1.9) справедливо. Поскольку второе слагаемое в равенстве (1.9) оценивает влияние признака X на Y, то его можно использовать для оценки тесноты связи между X и Y. Тесноту связи удобно оценивать в единицах общей дисперсии

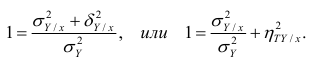

Разделив обе части равенства (1.9) на

Из последней формулы имеем

Поскольку

Все сделанные выводы справедливы и для

следует, что

Далее, из равенства (1.12) следует, что

Аналогичными свойствами обладает

Часто используют величину

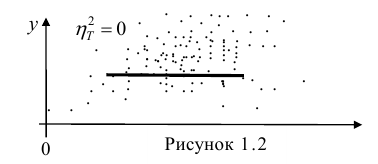

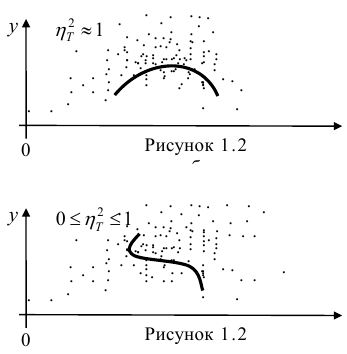

Считают, что она не может быть отрицательной. Значения величины

Значения

Разность

При вычислении

Понятие о многомерном корреляционном анализе

Частный коэффициент корреляции. Основные понятия корреляционного анализа, введенные для двумерной модели, можно распространить на многомерный случай. Задачи и предпосылки корреляционного анализа были сформулированы в п. 1.3. Однако если при изучении взаимосвязи переменных по двумерной модели мы ограничивались рассмотрением парных коэффициентов корреляции, то для многомерной модели этого недостаточно. Многообразие связей между переменными находит отражение в частных и множественных коэффициентах корреляции.

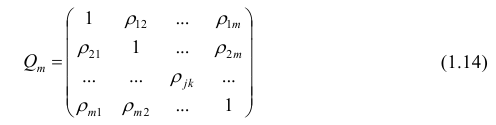

Пусть имеется многомерная нормальная совокупность с m признаками

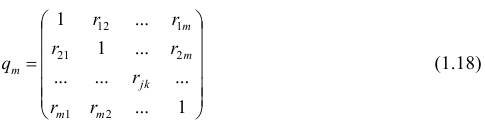

можно описать корреляционной матрицей. Под корреляционной матрицей будем понимать, матрицу, составленную из парных коэффициентов корреляции (вычисляются по формуле (1,1)):

где

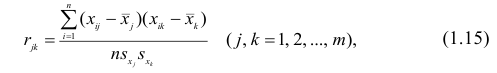

Оценкой парного коэффициента корреляции является выборочный парный коэффициент корреляции, определяемый по формуле (1.2), однако для m признаков формула (9.2) принимает вид

где

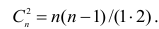

Как и в двумерном случае, для оценки коэффициента корреляции необходимо оценить математические ожидания и дисперсии. В многомерном корреляционном анализе имеем т математических ожиданий и m дисперсий, а также m(m—1)/2 парных коэффициентов корреляции. Таким образом, нужно произвести оценку 2m+m(m—1)/2 параметров.

В случае многомерной корреляции зависимости между признаками более многообразны и сложны, чем в двумерном случае. Одной корреляционной матрицей нельзя полностью описать зависимости между признаками. Введём понятие частного коэффициента корреляции l-го порядка.

Пусть исходная совокупность состоит из т признаков. Можно изучать зависимости между двумя из них при фиксированном значении l признаков из m-2 оставшихся. Рассмотрим, например, систему из 5 признаков. Изучим зависимости между

Рассмотрим более подробно структуру частных коэффициентов корреляции на примере системы из трёх признаков

корреляции и имеет вид

Частный коэффициент корреляции, так же как и парный коэффициент корреляции, изменяется от —1 до +1, В общем виде, когда система состоит из m признаков, частный коэффициент корреляции l-го порядка может быть найден из корреляционной матрицы. Если 1=m—2, то рассматривается матрица порядка m, при

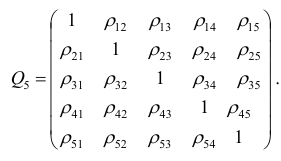

корреляции. Например, корреляционная матрица системы из пяти признаков имеет вид

Для определения частного коэффициента корреляции второго порядка, например

вычеркнув из исходной матрицы

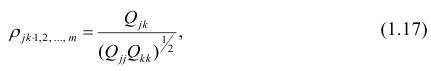

В общем виде формулу частного коэффициента корреляции l-го порядка (1=m—2) можно записать в виде

где

матрицы

Очевидно, что выражение (1.16) является частым случаем выражения (1.17), в чём легко убедиться, рассмотрев корреляционную матрицу

Оценкой частного коэффициента корреляции l-го порядка является выборочный частный коэффициент корреляции l-го порядка. Он вычисляется на основе корреляционной матрицы, составленной из выборочных парных коэффициентов корреляции:

Формула выборочного частного коэффициента корреляции имеет вид

где

Частный коэффициент корреляции l-го порядка, вызволенный на основе п наблюдений над признаками, имеет такое же распределение, что и парный коэффициент корреляции, вычисленный

Множественный коэффициент корреляции

Часто представляет интерес оценить связь одного из признаков со всеми остальными. Это можно сделать с помощью множественного, или совокупного, коэффициента корреляции

где

дополнение к элементу

Квадрат коэффициента множественной корреляции

множественным коэффициентом детерминации. Коэффициенты множественной корреляции и детерминации — величины положительные, принимающие значения в интервале

коэффициентов являются выборочные множественные коэффициенты корреляции и детерминации, которые обозначают соответственно

где

Многомерный корреляционный анализ позволяет получить оценку функции регрессии — уравнение регрессии. Коэффициенты в уравнении регрессии можно найти непосредственно через выборочные парные коэффициенты корреляции или воспользоваться методом многомерной регрессии, который мы рассмотрим в вопросе 2.7. В этом случае все предпосылки регрессионного анализа оказываются выполненными и, кроме того, связь между переменными строго линейна.

Ранговая корреляция

В некоторых случаях встречаются признаки, не поддающиеся количественной оценке (назовём такие признаки объектами). Попытаемся, например, оценить соотношение между математическими и музыкальными способностями группы учащихся. «Уровень способностей» является переменной величиной в том смысле; что он варьирует от одного индивидуума к другому. Его можно измерить, если выставлять каждому индивидууму отметки. Однако этот способ лишен объективности, так как разные экзаменаторы могут выставить одному и тому же учащемуся разные отметки. Элемент субъективизма можно исключить, если учащиеся будут ранжированы. Расположим учащихся по порядку, в соответствии со степенью способностей и присвоим каждому из них порядковый номер, который назовем рангом. Корреляция между рангами более точно отражает соотношение между способностями учащихся, чем корреляция между отметками.

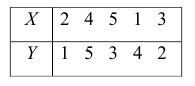

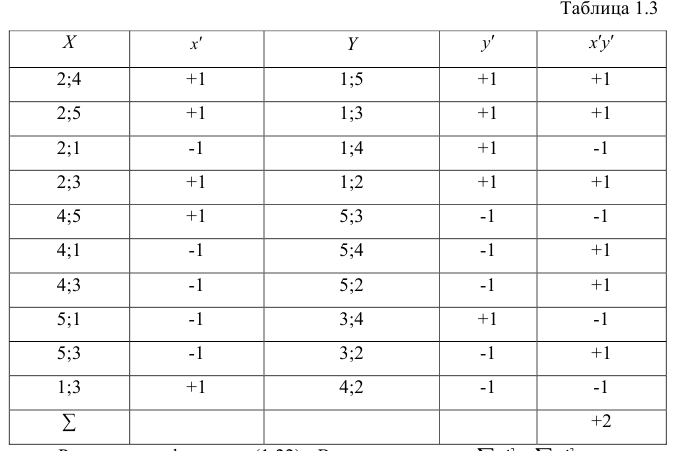

Тесноту связи между рангами измеряют так же, как и между признаками. Рассмотрим уже известную формулу коэффициента корреляции

Пусть

что

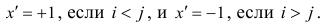

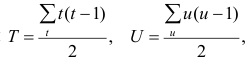

В зависимости от того, что принять за меру различия между величинами

Введём следующую меру различия между объектами: будем считать

Рассмотрим отдельно каждую из них. В последовательности X первой паре элементов —2; 4 припишем значение +1, так как

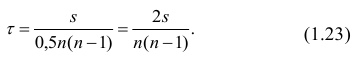

Рассмотрим формулу ( 1 .22). В нашем случае

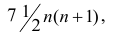

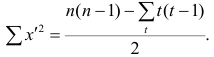

количеству пар, участвовавших в переборе. Каждая пара встречается только один раз, поэтому их общее количество равно числу сочетаний из n по 2, т.е.

Теперь рассмотрим другую меру различия между объектами. Если обозначить через

Тогда

чисел натурального ряда равна

Тогда

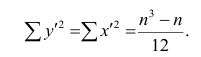

Введём новую величину d, равную разности между рангами: d=X—Y, и определим через неё величину

Коэффициент корреляции рангов Спирмэна

У коэффициентов

При вычислении коэффициента корреляций рангов Кэнделла для подсчёта s можно использовать следующий приём: одну из последовательностей упорядочивают так, чтобы её элементы были числами натурального ряда; соответственно изменяют и другую последовательность. Тогда сумму

Если нельзя установить ранговое различие нескольких объектов, говорят, что такие объекты являются связанными. В этом случае объектам приписывается средний ранг. Например, если связанными являются объекты 4 и 5, то им приписывают ранг 4.5; если связанными являются объекты 1, 2, 3, 4 и 5, то их средний ранг (1+2+3+4+5)/5=3. Сумма рангов связанных объектов должна быть равна сумме рангов при ранжировании без связей. Формулы коэффициентов корреляции для

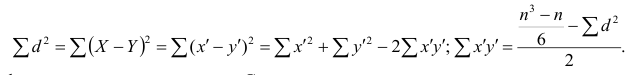

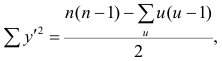

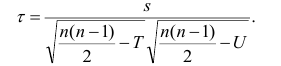

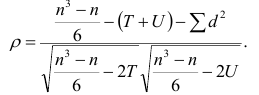

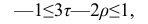

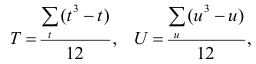

где t и u—число связанных пар в последовательностях.

Обозначая

Аналогично находим выражение для р. Только в этом случае

последовательностях, а

Если имеется несколько последовательностей, то возникает необходимость определить общую меру согласованности между ними. Такой мерой является коэффициент копкордации.

Пусть ь — число последовательностей, т — количество рангов в каждой последовательности. Тогда коэффициент конкордации

где d — фактически встречающееся отклонение от среднего значения суммы рангов одного объекта.

Коэффициент корреляции рангов может быть использован для быстрого оценивания взаимосвязи между признаками, не имеющими нормального распределения, и полезен в тех случаях, когда признаки поддаются ранжированию, но не могут быть точно измерены.

Пример:

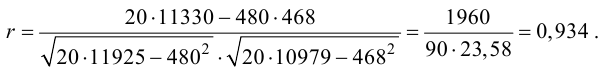

Для данных табл. 13 найти выборочный коэффициент корреляции, проверить его значимость на уровне

Решение. Для вычислений составим таблицу. Находим суммы

Подставляя полученные значения сумм в (8), найдем выборочный коэффициент корреляции

Проверим значимость

По таблице распределения П6 Стьюдента

Пример:

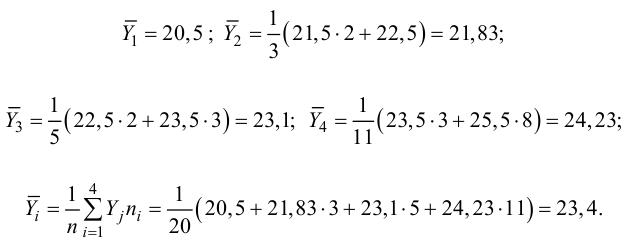

Для данных табл. 13 найти корреляционное отношение

Для вычисления эмпирического корреляционного отношения найдем групповые средние

Тогда

Вычисляем корреляционное отношение

- Статистические решающие функции

- Случайные процессы

- Выборочный метод

- Статистическая проверка гипотез

- Доверительный интервал для математического ожидания

- Доверительный интервал для дисперсии

- Проверка статистических гипотез

- Регрессионный анализ

Постановка задачи

При статистическом анализе зависимостей между количественными переменными возникают ситуации, когда представляет интерес расчет и анализ такого показателя как корреляционное отношение (η).

Данный показатель незаслуженно обойден вниманием в большинстве доступных для пользователей математических пакетов.

В данном разборе рассмотрим способы расчета и анализа η средствами Python.

Не будем углубляться в теорию (про η достаточно подробно написано, например, в [1, с.73], [2, с.412], [3, с.609]), но вспомним основные свойства η:

-

η характеризует степень тесноты любой корреляционной связи (как линейной, так и нелинейной), в отличие от коэффициента корреляции Пирсона r, который характеризует тесноту только линейной связи. Условие r=0 означает отсутствие линейной корреляционной связи между величинами, но при этом между ними может существовать нелинейная корреляционная связь (η>0).

-

η принимает значения от 0 до 1; при η=0 корреляционная связь отсутствует, при η=1 связь считается функциональной; степень тесноты связи можно оценивать по различным общепринятым шкалам, например, по шкале Чеддока и др.

-

Величина η² характеризует долю вариации, объясненной корреляционной связью между рассматриваемыми переменными.

-

η не может быть меньше абсолютной величины r: η ≥ |r|.

-

η несимметрично по отношению к исследуемым переменным, то есть ηXY ≠ ηYX.

-

Для расчета η необходимо иметь эмпирические данные эксперимента с повторностями; если же мы имеем просто два набора значений переменных X и Y, то данные нужно группировать. Этот вывод, в общем-то, очевиден – если предпринять попытку рассчитать η по негруппированным данным, получим результат η=1.

Группировка данных для расчета η заключается в разбиении области значений переменных X и Y на интервалы, подсчет частот попадания данных в интервалы и формирование корреляционной таблицы.

Важное замечание: особенности методики расчета корреляционного отношения, особенно при форме связи, близкой к линейной, и η близком к единице, могут привести к результатам, в общем-то абсурдным, например:

-

когда нарушается условие η ≥ |r|;

-

когда r окажется значим, а η нет;

-

когда нижняя граница доверительного интервала для η окажется меньше 0 или верхняя граница – больше 1.

Это нужно учитывать при выполнении анализа.

Итак, перейдем к расчетам.

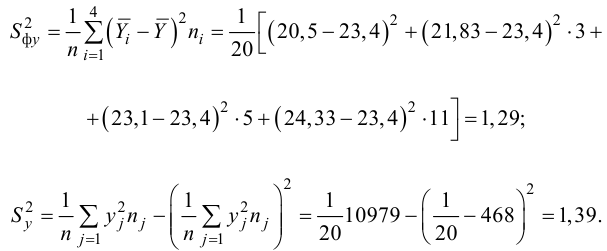

Формирование исходных данных

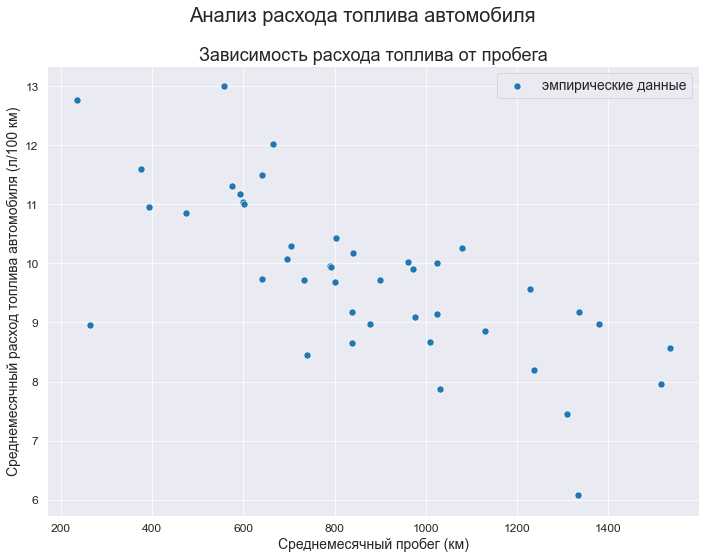

В качестве исходных данных рассмотрим зависимость расхода среднемесячного расхода топлива автомобиля (л/100 км) (FuelFlow) от среднемесячного пробега (км) (Mileage).

Загрузим исходные данные из csv-файла (исходные данные доступны в моем репозитории на GitHub):

fuel_df = pd.read_csv(

filepath_or_buffer='data/fuel_df.csv',

sep=';',

index_col='Number')

dataset_df = fuel_df.copy() # создаем копию исходной таблицы для работы

display(dataset_df.head())Загруженный DataFrame содержит следующие столбцы:

-

Month — месяц (в формате Excel)

-

Mileage – месячный пробег (км)

-

Temperature – среднемесячная температура (°C)

-

FuelFlow – среднемесячный расход топлива (л/100 км)

Сохраним нужные нам переменные Mileage и FuelFlow в виде numpy.ndarray.

X = np.array(dataset_df['Mileage'])

Y = np.array(dataset_df['FuelFlow'])Для удобства дальнейшей работы сформируем сформируем отдельный DataFrame из двух переменных – X и Y:

data_XY_df = pd.DataFrame({

'X': X,

'Y': Y})Настройка заголовков отчета (для дальнейшего формирования графиков):

# Общий заголовок проекта

Task_Project = "Расчет и анализ корреляционного отношения средствами Python"

# Заголовок, фиксирующий момент времени

AsOfTheDate = ""

# Заголовок раздела проекта

Task_Theme = "Анализ расхода топлива автомобиля"

# Общий заголовок проекта для графиков

Title_String = f"{Task_Project}n{AsOfTheDate}"

# Наименования переменных

Variable_Name_X = "Среднемесячный пробег (км)"

Variable_Name_Y = "Среднемесячный расход топлива автомобиля (л/100 км)"Визуализация и первичная обработка данных

Предварительно отсеем аномальные значения (выбросы). Подробно не будем останавливаться на этой процедуре, она не является целью данного разбора.

mask1 = data_XY_df['X'] > 200

mask2 = data_XY_df['X'] < 2000

data_XY_df = data_XY_df[mask1 & mask2]

X = np.array(data_XY_df['X'])

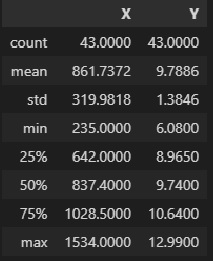

Y = np.array(data_XY_df['Y'])Описательная статистика исходных данных:

data_XY_df.describe()Выполним визуализацию исходных данных:

fig, axes = plt.subplots(figsize=(297/INCH, 210/INCH))

fig.suptitle(Task_Theme)

axes.set_title('Зависимость расхода топлива от пробега')

data_df = data_XY_df

sns.scatterplot(

data=data_df,

x='X', y='Y',

label='эмпирические данные',

s=50,

ax=axes)

axes.set_xlabel(Variable_Name_X)

axes.set_ylabel(Variable_Name_Y)

#axes.tick_params(axis="x", labelsize=f_size+4)

#axes.tick_params(axis="y", labelsize=f_size+4)

#axes.legend(prop={'size': f_size+6})

plt.show()

fig.savefig('graph/scatterplot_XY_sns.png', orientation = "portrait", dpi = 300)Для визуальной оценки выборочных данных построим гистограммы и коробчатые диаграммы:

fig = plt.figure(figsize=(420/INCH, 297/INCH))

ax1 = plt.subplot(2,2,1)

ax2 = plt.subplot(2,2,2)

ax3 = plt.subplot(2,2,3)

ax4 = plt.subplot(2,2,4)

fig.suptitle(Task_Theme)

ax1.set_title('X')

ax2.set_title('Y')

# инициализация данных

data_df = data_XY_df

X_mean = data_df['X'].mean()

X_std = data_df['X'].std(ddof = 1)

Y_mean = data_df['Y'].mean()

Y_std = data_df['Y'].std(ddof = 1)

bins_hist = 'sturges' # выбор числа интервалов ('auto', 'fd', 'doane', 'scott', 'stone', 'rice', 'sturges', 'sqrt')

# данные для графика плотности распределения X

xmin = np.amin(data_df['X'])

xmax = np.amax(data_df['X'])

nx = 100

hx = (xmax - xmin)/(nx - 1)

x1 = np.linspace(xmin, xmax, nx)

xnorm1 = sps.norm.pdf(x1, X_mean, X_std)

kx = len(np.histogram(X, bins=bins_hist, density=False)[0])

xnorm2 = xnorm1*len(X)*(xmax-xmin)/kx

# данные для графика плотности распределения Y

ymin = np.amin(Y)

ymax = np.amax(Y)

ny = 100

hy = (ymax - ymin)/(ny - 1)

y1 = np.linspace(ymin, ymax, ny)

ynorm1 = sps.norm.pdf(y1, Y_mean, Y_std)

ky = len(np.histogram(Y, bins=bins_hist, density=False)[0])

ynorm2 = ynorm1*len(Y)*(ymax-ymin)/ky

# гистограмма распределения X

ax1.hist(

data_df['X'],

bins=bins_hist,

density=False,

histtype='bar', # 'bar', 'barstacked', 'step', 'stepfilled'

orientation='vertical', # 'vertical', 'horizontal'

color = "#1f77b4",

label='эмпирическая частота')

ax1.plot(

x1, xnorm2,

linestyle = "-",

color = "r",

linewidth = 2,

label = 'теоретическая нормальная кривая')

ax1.axvline(X_mean, color='magenta', label = 'среднее значение')

ax1.axvline(np.median(data_df['X']), color='orange', label = 'медиана')

ax1.legend(fontsize = f_size+4)

# гистограмма распределения Y

ax2.hist(

data_df['Y'],

bins=bins_hist,

density=False,

histtype='bar', # 'bar', 'barstacked', 'step', 'stepfilled'

orientation='vertical', # 'vertical', 'horizontal'

color = "#1f77b4",

label='эмпирическая частота')

ax2.plot(

y1, ynorm2,

linestyle = "-",

color = "r",

linewidth = 2,

label = 'теоретическая нормальная кривая')

ax2.axvline(Y_mean, color='magenta', label = 'среднее значение')

ax2.axvline(np.median(data_df['Y']), color='orange', label = 'медиана')

ax2.legend(fontsize = f_size+4)

# коробчатая диаграмма X

sns.boxplot(

#data=corn_yield_df,

x=data_df['X'],

orient='h',

width=0.3,

ax=ax3)

# коробчатая диаграмма Y

sns.boxplot(

#data=corn_yield_df,

x=data_df['Y'],

orient='h',

width=0.3,

ax=ax4)

# подписи осей

ax3.set_xlabel(Variable_Name_X)

ax4.set_xlabel(Variable_Name_Y)

plt.show()

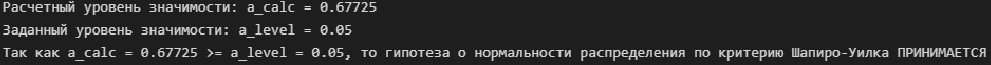

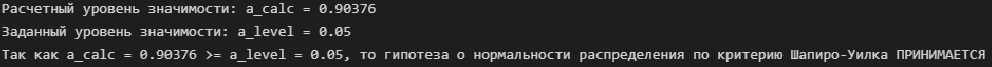

fig.savefig('graph/scatterplot_boxplot_X_Y_sns.png', orientation = "portrait", dpi = 300)Перед тем, как приступать к дальнейшим расчетам, проверим исходные данные на соответствие нормальному закону распределения.

Выполнять такую проверку нужно обязательно, так как только для нормально распределенных данных мы можем в дальнейшем использовать общепринятые статистические процедуры анализа: проверку значимости корреляционного отношения, построение доверительных интервалов и т.д.

Для проверки нормальности распределения воспользуемся критерием Шапиро-Уилка:

# функция для обработки реализации теста Шапиро-Уилка

def Shapiro_Wilk_test(data):

data = np.array(data)

result = sci.stats.shapiro(data)

s_calc = result.statistic # расчетное значение статистики критерия

a_calc = result.pvalue # расчетный уровень значимости

print(f"Расчетный уровень значимости: a_calc = {round(a_calc, DecPlace)}")

print(f"Заданный уровень значимости: a_level = {round(a_level, DecPlace)}")

if a_calc >= a_level:

conclusion_ShW_test = f"Так как a_calc = {round(a_calc, DecPlace)} >= a_level = {round(a_level, DecPlace)}" +

", то гипотеза о нормальности распределения по критерию Шапиро-Уилка ПРИНИМАЕТСЯ"

else:

conclusion_ShW_test = f"Так как a_calc = {round(a_calc, DecPlace)} < a_level = {round(a_level, DecPlace)}" +

", то гипотеза о нормальности распределения по критерию Шапиро-Уилка ОТВЕРГАЕТСЯ"

print(conclusion_ShW_test)# проверка нормальности распределения переменной X

Shapiro_Wilk_test(X)# проверка нормальности распределения переменной Y

Shapiro_Wilk_test(Y)Итак, гипотеза о нормальном распределении исходных данных принимается, что позволяет нам в дальнейшем пользоваться статистическим инструментарием для интервального оценивания величины η, проверки гипотез и т.д.

Переходим собственно к расчету корреляционного отношения.

Переходим собственно к расчету корреляционного отношения.

Расчёт и анализ корреляционного отношения

1. Выполним группировку исходных данным по обоим признакам X и Y:

Создадим новую переменную matrix_XY_df для работы с группированными данными:

matrix_XY_df = data_XY_df.copy()Определим число интервалов группировки (воспользуемся формулой Стерджесса); при этом минимальное число интервалов должно быть не менее 2:

# объем выборки для переменных X и Y

n_X = len(X)

n_Y = len(Y)

# число интервалов группировки

group_int_number = lambda n: round (3.31*log(n_X, 10)+1) if round (3.31*log(n_X, 10)+1) >=2 else 2

K_X = group_int_number(n_X)

K_Y = group_int_number(n_Y)

print(f"Число интервалов группировки для переменной X: {K_X}")

print(f"Число интервалов группировки для переменной Y: {K_Y}")Выполним группировку данных средствами библиотеки pandas, для этого воспользуемся функцией pandas.cut. В результате получим новые признаки cut_X и cut_X, которые показывают, в какой из интервалов попадает конкретное значение X и Y. Полученные новые признаки добавим в DataFrame matrix_XY_df:

cut_X = pd.cut(X, bins=K_X)

cut_Y = pd.cut(Y, bins=K_Y)

matrix_XY_df['cut_X'] = cut_X

matrix_XY_df['cut_Y'] = cut_Y

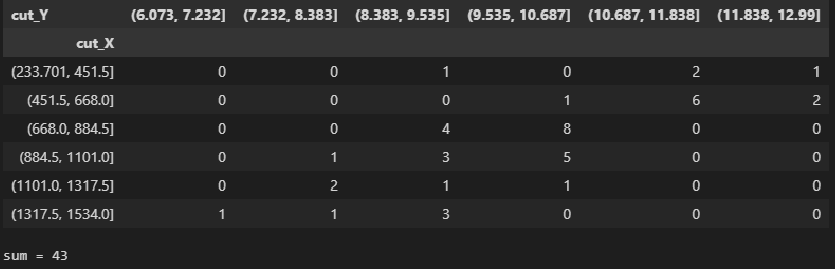

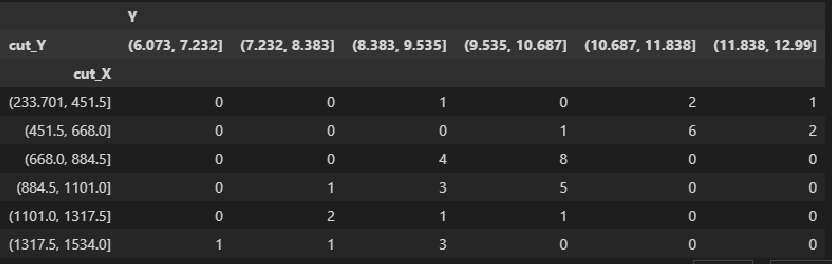

display(matrix_XY_df.head())Теперь мы можем получить корреляционную таблицу с помощью функции pandas.crosstab:

CorrTable_df = pd.crosstab(

index=matrix_XY_df['cut_X'],

columns=matrix_XY_df['cut_Y'],

rownames=['cut_X'],

colnames=['cut_Y'])

display(CorrTable_df)

# проверка правильности подсчета частот по интервалам

print(f"sum = {np.sum(np.array(CorrTable_df))}")Функция pandas.crosstab также позволяет формировать более ровные и удобные для восприятия границы интервалов группировки путем задания их вручную. Для расчета η это принципиального значения не имеет, но в отдельных случаях может быть полезно.

Например, зададим вручную границы интервалов группировки для X и Y:

bins_X = pd.IntervalIndex.from_tuples([(200, 400), (400, 600), (600, 800), (800, 1000), (1000, 1200), (1200, 1400), (1400, 1600)])

cut_X = pd.cut(X, bins=bins_X)

bins_Y = pd.IntervalIndex.from_tuples([(6.0, 7.0), (7.0, 8.0), (8.0, 9.0), (9.0, 10.0), (10.0, 11.0), (11.0, 12.0), (12.0, 13.0)])

cut_Y = pd.cut(X, bins=bins_Y)

CorrTable_df2 = pd.crosstab(

index=pd.cut(X, bins=bins_X),

columns=pd.cut(Y, bins=bins_Y),

rownames=['cut_X'],

colnames=['cut_Y'])

display(CorrTable_df2)

# проверка правильности подсчета частот по интервалам

print(f"sum = {np.sum(np.array(CorrTable_df2))}")Есть и другой способ получения корреляционной таблицы – с помощью pandas.pivot_table:

matrix_XY_df.pivot_table(

values=['Y'],

index='cut_X',

columns='cut_Y',

aggfunc=len,

fill_value=0)2. Выполним расчет корреляционного отношения:

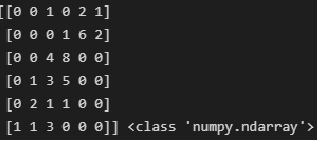

Для дальнейших расчетов приведем корреляционную таблицу к типу numpy.ndarray:

CorrTable_np = np.array(CorrTable_df)

print(CorrTable_np, type(CorrTable_np))Итоги корреляционной таблицы по строкам и столбцам:

# итоги по строкам

n_group_X = [np.sum(CorrTable_np[i]) for i in range(K_X)]

print(f"n_group_X = {n_group_X}")

# итоги по столбцам

n_group_Y = [np.sum(CorrTable_np[:,j]) for j in range(K_Y)]

print(f"n_group_Y = {n_group_Y}")Также нам необходимо получить среднегрупповые значения X и Y для каждой группы (интервала). При этом нужно помнить, что функция pandas.crosstab при группировании расширяет крайние диапазоны на 0.1% с каждой стороны, чтобы включить минимальное и максимальное значения.

Для доступа к данным – границам интервалов, полученным с помощью pandas.cut – существуют методы right и left:

# Среднегрупповые значения переменной X

Xboun_mean = [(CorrTable_df.index[i].left + CorrTable_df.index[i].right)/2 for i in range(K_X)]

Xboun_mean[0] = (np.min(X) + CorrTable_df.index[0].right)/2 # исправляем значения в крайних интервалах

Xboun_mean[K_X-1] = (CorrTable_df.index[K_X-1].left + np.max(X))/2

print(f"Xboun_mean = {Xboun_mean}")

# Среднегрупповые значения переменной Y

Yboun_mean = [(CorrTable_df.columns[j].left + CorrTable_df.columns[j].right)/2 for j in range(K_Y)]

Yboun_mean[0] = (np.min(Y) + CorrTable_df.columns[0].right)/2 # исправляем значения в крайних интервалах

Yboun_mean[K_Y-1] = (CorrTable_df.columns[K_Y-1].left + np.max(Y))/2

print(f"Yboun_mean = {Yboun_mean}", 'n')Находим средневзевешенные значения X и Y для каждой группы:

Xmean_group = [np.sum(CorrTable_np[:,j] * Xboun_mean) / n_group_Y[j] for j in range(K_Y)]

print(f"Xmean_group = {Xmean_group}")

Ymean_group = [np.sum(CorrTable_np[i] * Yboun_mean) / n_group_X[i] for i in range(K_X)]

print(f"Ymean_group = {Ymean_group}")Общая дисперсия X и Y:

Sum2_total_X = np.sum(n_group_X * (Xboun_mean - np.mean(X))**2)

print(f"Sum2_total_X = {Sum2_total_X}")

Sum2_total_Y = np.sum(n_group_Y * (Yboun_mean - np.mean(Y))**2)

print(f"Sum2_total_Y = {Sum2_total_Y}")Межгрупповая дисперсия X и Y (дисперсия групповых средних):

Sum2_between_group_X = np.sum(n_group_Y * (Xmean_group - np.mean(X))**2)

print(f"Sum2_between_group_X = {Sum2_between_group_X}")

Sum2_between_group_Y = np.sum(n_group_X * (Ymean_group - np.mean(Y))**2)

print(f"Sum2_between_group_Y = {Sum2_between_group_Y}")Внутригрупповая дисперсия X и Y (возникает за счет других факторов – не связанных с другой переменной):

print(f"Sum2_within_group_X = {Sum2_total_X - Sum2_between_group_X}")

print(f"Sum2_within_group_Y = {Sum2_total_Y - Sum2_between_group_Y}")Эмпирическое корреляционное отношение:

corr_ratio_XY = sqrt(Sum2_between_group_Y / Sum2_total_Y)

print(f"corr_ratio_XY = {corr_ratio_XY}")

corr_ratio_YX = sqrt(Sum2_between_group_X / Sum2_total_X)

print(f"corr_ratio_YX = {corr_ratio_YX}")Итак, мы получили результат – значение корреляционного отношения.

Оценим тесноту корреляционной связи по шкале Чеддока, для удобства создадим пользовательскую функцию:

def Cheddock_scale_check(r, name='r'):

# задаем шкалу Чеддока

Cheddock_scale = {

f'no correlation (|{name}| <= 0.1)': 0.1,

f'very weak (0.1 < |{name}| <= 0.2)': 0.2,

f'weak (0.2 < |{name}| <= 0.3)': 0.3,

f'moderate (0.3 < |{name}| <= 0.5)': 0.5,

f'perceptible (0.5 < |{name}| <= 0.7)': 0.7,

f'high (0.7 < |{name}| <= 0.9)': 0.9,

f'very high (0.9 < |{name}| <= 0.99)': 0.99,

f'functional (|{name}| > 0.99)': 1.0}

r_scale = list(Cheddock_scale.values())

for i, elem in enumerate(r_scale):

if abs(r) <= elem:

conclusion_Cheddock_scale = list(Cheddock_scale.keys())[i]

break

return conclusion_Cheddock_scaleШкала Чеддока изначально предназначалась для оценки тесноты линейно корреляционной связи (на основе коэффициента корреляции Пирсона r), но мы ее применим и для корреляционного отношения η (не забывая про свойство η ≥ r!). В выводе функции Cheddock_scale_check можно указать символ, обозначающий величину – аргумент name=chr(951) выводит η вместо r.

В современных исследованиях шкала Чеддока теряет популярность, в последние годы все чаще применяется шкала Эванса (в психосоциальных, медико-биологических и др.исследованиях) ( более подробно про шкалы Чеддока, Эванса и др. – см.[4]). Оценим тесноту корреляционной связи по шкале Эванса, для удобства также создадим пользовательскую функцию:

def Evans_scale_check(r, name='r'):

# задаем шкалу Эванса

Evans_scale = {

f'very weak (|{name}| < 0.19)': 0.2,

f'weak (0.2 < |{name}| <= 0.39)': 0.4,

f'moderate (0.4 < |{name}| <= 0.59)': 0.6,

f'strong (0.6 < |{name}| <= 0.79)': 0.8,

f'very strong (0.8 < |{name}| <= 1.0)': 1.0}

r_scale = list(Evans_scale.values())

for i, elem in enumerate(r_scale):

if abs(r) <= elem:

conclusion_Evans_scale = list(Evans_scale.keys())[i]

break

return conclusion_Evans_scale

print(f"Оценка тесноты корреляции по шкале Эванса: {Evans_scale_check(corr_ratio_XY, name=chr(951))}")Итак, степень тесноты корреляционной связи может быть оценена как высокая (по шкале Чеддока), сильная (по шкале Эванса).

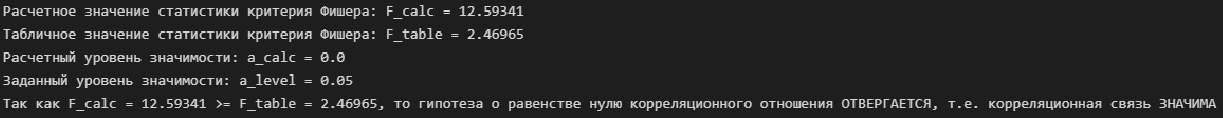

3. Проверка значимости корреляционного отношения:

Рассмотрим нулевую гипотезу:

H0: ηXY = 0

H1: ηXY ≠ 0Для проверки нулевой гипотезы воспользуемся критерием Фишера:

# расчетное значение статистики критерия Фишера

F_corr_ratio_calc = (n_X - K_X)/(K_X - 1) * corr_ratio_XY**2 / (1 - corr_ratio_XY**2)

print(f"Расчетное значение статистики критерия Фишера: F_calc = {round(F_corr_ratio_calc, DecPlace)}")

# табличное значение статистики критерия Фишера

dfn = K_X - 1

dfd = n_X - K_X

F_corr_ratio_table = sci.stats.f.ppf(p_level, dfn, dfd, loc=0, scale=1)

print(f"Табличное значение статистики критерия Фишера: F_table = {round(F_corr_ratio_table, DecPlace)}")

# расчетный уровень значимости

a_corr_ratio_calc = 1 - sci.stats.f.cdf(F_corr_ratio_calc, dfn, dfd, loc=0, scale=1)

print(f"Расчетный уровень значимости: a_calc = {round(a_corr_ratio_calc, DecPlace)}")

print(f"Заданный уровень значимости: a_level = {round(a_level, DecPlace)}")

# вывод

if F_corr_ratio_calc < F_corr_ratio_table:

conclusion_corr_ratio_sign = f"Так как F_calc = {round(F_corr_ratio_calc, DecPlace)} < F_table = {round(F_corr_ratio_table, DecPlace)}" +

", то гипотеза о равенстве нулю корреляционного отношения ПРИНИМАЕТСЯ, т.е. корреляционная связь НЕЗНАЧИМА"

else:

conclusion_corr_ratio_sign = f"Так как F_calc = {round(F_corr_ratio_calc, DecPlace)} >= F_table = {round(F_corr_ratio_table, DecPlace)}" +

", то гипотеза о равенстве нулю корреляционного отношения ОТВЕРГАЕТСЯ, т.е. корреляционная связь ЗНАЧИМА"

print(conclusion_corr_ratio_sign)4. Доверительный интервал для корреляционного отношения:

# число степеней свободы

f1 = round ((K_X - 1 + n_X * corr_ratio_XY**2)**2 / (K_X - 1 + 2 * n_X * corr_ratio_XY**2))

f2 = n_X - K_X

# вспомогательные величины

z1 = (n_X - K_X) / n_X * corr_ratio_XY**2 / (1 - corr_ratio_XY**2) * 1/sci.stats.f.ppf(p_level, f1, f2, loc=0, scale=1) - (K_X - 1)/n_X

z2 = (n_X - K_X) / n_X * corr_ratio_XY**2 / (1 - corr_ratio_XY**2) * 1/sci.stats.f.ppf(1 - p_level, f1, f2, loc=0, scale=1) - (K_X - 1)/n_X

# доверительный интервал

corr_ratio_XY_low = sqrt(z1) if sqrt(z1) >= 0 else 0

corr_ratio_XY_high = sqrt(z2) if sqrt(z2) <= 1 else 1

print(f"{p_level*100}%-ный доверительный интервал для корреляционного отношения: {[round(corr_ratio_XY_low, DecPlace), round(corr_ratio_XY_high, DecPlace)]}")Важное замечание: при значениях η близких к 0 или 1 левая или правая граница доверительного интервала может выходить за пределы отрезка [0; 1], теряя содержательный смысл (см. [1, с.80]). Причина этого – в аппроксимационном подходе к определению границ доверительного интервала. Подобные нежелательные явления возможны, и их нужно учитывать при выполнении анализа.

5. Проверка значимости отличия линейной корреляционной связи от нелинейной:

Оценим величину коэффициента линейной корреляции:

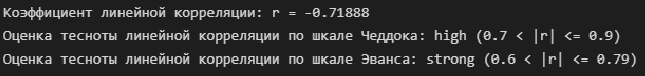

corr_coef = sci.stats.pearsonr(X, Y)[0]

print(f"Коэффициент линейной корреляции: r = {round(corr_coef, DecPlace)}")

print(f"Оценка тесноты линейной корреляции по шкале Чеддока: {Cheddock_scale_check(corr_coef)}")

print(f"Оценка тесноты линейной корреляции по шкале Эванса: {Evans_scale_check(corr_coef)}")Проверим значимость коэффициента линейной корреляции:

# расчетный уровень значимости

a_corr_coef_calc = sci.stats.pearsonr(X, Y)[1]

print(f"Расчетный уровень значимости коэффициента линейной корреляции: a_calc = {a_corr_coef_calc}")

print(f"Заданный уровень значимости: a_level = {round(a_level, DecPlace)}")

# вывод

if a_corr_coef_calc >= a_level:

conclusion_corr_coef_sign = f"Так как a_calc = {a_corr_coef_calc} >= a_level = {round(a_level, DecPlace)}" +

", то гипотеза о равенстве нулю коэффициента линейной корреляции ПРИНИМАЕТСЯ, т.е. линейная корреляционная связь НЕЗНАЧИМА"

else:

conclusion_corr_coef_sign = f"Так как a_calc = {a_corr_coef_calc} < a_level = {round(a_level, DecPlace)}" +

", то гипотеза о равенстве нулю коэффициента линейной корреляции ОТВЕРГАЕТСЯ, т.е. линейная корреляционная связь ЗНАЧИМА"

print(conclusion_corr_coef_sign)Теперь проверим значимость отличия линейной корреляционной связи от нелинейной. Для этого рассмотрим нулевую гипотезу:

H0: η² - r² = 0

H1: η² - r² ≠ 0Для проверки нулевой гипотезы воспользуемся критерием Фишера:

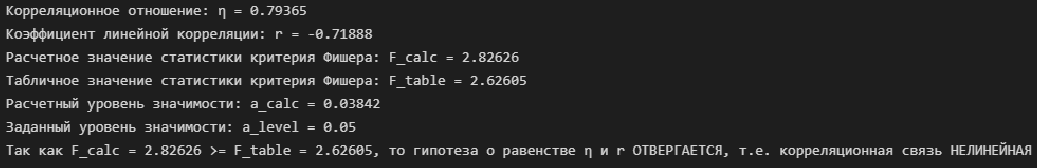

print(f"Корреляционное отношение: {chr(951)} = {round(corr_ratio_XY, DecPlace)}")

print(f"Коэффициент линейной корреляции: r = {round(corr_coef, DecPlace)}")

# расчетное значение статистики критерия Фишера

F_line_corr_sign_calc = (n_X - K_X)/(K_X - 2) * (corr_ratio_XY**2 - corr_coef**2) / (1 - corr_ratio_XY**2)

print(f"Расчетное значение статистики критерия Фишера: F_calc = {round(F_line_corr_sign_calc, DecPlace)}")

# табличное значение статистики критерия Фишера

dfn = K_X - 2

dfd = n_X - K_X

F_line_corr_sign_table = sci.stats.f.ppf(p_level, dfn, dfd, loc=0, scale=1)

print(f"Табличное значение статистики критерия Фишера: F_table = {round(F_line_corr_sign_table, DecPlace)}")

# расчетный уровень значимости

a_line_corr_sign_calc = 1 - sci.stats.f.cdf(F_line_corr_sign_calc, dfn, dfd, loc=0, scale=1)

print(f"Расчетный уровень значимости: a_calc = {round(a_line_corr_sign_calc, DecPlace)}")

print(f"Заданный уровень значимости: a_level = {round(a_level, DecPlace)}")

# вывод

if F_line_corr_sign_calc < F_line_corr_sign_table:

conclusion_line_corr_sign = f"Так как F_calc = {round(F_line_corr_sign_calc, DecPlace)} < F_table = {round(F_line_corr_sign_table, DecPlace)}" +

f", то гипотеза о равенстве {chr(951)} и r ПРИНИМАЕТСЯ, т.е. корреляционная связь ЛИНЕЙНАЯ"

else:

conclusion_line_corr_sign = f"Так как F_calc = {round(F_line_corr_sign_calc, DecPlace)} >= F_table = {round(F_line_corr_sign_table, DecPlace)}" +

f", то гипотеза о равенстве {chr(951)} и r ОТВЕРГАЕТСЯ, т.е. корреляционная связь НЕЛИНЕЙНАЯ"

print(conclusion_line_corr_sign)Создание пользовательской функции для корреляционного анализа

Для практической работы целесообразно все вышеприведенные расчеты реализовать в виде пользовательских функций:

-

функция corr_coef_check – для расчета и анализа коэффициента линейной корреляции Пирсона

-

функция corr_ratio_check – для расчета и анализа корреляционного отношения

-

функция line_corr_sign_check – для проверка значимости линейной корреляционной связи

Данные функции выводят результаты анализа в виде DataFrame, что удобно для визуального восприятия и дальнейшего использования результатов анализа (впрочем, способ вывода – на усмотрение каждого исследователя).

# Функция для расчета и анализа коэффициента линейной корреляции Пирсона

def corr_coef_check(X, Y, p_level=0.95, scale='Cheddok'):

a_level = 1 - p_level

X = np.array(X)

Y = np.array(Y)

n_X = len(X)

n_Y = len(Y)

# оценка коэффициента линейной корреляции средствами scipy

corr_coef, a_corr_coef_calc = sci.stats.pearsonr(X, Y)

# несмещенная оценка коэффициента линейной корреляции (при n < 15) (см.Кобзарь, с.607)

if n_X < 15:

corr_coef = corr_coef * (1 + (1 - corr_coef**2) / (2*(n_X-3)))

# проверка гипотезы о значимости коэффициента корреляции

t_corr_coef_calc = abs(corr_coef) * sqrt(n_X-2) / sqrt(1 - corr_coef**2)

t_corr_coef_table = sci.stats.t.ppf((1 + p_level)/2 , n_X - 2)

conclusion_corr_coef_sign = 'significance' if t_corr_coef_calc >= t_corr_coef_table else 'not significance'

# доверительный интервал коэффициента корреляции

if t_corr_coef_calc >= t_corr_coef_table:

z1 = np.arctanh(corr_coef) - sci.stats.norm.ppf((1 + p_level)/2, 0, 1) / sqrt(n_X-3) - corr_coef / (2*(n_X-1))

z2 = np.arctanh(corr_coef) + sci.stats.norm.ppf((1 + p_level)/2, 0, 1) / sqrt(n_X-3) - corr_coef / (2*(n_X-1))

corr_coef_conf_int_low = tanh(z1)

corr_coef_conf_int_high = tanh(z2)

else:

corr_coef_conf_int_low = corr_coef_conf_int_high = '-'

# оценка тесноты связи

if scale=='Cheddok':

conclusion_corr_coef_scale = scale + ': ' + Cheddock_scale_check(corr_coef)

elif scale=='Evans':

conclusion_corr_coef_scale = scale + ': ' + Evans_scale_check(corr_coef)

# формируем результат

result = pd.DataFrame({

'notation': ('r'),

'coef_value': (corr_coef),

'coef_value_squared': (corr_coef**2),

'p_level': (p_level),

'a_level': (a_level),

't_calc': (t_corr_coef_calc),

't_table': (t_corr_coef_table),

't_calc >= t_table': (t_corr_coef_calc >= t_corr_coef_table),

'a_calc': (a_corr_coef_calc),

'a_calc <= a_level': (a_corr_coef_calc <= a_level),

'significance_check': (conclusion_corr_coef_sign),

'conf_int_low': (corr_coef_conf_int_low),

'conf_int_high': (corr_coef_conf_int_high),

'scale': (conclusion_corr_coef_scale)

},

index=['Correlation coef.'])

return result # Функция для расчета и анализа корреляционного отношения

def corr_ratio_check(X, Y, p_level=0.95, orientation='XY', scale='Cheddok'):

a_level = 1 - p_level

X = np.array(X)

Y = np.array(Y)

n_X = len(X)

n_Y = len(Y)

# запишем данные в DataFrame

matrix_XY_df = pd.DataFrame({

'X': X,

'Y': Y})

# число интервалов группировки

group_int_number = lambda n: round (3.31*log(n_X, 10)+1) if round (3.31*log(n_X, 10)+1) >=2 else 2

K_X = group_int_number(n_X)

K_Y = group_int_number(n_Y)

# группировка данных и формирование корреляционной таблицы

cut_X = pd.cut(X, bins=K_X)

cut_Y = pd.cut(Y, bins=K_Y)

matrix_XY_df['cut_X'] = cut_X

matrix_XY_df['cut_Y'] = cut_Y

CorrTable_df = pd.crosstab(

index=matrix_XY_df['cut_X'],

columns=matrix_XY_df['cut_Y'],

rownames=['cut_X'],

colnames=['cut_Y'])

CorrTable_np = np.array(CorrTable_df)

# итоги корреляционной таблицы по строкам и столбцам

n_group_X = [np.sum(CorrTable_np[i]) for i in range(K_X)]

n_group_Y = [np.sum(CorrTable_np[:,j]) for j in range(K_Y)]

# среднегрупповые значения переменной X

Xboun_mean = [(CorrTable_df.index[i].left + CorrTable_df.index[i].right)/2 for i in range(K_X)]

Xboun_mean[0] = (np.min(X) + CorrTable_df.index[0].right)/2 # исправляем значения в крайних интервалах

Xboun_mean[K_X-1] = (CorrTable_df.index[K_X-1].left + np.max(X))/2

# среднегрупповые значения переменной Y

Yboun_mean = [(CorrTable_df.columns[j].left + CorrTable_df.columns[j].right)/2 for j in range(K_Y)]

Yboun_mean[0] = (np.min(Y) + CorrTable_df.columns[0].right)/2 # исправляем значения в крайних интервалах

Yboun_mean[K_Y-1] = (CorrTable_df.columns[K_Y-1].left + np.max(Y))/2

# средневзевешенные значения X и Y для каждой группы

Xmean_group = [np.sum(CorrTable_np[:,j] * Xboun_mean) / n_group_Y[j] for j in range(K_Y)]

Ymean_group = [np.sum(CorrTable_np[i] * Yboun_mean) / n_group_X[i] for i in range(K_X)]

# общая дисперсия X и Y

Sum2_total_X = np.sum(n_group_X * (Xboun_mean - np.mean(X))**2)

Sum2_total_Y = np.sum(n_group_Y * (Yboun_mean - np.mean(Y))**2)

# межгрупповая дисперсия X и Y (дисперсия групповых средних)

Sum2_between_group_X = np.sum(n_group_Y * (Xmean_group - np.mean(X))**2)

Sum2_between_group_Y = np.sum(n_group_X * (Ymean_group - np.mean(Y))**2)

# эмпирическое корреляционное отношение

corr_ratio_XY = sqrt(Sum2_between_group_Y / Sum2_total_Y)

corr_ratio_YX = sqrt(Sum2_between_group_X / Sum2_total_X)

try:

if orientation!='XY' and orientation!='YX':

raise ValueError("Error! Incorrect orientation!")

if orientation=='XY':

corr_ratio = corr_ratio_XY

elif orientation=='YX':

corr_ratio = corr_ratio_YX

except ValueError as err:

print(err)

# проверка гипотезы о значимости корреляционного отношения

F_corr_ratio_calc = (n_X - K_X)/(K_X - 1) * corr_ratio**2 / (1 - corr_ratio**2)

dfn = K_X - 1

dfd = n_X - K_X

F_corr_ratio_table = sci.stats.f.ppf(p_level, dfn, dfd, loc=0, scale=1)

a_corr_ratio_calc = 1 - sci.stats.f.cdf(F_corr_ratio_calc, dfn, dfd, loc=0, scale=1)

conclusion_corr_ratio_sign = 'significance' if F_corr_ratio_calc >= F_corr_ratio_table else 'not significance'

# доверительный интервал корреляционного отношения

if F_corr_ratio_calc >= F_corr_ratio_table:

f1 = round ((K_X - 1 + n_X * corr_ratio**2)**2 / (K_X - 1 + 2 * n_X * corr_ratio**2))

f2 = n_X - K_X

z1 = (n_X - K_X) / n_X * corr_ratio**2 / (1 - corr_ratio**2) * 1/sci.stats.f.ppf(p_level, f1, f2, loc=0, scale=1) - (K_X - 1)/n_X

z2 = (n_X - K_X) / n_X * corr_ratio**2 / (1 - corr_ratio**2) * 1/sci.stats.f.ppf(1 - p_level, f1, f2, loc=0, scale=1) - (K_X - 1)/n_X

corr_ratio_conf_int_low = sqrt(z1) if sqrt(z1) >= 0 else 0

corr_ratio_conf_int_high = sqrt(z2) if sqrt(z2) <= 1 else 1

else:

corr_ratio_conf_int_low = corr_ratio_conf_int_high = '-'

# оценка тесноты связи

if scale=='Cheddok':

conclusion_corr_ratio_scale = scale + ': ' + Cheddock_scale_check(corr_ratio, name=chr(951))

elif scale=='Evans':

conclusion_corr_ratio_scale = scale + ': ' + Evans_scale_check(corr_ratio, name=chr(951))

# формируем результат

result = pd.DataFrame({

'notation': (chr(951)),

'coef_value': (corr_ratio),

'coef_value_squared': (corr_ratio**2),

'p_level': (p_level),

'a_level': (a_level),

'F_calc': (F_corr_ratio_calc),

'F_table': (F_corr_ratio_table),

'F_calc >= F_table': (F_corr_ratio_calc >= F_corr_ratio_table),

'a_calc': (a_corr_ratio_calc),

'a_calc <= a_level': (a_corr_ratio_calc <= a_level),

'significance_check': (conclusion_corr_ratio_sign),

'conf_int_low': (corr_ratio_conf_int_low),

'conf_int_high': (corr_ratio_conf_int_high),

'scale': (conclusion_corr_ratio_scale)

},

index=['Correlation ratio'])

return result # Функция для проверка значимости линейной корреляционной связи

def line_corr_sign_check(X, Y, p_level=0.95, orientation='XY'):

a_level = 1 - p_level

X = np.array(X)

Y = np.array(Y)

n_X = len(X)

n_Y = len(Y)

# коэффициент корреляции

corr_coef = sci.stats.pearsonr(X, Y)[0]

# корреляционное отношение

try:

if orientation!='XY' and orientation!='YX':

raise ValueError("Error! Incorrect orientation!")

if orientation=='XY':

corr_ratio = corr_ratio_check(X, Y, orientation='XY', scale='Evans')['coef_value'].values[0]

elif orientation=='YX':

corr_ratio = corr_ratio_check(X, Y, orientation='YX', scale='Evans')['coef_value'].values[0]

except ValueError as err:

print(err)

# число интервалов группировки

group_int_number = lambda n: round (3.31*log(n_X, 10)+1) if round (3.31*log(n_X, 10)+1) >=2 else 2

K_X = group_int_number(n_X)

# проверка гипотезы о значимости линейной корреляционной связи

if corr_ratio >= abs(corr_coef):

F_line_corr_sign_calc = (n_X - K_X)/(K_X - 2) * (corr_ratio**2 - corr_coef**2) / (1 - corr_ratio**2)

dfn = K_X - 2

dfd = n_X - K_X

F_line_corr_sign_table = sci.stats.f.ppf(p_level, dfn, dfd, loc=0, scale=1)

comparison_F_calc_table = F_line_corr_sign_calc >= F_line_corr_sign_table

a_line_corr_sign_calc = 1 - sci.stats.f.cdf(F_line_corr_sign_calc, dfn, dfd, loc=0, scale=1)

comparison_a_calc_a_level = a_line_corr_sign_calc <= a_level

conclusion_null_hypothesis_check = 'accepted' if F_line_corr_sign_calc < F_line_corr_sign_table else 'unaccepted'

conclusion_line_corr_sign = 'linear' if conclusion_null_hypothesis_check == 'accepted' else 'non linear'

else:

F_line_corr_sign_calc = ''

F_line_corr_sign_table = ''

comparison_F_calc_table = ''

a_line_corr_sign_calc = ''

comparison_a_calc_a_level = ''

conclusion_null_hypothesis_check = 'Attention! The correlation ratio is less than the correlation coefficient'

conclusion_line_corr_sign = '-'

# формируем результат

result = pd.DataFrame({

'corr.coef.': (corr_coef),

'corr.ratio.': (corr_ratio),

'null hypothesis': ('ru00b2 = ' + chr(951) + 'u00b2'),

'p_level': (p_level),

'a_level': (a_level),

'F_calc': (F_line_corr_sign_calc),

'F_table': (F_line_corr_sign_table),

'F_calc >= F_table': (comparison_F_calc_table),

'a_calc': (a_line_corr_sign_calc),

'a_calc <= a_level': (comparison_a_calc_a_level),

'null_hypothesis_check': (conclusion_null_hypothesis_check),

'significance_line_corr_check': (conclusion_line_corr_sign),

},

index=['Significance of linear correlation'])

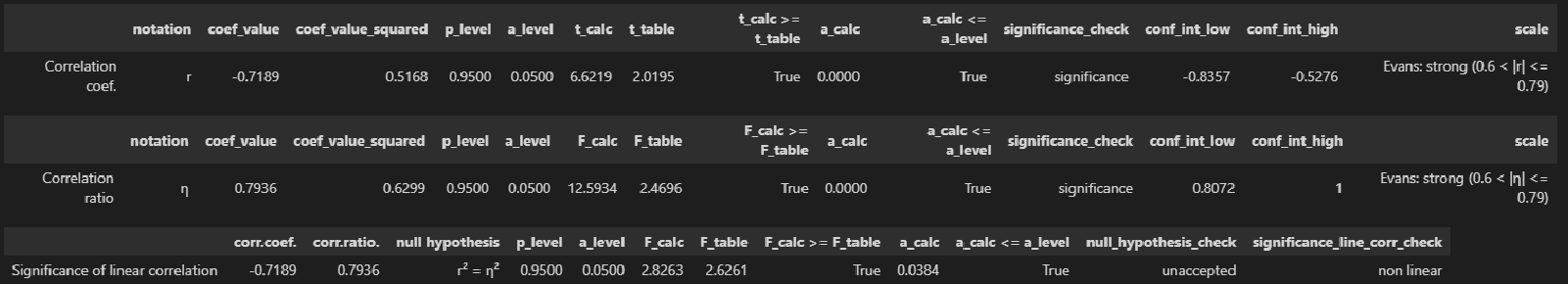

return resultdisplay(corr_coef_check(X, Y, scale='Evans'))

display(corr_ratio_check(X, Y, orientation='XY', scale='Evans'))

display(line_corr_sign_check(X, Y, orientation='XY'))Сделаем выводы по результатам расчетов:

-

Между величинами существует значимая (acalc<0.05) корреляционная связь, корреляционное отношение η = 0.7936 (т.е. связь сильная по Эвансу).

-

Линейная корреляционная связь между величинами также значимая (acalc<0.05), отрицательная, коэффициент корреляции r = -0.7189 (связь сильная по Эвансу); линейная корреляция между переменными объясняет 51.68% вариации.

-

Гипотеза о равенстве корреляционного отношения и коэффициента корреляции отвергается (acalc<0.05), то есть отличие линейной формы связи от нелинейной значимо.

ИТОГИ

Итак, мы рассмотрели способы построения корреляционной таблицы, расчета корреляционного отношения, проверки его значимости и построения для него доверительных интервалов средствами Python. Также предложены пользовательские функции, уменьшающие размер кода.

Исходный код находится в моем репозитории на GitHub (https://github.com/AANazarov/Statistical-methods).

ЛИТЕРАТУРА

-

Айвазян С.А. и др. Прикладная статистика: исследование зависимостей. – М.: Финансы и статистика, 1985. – 487 с.

-

Айвазян С.А., Мхитарян В.С. Прикладная статистика. Основы эконометрики: В 2 т. – Т.1: Теория вероятностей и прикладная статистика. – М.: ЮНИТИ-ДАНА, 2001. – 656 с.

-

Кобзарь А.И. Прикладная математическая статистика. Для инженеров и научных работников. – М.: ФИЗМАТЛИТ, 2006. – 816 с.

-

Котеров А.Н. и др. Сила связи. Сообщение 2. Градации величины корреляции. – Медицинская радиология и радиационная безопасность. 2019. Том 64. № 6. с.12–24 (https://medradiol.fmbafmbc.ru/journal_medradiol/abstracts/2019/6/12-24_Koterov_et_al.pdf).

В социальной гигиене и организации здравоохранения, в различных

разделах медицины и биологии часто приходится проводить статистический анализ связей всевозможных признаков в совокупности. Необходимо

уметь изучать особенности этих связей, определять их размеры и характер, а также оценивать их достоверность.

Врачу любой специальности в практической деятельности приходится наблюдать изменения в состоянии здоровья человека и отдельных групп населения, происходящие в результате воздействия определенных факторов, как в позитивном, так и в негативном направлении.

Для того, чтобы уметь отличить случайное от объективного надо знать и уметь это делать. Этому служит данная тема.

Необходимо знать:

- Коэффициент корреляции (оценка, методы расчета)

- Значение и практическое применение.

Контрольные вопросы:

1.Какие виды связи могут быть между явлениями в природе и обществе?

2. Определение функциональной связи. Примеры.

3. Понятие о корреляционной связи. Примеры.

4. Направление, сила, форма связи.

5. Методы определения коэффициентов корреляции.

Задачи для самостоятельного решения

ВОПРОСЫ ТЕСТОВОГО КОНТРОЛЯ

Информационный блок

Все явления в природе и обществе находятся во взаимной связи.

Различают две формы связи: функциональную и корреляционную.

Функциональная связь означает строгую зависимость явлений.

При функциональной связи изменение какого либо одного явления вызывает обязательно строго определенные по величине изменения другого явления.

Радиусу круга соответствует определенная площадь круга,

скорость свободно падающего тела определяется величиной ускорения

силы тяжести и времени падения, и т.д.

Такого рода связь чаще наблюдается в физико-химических явлениях.

В области биологических и общественных явлений чаще встречаются взаимосвязи иного характера.

Такого рода связи называют статистическими, или корреляционными.

Корреляция (лат.) – означает соотношение, взаимосвязь между признаками.

Корреляция – взаимосвязь между двумя или более переменными.

При корреляционной связи значению каждой средней величины одного признака соответствует несколько значений другого взаимосвязанного с ним признака.

Цель корреляционного анализа – установление наличия или отсутствия этой

взаимосвязи.

В случае, когда имеются две переменных, значения которых

измерены в шкале отношений, используется коэффициент линейной

корреляции Пирсона r, который принимает значения от -1 до +1.

Термин «линейный» свидетельствует о том, что исследуется наличие

линейной связи между переменными.

Для данных, измеренных в порядковой шкале, следует использовать

коэффициент ранговой корреляции Спирмена, так как он является

непараметрическим и улавливает тенденцию – изменения переменных в

одном направлении, который обозначается Rs и определяется сравнением

рангов – номеров значений сравниваемых переменных в их упорядочении.

Коэффициент корреляции Спирмена является менее чувствительным, чем

коэффициент корреляции Пирсона.

Важно отметить, что близкое к плюс единице или к минус единице

значение коэффициента корреляции говорит о силе взаимосвязи переменных прямой или обратной, но ничего не говорит о причинно-следственных отношениях между ними.

Например:

Всем известно, что рост и масса тела человека связаны между собой. У группы лиц с одинаковым ростом наблюдаются различные колебания массы тела. Однако эти колебания массы тела варьируют в определенных размерах – вокруг своей средней величины.

Между уровнем температуры тела человека и числом сердечных сокращений существует также зависимость. При одинаковой температуре тела у различных людей наблюдаются индивидуальные колебания частоты сердечных сокращений, варьирующие вокруг своей средней.

Уровень антитоксина в крови и заболеваемость дифтерией взаимосвязаны между собой. При одинаковом уровне антитоксина в разных группах детей встречается разное количество заболевших.

В качестве примеров корреляционной связи можно указать на связь между количеством проведенных профилактических прививок и размерами заболеваемости, между размерами заболеваемости и смертности, между сроками изоляции инфекционных больных и частотой вторичных заболеваний в очаге, между качеством питьевой воды и заболеваемостью острыми кишечными инфекциями и т.д.

Используя методы корреляции, важно помнить о возможности измерять связь между различными признаками только лишь в качественно однородной совокупности. Нельзя, например, сопоставлять рост и массу тела людей, состоящих из лиц разного пола и возраста.

Параллельное изменение признаков двух явлений само по себе еще не говорит (хотя и наводит на мысль) о наличии связи между ними, так как может быть обусловлено случайным совпадением многих обстоятельств, не связанных друг с другом.

Измерение связи методами статистики целесообразно только тогда, когда наличие и материальная природа связи хотя бы предположительно установлена специальными методами данной науки.

При наличии действительной связи, установленной на основе конкретного анализа материальной природы изучаемых явлений, статистика дает возможность измерить размер (тесноту, силу) этой связи и установить степень зависимости между изучаемыми явлениями.

Измерение связи заключается в определении ее размеров (тесноты, силы).

Под теснотой связи понимается степень сопряженности связанных признаков, широта варьирования каждого из них при изменении средней величины другого.

Помимо тесноты связи, статистические методы позволяют вскрыть форму этой связи.

По силе связи корреляция колеблется от 0 до 1:

от 0 до 0,3 – слабая,

от 0,3 до 0,69 – средняя,

от 0,7 до 1 – сильная.

При силе связи равной 1 выявлена полная связь (функциональная связь). Сила связи измеряется коэффициентами корреляции.

По характеру связь может быть прямой и обозначается (+) и обратной (-).

Прямая связь – это такая связь, когда изменение одного признака влечет за собой изменение другого в том же направлении. Обратная связь – один признак увеличивается, другой уменьшается.

По форме (или направленности) корреляционные связи подразделяются на прямолинейные, когда наблюдается пропорциональное изменение одного признака в зависимости от изменения другого (графически это выражается в виде прямой линии), и криволинейные, когда одна величина признака изменяется непропорционально изменению другой (на графике эти связи изображаются параболами или иной кривой линией).

Методы сравнения наблюдений, которые независимо от вида распределения называют ранговыми или непараметрическими, т.е. независящими от формы распределения признаков в генеральной совокупности.

Их применение в медико-биологических исследованиях более оправдано хотя бы потому, что они менее трудоемкие по сравнению с другими.

Наиболее часто в этом случае используется метод определения коэффициента корреляции рангов (Спирмена). Этот коэффициент целесообразно использовать, при наличии небольшого числа наблюдений в случаях, когда сопоставляемые данные носят приближенный характер, а форма связи – криволинейна.

При наличии прямолинейной связи между взаимосвязанными компонентными признаками, особенно при большом числе наблюдений, рациональнее прибегать к параметрическим методам оценки, которые требуют вычисления определенных параметров средней величины, среднеквадратического отклонения, средней ошибки. При этом вычисление связи проводится при числе наблюдений 30 и менее сравниваемых пар по методу квадратов (К. Пирсона).

Метод определения коэффициента ранговой корреляции или метод рангов, или метод Спирмена (по автору)

Последовательность расчета:

Задача:

Влияние удельного веса нестандартной воды по бак. показателям в Свердловском районе г. Перми на заболеваемость ОКИ.

Эталон решения